网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

<name>dfs.namenode.secondary.http-address</name>

<value>node2:9868</value>

补充:这里指定secondarynamenode在node2上,也就意味着我们jps时,这个进程是显示在node2节点上,而不是node1,如果想要放在node1上,只需修改value的值即可。

### 4、mapred-site.xml

作用:mapreduce相关的

注意:有些版本是没有mapred-site.xml文件的,只有mapred-site.xml.template模板,可以先复制一份这样的模板,再去修改。

1)备份mapred-site.xml.template

cp mapred-site.xml.template mapred-site.xml

如果有mapred-site.xml,忽略这一步。

2)修改文件

vi mapred-site.xml

### 5、yarn-site.xml

作用:与yarn相关的,指定resourcemanager的位置信息。

vi yarn-site.xml

#在configuration标签内添加内容

### 6、workers

作用:指定工作的节点有哪些。

注意:在hadoop3.0以前,这个文件叫slaves,3.0之后叫做workers。由于我这里是hadoop3.3.0,所以

vi workers

把文件里面的localhost删除,添加以下内容

node1

node2

node3

**补充**: /etc/hosts 和 workers 这两个文件里的主机名写法应该保持一致,否则会导致启动集群时,系统无法识别主机名。比如我/etc/hosts 里写的是node1,那 workers 里写的也应该是node1,而不是node1.itcast.cn。

**至此,配置文件修改完成。**

## 三、分发同步hadoop

先前并没有同步hadoop服务,是因为想等修改好配置文件后,再把整个hadoop目录同步过去。

1)回到服务安装路径下,也就是我这里的`/export/servers`。

cd /export/servers

2)执行以下命令

scp -r hadoop-3.3.0 root@node2: P W D s c p − r h a d o o p − 3.3.0 r o o t @ n o d e 3 : PWD scp -r hadoop-3.3.0 root@node3: PWDscp−rhadoop−3.3.0root@node3:PWD

补充:**$PWD表示当前节点所在的绝对路径**,在这里就是`/export/servers`,

在执行上述命令后,会把node1当前路径下的hadoop-3.3.0目录及其子目录、文件 复制到 node2和node3 的相同路径(/export/servers)下。也就是root@node2:/export/servers 的另一种写法。

至此,所有节点都安装了hadoop。

## 四、配置环境变量

光是下载好jdk和hadoop是不行的,系统不知道它们的路径,也就无法正常使用它们。就像我们在命令符界面使用某些工具时,都需要去到相应的路径才能正常使用一样。

负责环境变量的文件是`/etc/profile`。

### 1、修改环境变量

vi /etc/profile

将下面内容添加到profile文件中,然后保存退出。

#java path

export JAVA_HOME=/export/servers/jdk1.8.0_241

export PATH=

P

A

T

H

:

PATH:

PATH:JAVA_HOME/bin

export CLASSPATH=.:

J

A

V

A

_

H

O

M

E

/

l

i

b

/

d

t

.

j

a

r

:

JAVA\_HOME/lib/dt.jar:

JAVA_HOME/lib/dt.jar:JAVA_HOME/lib/tools.jar

#hadoop path

export HADOOP_HOME=/export/servers/hadoop-3.3.0

export PATH=

P

A

T

H

:

PATH:

PATH:HADOOP_HOME/bin:$HADOOP_HOME/sbin

补充:一定要以自己的jdk和hadoop安装路径为准

### 2、分发环境变量文件

将修改好的profile分件分发给其它节点,就无需每个都配置一次。

scp /etc/profile root@node2:/etc/

scp /etc/profile root@node3:/etc/

### 3、使文件生效

一般情况下,保存的配置文件会在下一次启动时更新,使用以下命令可以在当前会话生效,**每个节点都执行一次**。

source /etc/profile

### 4、查看版本,检验安装

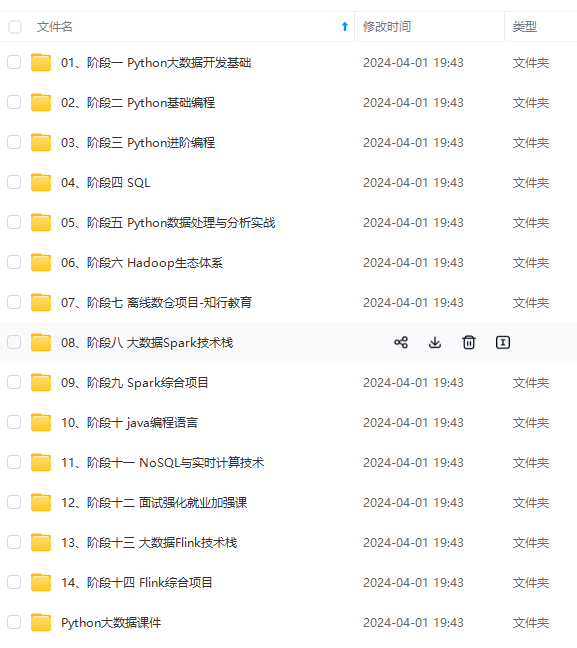

**既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,涵盖了95%以上大数据知识点,真正体系化!**

**由于文件比较多,这里只是将部分目录截图出来,全套包含大厂面经、学习笔记、源码讲义、实战项目、大纲路线、讲解视频,并且后续会持续更新**

**[需要这份系统化资料的朋友,可以戳这里获取](https://bbs.csdn.net/forums/4f45ff00ff254613a03fab5e56a57acb)**

链图片转存中...(img-iXGyV6ZX-1715241230067)]

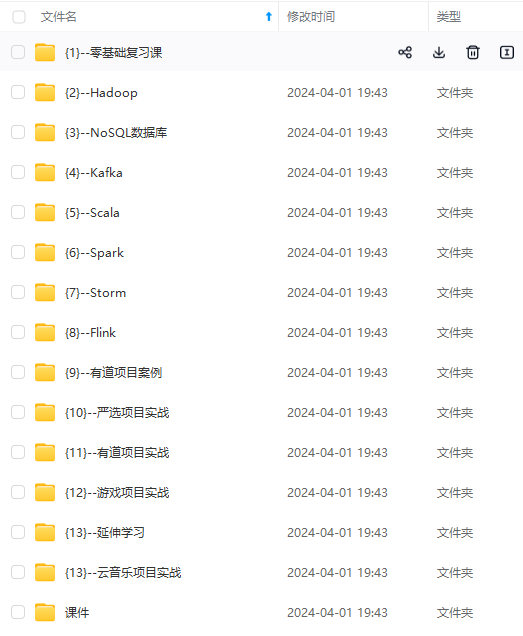

**既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,涵盖了95%以上大数据知识点,真正体系化!**

**由于文件比较多,这里只是将部分目录截图出来,全套包含大厂面经、学习笔记、源码讲义、实战项目、大纲路线、讲解视频,并且后续会持续更新**

**[需要这份系统化资料的朋友,可以戳这里获取](https://bbs.csdn.net/forums/4f45ff00ff254613a03fab5e56a57acb)**

3381

3381

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?