网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

修改内容:

# TaskManager节点地址.需要配置为当前机器名

taskmanager.host: hadoop103

执行命令:

[hadoop@hadoop104 conf]$ vim flink-conf.yaml

修改内容:

# TaskManager节点地址.需要配置为当前机器名

taskmanager.host: hadoop104

三、启动关闭集群(Standalone模式)

在hadoop102节点服务器上执行start-cluster.sh启动Flink集群

# 启动

[hadoop@hadoop102 flink-1.17.0]$ bin/start-cluster.sh

# 关闭

[hadoop@hadoop102 flink-1.17.0]$ bin/stop-cluster.sh

四、访问WEB-UI

启动成功后,同样可以访问http://hadoop102:8081对flink集群和任务进行监控管理。

五、向集群提交作业(会话模式部署)

5.1 WEB-UI方式提交

5.2 命令行方式提交

bin/flink run -m hadoop102:8081 -c com.atguigu.flink01.Flink03_WC_Unbound_Socket ./flink-0918-1.0-SNAPSHOT.jar

六、Flink集群运行模式

Flink集群的运行模式

6.1 Standalone模式

默认

6.2 Flink on Yarn模式

6.2.1 相关准备和配置(配置环境变量并分发)

[hadoop@hadoop102 ~]$ sudo vim /etc/profile.d/my_env.sh

新增内容:

#Flink on Yarn

export HADOOP\_CONF\_DIR=${HADOOP\_HOME}/etc/hadoop

export HADOOP\_CLASSPATH=`hadoop classpath`

其他两台机器同样新增该环境变量

使环境变量生效:

[hadoop@hadoop102 ~]$ mytools_call source /etc/profile

6.2.2 以会话模式在Flink on Yarn集群上部署Flink应用程序

YARN的会话模式与独立集群略有不同,需要首先申请一个YARN会话(YARN Session)来启动Flink集群

-nm(–name):配置在YARN UI界面上显示的任务名。

(1)启动关闭Flink集群

# 启动

[hadoop@hadoop102 flink-1.17.0]$ bin/yarn-session.sh -nm flink-session-cluster01

# 关闭

[hadoop@hadoop102 ~]$ yarn application -kill application_1700281106461_0453

(2)提交作业(WEB-UI方式)

部署到阿里云的这里IP有点问题,跳转到Flink WEB-UI时是内网IP

(3)提交作业(命令行方式)

[hadoop@hadoop102 flink-1.17.0]$ bin/flink run -c com.atguigu.flink01.Flink03_WC_Unbound_Socket ./flink-0918-1.0-SNAPSHOT.jar

6.2.3 以单作业模式在Flink on Yarn集群上部署Flink应用程序

启动一个Flink集群并提交作业

-d:后台运行

-t:指定部署模式(单作业模式)

# 启动

[hadoop@hadoop102 flink-1.17.0]$ bin/flink run -d -t yarn-per-job -c com.atguigu.flink01.Flink03_WC_Unbound_Socket ./flink-0918-1.0-SNAPSHOT.jar

# 关闭(通过WEB UI页面cancel作业)

6.2.4 以应用模式在Flink on Yarn集群上部署Flink应用程序

(1)启动

应用模式同样非常简单,与单作业模式类似,直接执行flink run-application命令即可

-d:后台运行

-t:指定部署模式(应用模式)

[hadoop@hadoop102 flink-1.17.0]$ bin/flink run-application -d -t yarn-application -c com.atguigu.flink01.Flink03_WC_Unbound_Socket ./flink-0918-1.0-SNAPSHOT.jar

(2)上传Flink的lib和plugins到HDFS上

将Flink应用程序用到Flink集群中的lib上传到Hadoop集群上。

[hadoop@hadoop102 flink-1.17.0]$ hadoop fs -mkdir /flink-dist

[hadoop@hadoop102 flink-1.17.0]$ hadoop fs -put lib/ /flink-dist

[hadoop@hadoop102 flink-1.17.0]$ hadoop fs -put plugins/ /flink-dist

(3)上传Flink应用程序jar到HDFS上

[hadoop@hadoop102 flink-1.17.0]$ hadoop fs -mkdir /flink-jars

[hadoop@hadoop102 flink-1.17.0]$ hadoop fs -put ./flink-0918-1.0-SNAPSHOT.jar /flink-jars

(4)提交作业

[hadoop@hadoop102 flink-1.17.0]$ bin/flink run-application -d -t yarn-application -Dyarn.provided.lib.dirs="hdfs://hadoop102:9820/flink-dist" -c com.atguigu.flink01.Flink03_WC_Unbound_Socket hdfs://hadoop102:9820/flink-jars/flink-0918-1.0-SNAPSHOT.jar

6.2.5 应用模式与单作业模式的区别

单作业模式:客户端需要执行main方法,将JobGraph提交给YARN上的JobManager。

应用模式:应用程序jar的main()方法将在YARN中的JobManager上执行。客户端仅仅是执行命令。

6.3 配置Flink历史服务器

6.3.1 创建存储目录

[hadoop@hadoop102 flink-1.17.0]$ hadoop fs -mkdir -p /logs/flink-job

6.3.2 修改配置文件flink-config.yaml

[hadoop@hadoop102 conf]$ vim flink-conf.yaml

新增内容:

找到historyserver部分(在最后),添加到该位置即可。

jobmanager.archive.fs.dir: hdfs://hadoop102:9820/logs/flink-job

historyserver.web.address: hadoop102

historyserver.web.port: 8082

historyserver.archive.fs.dir: hdfs://hadoop102:9820/logs/flink-job

historyserver.archive.fs.refresh-interval: 5000

6.3.3 启动停止历史服务器

# 启动

[hadoop@hadoop102 flink-1.17.0]$ bin/historyserver.sh start

# 停止

[hadoop@hadoop102 flink-1.17.0]$ bin/historyserver.sh stop

6.3.4 重启Yarn(跳过)

如果历史服务器不生效则需要重启,正常情况不需要。

stop-yarn.sh

start-yarn.sh

6.3.5 访问Flink历史服务器地址

在yarn的WEB-UI界面,点击任务的History位置,如果Flink历史服务器生效就会跳转到Flink历史服务器UI界面,否则会跳转到Yarn的UI界面。

地址:http://hadoop102:8082

七、Flink Standalone会话模式的系统架构

7.1 基础架构图

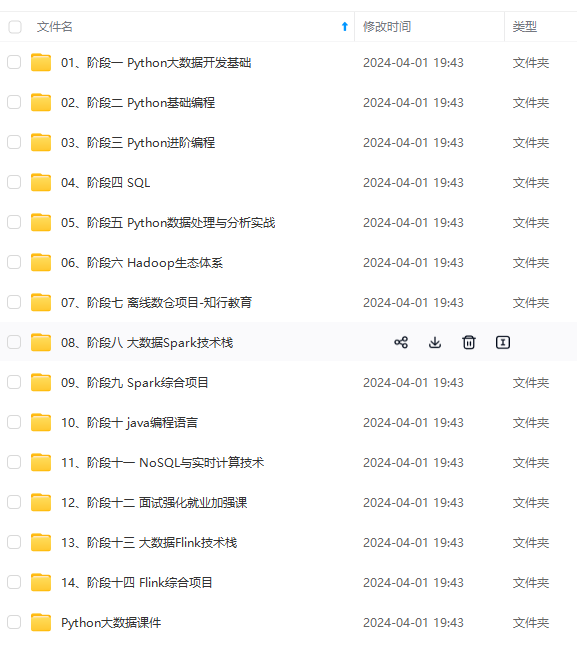

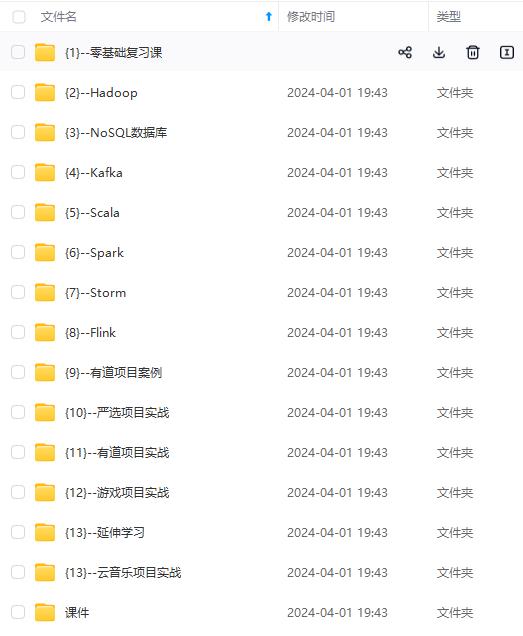

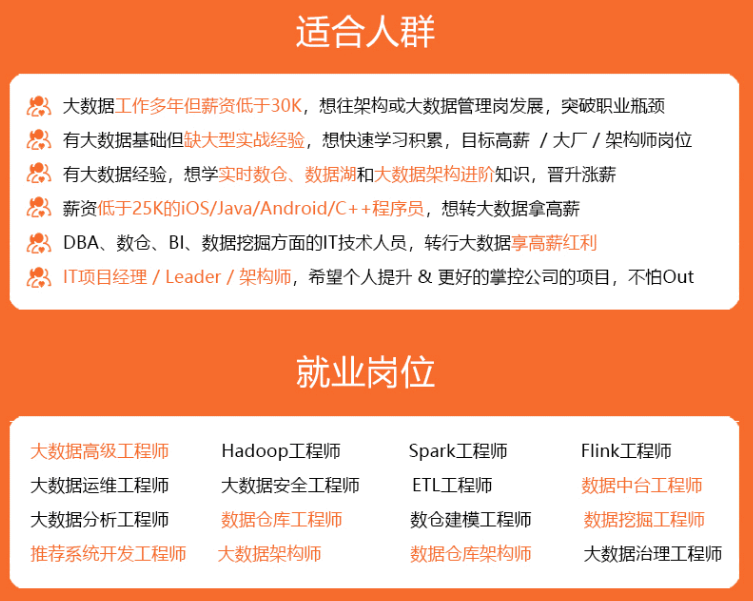

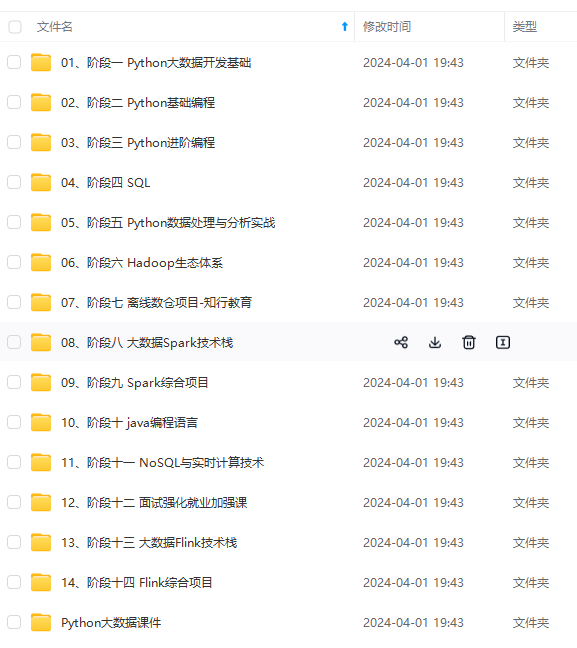

既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,涵盖了95%以上大数据知识点,真正体系化!

由于文件比较多,这里只是将部分目录截图出来,全套包含大厂面经、学习笔记、源码讲义、实战项目、大纲路线、讲解视频,并且后续会持续更新

七、Flink Standalone会话模式的系统架构

7.1 基础架构图

[外链图片转存中…(img-b4BDk72z-1715641256372)]

[外链图片转存中…(img-Z6kyx0bm-1715641256372)]

[外链图片转存中…(img-QAY7uBXF-1715641256373)]

既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,涵盖了95%以上大数据知识点,真正体系化!

由于文件比较多,这里只是将部分目录截图出来,全套包含大厂面经、学习笔记、源码讲义、实战项目、大纲路线、讲解视频,并且后续会持续更新

472

472

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?