先自我介绍一下,小编浙江大学毕业,去过华为、字节跳动等大厂,目前阿里P7

深知大多数程序员,想要提升技能,往往是自己摸索成长,但自己不成体系的自学效果低效又漫长,而且极易碰到天花板技术停滞不前!

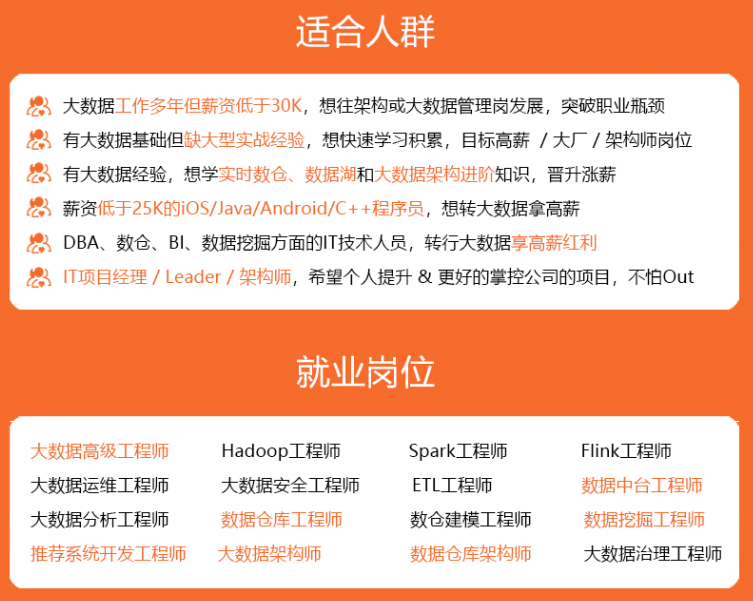

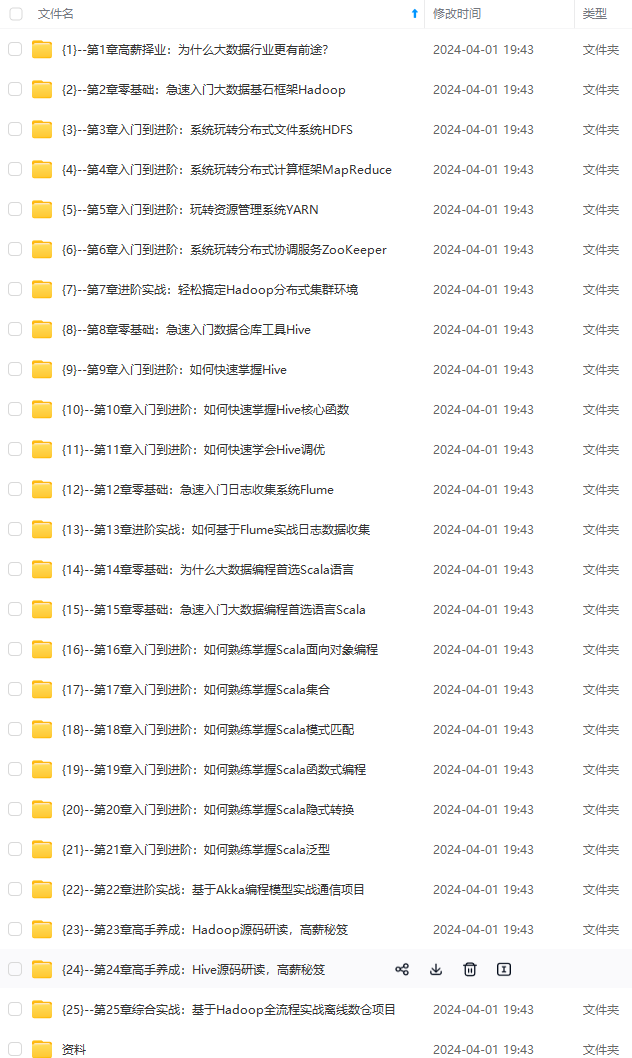

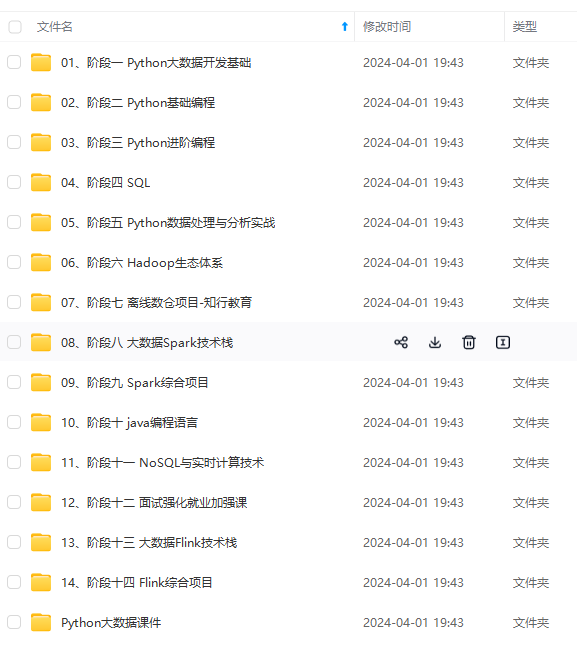

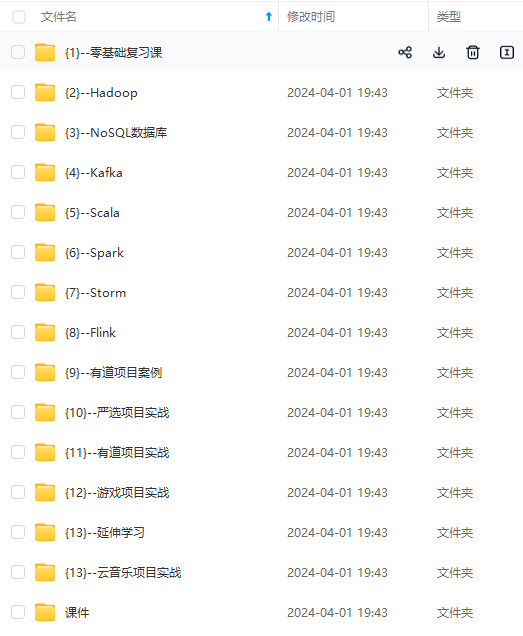

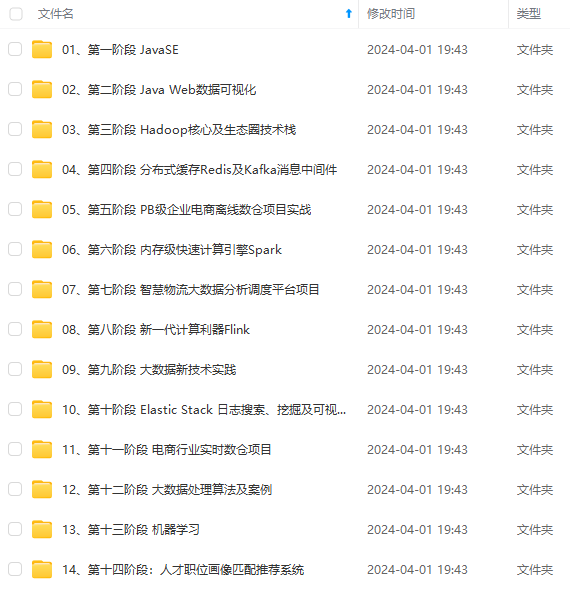

因此收集整理了一份《2024年最新大数据全套学习资料》,初衷也很简单,就是希望能够帮助到想自学提升又不知道该从何学起的朋友。

既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,涵盖了95%以上大数据知识点,真正体系化!

由于文件比较多,这里只是将部分目录截图出来,全套包含大厂面经、学习笔记、源码讲义、实战项目、大纲路线、讲解视频,并且后续会持续更新

如果你需要这些资料,可以添加V获取:vip204888 (备注大数据)

正文

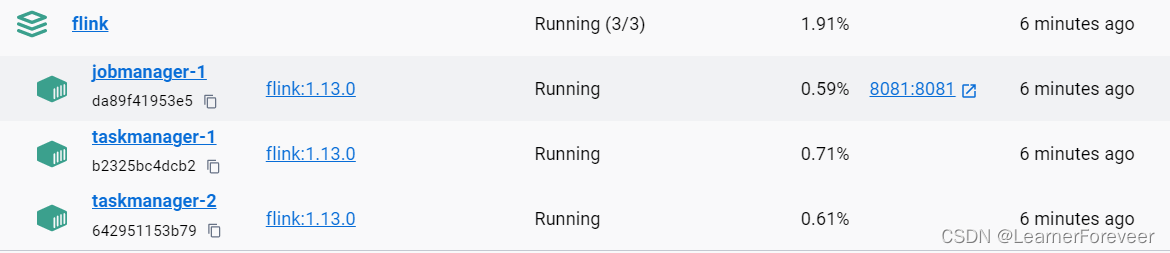

创建容器

这里通过docker-compose定义一个包含一个作业管理器和两个任务管理器的 Apache Flink 集群。作业管理器映射到主机的 8081 端口,而任务管理器则在同一网络下运行,并设置了各自的环境变量以连接到作业管理器。

version: "2"

services:

jobmanager:

image: flink:1.13.0

ports:

- "8081:8081"

command: jobmanager

environment:

- |

FLINK_PROPERTIES=

jobmanager.rpc.address: jobmanager

networks:

- flink-net

taskmanager-1:

image: flink:1.13.0

container_name: taskmanager-1

depends_on:

- jobmanager

command: taskmanager

environment:

- |

FLINK_PROPERTIES=

jobmanager.rpc.address: jobmanager

taskmanager.numberOfTaskSlots: 2

networks:

- flink-net

taskmanager-2:

image: flink:1.13.0

container_name: taskmanager-2

depends_on:

- jobmanager

command: taskmanager

environment:

- |

FLINK_PROPERTIES=

jobmanager.rpc.address: jobmanager

taskmanager.numberOfTaskSlots: 2

networks:

- flink-net

networks:

flink-net:

driver: bridge

在docker-compose.yml文件路径下的控制台输入下面的命令搭建集群:

docker-compose up

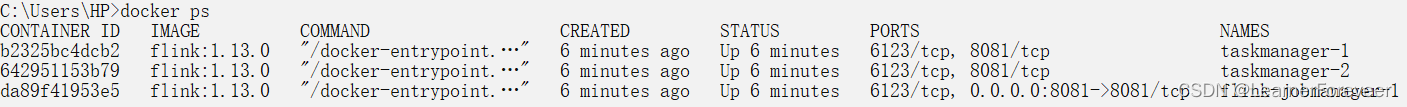

当然也可以通过docker命令查看当前已经搭建好了的flink集群:

docker ps

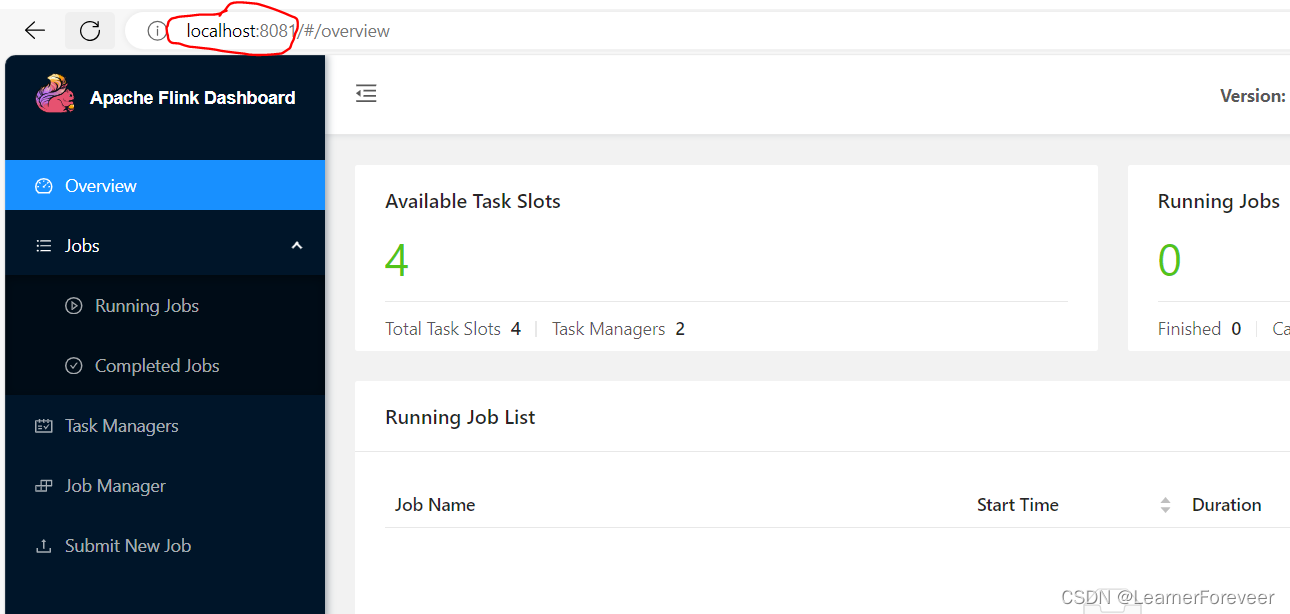

集群控制页面(Flink UI)

可以看到,在这里我们暴露了jobmanager的8081端口,通过这个端口我们可以打开Flink集群的UI界面并在上面提交程序jar包。

通过在浏览器的地址栏中输入localhost:8081即可打开Flink的UI页面:

Flink的UI页面是用于展示和监控Flink集群的运行状态和统计信息的Web可视化界面,通过它可以方便地查看集群总览、作业列表、作业监控、Task监控和日志查看等功能,帮助用户监控集群运行情况、发现和解决问题,并进行作业调优。

创建Flink任务程序

Flink任务程序是基于Apache Flink框架编写的数据处理应用程序,它由一系列数据转换和操作组成,用于实现对数据流或批量数据的实时处理。任务程序可以定义数据源、数据转换操作和数据汇,同时可以设置数据窗口、触发器和窗口函数等,以实现各种复杂的数据处理逻辑。Flink任务程序具有高度可扩展性和容错性,能够处理大规模数据流和批量数据,并具备低延迟和高吞吐量的特性。

在这里我们通过下面的实例来学习Flink项目的创建和任务的编写,在这一部分可能对一些特别深入细致的代码内容没办法进行详细的解释,如果读者想要对Flink进行深入的理解请学习Flink的系列课程,本篇文章仅仅带大家熟悉怎样在Docker中创建Flink集群并完成相应的任务。

任务:现有游戏交易数据,其数据格式为(交易类型,交易金额),现在请编写Flink Java任务来完成对不同交易类型的交易总金额进行统计。

Maven依赖导入

如果要通过Flink向Redis,HBase等Sink数据需要导其他的依赖,这里我们只是将最终数据sink到控制台上,所以就不需要这些其他的依赖了,只需要最基础的Flink-Java依赖即可。

由于flink依赖的包比较多,所以通过一个maven pom文件属性对这些依赖的作用范围进行管理:

<properties>

<base.flink.scope>compile</base.flink.scope>

</properties>

再次基础上将依赖写入:

<dependencies>

<dependency>

<groupId>org.apache.flink</groupId>

<artifactId>flink-java</artifactId>

<version>1.13.0</version>

<scope>${base.flink.scope}</scope>

</dependency>

<dependency>

<groupId>org.apache.flink</groupId>

<artifactId>flink-streaming-java_2.12</artifactId>

<version>1.13.0</version>

<scope>${base.flink.scope}</scope>

</dependency>

<dependency>

<groupId>org.apache.flink</groupId>

<artifactId>flink-clients_2.12</artifactId>

<version>1.13.0</version>

<scope>${base.flink.scope}</scope>

</dependency>

</dependencies>

编写自定义数据源

Flink中已经实现好了的数据源包括本地集合、文件、Kafka、Socket等。本地集合数据源适用于小规模数据集的测试和调试,可以直接将数据加载到内存中进行处理。文件数据源可以从本地文件系统或分布式文件系统(如HDFS)中读取数据,支持各种格式的文件,如文本文件、CSV文件等。Kafka数据源可以将数据从Kafka消息队列中读取,实现实时数据处理。Socket数据源可以从网络socket中读取数据,常用于接收实时数据流。此外,Flink还支持自定义数据源,开发者可以根据自己的需求实现自己的数据源逻辑。这些数据源提供了灵活且高效的数据输入方式,使得用户可以方便地将各种数据接入到Flink中进行处理。

虽然Flink中有许多已经实现好了的数据源,但是为了对Flink的自定义源进行了解,所以在这里我会自己手动实现一个自定义数据源。

根据我们上面提到的任务,在这里我会创建一个自定义源来自动创建随机的交易流水:

package source;

import org.apache.flink.streaming.api.functions.source.SourceFunction;

import java.util.Random;

// 自定义实现Flink的SourceFunction接口,产生随机交易流数据

public class RandomFlowSource implements SourceFunction<String> {

// 创建一个Random对象用于生成随机数

private static final Random rd = new Random();

// 用于控制数据源是否在运行的标志位

private volatile boolean isRunning = true;

@Override

public void run(SourceContext<String> sourceContext) throws Exception {

// 当数据源在运行时持续产生数据

while (isRunning) {

// 生成随机的交易类型,假设有3种交易类型

int transactionType = rd.nextInt(3);

// 生成随机的交易金额,取值范围为0到100

double transactionAmount = rd.nextDouble() * 100;

// 将交易类型和金额拼接成字符串,并将其发送给下游算子

sourceContext.collect(String.format("%d,%f", transactionType, transactionAmount));

// 线程休眠100毫秒,模拟实际数据产生的时间间隔

Thread.sleep(100);

}

}

@Override

public void cancel() {

// 当取消数据源时,修改标志位使数据源停止产生数据

isRunning = false;

}

}

创建任务处理程序

在完成了Flink数据源的创建之后,接下来就要完成最核心的任务处理部分的代码了。

package tasks;

import org.apache.flink.api.common.functions.MapFunction;

import org.apache.flink.api.java.functions.KeySelector;

import org.apache.flink.api.java.tuple.Tuple2;

import org.apache.flink.streaming.api.datastream.DataStreamSource;

import org.apache.flink.streaming.api.datastream.SingleOutputStreamOperator;

import org.apache.flink.streaming.api.environment.StreamExecutionEnvironment;

import scala.Int;

import source.RandomFlowSource;

public class TransactionAnalysisJob {

public static void main(String[] args) throws Exception {

// 获取Flink的执行环境

StreamExecutionEnvironment env = StreamExecutionEnvironment.getExecutionEnvironment();

// 添加自定义数据源RandomFlowSource作为数据输入源

DataStreamSource<String> dataSource = env.addSource(new RandomFlowSource());

// 使用MapFunction将输入的字符串转换成Tuple2<String, Double>类型的数据流

SingleOutputStreamOperator<Tuple2<String, Double>> mapOp = dataSource.map(new MapFunction<String, Tuple2<String, Double>>() {

@Override

public Tuple2<String, Double> map(String s) throws Exception {

// 将输入的字符串按逗号分割成交易类型和金额,并封装成Tuple2返回

String[] fields = s.split(",");

return Tuple2.of(fields[0], Double.parseDouble(fields[1]));

}

});

**网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。**

**需要这份系统化的资料的朋友,可以添加V获取:vip204888 (备注大数据)**

**一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!**

}

});

**网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。**

**需要这份系统化的资料的朋友,可以添加V获取:vip204888 (备注大数据)**

[外链图片转存中...(img-YrCje3l1-1713280087894)]

**一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!**

2305

2305

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?