网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

fs.defaultFS

hdfs://localhost:9000

hdfs-site.xml 中配置:其中在hadoop文件下新建data文件夹,在data文件夹下新建namenode文件加和datanode文件夹

file地址,写自己的文件地址

dfs.replication 1 dfs.namenode.name.dir file:/D:/chromedownload/hadoop-3.1.1/data/namenode dfs.datanode.data.dir file:/D:/chromedownload/hadoop-3.1.1/data/datanodemapred-site.xml 中配置

mapreduce.framework.name yarnyarn-site.xml 中配置:

yarn.nodemanager.aux-services mapreduce\_shuffle yarn.nodemanager.aux-services.mapreduce.shuffle.class org.apache.hadoop.mapred.ShuffleHandler yarn.resourcemanager.webapp.address 127.0.0.1:8088 yarn.resourcemanager.hostname localhost3.配置完之后,到这个地址下载https://download.csdn.net/download/qq_33398459/10942809 bin 文件夹下需要的工具包

4.启动hdfs 和 yarn ,首先以 管理员身份 运行命令提示符 :到hadoop文件夹下的sbin路径下

输入:hdfs namenode -format 执行完后

5.执行 start-dfs.cmd 会另外开启两个窗口,没有报错,即启动成功

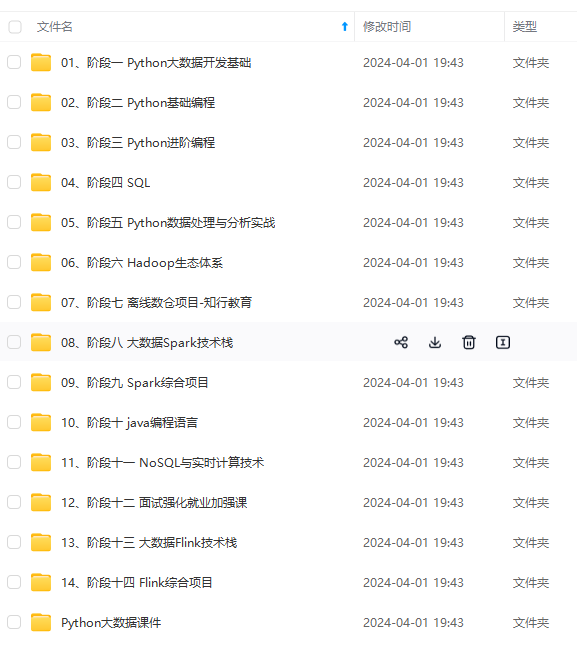

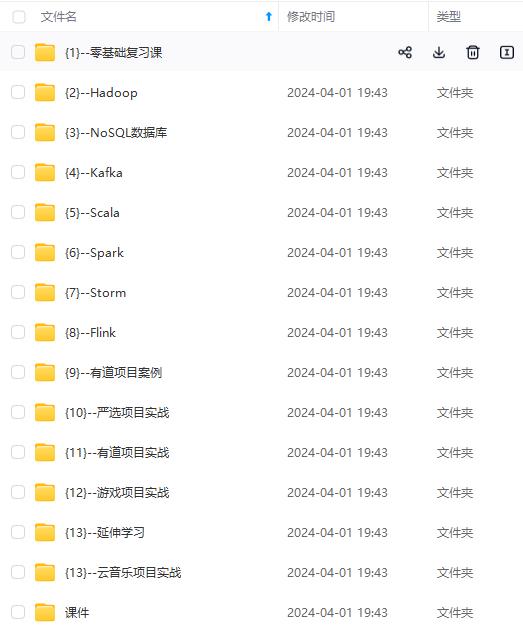

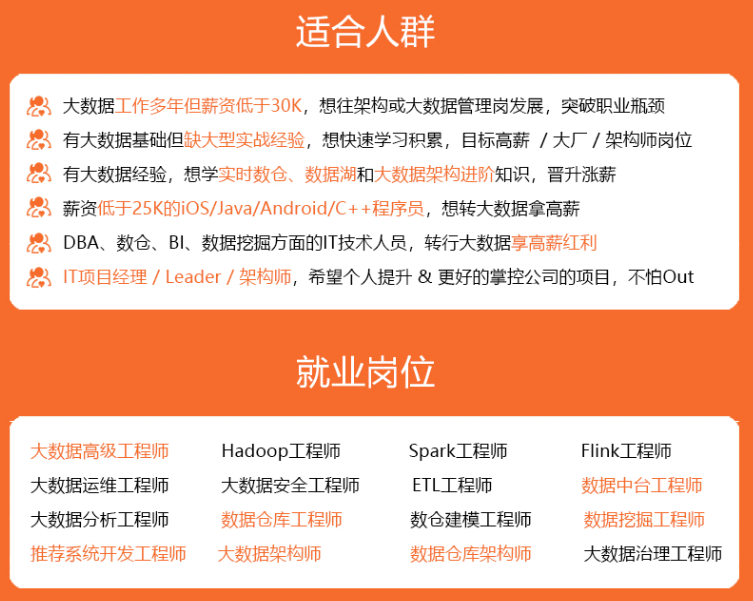

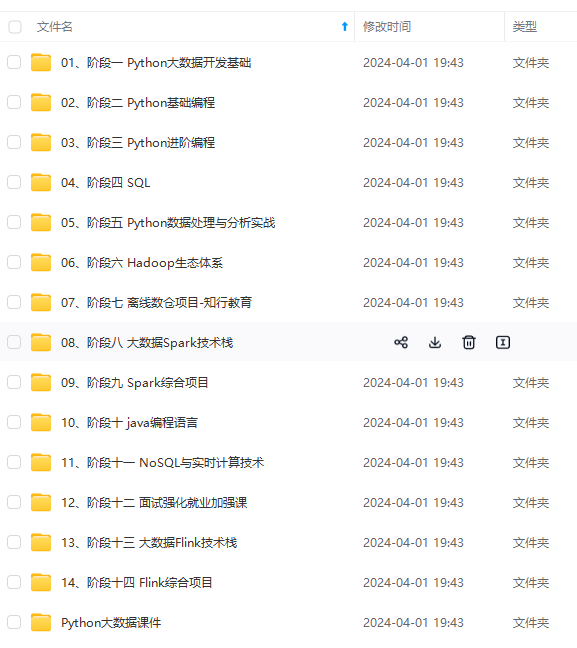

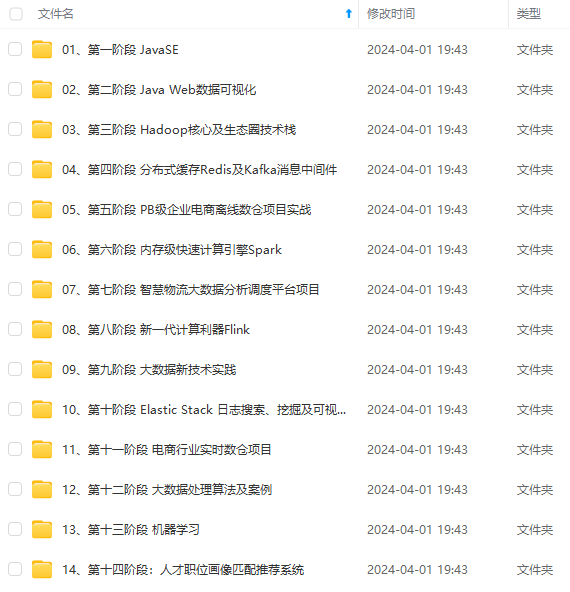

既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,涵盖了95%以上大数据知识点,真正体系化!

由于文件比较多,这里只是将部分目录截图出来,全套包含大厂面经、学习笔记、源码讲义、实战项目、大纲路线、讲解视频,并且后续会持续更新

续更新**

2688

2688

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?