pageindex = []

i = 0

pattern = re.compile(“collinear”)

for page in PDFPage.create_pages(document):

interpreter.process_page(page)

# 接受该页面的LTPage对象

layout=device.get_result() # return text image line curve

for x in layout:

if isinstance(x,LTText):

if pattern.search(x.get_text()):

pageindex.append(i)

i +=1

pdf_output = PdfFileWriter()

pdf_input = PdfFileReader(fp)

获取 pdf 共用多少页

for j in pageindex:

pdf_output.addPage(pdf_input.getPage(j))

final_path =os.path.join(r"C:\Users\tc\Desktop\final.pdf")

with open(final_path,“wb”) as f:

pdf_output.write(f)

fp.close()

好吧,到此结束???很多人会说,这些有什么意思,我随便点击一下鼠标就完事了?

----------------------------------垃圾分割线-------------------------------------------

别急,以上仅仅作为演示,干货在下面

-----------干货1-------------

技术:文章的封面是经过笔者仔细研究pypdfminer之后做出的图,理清了该库的主要逻辑。

----------干货2---------------

场景:A君为证券公司IPO小兵,近来在研究[共同实际控制人]问题,然而,这问题并不常见,通过网络关键搜索-即使派上了全文搜索以及牛逼哄哄的google-以及肉眼式的轰炸,仅仅找到了几个老旧的案例。这显然不是A君要的东西,对此他苦恼不堪。难道就没有捷径?

有的,不过,捷径通常掌握在思考者手里!

我们来思考刚刚提到的窘境

问题:搜寻共同实际控制人案例

问题的根本解决之路:从众多IPO公司招股书中查找

手段:”人生苦胆,我学python“

思路:

1,利用爬虫下载证监会招股说明书–PDF格式文件

2,利用pdfminer解析文本,获取含有【共同实际控制人】招股书公司名字

PART ONE

以是下载证监会反馈意见scrapy项目的主要spider代码:

-- coding: utf-8 --

import scrapy

import os

import urllib.request

from scrapy.selector import Selector

from .tools import alreay_exit,create_worddoc,get_para

from .tools import get_start_urls

class YxplSpider(scrapy.Spider):

name = ‘yxpl’

allowed_domains = [‘http://www.csrc.gov.cn’]

start_urls = get_start_urls()

exit_files = alreay_exit()

def parse_page(self,response):

final_dir =r"C:\Users\tc\PycharmProjects\yxpl\files"

item = SeoItem()

pre = “/”.join(response.url.split(“/”)[:-1])

title = response.xpath(“//head/title/text()”).extract()[0]

item[“title”] = title

#to get the pdf url

urls = response.xpath(‘//div[@class=“content”]/a/@href’).extract()

if len(urls) > 0:

for j in urls:

final_url = pre + j[1:] #最终网址

if item[“title”] not in self.exit_files:

try:

item[“content”] =urllib.request.urlopen(final_url).read()

file = open(os.path.join(final_dir, item[“title”] + “.pdf”), mode=“wb”)

file.write(item[“content”])

file.close()

except urllib.request.HTTPError:

print(“Error with HTTPErro” + item[“title”])

else:

print(title)

return item

def parse(self, response):

pre = r"http://www.csrc.gov.cn/pub/newsite/fxjgb/zrzfkyj/"

urls = response.xpath(‘//ul[@id=“myul”]/li/a/@href’).extract()

for i in urls:

new_url = “http://www.csrc.gov.cn/pub/” + “/”.join(i.split(“/”)[3:]

yield scrapy.Request(new_url,callback=self.parse_page,dont_filter=True)

PART TWO

2,返回含有关键子的文件名

对于下载好的PDF,仅仅只需要打开文件并对比关键字即可。由于过程简单,这里就不展示代码了。(实际上并不是我不愿意展示,而是因为运行速度太慢了!,一个400页的PDF大概需要一分多钟才能运行完毕,下载的文件有1500份,最少需要15个小时,so,python库确实 慢!慢!慢!)

含有【共同实际控制人】招股书名称截图

结语:对于PDF的操作介绍就到此结束。本文仅仅作为一种运用库展示代码编写过程,具体技术还需要有兴趣的朋友自己专研。

---------------ps-------------------

好吧,我还是透露在项目中发现的一个pycharm的一个重要功能–类的层级关系图,并将它与官方网站的模型图进行对比。

自我介绍一下,小编13年上海交大毕业,曾经在小公司待过,也去过华为、OPPO等大厂,18年进入阿里一直到现在。

深知大多数Python工程师,想要提升技能,往往是自己摸索成长或者是报班学习,但对于培训机构动则几千的学费,着实压力不小。自己不成体系的自学效果低效又漫长,而且极易碰到天花板技术停滞不前!

因此收集整理了一份《2024年Python开发全套学习资料》,初衷也很简单,就是希望能够帮助到想自学提升又不知道该从何学起的朋友,同时减轻大家的负担。

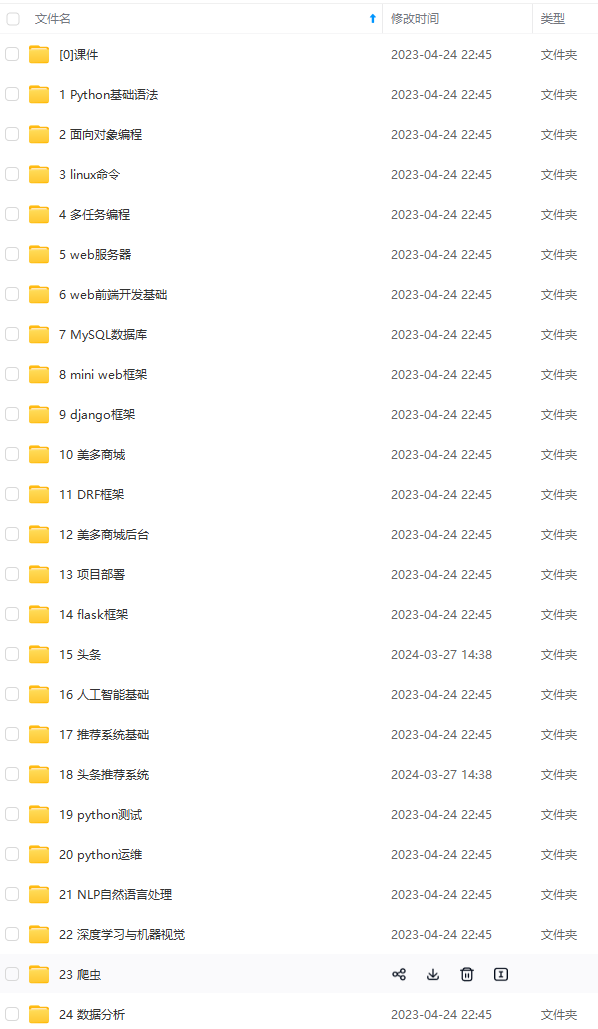

既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,基本涵盖了95%以上Python开发知识点,真正体系化!

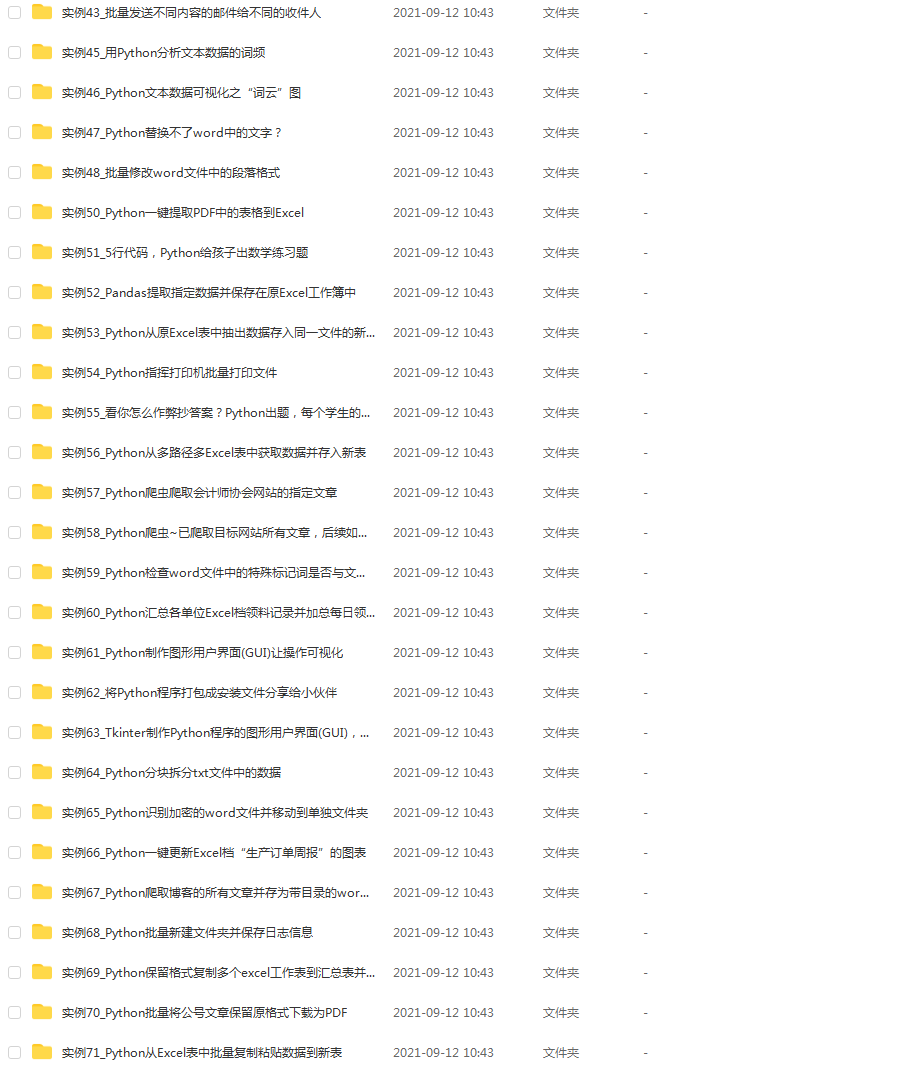

由于文件比较大,这里只是将部分目录大纲截图出来,每个节点里面都包含大厂面经、学习笔记、源码讲义、实战项目、讲解视频,并且后续会持续更新

如果你觉得这些内容对你有帮助,可以添加V获取:vip1024c (备注Python)

文末有福利领取哦~

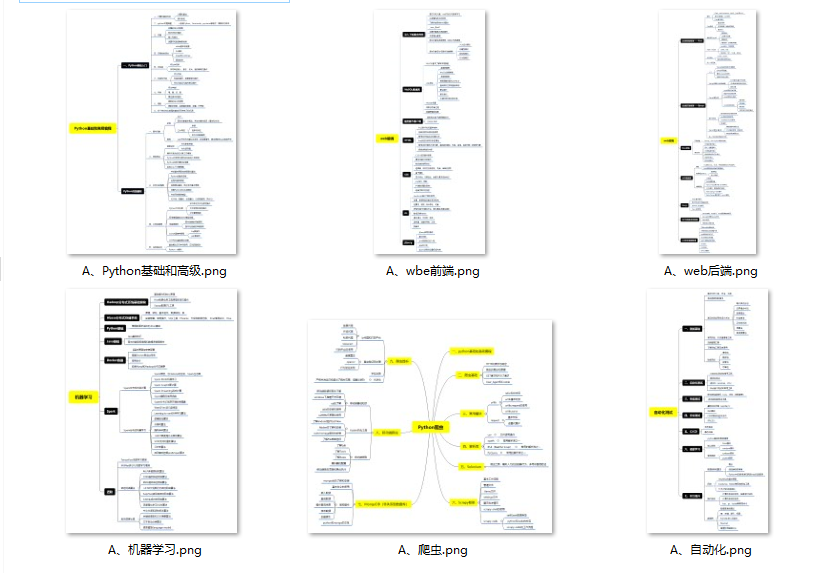

👉一、Python所有方向的学习路线

Python所有方向的技术点做的整理,形成各个领域的知识点汇总,它的用处就在于,你可以按照上面的知识点去找对应的学习资源,保证自己学得较为全面。

👉二、Python必备开发工具

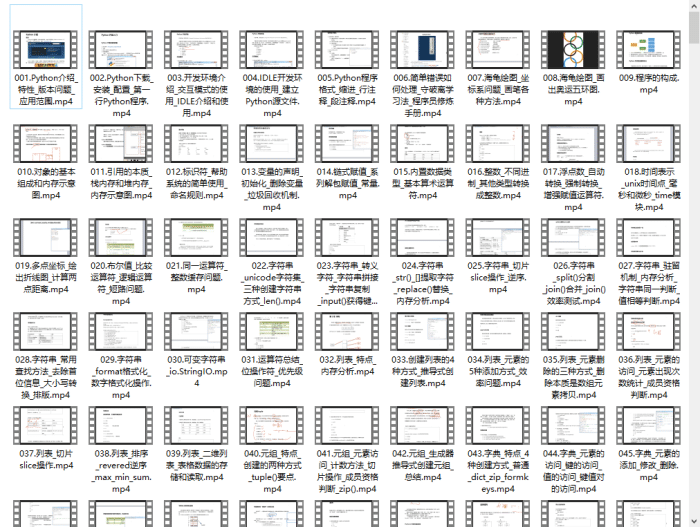

👉三、Python视频合集

观看零基础学习视频,看视频学习是最快捷也是最有效果的方式,跟着视频中老师的思路,从基础到深入,还是很容易入门的。

👉 四、实战案例

光学理论是没用的,要学会跟着一起敲,要动手实操,才能将自己的所学运用到实际当中去,这时候可以搞点实战案例来学习。(文末领读者福利)

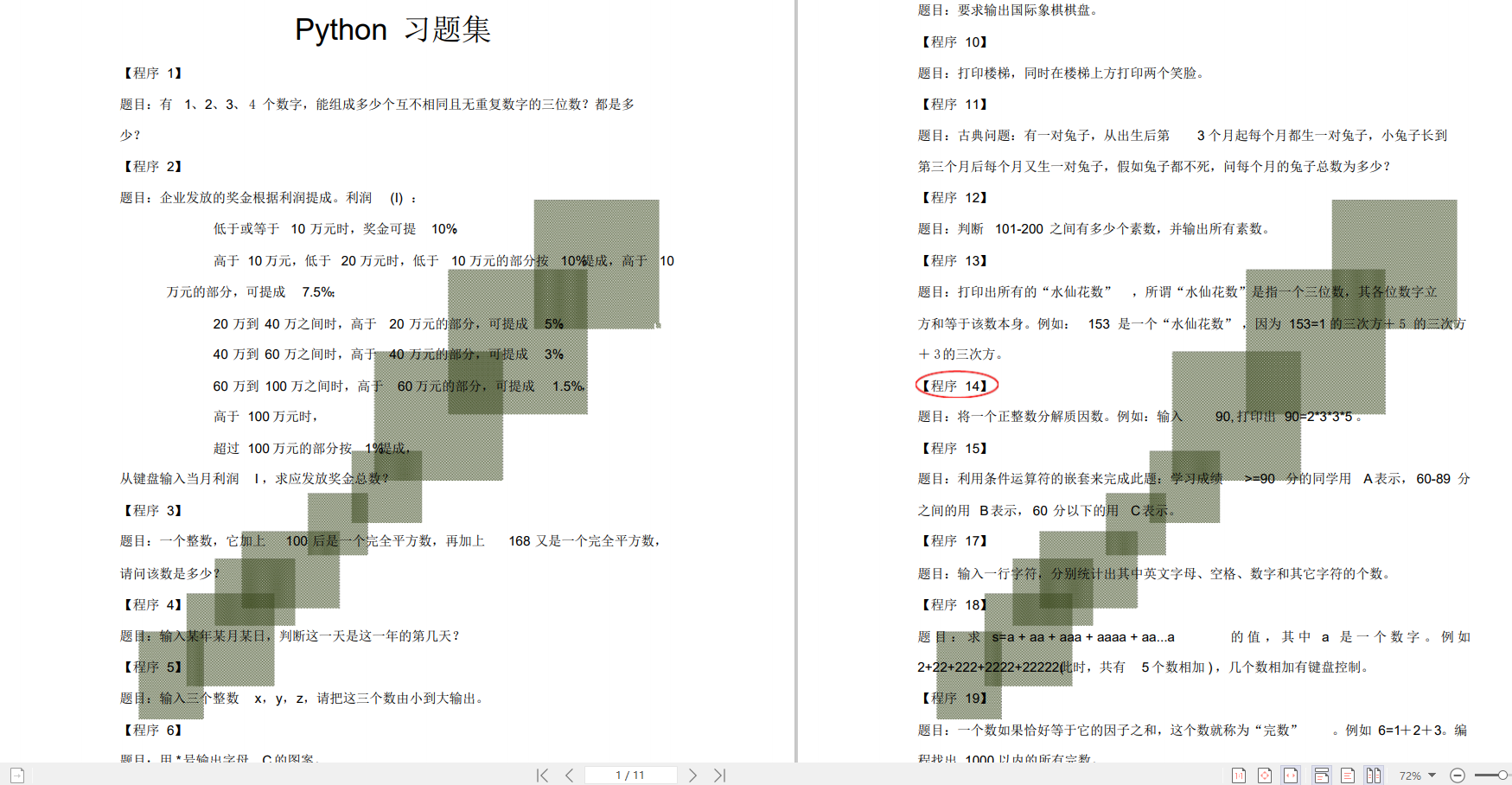

👉五、Python练习题

检查学习结果。

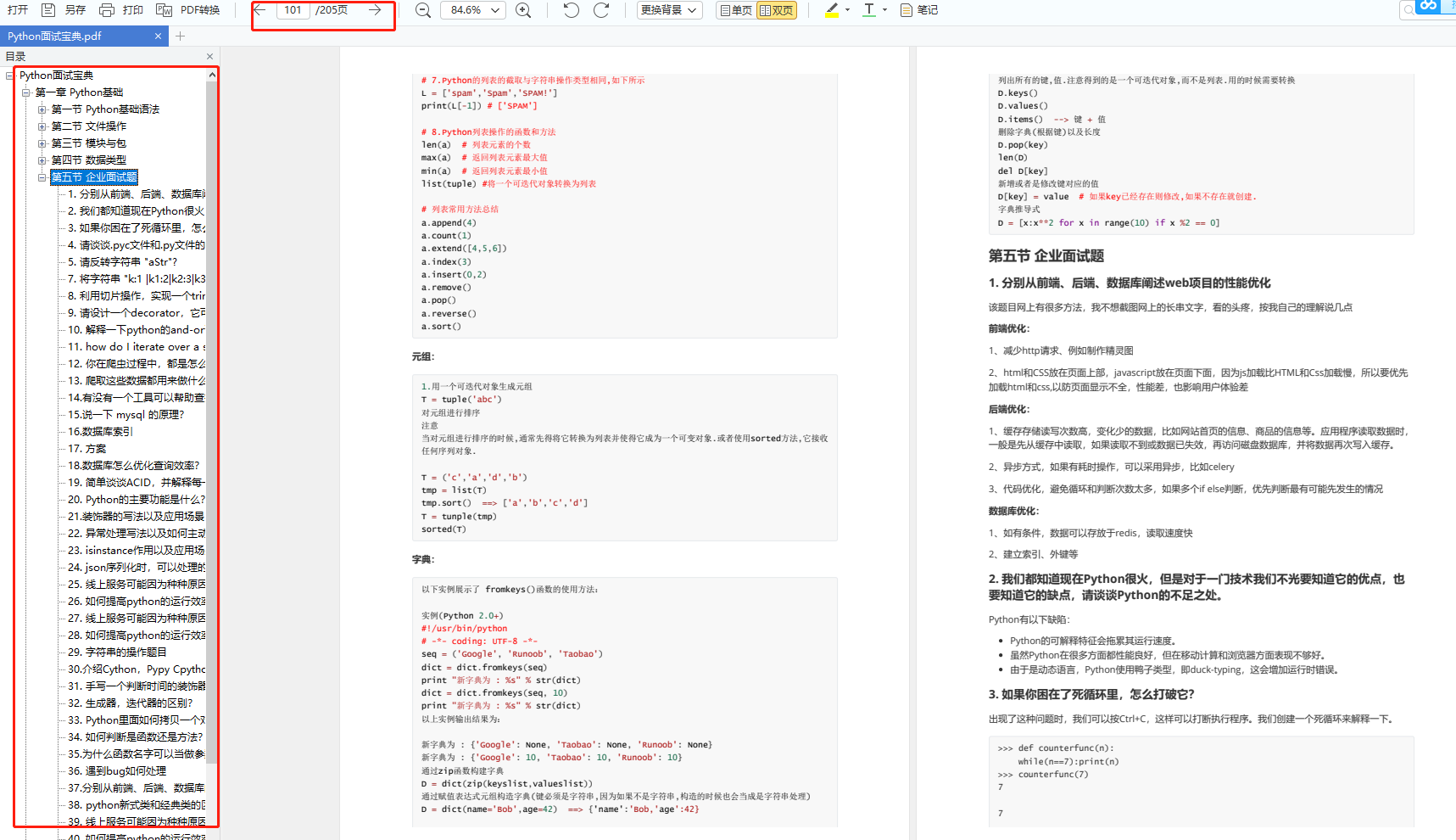

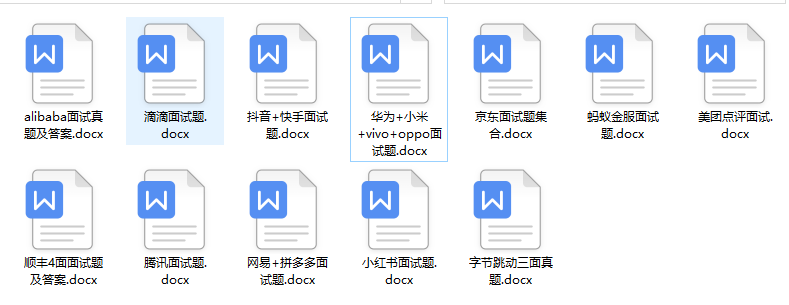

👉六、面试资料

我们学习Python必然是为了找到高薪的工作,下面这些面试题是来自阿里、腾讯、字节等一线互联网大厂最新的面试资料,并且有阿里大佬给出了权威的解答,刷完这一套面试资料相信大家都能找到满意的工作。

👉因篇幅有限,仅展示部分资料,这份完整版的Python全套学习资料已经上传

一个人可以走的很快,但一群人才能走的更远。不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎扫码加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

9437a988883d84dcc5e58.png)

👉因篇幅有限,仅展示部分资料,这份完整版的Python全套学习资料已经上传

一个人可以走的很快,但一群人才能走的更远。不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎扫码加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

[外链图片转存中…(img-bFAVFYZJ-1712786520456)]

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?