先自我介绍一下,小编浙江大学毕业,去过华为、字节跳动等大厂,目前阿里P7

深知大多数程序员,想要提升技能,往往是自己摸索成长,但自己不成体系的自学效果低效又漫长,而且极易碰到天花板技术停滞不前!

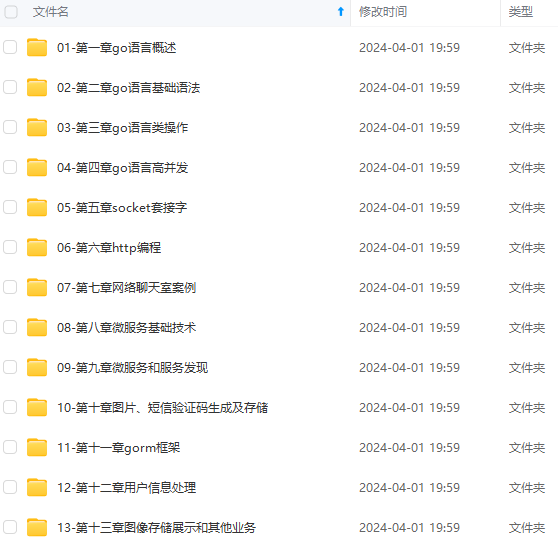

因此收集整理了一份《2024年最新Golang全套学习资料》,初衷也很简单,就是希望能够帮助到想自学提升又不知道该从何学起的朋友。

既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,涵盖了95%以上Go语言开发知识点,真正体系化!

由于文件比较多,这里只是将部分目录截图出来,全套包含大厂面经、学习笔记、源码讲义、实战项目、大纲路线、讲解视频,并且后续会持续更新

如果你需要这些资料,可以添加V获取:vip1024b (备注go)

正文

“fmt”

“net/http”

“golang.org/x/net/html”

)

func main() {

resp, err := http.Get(“https://www.example.com”)

if err != nil {

fmt.Println(“请求发送失败:”, err)

return

}

defer resp.Body.Close()

doc, err := html.Parse(resp.Body)

if err != nil {

fmt.Println(“解析HTML失败:”, err)

return

}

// 在这里进行HTML解析操作…

}

上面的代码中,我们使用html.Parse函数来解析HTML,并得到一个表示整个HTML文档的树状结构。在这个树状结构中,我们可以使用不同的方法来查找和提取我们需要的数据。

package main

import (

“fmt”

“net/http”

“golang.org/x/net/html”

)

func main() {

resp, err := http.Get(“https://www.example.com”)

if err != nil {

fmt.Println(“请求发送失败:”, err)

return

}

defer resp.Body.Close()

doc, err := html.Parse(resp.Body)

if err != nil {

fmt.Println(“解析HTML失败:”, err)

return

}

findLinks(doc)

}

func findLinks(n *html.Node) {

if n.Type == html.ElementNode && n.Data == “a” {

for _, a := range n.Attr {

if a.Key == “href” {

fmt.Println(a.Val)

}

}

}

for c := n.FirstChild; c != nil; c = c.NextSibling {

findLinks©

}

}

上面的代码中,我们定义了一个递归函数findLinks来查找HTML中的所有链接。我们使用html.Node的Type和Data属性来判断当前节点是否为<a>标签,并使用Attr属性来获取链接的地址。

四、并发爬虫

并发是Golang的一个重要特性,能够提高爬虫的效率。我们可以使用Golang的并发机制来同时发送多个HTTP请求,加快网页的爬取速度。

package main

import (

“fmt”

“net/http”

“golang.org/x/net/html”

)

func main() {

urls := []string{

“https://www.example.com/page1”,

“https://www.example.com/page2”,

“https://www.example.com/page3”,

}

ch := make(chan string)

for _, url := range urls {

go fetch(url, ch)

}

for range urls {

fmt.Println(<-ch)

}

}

func fetch(url string, ch chan<- string) {

resp, err := http.Get(url)

if err != nil {

ch <- fmt.Sprintf(“请求 %s 发送失败:%v”, url, err)

return

}

defer resp.Body.Close()

doc, err := html.Parse(resp.Body)

if err != nil {

ch <- fmt.Sprintf(“解析 %s 失败:%v”, url, err)

return

}

// 在这里进行HTML解析操作…

ch <- fmt.Sprintf(“请求 %s 完成”, url)

}

上面的代码中,我们定义了一个ch通道用于接收爬虫的结果。然后,我们使用go关键字来开启多个协程,每个协程负责爬取一个网页的内容并进行解析。最后,我们使用<-ch来从通道中获取结果并打印出来。

五、数据存储

爬取到的数据通常需要保存到数据库或者文件中。Golang提供了各种数据库驱动和文件操作函数,可以方便地进行数据存储。

package main

import (

“fmt”

“net/http”

“golang.org/x/net/html”

“os”

“io”

)

func main() {

resp, err := http.Get(“https://www.example.com”)

if err != nil {

fmt.Println(“请求发送失败:”, err)

return

}

defer resp.Body.Close()

file, err := os.Create(“output.html”)

if err != nil {

fmt.Println(“创建文件失败:”, err)

return

}

defer file.Close()

_, err = io.Copy(file, resp.Body)

if err != nil {

fmt.Println(“保存文件失败:”, err)

return

}

fmt.Println(“文件保存成功”)

}

上面的代码中,我们使用os.Create函数创建了一个名为output.html的文件,并使用io.Copy函数将HTTP响应的内容保存到文件中。

六、案例

案例一:爬取网页标题

package main

import (

“fmt”

“net/http”

“golang.org/x/net/html”

)

func main() {

resp, err := http.Get(“https://www.example.com”)

if err != nil {

fmt.Println(“请求发送失败:”, err)

return

}

defer resp.Body.Close()

doc, err := html.Parse(resp.Body)

if err != nil {

fmt.Println(“解析HTML失败:”, err)

return

}

title := findTitle(doc)

fmt.Println(“网页标题:”, title)

}

func findTitle(n *html.Node) string {

if n.Type == html.ElementNode && n.Data == “title” {

return n.FirstChild.Data

}

for c := n.FirstChild; c != nil; c = c.NextSibling {

title := findTitle©

if title != “” {

return title

}

}

return “”

}

在上面的例子中,我们使用findTitle函数来查找网页的标题。我们通过递归遍历HTML树,如果遇到<title>标签,我们就返回其内容。

案例二:爬取图片链接

package main

import (

“fmt”

“net/http”

“golang.org/x/net/html”

)

func main() {

网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。

需要这份系统化的资料的朋友,可以添加V获取:vip1024b (备注Go)

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

func main() {

网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。

需要这份系统化的资料的朋友,可以添加V获取:vip1024b (备注Go)

[外链图片转存中…(img-NUUn9Axk-1713311208368)]

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

1256

1256

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?