react和vue的比较

相同

1)vitual dom

2)组件化

3)props,单一数据流

不同点

1)react是jsx和模板;(jsx可以进行更多的js逻辑和操作)

2)状态管理(react)

3)对象属性(vue)

4)vue:view——medol之间双向绑定

5)vue:组件之间的通信(props,callback,emit)

clever at善于

文章目录

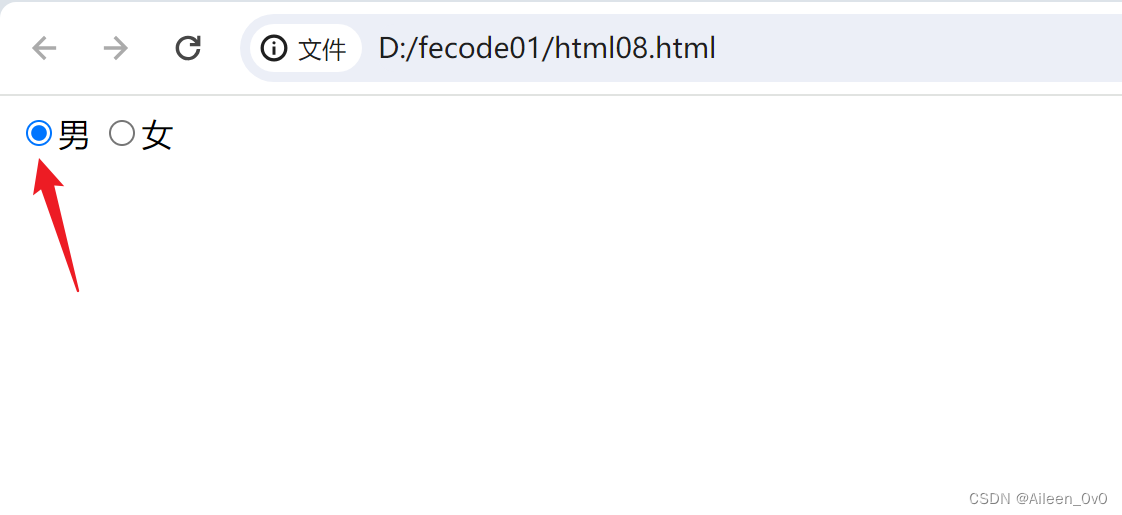

label标签

label标签常搭配input使用

<input type="radio" name="sex">男

<input type="radio" name="sex">女

<!-- 将文字和单选按钮关联在一起利用label标签 -->

<label for="male">男</label>

<input type="radio" name="sex" id="male">

<label for="female">女</label>

<input type="radio" name="sex" id="female">

label中的for属性:表示将当前包裹的内容和哪一个元素进行关联

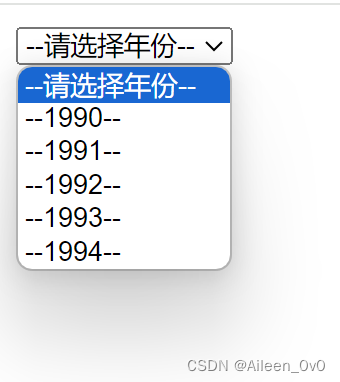

select标签

<select name="" id="">

<option value="">--请选择年份--</option>

<option value="">--1990--</option>

<option value="">--1991--</option>

<option value="">--1992--</option>

<option value="">--1993--</option>

<option value="">--1994--</option>

</select>

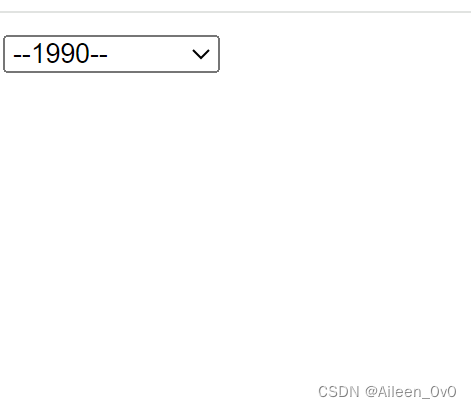

我们可以通过selected标签进行默认选项的选择,代码如下:

<select name="" id="">

<option value="">--请选择年份--</option>

<option value="" selected="selected">--1990--</option>

<option value="">--1991--</option>

<option value="">--1992--</option>

<option value="">--1993--</option>

<option value="">--1994--</option>

</select>

文本标签

<textarea name="" id="" cols="30" rows="10" ></textarea>

### 最后

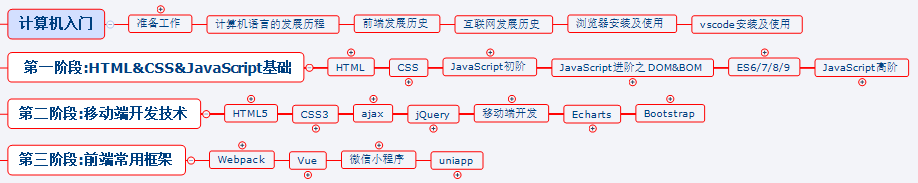

其实前端开发的知识点就那么多,面试问来问去还是那么点东西。所以面试没有其他的诀窍,只看你对这些知识点准备的充分程度。so,出去面试时先看看自己复习到了哪个阶段就好。

这里再分享一个复习的路线:(以下体系的复习资料是我从各路大佬收集整理好的)

《前端开发四大模块核心知识笔记》

最后,说个题外话,我在一线互联网企业工作十余年里,指导过不少同行后辈。帮助很多人得到了学习和成长。

**[开源分享:【大厂前端面试题解析+核心总结学习笔记+真实项目实战+最新讲解视频】](https://bbs.csdn.net/topics/618166371)**

我意识到有很多经验和知识值得分享给大家,也可以通过我们的能力和经验解答大家在IT学习中的很多困惑,所以在工作繁忙的情况下还是坚持各种整理和分享。

人得到了学习和成长。

**[开源分享:【大厂前端面试题解析+核心总结学习笔记+真实项目实战+最新讲解视频】](https://bbs.csdn.net/topics/618166371)**

我意识到有很多经验和知识值得分享给大家,也可以通过我们的能力和经验解答大家在IT学习中的很多困惑,所以在工作繁忙的情况下还是坚持各种整理和分享。

243

243

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?