所以我们可以用下面的正则表达式来匹配,如果匹配成功就说明当前页不是最后一页,否则当前页就是最后一页。

### 六、编程实现

下面是摘自的Python2版完整的代码实现:

#!usr/bin/python

-*- coding: utf-8 -*-

‘’’

Created on 2016年2月13日

@author: ***

使用python爬取csdn个人博客的访问量,主要用来练手

‘’’

import urllib2

import re

#当前的博客列表页号

page_num = 1

#不是最后列表的一页

notLast = 1

account = str(raw_input(‘输入csdn的登录账号:’))

while notLast:

#首页地址

baseUrl = ‘http://blog.csdn.net/’+account

#连接页号,组成爬取的页面网址

myUrl = baseUrl+‘/article/list/’+str(page_num)

#伪装成浏览器访问,直接访问的话csdn会拒绝

user_agent = ‘Mozilla/4.0 (compatible; MSIE 5.5; Windows NT)’

headers = {‘User-Agent’:user_agent}

#构造请求

req = urllib2.Request(myUrl,headers=headers)

#访问页面

myResponse = urllib2.urlopen(req)

myPage = myResponse.read()

#在页面中查找是否存在‘尾页’这一个标签来判断是否为最后一页

notLast = re.findall(‘尾页’,myPage,re.S)

print ‘---------------第%d页-------------’ % (page_num,)

#利用正则表达式来获取博客的标题

title = re.findall(‘(.*?)’,myPage,re.S)

titleList=[]

for items in title:

titleList.append(str(items).lstrip().rstrip())

#利用正则表达式获取博客的访问量

view = re.findall(‘<span class=“link_view”.*?>阅读((.*?))’,myPage,re.S)

viewList=[]

for items in view:

viewList.append(str(items).lstrip().rstrip())

#将结果输出

for n in range(len(titleList)):

print ‘访问量:%s 标题:%s’ % (viewList[n].zfill(4),titleList[n])

#页号加1

page_num = page_num + 1

由于自己现在的IDE为Python3,且自己在学习Python3。故在此基础上实现Python2项目的升级改造,并在改造过程中发现版本之间的差异性。以下为Python3版本下的爬虫代码。

#!usr/bin/python

-*- coding: utf-8 -*-

‘’’

Created on 2017年3月19日

@author: SUN HuaQiang

目的:使用python爬取csdn个人博客的访问量,主要用来练手Python爬虫

收获:1.了解Python爬虫的基本过程

2.在Python2的基础上实现Python3,通过对比发现版本之间的差异

‘’’

import urllib.request

import urllib

import re

#当前的博客列表页号

page_num = 1

#初始化最后列表的页码

notLast = 1

account = str(input(‘请输入csdn的登录账号:’))

while notLast:

#首页地址

baseUrl = ‘http://blog.csdn.net/’ + account

#连接页号,组成爬取的页面网址

myUrl = baseUrl+‘/article/list/’ + str(page_num)

#伪装成浏览器访问,直接访问的话csdn会拒绝

user_agent = ‘Mozilla/4.0 (compatible; MSIE 5.5; Windows NT)’

headers = {‘User-Agent’:user_agent}

#构造请求

req = urllib.request.Request(myUrl,headers=headers)

#访问页面

myResponse = urllib.request.urlopen(req)

#python3中urllib.read返回的是bytes对象,不是string,得把它转换成string对象,用bytes.decode方法

myPage = myResponse.read().decode()

#在页面中查找是否存在‘尾页’这一个标签来判断是否为最后一页

notLast = re.findall(‘尾页’, myPage, re.S)

print (‘-----------第%d页--------------’ % (page_num,))

#利用正则表达式来获取博客的标题

title = re.findall(‘(.*?)’,myPage,re.S)

titleList=[]

for items in title:

titleList.append(str(items).lstrip().rstrip())

#利用正则表达式获取博客的访问量

view = re.findall(‘<span class=“link_view”.*?>阅读((.*?))’,myPage,re.S)

viewList=[]

for items in view:

viewList.append(str(items).lstrip().rstrip())

#将结果输出

for n in range(len(titleList)):

print (‘访问量:%s 标题:%s’ % (viewList[n].zfill(4),titleList[n]))

#页号加1

page_num = page_num + 1

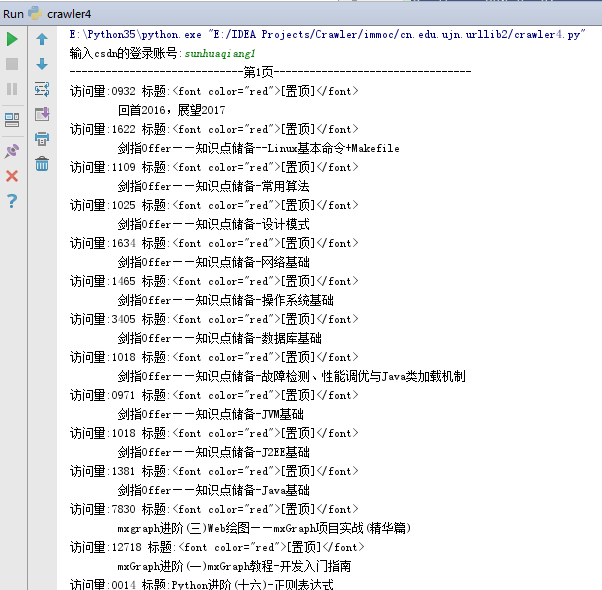

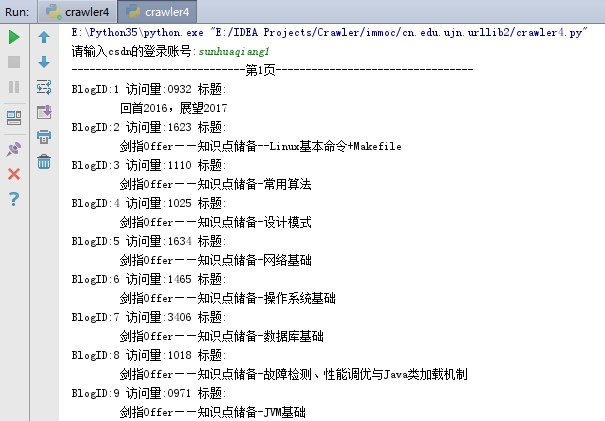

下面是部分结果:

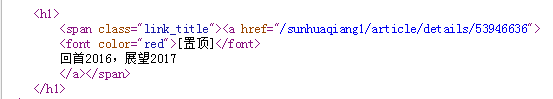

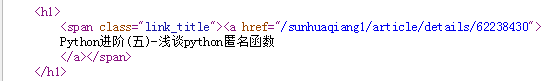

瑕疵:通过爬虫结果可以发现,在CSDN中,对于设置为指定的文章,爬取结果存在一定的问题,还包含部分css代码。

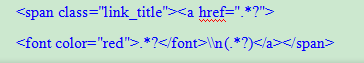

改善:通过更改获取博文标题的正则表达式,即可解决此问题。

想法是好的,但是直接利用正则实现标题获取时遇到了困难,暂时并未实现理想结果。

遂改变思路,将利用正则获取后的字符串再进行二次正则,即替换操作,语句如下:

for items in title:

titleList.append(re.sub(‘.*?’, ‘’, str(items).lstrip().rstrip()))

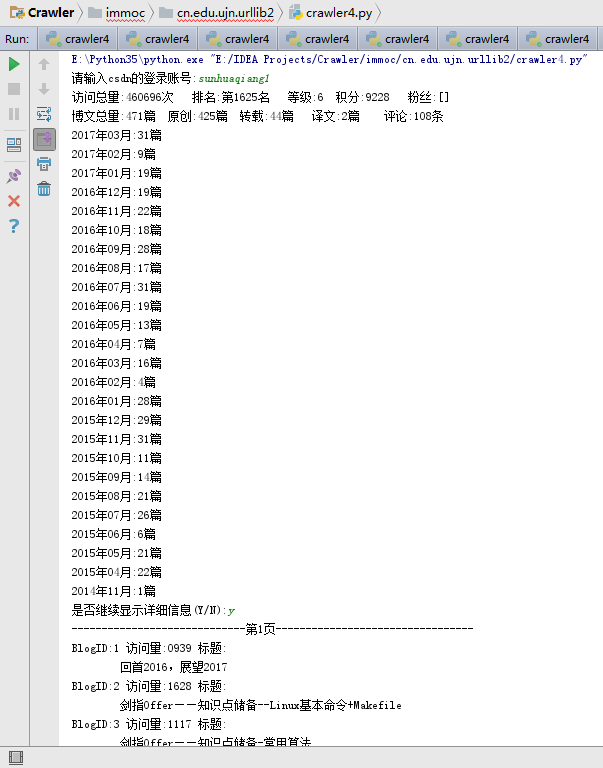

更改后的结果如下。并同时为每篇博文进行了编号。

同时,自己还希望获取到的信息包括:访问总量、积分、等级、排名、粉丝、原创、转载、译文、评论等数据信息。

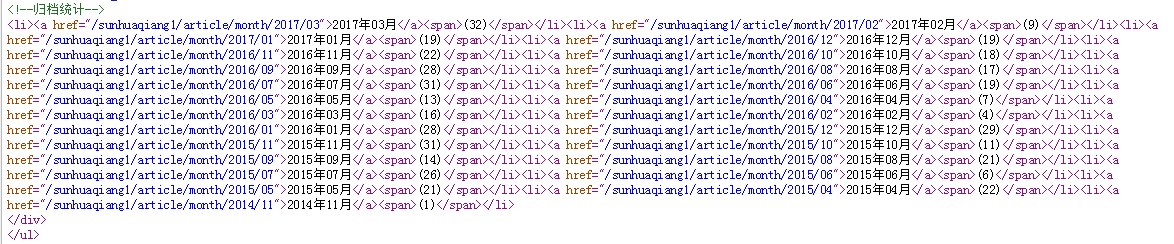

以上信息在网页源码中如下所示。

- 访问:459285次

- 积分:9214

- 等级:

积分:9214

积分:9214 - 排名:第1639名

- 原创:425篇

- 转载:44篇

- 译文:2篇

- 评论:108条

则获取访问信息的正则表达式为:

#利用正则表达式获取博客信息

sumVisit = re.findall(‘

- 访问:(.*?)

- ’, myPage, re.S)

credit = re.findall(‘ - 积分:(.*?)

- ’, myPage, re.S)

rank = re.findall(‘ - 排名:(.*?)

- ’, myPage, re.S)

grade = re.findall(‘ - .*?

.*?

.*? - ’, test3, re.S)

original = re.findall(‘ - 原创:(.*?)

- ’, myPage, re.S)

reprint = re.findall(‘ - 转载:(.*?)

- ’, myPage, re.S)

trans = re.findall(‘ - 译文:(.*?)

- ’, myPage, re.S)

comment = re.findall(‘ - 评论:(.*?)

- ’, myPage, re.S)

根据网页源码,可得出其正则表达式为staData = re.findall(‘

- (.*?)(.*?)

- ’, myPage, re.S)

for i in staData:

print(i[0] + ‘:’ + i[1].lstrip(‘(’).rstrip(‘)’)+‘篇’)经过以上操作,得到的用户Blog信息如下图所示:  最终遇到的问题是:有关粉丝数的爬取遇到了问题,因为前面数据信息的获取不需要用户登录,而用户粉丝数是在用户已登录情景下获取的,故需要将用户登录信息添加进去。犯愁~ PS:**论文盲审送回来了,自己这段时间要用来修改论文了,后面的博客后面再说吧~** ### 七、注意事项 * `urllib2`在3.5中为`urllib.request`; * `raw_input()`在3.5中为`input()`; * python3中`urllib.read()`返回的是bytes对象,不是string,得把它转换成string对象,用`bytes.decode()`方法; * re.S意在使.匹配包括换行在内的所有字符; * python3对`urllib`和`urllib2`进行了重构,拆分成了`urllib.request`,`urllib.response,urllib.parse,urllib.error`等几个子模块,这样的架构从逻辑和结构上说更加合理。`urljoin`现在对应的函数是`urllib.parse.urljoin`。  **感谢每一个认真阅读我文章的人,看着粉丝一路的上涨和关注,礼尚往来总是要有的:** ① 2000多本Python电子书(主流和经典的书籍应该都有了) ② Python标准库资料(最全中文版) ③ 项目源码(四五十个有趣且经典的练手项目及源码) ④ Python基础入门、爬虫、web开发、大数据分析方面的视频(适合小白学习) ⑤ Python学习路线图(告别不入流的学习) **网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。** **[需要这份系统化学习资料的朋友,可以戳这里无偿获取](https://bbs.csdn.net/topics/618317507)** **一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!**

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?