做了那么多年开发,自学了很多门编程语言,我很明白学习资源对于学一门新语言的重要性,这些年也收藏了不少的Python干货,对我来说这些东西确实已经用不到了,但对于准备自学Python的人来说,或许它就是一个宝藏,可以给你省去很多的时间和精力。

别在网上瞎学了,我最近也做了一些资源的更新,只要你是我的粉丝,这期福利你都可拿走。

我先来介绍一下这些东西怎么用,文末抱走。

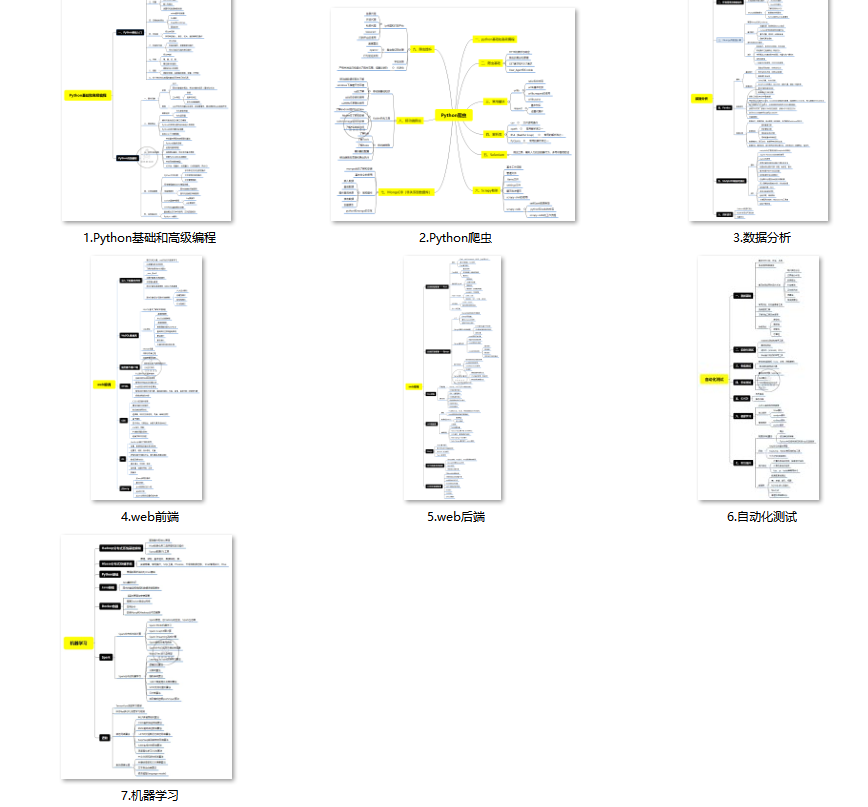

(1)Python所有方向的学习路线(新版)

这是我花了几天的时间去把Python所有方向的技术点做的整理,形成各个领域的知识点汇总,它的用处就在于,你可以按照上面的知识点去找对应的学习资源,保证自己学得较为全面。

最近我才对这些路线做了一下新的更新,知识体系更全面了。

(2)Python学习视频

包含了Python入门、爬虫、数据分析和web开发的学习视频,总共100多个,虽然没有那么全面,但是对于入门来说是没问题的,学完这些之后,你可以按照我上面的学习路线去网上找其他的知识资源进行进阶。

(3)100多个练手项目

我们在看视频学习的时候,不能光动眼动脑不动手,比较科学的学习方法是在理解之后运用它们,这时候练手项目就很适合了,只是里面的项目比较多,水平也是参差不齐,大家可以挑自己能做的项目去练练。

(4)200多本电子书

这些年我也收藏了很多电子书,大概200多本,有时候带实体书不方便的话,我就会去打开电子书看看,书籍可不一定比视频教程差,尤其是权威的技术书籍。

基本上主流的和经典的都有,这里我就不放图了,版权问题,个人看看是没有问题的。

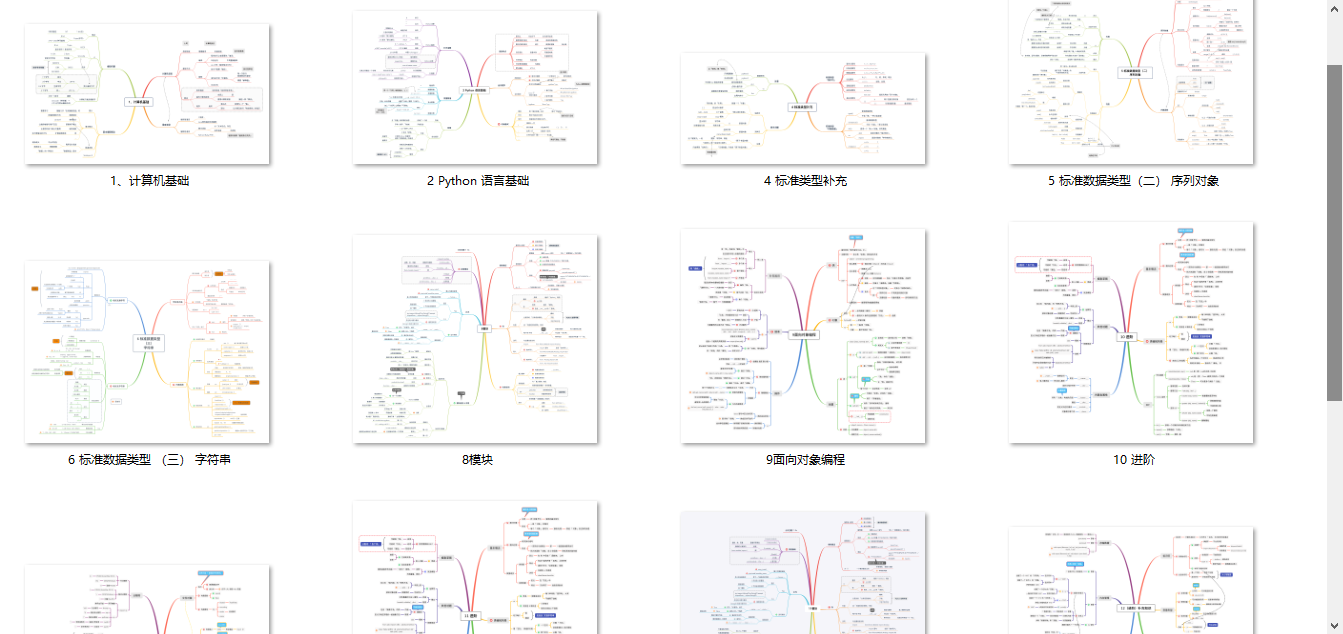

(5)Python知识点汇总

知识点汇总有点像学习路线,但与学习路线不同的点就在于,知识点汇总更为细致,里面包含了对具体知识点的简单说明,而我们的学习路线则更为抽象和简单,只是为了方便大家只是某个领域你应该学习哪些技术栈。

(6)其他资料

还有其他的一些东西,比如说我自己出的Python入门图文类教程,没有电脑的时候用手机也可以学习知识,学会了理论之后再去敲代码实践验证,还有Python中文版的库资料、MySQL和HTML标签大全等等,这些都是可以送给粉丝们的东西。

这些都不是什么非常值钱的东西,但对于没有资源或者资源不是很好的学习者来说确实很不错,你要是用得到的话都可以直接抱走,关注过我的人都知道,这些都是可以拿到的。

网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

response.meta[‘item’] = singer_item = SingerItem()

singer_item[‘_id’] = singer_item[‘singer_id’] = singer_id = \

int(singer_node.css(‘a.nm::attr(href)’).re_first(‘\d+’))

singer_item[‘crawl_time’] = datetime.now()

singer_item[‘singer_name’] = singer_node.css(‘a.nm::text’).get()

singer_item[‘singer_desc_url’] = self.get_singer_desc(singer_id)

singer_item[‘singer_hot_songs’] = response.urljoin(singer_node.css(‘a.nm::attr(href)’).re_first(‘\S+’))

singer_item[‘cat_name’] = response.css(‘.z-slt::text’).get()

singer_item[‘cat_id’] = int(response.css(‘.z-slt::attr(href)’).re_first(‘\d+’))

singer_item[‘cat_url’] = response.urljoin(response.css(‘.z-slt::attr(href)’).re_first(‘\S+’))

yield singer_item

yield Request(self.get_singer_albums(singer_id), callback=self.parse_albums)

def parse_albums(self, response):

for li in response.css(‘#m-song-module li’):

yield response.follow(li.css(‘a.msk::attr(href)’).get(), callback=self.parse_songs)

next_page = response.css(‘div.u-page a.znxt::attr(href)’).get()

if next_page:

yield response.follow(next_page, callback=self.parse_albums)

def parse_songs(self, response):

album_item = AlbumItem()

album_item[‘_id’] = album_item[‘album_id’] = int(re.search(‘id=(\d+)’, response.url).group(1))

album_item[‘album_name’] = response.css(‘h2::text’).get()

album_item[‘album_author’] = response.css(‘a.u-btni::attr(data-res-author)’).get()

album_item[‘album_author_id’] = int(response.css(‘p.intr:nth-child(2) a::attr(href)’).re_first(‘\d+’))

album_item[‘album_authors’] =[{‘name’: a.css(‘::text’).get(), ‘href’: a.css(‘::attr(href)’).get()}

for a in response.css(‘p.intr:nth-child(2) a’)]

album_item[‘album_time’] = response.css(‘p.intr:nth-child(3)::text’).get()

album_item[‘album_url’] = response.url

album_item[‘album_img’] = response.css(‘.cover img::attr(src)’).get()

album_item[‘album_company’] = response.css(‘p.intr:nth-child(4)::text’).re_first(‘\w+’)

album_item[‘album_desc’] = response.xpath(‘string(//div[@id=“album-desc-more”])’).get() if \

response.css(‘#album-desc-more’) else response.xpath(‘string(.//div[@class=“n-albdesc”]/p)’).get()

用这个 ‘span#cnt_comment_count::text’ 有些没有评论的会出问题,会变成“评论”

album_item[‘album_comments_cnt’] = int(response.css(‘#comment-box::attr(data-count)’).get())

album_item[‘album_songs’] = response.css(‘#song-list-pre-cache li a::text’).getall()

album_item[‘album_appid’] = int(json.loads(response.css(‘script[type=“application/ld+json”]::text’).get())[‘appid’])

yield album_item

for li in response.css(‘#song-list-pre-cache li’):

song_item = SongItem()

song_item[‘crawl_time’] = datetime.now()

song_item[‘song_name’] = li.css(‘a::text’).get()

song_item[‘_id’] = song_item[‘song_id’] = int(li.css(‘a::attr(href)’).re_first(‘\d+’))

song_item[‘song_url’] = response.urljoin(li.css(‘a::attr(href)’).re_first(‘\S+’))

yield song_item

try:

热歌信息在

节点下,可以通过div#hotsong-list li a 得到歌曲的Id, href, name

但是,可以通过下面的textarea节点得到更为详细的data,这个不能通过正则匹配[],不然会被一些歌曲名给套住

有些歌手没有热门歌曲,比如: https://music.163.com/#/artist?id=13226806, 返回的是一个’\n’,无法json解析,因此用.strip()过滤

在解析韩国歌手页面的时候出现问题,比如: https://music.163.com/artist?id=1038327, 有时用BeautifulSoup的html5解析能解决问题

但提升效果有限,此处为了代码简介就不展开了

json_data = json.loads(response.xpath(‘.//textarea/text()’).get())

for item in json_data:

song_item = SongItem()

song_item.update(item)

song_item[‘_id’] = item[‘id’]

song_item[‘crawl_time’] = datetime.now()

yield song_item

except JSONDecodeError:

with open(‘Failed Textarea Collection.txt’, ‘a’, encoding=‘utf-8’) as f:

f.write(response.url + ‘\n’)

当接近200万首歌的数据爬取完毕之后,我们启动评论爬虫,主要工作就是遍历数据库中还没有更新“评论数”这个字段的歌曲id,然后访问对应的评论api,得到我们想要的评论数据。

核心代码如下:

def start_requests(self):

cursor = self.coll_song.find({‘comments_cnt’: {‘$exists’: False}}, no_cursor_timeout=True)

for song_item in cursor:

if self.settings.get(‘PARSE_ALL_COMMENTS’):

limit, offset = 100, 0

elif self.settings.get(‘PARSE_HOT_COMMENTS’):

limit, offset = 0, 0

else:

limit, offset = 0, 1

comment_url = self.get_comment_page_url(song_item[‘song_id’], limit=limit, offset=offset)

yield Request(comment_url, dont_filter=False, callback=self.parse,

meta={‘song_item’: song_item, ‘limit’: limit, ‘offset’: offset})

cursor.close()

def parse(self, response):

json_data = json.loads(response.text)

comment_item = CommentItem()

comment_item[‘comment_url’] = response.url.split(‘?’)[0]

comment_item[‘crawl_time’] = datetime.now()

comment_item[‘isMusician’] = json_data[‘isMusician’]

comment_item[‘comments_cnt’] = comments_cnt = json_data[‘total’]

comment_item[‘song_name’] = response.meta[‘song_item’][‘song_name’]

comment_item[‘singer_name’] = response.meta[‘song_item’][‘singer_name’]

comment_item[‘song_id’] = song_id = response.meta[‘song_item’][‘song_id’]

for comment_info in json_data.get(‘comments’):

comment_item.update(comment_info)

comment_item[‘_id’] = comment_info[‘commentId’]

yield comment_item

一、Python所有方向的学习路线

Python所有方向的技术点做的整理,形成各个领域的知识点汇总,它的用处就在于,你可以按照下面的知识点去找对应的学习资源,保证自己学得较为全面。

二、Python必备开发工具

工具都帮大家整理好了,安装就可直接上手!

三、最新Python学习笔记

当我学到一定基础,有自己的理解能力的时候,会去阅读一些前辈整理的书籍或者手写的笔记资料,这些笔记详细记载了他们对一些技术点的理解,这些理解是比较独到,可以学到不一样的思路。

四、Python视频合集

观看全面零基础学习视频,看视频学习是最快捷也是最有效果的方式,跟着视频中老师的思路,从基础到深入,还是很容易入门的。

五、实战案例

纸上得来终觉浅,要学会跟着视频一起敲,要动手实操,才能将自己的所学运用到实际当中去,这时候可以搞点实战案例来学习。

六、面试宝典

简历模板

网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?