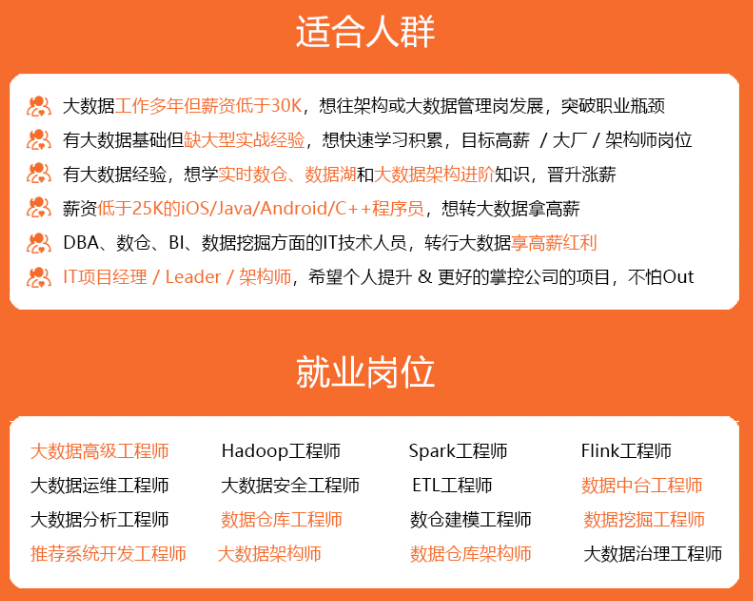

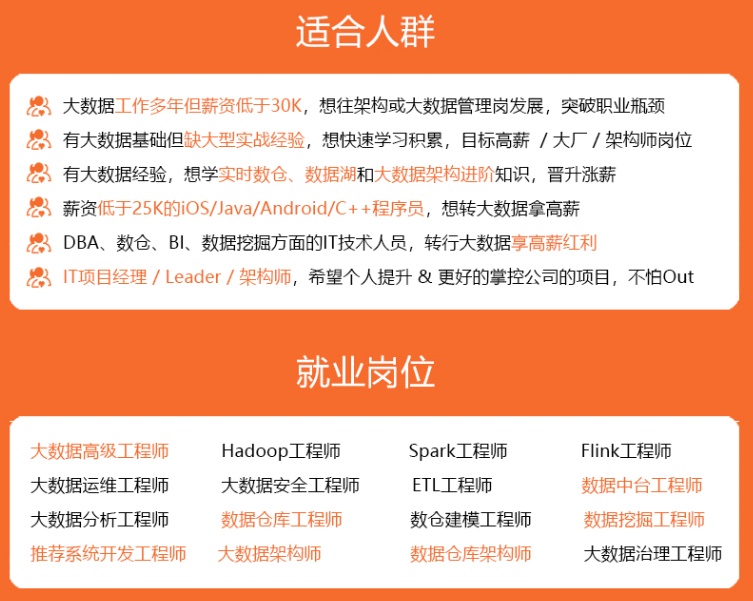

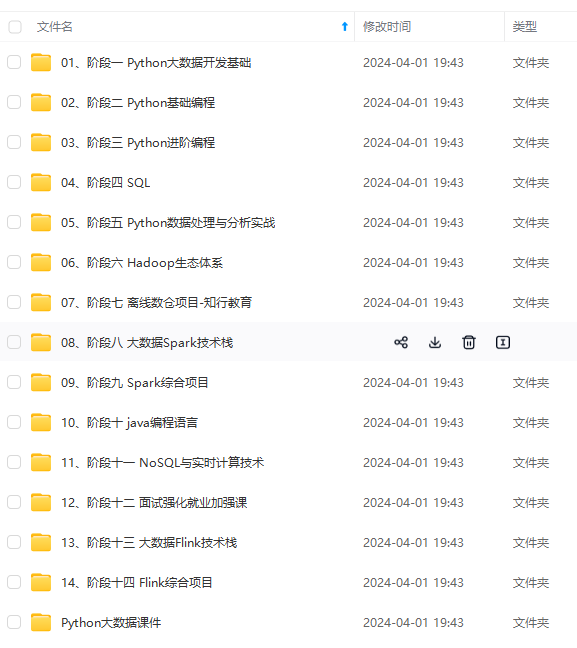

既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,涵盖了95%以上大数据知识点,真正体系化!

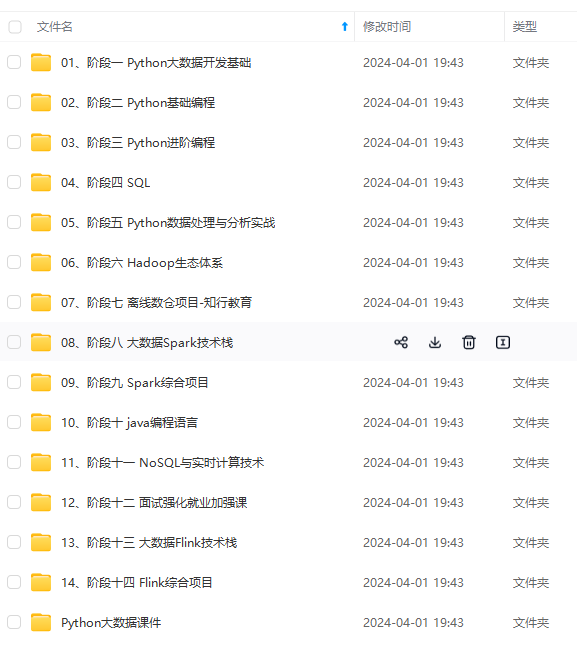

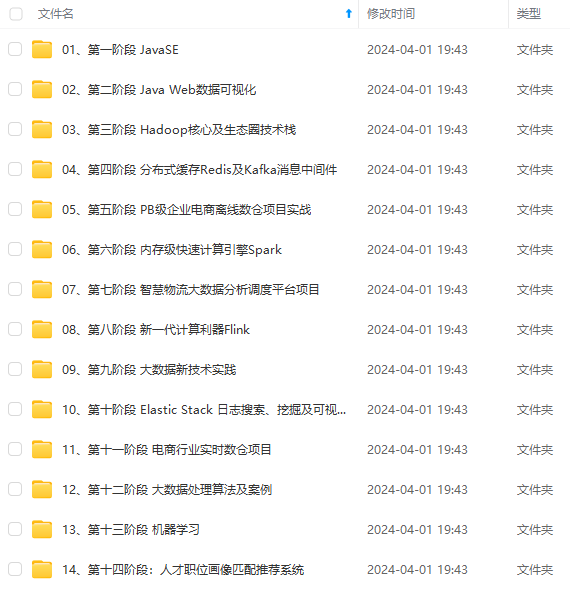

由于文件比较多,这里只是将部分目录截图出来,全套包含大厂面经、学习笔记、源码讲义、实战项目、大纲路线、讲解视频,并且后续会持续更新

- 数据聚合:如果有多个Hadoop集群,每个集群都在处理一部分数据,可以使用distcp命令将各个集群上的数据聚合到一个集群中进行后续的处理和分析。

总结起来,distcp命令是Hadoop中用于复制数据的工具,可以在不同的Hadoop集群之间、不同的Hadoop文件系统之间、甚至本地文件系统和Hadoop文件系统之间进行数据复制。它的原理是通过分布式的方式将源文件拆分成多个块,并在目标集群上并行地进行复制。应用场景包括数据迁移、数据备份和数据聚合等。

以下是一个使用distcp命令的例子: 假设我们有两个Hadoop集群:源集群和目标集群,并且我们要将源集群上的/user/source_data目录中的数据复制到目标集群的/user/target_data目录中。 使用distcp命令执行以下步骤:

1,登录到源集群的机器上。

2,执行以下命令:

/usr/hadoop/bin/hadoop distcp \

-Dmapreduce.job.queuename=hadoop队列名称 - m 200 \

hdfs://source_cluster/user/source_data

hdfs://target_cluster/user/target_data

-m 200表示200个并发核,可根据实际数据量更改,几个T的数据,200核大约需要10几到半个小时左右。

请确保将source_cluster和target_cluster替换为实际的源和目标集群的主机名或IP地址。 distcp命令将会启动一个MapReduce作业来复制数据。该作业将自动分配和执行任务以实现高效的数据复制。 请注意,distcp命令还支持其他选项和参数,如限制带宽、跳过文件校验等。你可以使用hadoop distcp -h命令查看完整的选项列表和用法示例。

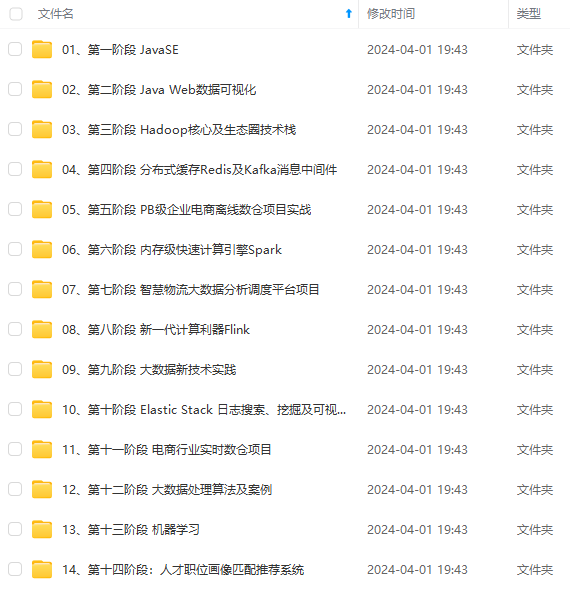

既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,涵盖了95%以上大数据知识点,真正体系化!

由于文件比较多,这里只是将部分目录截图出来,全套包含大厂面经、学习笔记、源码讲义、实战项目、大纲路线、讲解视频,并且后续会持续更新

资料的朋友,可以戳这里获取](https://bbs.csdn.net/topics/618545628)**

3093

3093

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?