网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

该课程适合于对大语言模型技术感兴趣的学习者,从初学者到进阶者均可受益。经过本课程的学习,获得相关技术实战经验,通过一系列的实践案例提高利用大模型解决实际问题能力。

【课程时长】

3天(6小时/天)

【课程对象】

理工科本科及以上,且至少了解一门编程语言。

【课程大纲】(培训内容可根据客户需求调整)

| Day1下午 | 强化学习基础1. 马尔科夫奖励/决策过程 |

- 状态行为值函数

- Bellman方程

- DP、MC、TD三者的关系

- 策略梯度方法

- 信赖域系方法背景

- PPO方法

chatGPT****的原理介绍 1、指示学习与InstructGPT 2、相关数据集 3、有监督微调(SFT) 4、从人类反馈中RL的思路 5、奖励建模(RM) 6、运用PPO改进 |

| Day2上午 | ChatGLM****部署 1、ChatGLM3-6B介绍 2、ChatGLM3搭建流程 3、应用场景(工具调用、代码执行) 4、权重量化 ChatGLM3****原理 1、Code Interpreter 2、多模态CogVLM 3、WebGLM搜索增强 微调大模型 1、基于chatGLM的微调 2、LoRA 3、Prefix Tuning 4、P-Tuning 5、Prompt Tuning 6、freeze 7、构建训练数据集 |

| Day2下午 | 其他开源大模型 1、LLaMA系列 2、通义千问(qwen) 3、零一万物(Yi) llama-factory****微调大模型 1、工具的主要功能 2、支持的模型 3、数据集准备 4、微调策略(LoRA, QLoRA, PEFT) |

| Day3上午 | 学习LangChain所需的知识储备 1、词嵌入与语义空间 2、高维向量的快速模糊匹配 3、局部敏感哈希(LSH) 4、向量数据库 LangChain****的原理 1、大模型利用的难点与痛点 2、Langchain的基本思路 3、关键组件 |

| Day3下午 | LangChain****的实操 1、环境搭建 2、知识库向量化与存储 3、问句向量化与初步匹配 4、合成prompt(提示词) 5、提交给LLM生成答案 大语言模型的其他应用 1、kimi chat 2、coze 3、文心一格与通义万相 |

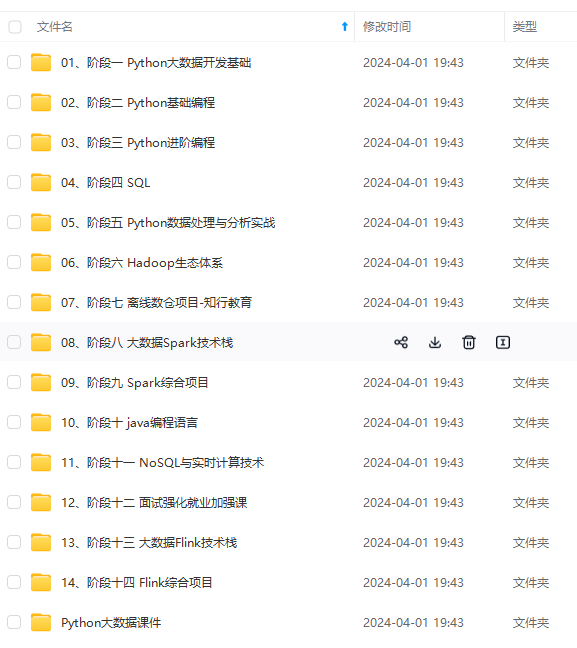

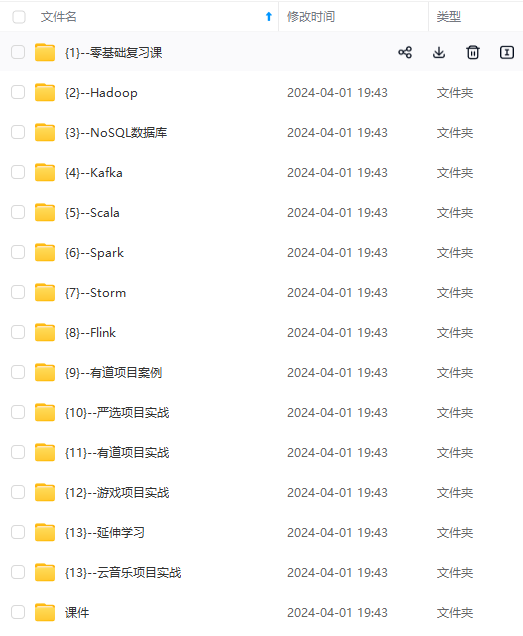

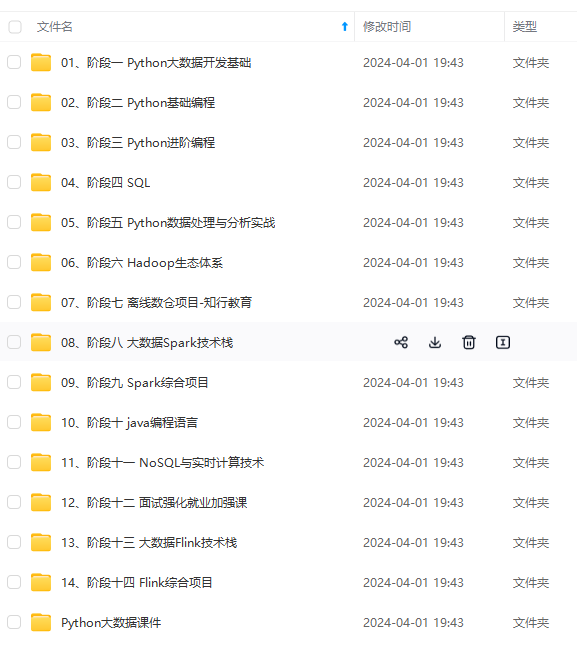

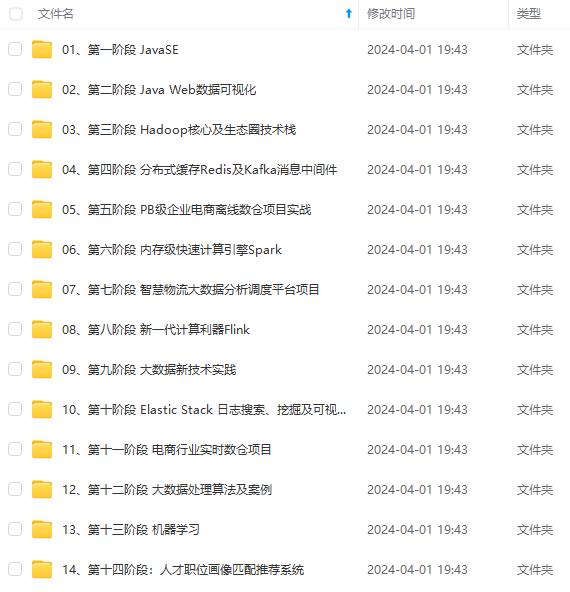

既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,涵盖了95%以上大数据知识点,真正体系化!

由于文件比较多,这里只是将部分目录截图出来,全套包含大厂面经、学习笔记、源码讲义、实战项目、大纲路线、讲解视频,并且后续会持续更新

https://bbs.csdn.net/forums/4f45ff00ff254613a03fab5e56a57acb)**

207

207

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?