网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

2.易用性

Spark支持Java、Python和Scala的API,还支持超过80种高级算法,使用户可以快速构建不同的应用。而且Spark支持交互式的Python和Scala的shell,可以非常方便地在这些shell中使用Spark集群来验证解决问题的方法。

3.通用性

Spark提供了统一的解决方案。Spark可以用于批处理、交互式查询(Spark SQL)、实时流处理(Spark Streaming)、机器学习(Spark MLlib)和图计算(GraphX)。这些不同类型的处理都可以在同一个应用中无缝使用。Spark统一的解决方案非常具有吸引力,毕竟任何公司都想用统一的平台去处理遇到的问题,减少开发和维护的人力成本和部署平台的物力成本。

4.兼容性

Spark可以非常方便地与其他的开源产品进行融合。

三、Spark的组成

Spark主要组件:

SparkCore:将分布式数据抽象为弹性分布式数据集(RDD),实现了应用任务调度,RPC,序列化和压缩,并为运行在其上的上层组件提供API。

SparkSQL: Spark Sql 是Spark来操作结构化数据的程序包,可以让我使用SQL语句的方式来查询数据,Spark支持多种数据源,包含Hive表,parquest以及JSON等内容

SparkStreaming: 是Spark提供的实时数据进行流式计算的组件

**MLlib:**提供常用机器学习算法的实现库

**GraphX:**提供一个分布式图计算框架,能高效进行图计算

**BlinkDB:**用于在海量数据上进行交互式SQL的近似查询引擎

**Tachyon:**以内存为中心高容错的分布式文件系统

四、应用场景

淘宝使用Spark来解决多次迭代的机器学习算法、高计算复杂度的算法等。应用于内容推荐,社区发现等

五、Spark之RDD

5.1什么是RDD

RDD叫做弹性分布式数据集,是Spark中最基本的数据抽象,它代表一个不可变,可分区,里面的元素可并行计算的集合。RDD具有数据流模型的特点:自动容错,位置感知性调度和可伸缩性。RDD允许用户在执行多个查询时显式地将工作集缓存在内存中,后续地查询能够重用工作集,这极大地提升了查询速度。

5.2RDD的属性

(1) 一组分片,即数据集的基本组成单位。对于RDD来说,每个分片都会被一个计算任务处理,并决定并行计算的粒度。

(2)一个计算每个分区的函数。Spark中的RDD的计算以分片为单位的,每个RDD都会实现compute函数以达到这个目的。

(3)RDD之间的依赖关系。RDD的每次转换都会生成一个新的RDD,所以RDD之间就会形成类似于流水线一样的前后依赖关系。部分分区数据丢失时,Spark可以通过这个依赖关系重新计算对视的分区数据,而不是对RDD的所有分区进行重新计算。

(4)一个Partitioner,即RDD的分片函数。当前Spark中实现了两种类型的分片函数,一个是基于哈希的,另一个是基于范围的

(5)一个列表,存储存取每个Partition(分片)的优先位置。对于一个HDFS文件来说,这个列表保存的就是每个Partition所在的块的位置。

5.3通过简单的词频统计来了解RDD

img

六、RDD的创建方式

6.1通过读取文件生成

由外部存储系统的数据集创建,包括本地的文件系统,还有所有Hadoop支持的数据集,比如HDFS、Cassandra、HBase等

scala> val file = sc.textFile("/spark/hello.txt")

6.2通过并行化的方式创建RDD

由一个已经存在的Scala集合创建

scala> val array = Array(1,2,3,4,5)

array: Array[Int] = Array(1, 2, 3, 4, 5)

scala> val rdd = sc.parallelize(array)

rdd: org.apache.spark.rdd.RDD[Int] = ParallelCollectionRDD[27] at parallelize at <console>:26

6.3其他方式

读取数据库等等其他的操作。也可以生成RDD。

RDD可以通过其他的RDD转换而来的。

七、RDD编程API

Spark支持两个类型(算子)操作:Transformation和Action

7.1Transformation

主要做的是就是将一个已有的RDD生成另外一个RDD。Transformation具有lazy特性(延迟加载)。Transformation算子的代码不会真正被执行。只有当我们的程序里面遇到一个action算子的时候,代码才会真正的被执行。这种设计让Spark更加有效率地运行。

常用的Transformation:

| 转换 | 含义 |

|---|---|

| map(func) | 返回一个新的RDD,该RDD由每一个输入元素经过func函数转换后组成 |

| filter(func) | 返回一个新的RDD,该RDD由经过func函数计算后返回值为true的输入元素组成 |

| flatMap(func) | 类似于map,但是每一个输入元素可以被映射为0或多个输出元素(所以func应该返回一个序列,而不是单一元素) |

| union(otherDataset) | 对源RDD和参数RDD求并集后返回一个新的RDD |

| groupByKey([numTasks]) | 在一个(K,V)的RDD上调用,返回一个(K, Iterator[V])的RD |

| sortByKey | 在一个(K,V)的RDD上调用,K必须实现Ordered接口,返回一个按照key进行排序的(K,V)的RDD |

| 官方很全面,这里只做了解。 |

7.2Action

触发代码的运行,我们一段spark代码里边至少需要有一个action操作

常用的Action:

| 动作 | 含义 |

|---|---|

| reduce(func) | 通过func函数聚集RDD中的所有元素,这个功能必须是课交换且可并联的 |

| collect() | 在驱动程序中,以数组的形式返回数据集的所有元素 |

| count() | 返回RDD的元素个数 |

| first() | 返回RDD的第一个元素(类似于take(1)) |

| foreach(func) | 在数据集的每一个元素上,运行函数func进行更新。 |

| 此处只是列举几个,更为全面的去查看官方文档 |

7.3Spark WordCount代码编写

使用maven进行项目搭建

查看官方文档,导入2个依赖包

详细代码-scala

import org.apache.spark.rdd.RDD

import org.apache.spark.{SparkConf, SparkContext}

object SparkWordCountWithScala {

def main(args: Array[String]): Unit = {

val conf = new SparkConf()

/\*\*

\* 如果这个参数不设置,默认认为你运行的是集群模式

\* 如果设置成local代表运行的是local模式

\*/

conf.setMaster("local")

//设置任务名

**既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,涵盖了95%以上大数据知识点,真正体系化!**

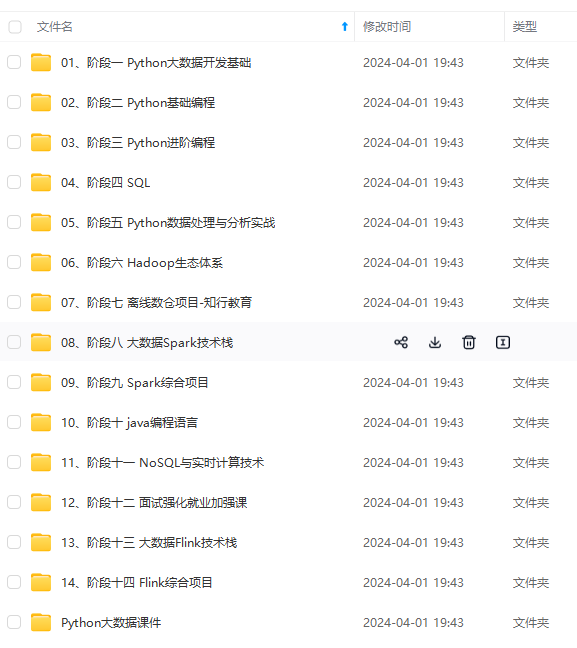

**由于文件比较多,这里只是将部分目录截图出来,全套包含大厂面经、学习笔记、源码讲义、实战项目、大纲路线、讲解视频,并且后续会持续更新**

**[需要这份系统化资料的朋友,可以戳这里获取](https://bbs.csdn.net/topics/618545628)**

652394672)]

**既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,涵盖了95%以上大数据知识点,真正体系化!**

**由于文件比较多,这里只是将部分目录截图出来,全套包含大厂面经、学习笔记、源码讲义、实战项目、大纲路线、讲解视频,并且后续会持续更新**

**[需要这份系统化资料的朋友,可以戳这里获取](https://bbs.csdn.net/topics/618545628)**

359

359

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?