是Python内置的HTTP请求库,不需要额外安装即可使用,包含以下4个模块:

request 打开和读取 URL,最基本的HTTP请求模块,可以用来模拟发送请求

error 包含 urllib.request 抛出的异常,如果出现请求错误,我们可以捕获这些异常,然后进行重试或其他操作以保证程序不会意外终止。

parse 用于解析 URL,比如拆分、解析、合并等。

robotparser 用于解析 robots.txt 文件,主要是用来识别网站的robots.txt文件,然后判断哪些网站可以爬,哪些网站不可以爬。

需要注意的是urllib不能自动判断重定向,需要自己解析重定向的链接并重新请求。

如果你只是爬取一般的网页,那么Python自带的urllib库足够用了,如果是想要爬取异步加载的动态网站,requests库会方便很多。

requests库

功能强大的爬取网页信息的第三方库,可以进行自动爬取HTML页面及自动网络请求提交的操作。

requests库的主要方法:

Response对象

技巧二:抓包工具分析网络请求

抓取工具主要有chrome firefox fidder appium,重点讲一下fidder,基本可以说目前最为全面和强大的抓包工具就是fiddler了,使用也不算麻烦。

Fiddler也在官网上有提供非常详细的文档和教程,如果使用的时候遇到问题,可以直接查阅官网文档。我们可以利用Fiddler详细的对HTTP请求进行分析,并模拟对应的HTTP请求。

fiddler本质就是一个HTTP代理服务器,功能非常强大,除了可以清晰的了解每个请求与响应之外,还可以进行断点设置,修改请求数据、拦截响应内容。

技巧三:解析数据库

解析库有非常多可以选择,比如CSS、pyqery、re、xpath等,比较建议掌握Beautiful Soup和Xpath

Beautiful Soup解析库

为第三方库需要安装使用,在命令行用pip安装就可以了:

pip install bs4

具体用法:变量名称 = BeautifulSoup(需要解析的数据,"html.parser’)

它是一个工具箱,通过解析文档为用户提供需要抓取的数据,因为简单,所以不需要多少代码就可以写出一个完整的应用程序,能自动转换编码。

BeautifulSoup支持的解析器

1.Python标准库:内置库、执行速度适中、文档容错能力强;

2.lxml HTML解析器:速度快,文档容错能力强(推荐);

3.lxml XML解析器:速度快,唯一支持xml的解析器;

4.html5lib:最好的容错性、以浏览器方式解析文档,生成HTML5格式的文档。

具体用法:soup=BeautifulSoup(markup,from_encoding=“编码方式”)

Xpath解析库

提供了非常简洁明了的路径选择表达式,XPath相对于正则表达式显得更加简洁明了,对于网页的节点来说,它可以定义id、class或其他属性。而且节点之间还有层次关系,在网页中可以通过XPath来定位一个或多个节点

规则:

技巧四:保存数据

学到这里就比较容易了,主要是对数据的存储和处理,有两种方式:

小规模数据可以使用txt文件、json文件、csv文件等方式来保存文件。

大规模数据就需要使用数据库了像mysql,mongodb、redis等,就比较方便查询管理。

这一块掌握主流的MongoDB 就可以了,可以方便你去存储一些非结构化的数据,比如各种评论的文本,图片的链接等等。

以上这些核心技巧Python都有相应的库帮你去做,你只需要知道如何去应用它们,掌握精通每一部分的一到两种方法就可以了。

还想对爬虫了解更多的话继续往下看吧

反爬虫应对

当你能够独自爬取80%以上的网站后,再学点反爬技巧,爬虫之路不会有太大的阻碍。

一般爬虫过程中可能会碰到像奇奇怪怪的验证码、被封IP(例如豆瓣和github,在检测到某一客户端频繁访问后,会直接封锁ip)、userAgent访问限制、动态数据加载、加密数据等这种反爬虫的手段。

简单一点的根据User-Agent过滤,例如知乎,我们只需要设置为和浏览器相同即可。常规的解决办法通常有比如控制访问频率、抓包、反加密字体、验证码OCR处理、使用代理IP池等,简单一点的根据User-Agent过滤,例如知乎,我们只需要设置为和浏览器相同即可。能够掌握常规的反爬技巧,绝大部分的网站爬虫不是问题。

这里需要提示一点的是:不要去挑战某宝的反爬!后果很严重!

如果不满足自己的爬虫效率,觉得爬取速度太慢了,可以去学习爬虫框架scrapy和分布式爬虫。

爬虫框架scrapy:

Python开发的一个快速、高层次的屏幕抓取和web抓取框架,用于抓取web站点并从页面中提取结构化的数据。Scrapy用途广泛,可以用于数据挖掘、监测和自动化测试.

Scrapy框架主要由五大组件组成,分别是调度器(Scheduler)、下载器(Downloader)、爬虫(Spider)和实体管道(Item Pipeline)、Scrapy引擎(Scrapy Engine)。

在复杂的情况下,scrapy框架不仅能够便捷地构建request,还有强大的 selector 能够方便地解析 response,这是一个功能十分强大的爬虫框架,可以实现爬虫工程化和模块化。

分布式爬虫

企业级爬虫,能实现数据的大规模采集,通俗一点来理解就是它可以实现多台电脑使用一个共同的爬虫程序,同时将爬虫任务部署到多台电脑上运行,这样可以提高爬虫速度和效率,需要掌握 Scrapy + MongoDB + Redis 这三种工具。

但是分布式爬虫对电脑的CPU和网速都有一定的要求,这个看个人需要,如果你需要用于大规模的数据爬取,分布式爬虫可以帮你解决很多的麻烦。大部分情况下单一爬虫都能满足一般的爬取需要,只是爬取效率比不了分布式爬虫,有条件的可以尝试学学分布式爬虫。

关于Python学习指南

学好 Python 不论是就业还是做副业赚钱都不错,但要学会 Python 还是要有一个学习规划。最后给大家分享一份全套的 Python 学习资料,给那些想学习 Python 的小伙伴们一点帮助!

包括:Python激活码+安装包、Python web开发,Python爬虫,Python数据分析,人工智能、自动化办公等学习教程。带你从零基础系统性的学好Python!

最后

Python崛起并且风靡,因为优点多、应用领域广、被大牛们认可。学习 Python 门槛很低,但它的晋级路线很多,通过它你能进入机器学习、数据挖掘、大数据,CS等更加高级的领域。Python可以做网络应用,可以做科学计算,数据分析,可以做网络爬虫,可以做机器学习、自然语言处理、可以写游戏、可以做桌面应用…Python可以做的很多,你需要学好基础,再选择明确的方向。这里给大家分享一份全套的 Python 学习资料,给那些想学习 Python 的小伙伴们一点帮助!

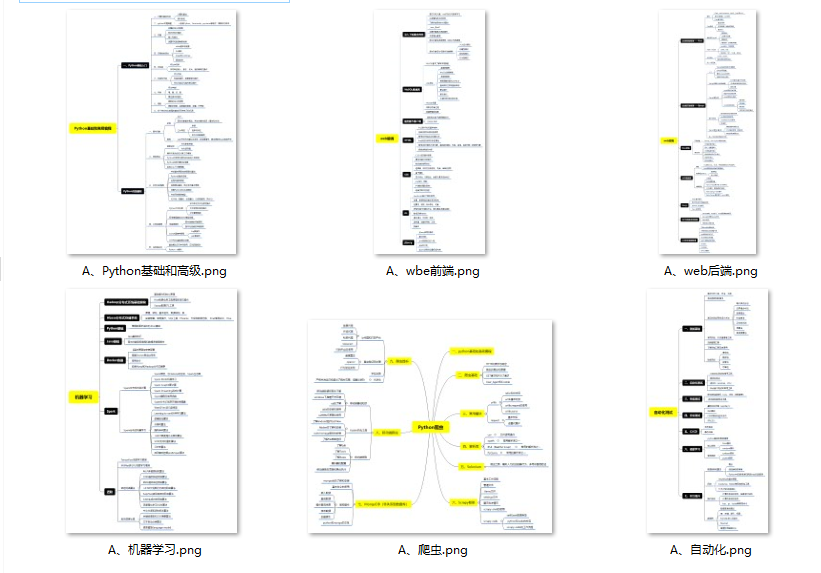

👉Python所有方向的学习路线👈

Python所有方向的技术点做的整理,形成各个领域的知识点汇总,它的用处就在于,你可以按照上面的知识点去找对应的学习资源,保证自己学得较为全面。

👉Python必备开发工具👈

工欲善其事必先利其器。学习Python常用的开发软件都在这里了,给大家节省了很多时间。

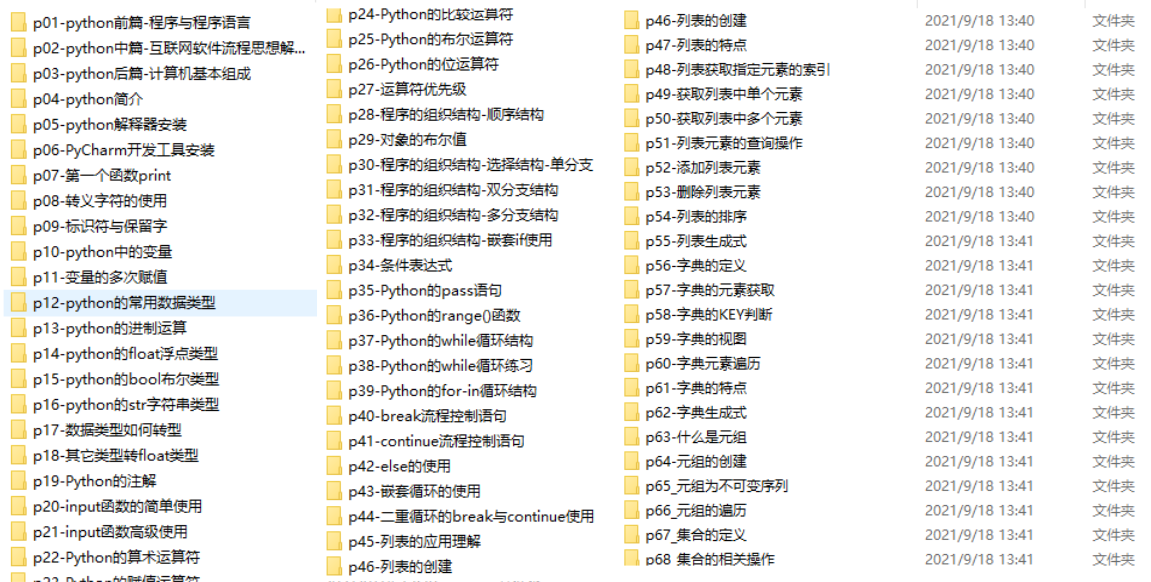

👉Python全套学习视频👈

我们在看视频学习的时候,不能光动眼动脑不动手,比较科学的学习方法是在理解之后运用它们,这时候练手项目就很适合了。

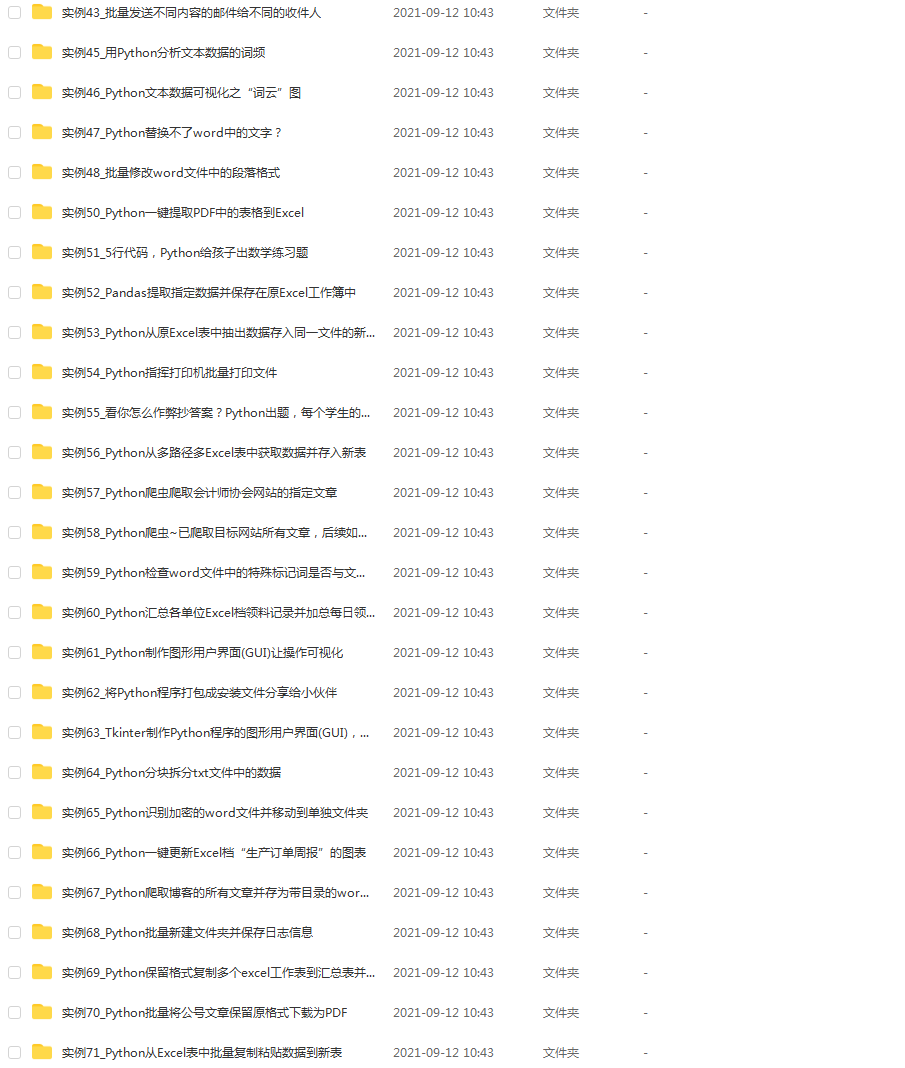

👉实战案例👈

学python就与学数学一样,是不能只看书不做题的,直接看步骤和答案会让人误以为自己全都掌握了,但是碰到生题的时候还是会一筹莫展。

因此在学习python的过程中一定要记得多动手写代码,教程只需要看一两遍即可。

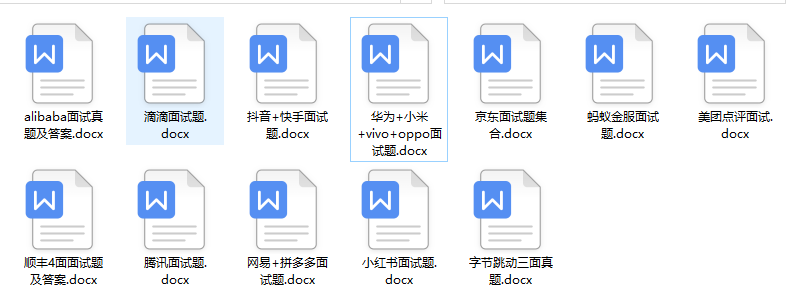

👉大厂面试真题👈

我们学习Python必然是为了找到高薪的工作,下面这些面试题是来自阿里、腾讯、字节等一线互联网大厂最新的面试资料,并且有阿里大佬给出了权威的解答,刷完这一套面试资料相信大家都能找到满意的工作。

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

55万+

55万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?