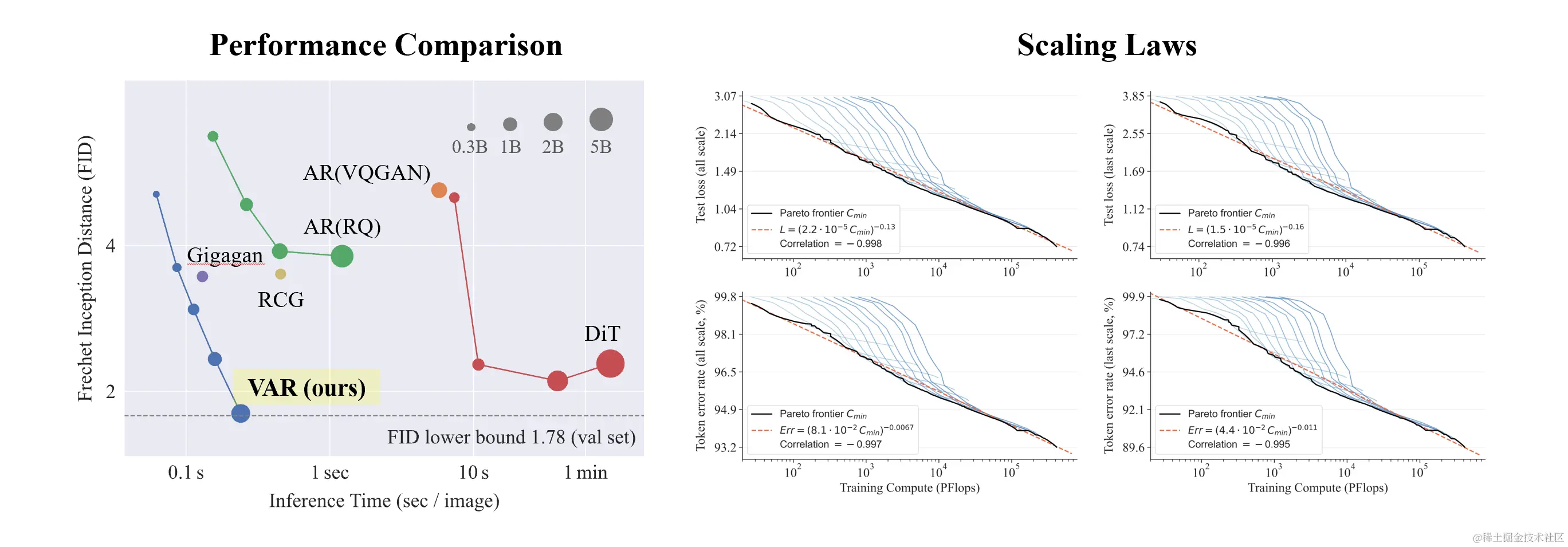

新一代视觉生成范式「VAR: Visual Auto Regressive」视觉自回归来了!使 GPT 风格的自回归模型在图像生成首次超越扩散模型,并观察到与大语言模型相似的 Scaling Laws 缩放定律、Zero-shot Task Generalization 泛化能力:

论文标题:Visual Autoregressive Modeling: Scalable Image Generation via Next-Scale Prediction

这项名为 VAR 的新工作由北京大学和字节跳动的研究者提出,登上了 GitHub 和 Paperwithcode 热度榜单,并得到大量同行关注:

目前体验网站、论文、代码、模型已放出:

- 体验网站:var.vision/

- 论文链接:arxiv.org/abs/2404.02…

- 开源代码:github.com/FoundationV…

- 开源模型:huggingface.co/FoundationV…

背景介绍

在自然语言处理中,以 GPT、LLaMa 系列等大语言模型为例的 Autoregressive 自回归模型已经取得了较大的成功,尤其 Scaling Law 缩放定律和 Zero-shot Task Generalizability 零样本任务泛化

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?