一、大语言模型的困境:从“鹦鹉学舌”到“知识饥渴”

在人工智能领域,大语言模型(LLMs)的出现曾让我们惊叹于其语言能力——它们能流畅对话、撰写文章,甚至模仿人类的逻辑推理。然而,随着应用场景的深入,这些“超级智能鹦鹉”的局限性逐渐暴露:

-

时效性缺失

模型训练数据往往截止到某个固定时间点,无法回答“昨晚比赛结果”“最新政策变化”等实时问题。

-

知识边界模糊

面对企业内部文档、专业领域知识等私有数据时,传统LLMs因缺乏访问权限而无法准确响应。

-

幻觉风险

当模型对未知领域信息缺乏可靠依据时,可能会“编造事实”,导致回答不可信。

这些问题的核心,在于传统LLMs的知识更新依赖静态训练,无法动态获取外部信息。正如让一位渊博的历史学家评论最新社交媒体趋势,其知识体系的“时差”使其无法有效应对。为突破这一困境,检索增强生成(Retrieval-Augmented Generation,RAG)技术应运而生,成为连接LLMs与实时、私有知识的桥梁。

二、RAG的核心逻辑:给模型装上“动态知识库”

RAG的本质,是将检索(Retrieval)与生成(Generation)相结合,让LLMs在回答问题时不再依赖“记忆”,而是通过实时检索外部知识库获取最新信息。其核心优势可类比为:

-

从“死记硬背”到“活学活用”

传统LLMs如同“考前突击的学生”,依赖训练数据中的记忆;RAG则像“带教材进考场的考生”,可随时查阅最新资料。

-

从“单一知识库”到“多元信息网”

RAG支持接入企业内部文档、行业数据库、实时新闻等多源数据,打破传统模型对公开数据的依赖。

-

从“模糊猜测”到“有据可依”

通过检索验证信息来源,显著降低模型幻觉风险,提升回答可信度。

(一)RAG的三大应用场景

-

企业知识管理

在大型企业中,海量知识分散在员工头脑、历史文件或内部系统中。当新问题出现时,传统方式需耗费大量时间查找资料,而RAG可作为“企业级大脑”: -

- 实时检索产品手册、技术文档、过往解决方案,辅助员工快速定位答案;

- 整合跨部门知识,避免重复劳动,提升决策效率。

-

智能客服升级

传统客服机器人依赖预设FAQ,无法处理复杂或个性化问题。RAG则能: -

- 实时检索产品更新说明、用户历史工单,提供精准解答;

- 结合用户提问语境,从海量文档中提取相关片段,生成自然语言回复,减少人工介入。

-

实时信息查询

应对新闻事件、金融数据、体育赛事等动态内容时,RAG可: -

- 连接实时数据源(如API接口、新闻网站),确保回答时效性;

- 过滤冗余信息,仅向LLMs提供最相关的上下文,避免信息过载。

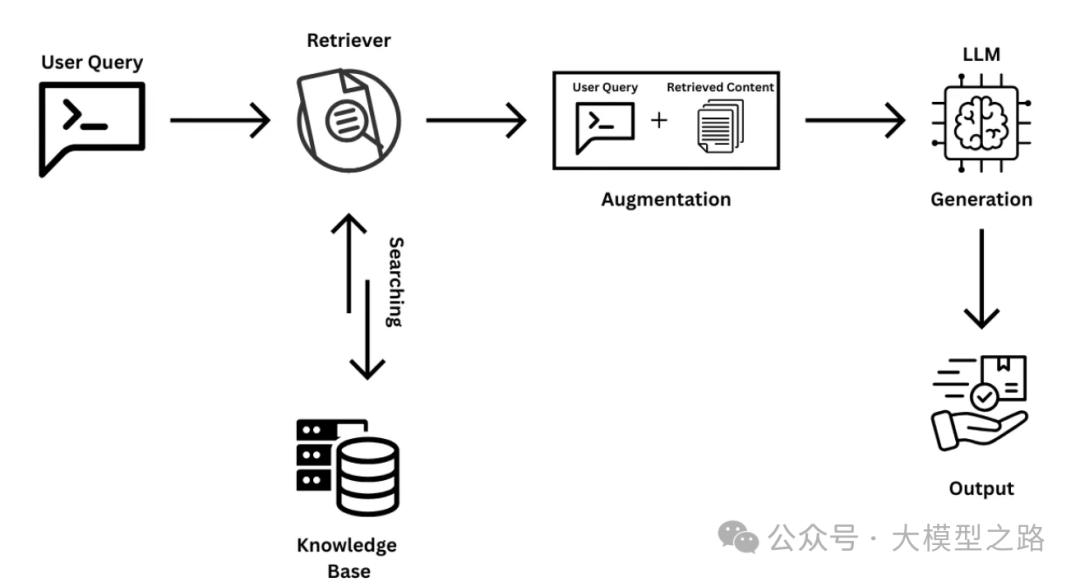

三、RAG的技术架构:四步实现“知识注入”

RAG的实现流程可拆解为四个核心步骤,每个环节均依赖特定工具与技术,共同构建从数据到回答的完整链路。

(一)数据预处理:将“大书”拆成“闪卡”

- 文档加载与解析

使用工具(如LangChain的Document Loaders)从多种数据源(PDF、网页、数据库等)提取原始数据,并转换为统一格式。例如,解析PDF时需保留文本结构、表格内容,处理网页时需过滤广告、提取正文。 - 文本分块(Chunking)

为避免单一文本块过大导致LLMs处理效率下降,需将长文档拆分为数百字的“文本片段”(如LangChain的RecursiveCharacterTextSplitter)。这一步类似将教科书拆解为知识点卡片,便于后续检索与匹配。 - 向量化编码(Embedding)

通过嵌入模型(如OpenAI的text-embedding-ada-002、Google的Universal Sentence Encoder)将文本片段转换为高维向量(“意义标签”)。向量空间中的距离反映语义相关性,例如“苹果手机续航”与“iPhone电池评测”的向量应高度相似。 - 向量存储(Vector Store)

将向量存入专用数据库(如FAISS、Chroma、Pinecone),并建立索引(Indexing)以加速检索。这类数据库如同“语义图书馆”,按内容相关性而非标题或关键词组织数据,支持快速的近邻搜索(Nearest Neighbor Search)。

(二)检索:快速定位“相关闪卡”

当用户提问时,系统首先将问题转换为向量,然后在向量存储中检索与问题向量最相似的文本片段(通常返回前5-10条)。这一过程类似图书馆员根据读者问题关键词,快速从千万册书籍中找到最相关的章节摘要。

关键技术点:

-

相似度算法

常用余弦相似度(Cosine Similarity)、欧式距离等衡量向量相关性;

-

检索优化

通过分层索引(Hierarchical Indexing)、缓存机制(Caching)减少检索延迟,应对高并发请求。

(三)增强:为问题“添加上下文”

将检索到的文本片段与原始问题结合,形成包含背景信息的“增强查询”。例如,用户提问“如何解决X产品卡顿问题”,若检索到文档中“X产品缓存清理步骤”的片段,则将其作为上下文附加到问题中。

这一步的核心作用是:

- 为LLMs提供回答所需的具体知识,弥补其训练数据之外的信息缺口;

- 缩小生成范围,引导模型基于可靠来源作答,降低幻觉风险。

(四)生成:用“知识+语言能力”产出答案

将增强后的查询输入LLMs(如GPT-4、Claude、Gemini),模型结合自身训练的语言理解能力与检索到的外部知识,生成自然语言回答。例如,GPT-4可根据“缓存清理步骤”的上下文,用用户易懂的语言解释操作流程,同时补充常见问题注意事项。

此时,LLMs的角色从“知识生产者”转变为“知识整合者”,其输出质量取决于:

- 检索结果的相关性与完整性;

- 模型对多源信息的逻辑串联能力。

四、RAG的技术工具箱:LangChain的模块化支持

RAG的实现涉及数据处理、向量检索、流程编排等多个技术环节,而LangChain作为开源框架,提供了一站式工具集,大幅降低开发门槛。

(一)核心组件解析

-

文档加载器(Document Loaders)

-

-

功能:从不同数据源提取原始数据,支持PDF、Markdown、CSV、SQL数据库、网页(如BeautifulSoupLoader)等。

-

示例:加载本地PDF文档:

-

from langchain.document_loaders import PyPDFLoader

loader = PyPDFLoader("report.pdf")

documents = loader.load()

-

文本分割器(Text Splitters)

-

-

功能:将长文本拆分为固定长度的片段,支持按字符数、句子或段落分割。

-

示例:使用RecursiveCharacterTextSplitter按1000字分块:

-

from langchain.text_splitter import RecursiveCharacterTextSplitter

text_splitter = RecursiveCharacterTextSplitter(chunk_size=1000, chunk_overlap=200)

texts = text_splitter.split_documents(documents)

-

嵌入模型(Embedding Models)

-

-

功能:将文本转换为向量,支持OpenAI、Hugging Face等多厂商模型。

-

示例:使用OpenAIEmbeddings生成向量:

-

from langchain.embeddings import OpenAIEmbeddings

embeddings = OpenAIEmbeddings()

text_embeddings = embeddings.embed_query("示例文本")

-

向量存储(Vector Stores)

-

-

功能:存储向量并提供检索接口,支持Chroma(本地存储)、Pinecone(云端服务)等。

-

示例:将文本片段存入Chroma:

-

from langchain.vectorstores import Chroma

vector_store = Chroma.from_documents(texts, embeddings)

-

检索器(Retrievers)

-

-

功能:根据用户查询从向量存储中检索相关文本,支持关键词检索、向量相似度检索等。

-

示例:检索与“用户隐私保护”相关的文本:

-

retriever = vector_store.as_retriever()

relevant_docs = retriever.get_relevant_documents("用户隐私保护")

-

链条(Chains)

-

-

功能:编排RAG流程,将检索与生成步骤串联。

-

示例:创建简单RAG链条:

-

from langchain.chains import RetrievalQA

chain = RetrievalQA.from_chain_type(llm=ChatOpenAI(), retriever=retriever)

answer = chain.run("如何保护用户隐私?")

(二)LangChain的优势

-

模块化设计

各组件可灵活替换(如切换嵌入模型、向量存储),适应不同技术栈;

-

低代码门槛

通过预设链条(如RetrievalQA),开发者无需关注底层细节,快速搭建RAG系统;

-

生态整合

支持与主流LLMs、数据源无缝对接,简化端到端开发流程。

五、RAG的挑战与应对策略

尽管RAG显著提升了LLMs的实用性,但其落地仍面临以下技术挑战:

(一)多模态数据处理难题

-

问题

当输入包含图片、音频等非文本数据时,需先通过OCR、语音识别转换为文本,再进行向量化。不同模态的语义一致性难以保证(如图片描述与文字说明可能存在偏差)。

-

解决方案

-

- 采用多模态嵌入模型(如CLIP、ALBEF),统一处理图文数据;

- 对非文本数据进行标准化预处理(如音频转文字后分段),确保与文本数据的向量化逻辑一致。

(二)大规模数据下的性能瓶颈

-

问题

当向量存储包含数十亿条记录时,检索延迟可能从毫秒级升至秒级,影响用户体验;存储成本也会随数据量激增。

-

解决方案

-

-

分层检索

将高频数据存入内存型向量数据库(如Chroma),低频数据存储于磁盘或云端(如Pinecone);

-

近似最近邻(ANN)算法

使用HNSW、IVF等算法减少检索时的计算量,在精度损失可控的前提下提升速度;

-

数据压缩

通过量化(Quantization)技术降低向量维度,减少存储空间占用。

-

(三)数据质量依赖症

-

问题

若原始文档存在错误、冗余或格式混乱,检索结果可能引入“脏数据”,导致LLMs生成错误回答。

-

解决方案

-

- 建立数据清洗管道(ETL流程),剔除重复内容、修正语法错误、标准化格式;

- 引入置信度评估机制:LLMs生成回答后,对比检索到的原始文本,验证事实一致性,对存疑内容标注“可能存在误差”。

(四)跨领域泛化能力不足

-

问题

当RAG系统仅针对特定领域(如医疗)训练时,处理其他领域(如法律)问题可能因知识库缺失而失效。

-

解决方案

-

- 构建领域无关的通用向量存储,或通过联邦学习(Federated Learning)整合多领域数据;

- 在查询阶段动态识别领域标签,自动切换对应的知识库(如医疗问题优先检索医学文献库)。

读者福利:如果大家对大模型感兴趣,这套大模型学习资料一定对你有用

对于0基础小白入门:

如果你是零基础小白,想快速入门大模型是可以考虑的。

一方面是学习时间相对较短,学习内容更全面更集中。

二方面是可以根据这些资料规划好学习计划和方向。

包括:大模型学习线路汇总、学习阶段,大模型实战案例,大模型学习视频,人工智能、机器学习、大模型书籍PDF。带你从零基础系统性的学好大模型!

😝有需要的小伙伴,可以保存图片到wx扫描二v码免费领取【保证100%免费】🆓

👉AI大模型学习路线汇总👈

大模型学习路线图,整体分为7个大的阶段:(全套教程文末领取哈)

第一阶段: 从大模型系统设计入手,讲解大模型的主要方法;

第二阶段: 在通过大模型提示词工程从Prompts角度入手更好发挥模型的作用;

第三阶段: 大模型平台应用开发借助阿里云PAI平台构建电商领域虚拟试衣系统;

第四阶段: 大模型知识库应用开发以LangChain框架为例,构建物流行业咨询智能问答系统;

第五阶段: 大模型微调开发借助以大健康、新零售、新媒体领域构建适合当前领域大模型;

第六阶段: 以SD多模态大模型为主,搭建了文生图小程序案例;

第七阶段: 以大模型平台应用与开发为主,通过星火大模型,文心大模型等成熟大模型构建大模型行业应用。

👉大模型实战案例👈

光学理论是没用的,要学会跟着一起做,要动手实操,才能将自己的所学运用到实际当中去,这时候可以搞点实战案例来学习。

👉大模型视频和PDF合集👈

观看零基础学习书籍和视频,看书籍和视频学习是最快捷也是最有效果的方式,跟着视频中老师的思路,从基础到深入,还是很容易入门的。

👉学会后的收获:👈

• 基于大模型全栈工程实现(前端、后端、产品经理、设计、数据分析等),通过这门课可获得不同能力;

• 能够利用大模型解决相关实际项目需求: 大数据时代,越来越多的企业和机构需要处理海量数据,利用大模型技术可以更好地处理这些数据,提高数据分析和决策的准确性。因此,掌握大模型应用开发技能,可以让程序员更好地应对实际项目需求;

• 基于大模型和企业数据AI应用开发,实现大模型理论、掌握GPU算力、硬件、LangChain开发框架和项目实战技能, 学会Fine-tuning垂直训练大模型(数据准备、数据蒸馏、大模型部署)一站式掌握;

• 能够完成时下热门大模型垂直领域模型训练能力,提高程序员的编码能力: 大模型应用开发需要掌握机器学习算法、深度学习框架等技术,这些技术的掌握可以提高程序员的编码能力和分析能力,让程序员更加熟练地编写高质量的代码。

👉获取方式:

😝有需要的小伙伴,可以保存图片到wx扫描二v码免费领取【保证100%免费】🆓

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?