DiffGAN-TTS简介

DiffGAN-TTS是一种新型的基于去噪扩散概率模型(DDPMs)的文本转语音(TTS)模型,由刘松祥等人于2022年提出。该模型结合了去噪扩散模型和生成对抗网络(GANs)的优点,能够生成高保真度的语音,同时具有较高的推理效率。

DiffGAN-TTS的主要特点包括:

- 采用去噪扩散GAN架构,使用对抗性训练的表达能力强的模型来近似去噪分布

- 允许较大的去噪步长,提高了生成过程的效率

- 引入主动浅层扩散机制,进一步加速推理

- 采用两阶段训练方案,先训练基础声学模型,再训练DDPM模型

实验表明,DiffGAN-TTS仅需4步去噪即可生成高保真度的语音样本,在1步去噪的情况下也能达到较好的合成效果。

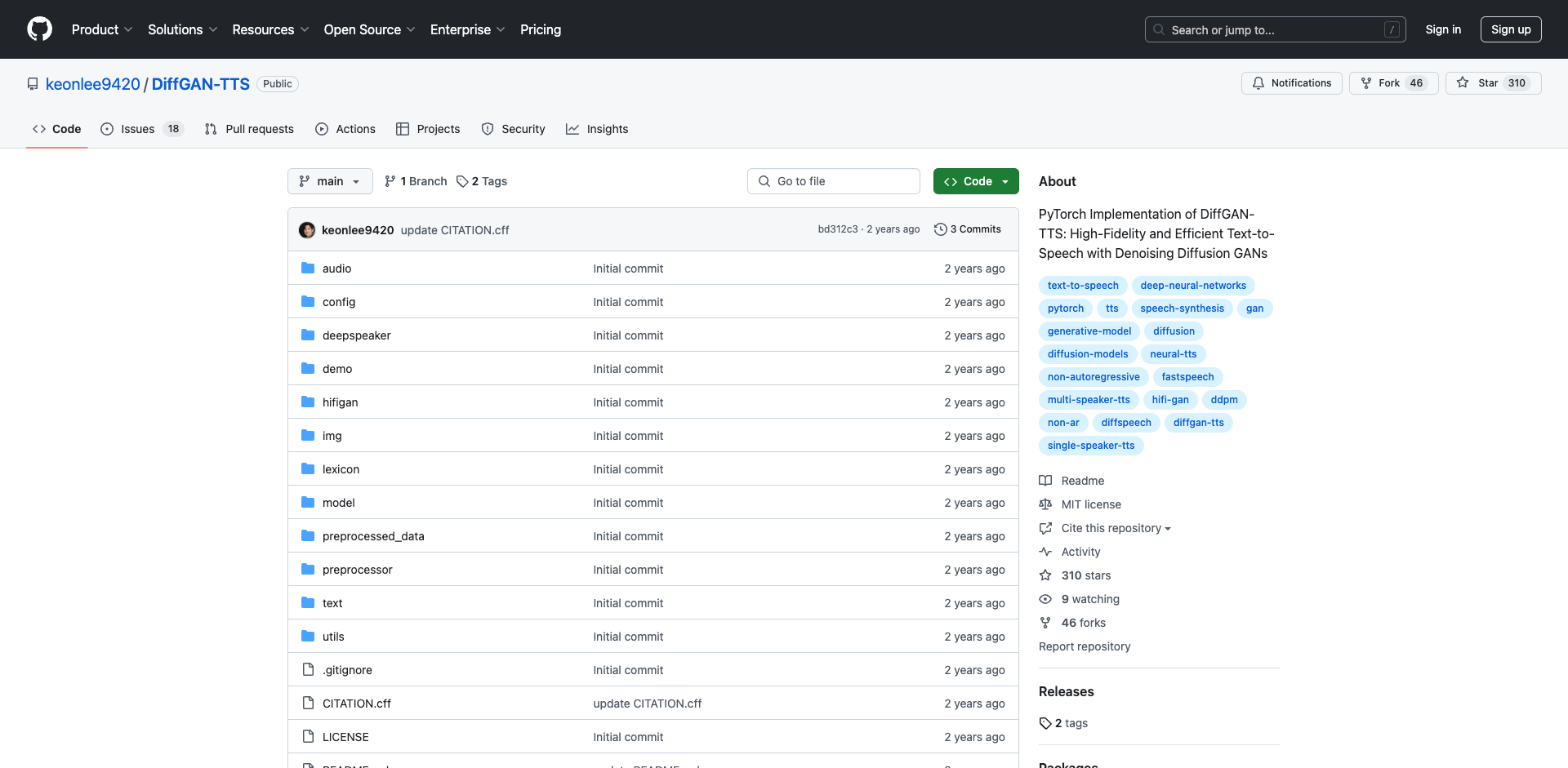

官方代码实现

DiffGAN-TTS的PyTorch官方实现代码已在GitHub开源:

该仓库提供了模型的完整实现,包括:

- 数据预处理

- 模型训练

- 语音合成

- 预训练模型

感兴趣的读者可以直接克隆该仓库进行实验。

论文原文

DiffGAN-TTS的原始论文发表于ICASSP 2022,题为《DiffGAN-TTS: High-Fidelity and Efficient Text-to-Speech with Denoising Diffusion GANs》:

论文详细介绍了DiffGAN-TTS的模型结构、训练方法和实验结果,是深入理解该模型的重要参考资料。

相关博客解读

以下是一些对DiffGAN-TTS进行解读的博客文章,可以帮助读者更好地理解该模型:

音频样例

DiffGAN-TTS的音频合成效果可以在以下链接中听到:

该页面提供了多个中文语音合成样例,包括不同说话人和不同文本内容,可以直观感受DiffGAN-TTS的合成效果。

总结

DiffGAN-TTS作为一种新型的TTS模型,在语音质量和合成效率上都取得了很好的效果。本文汇总了DiffGAN-TTS的相关学习资料,希望能够帮助读者快速了解和学习这一前沿TTS技术。随着相关研究的不断深入,DiffGAN-TTS有望在实际应用中发挥重要作用。

文章链接:www.dongaigc.com/a/diffgan-tts-study-resources

https://www.dongaigc.com/a/diffgan-tts-study-resources

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?