Cog简介:机器学习模型的容器化利器

在人工智能和机器学习快速发展的今天,如何高效地将模型从研究环境部署到生产环境,成为了许多开发者和企业面临的挑战。Cog应运而生,它是一款开源工具,旨在简化机器学习模型的容器化和部署过程。

Cog的核心功能

Cog的主要功能是将机器学习模型打包成标准化的、生产就绪的容器。它通过一个简单的配置文件定义环境,自动生成符合最佳实践的Docker镜像。这一过程不仅简化了传统的Dockerfile编写,还解决了许多常见的环境配置问题。

Cog的主要特点

-

简化Docker容器创建: Cog使用简单的配置文件代替复杂的Dockerfile,大大降低了容器化的门槛。

-

自动解决CUDA兼容性: Cog能够自动处理CUDA、cuDNN、PyTorch、TensorFlow和Python版本之间的兼容性问题,这是许多开发者在配置深度学习环境时常遇到的难题。

-

标准化输入输出定义: 通过Python代码定义模型的输入和输出,Cog自动生成OpenAPI schema并使用Pydantic进行验证。

-

自动生成HTTP预测服务: 基于模型的类型定义,Cog使用FastAPI动态生成RESTful HTTP API。

-

内置队列工作器: 对于长时间运行的深度学习模型或批处理任务,Cog内置了队列功能,目前支持Redis。

-

云存储支持: Cog支持直接读写Amazon S3和Google Cloud Storage的文件。

-

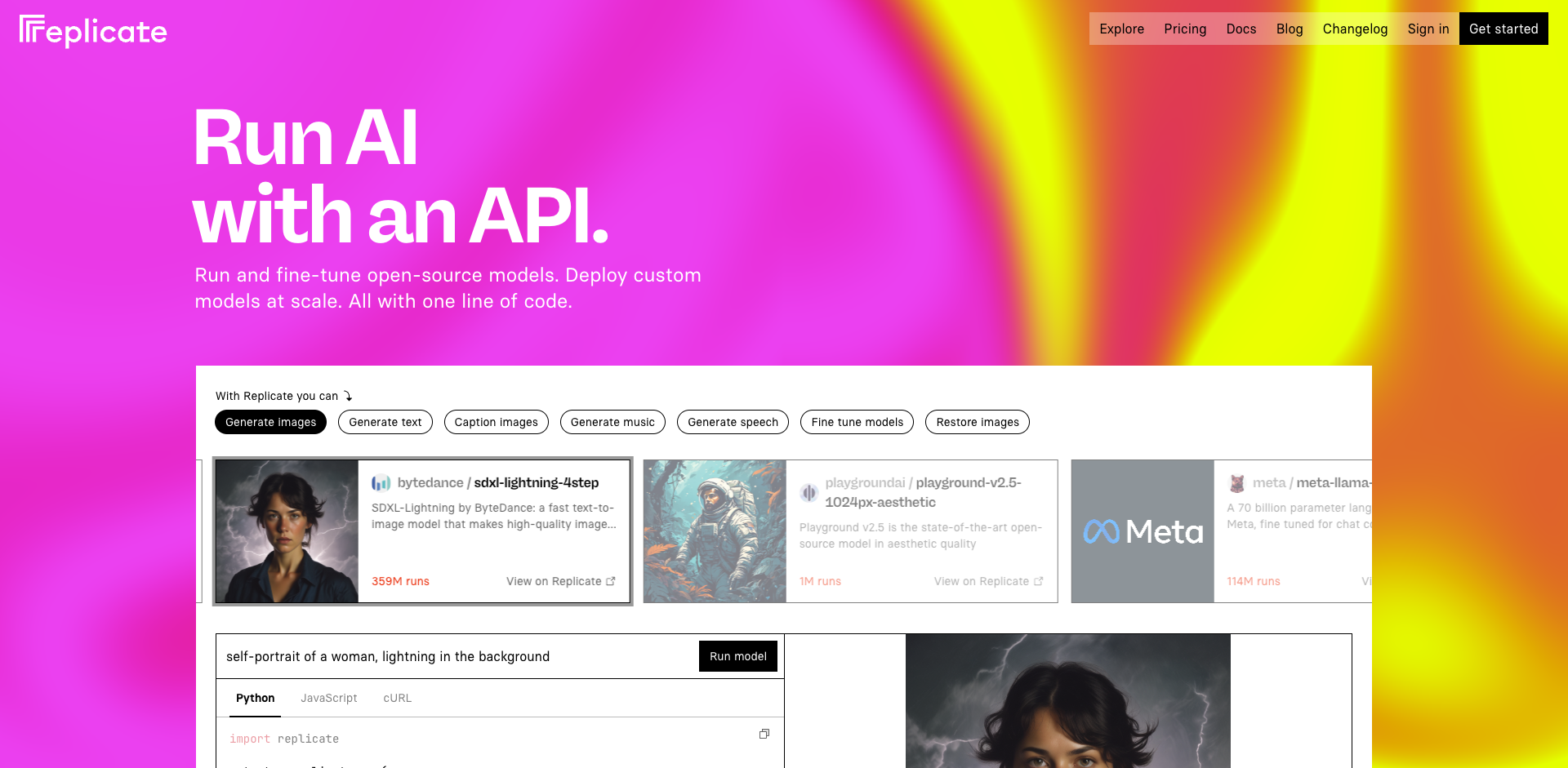

生产就绪: Cog生成的容器可以部署到任何支持Docker的环境,包括用户自己的基础设施或Replicate平台。

Cog的工作原理

Cog的核心在于其简洁而强大的配置方式。开发者只需要定义两个关键文件:

cog.yaml: 用于定义Docker环境predict.py: 用于定义预测逻辑

cog.yaml示例

build:

gpu: true

system_packages:

- "libgl1-mesa-glx"

- "libglib2.0-0"

python_version: "3.12"

python_packages:

- "torch==2.3"

predict: "predict.py:Predictor"

这个配置文件指定了GPU支持、系统包、Python版本以及所需的Python包。

predict.py示例

from cog import BasePredictor, Input, Path

import torch

class Predictor(BasePredictor):

def setup(self):

"""加载模型到内存,以提高多次预测的效率"""

self.model = torch.load("./weights.pth")

def predict(self,

image: Path = Input(description="灰度输入图像")

) -> Path:

"""运行单次预测"""

processed_image = preprocess(image)

output = self.model(processed_image)

return postprocess(output)

这个文件定义了模型的加载方式和预测逻辑。

Cog的使用场景

Cog适用于多种机器学习和深度学习场景:

-

模型部署自动化: 研究人员可以轻松将实验中的模型转化为可部署的容器。

-

标准化生产环境: 企业可以使用Cog创建统一的模型部署标准,简化DevOps流程。

-

快速原型开发: 数据科学家可以快速将模型打包并分享给团队成员或客户。

-

云服务集成: Cog生成的容器可以轻松部署到各种云平台,实现弹性扩展。

-

边缘计算部署: 由于Cog生成标准Docker容器,它们可以部署到支持容器的边缘设备上。

Cog的优势

-

降低技术门槛: Cog简化了容器化过程,使非DevOps专业人员也能轻松部署模型。

-

提高开发效率: 自动化的环境配置和依赖管理大大减少了调试时间。

-

标准化部署流程: Cog为团队提供了一致的模型部署方法,有利于协作和维护。

-

灵活性: 支持多种机器学习框架和云平台,适应不同的技术栈。

-

社区支持: 作为开源项目,Cog拥有活跃的社区,不断改进和更新。

Cog的安装和使用

安装Cog非常简单,支持多种操作系统:

- macOS用户可以通过Homebrew安装:

brew install cog

- Linux和Windows 11 (WSL 2)用户可以使用安装脚本:

curl -o /usr/local/bin/cog -L https://github.com/replicate/cog/releases/latest/download/cog_$(uname -s)_$(uname -m) chmod +x /usr/local/bin/cog

安装完成后,可以通过简单的命令来使用Cog:

1. 初始化项目:

cog init

2. 构建Docker镜像:

cog build

3. 运行预测:

cog predict -i image=@input.jpg

文章链接:www.dongaigc.com/a/cog-innovation-tool-for-machine-learning

https:.//www.dongaigc.com/a/cog-innovation-tool-for-machine-learning

790

790

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?