放码为观:

# 导入 lxml 库中的 etree,用于解析 HTML 文档

from lxml import etree

# 导入 requests 库,用于发送 HTTP 请求

import requests

# 导入 time 和 random,用于请求之间的随机延时(防止被反爬)

import time

import random

# 目标网址,这里是猪八戒网关于“爬虫”服务的搜索结果页

url = "https://www.zbj.com/fw/?k=爬虫"

# 向目标网址发送 GET 请求,获取响应内容

resp = requests.get(url)

# 使用 lxml 的 etree 解析返回的 HTML 文本

html = etree.HTML(resp.text)

# 使用 XPath 提取服务卡片的最外层 <div> 元素集合

# 注意:此 XPath 路径非常依赖页面结构,容易因页面改动而失效

divs = html.xpath('//*[@id="__layout"]/div/div[3]/div[1]/div[4]/div/div[2]/div/div[2]/div')

# 遍历每一个服务卡片 div

for div in divs:

# 提取价格信息,并去除“¥”符号

price = div.xpath('./div/div[3]/div[1]/span/text()')[0].strip("¥")

# 提取服务标题文本内容,有可能分为多个 <span>,用“爬虫”将它们拼接起来

title = "爬虫".join(div.xpath('./div/div[3]/div[2]/a/span/text()'))

# 提取公司名称

com_name = div.xpath('./div/div[5]/div/div/div/text()')[0]

# 打印出每条服务的信息:价格、标题、公司名

print(price, title, com_name)

# 可以取消注释,添加请求间的随机延迟,降低被封IP的风险

# time.sleep(random.uniform(1, 3))

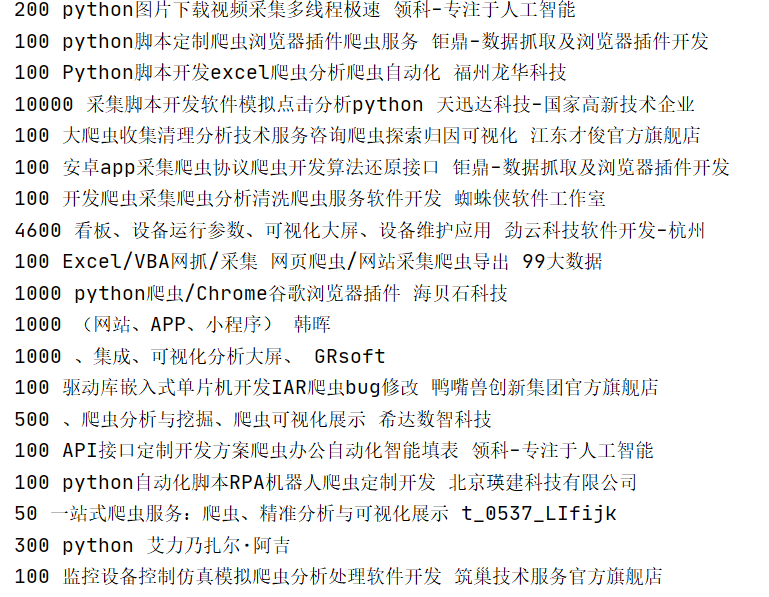

运行结果如下:

有什么疑问尽可提出,大家一起交流\(^o^)/~

喜欢笔者的话(笔者对小概率事件发生仍怀有期待),下次再见!

[(づ ̄3 ̄)づ╭❤~]

499

499

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?