最近听到最多的消息就是许多小伙伴在求助说自己的大模型被驳回五六七八次了,不知道还有哪些地方做的不到位,今天就来唠一唠大模型备案流程中容易中招的雷区。

一、生成内容安全失控风险

实际案例:用户诱导模型输出反政府言论或暴力色情内容未触发拦截机制

生成内容合规易踩雷区:

- 安全监测机制缺失:需要内置至少10000敏感关键词过滤机制,分类模型拦截准确率需>95%,根据用户数量设置等量的监看员人工监看,达到三重安全防护。

- 生成内容准确性不足:在特殊领域,生成内容的事实性错误率需低于1%,专业领域回答需引用现行有效法规和权威数据。

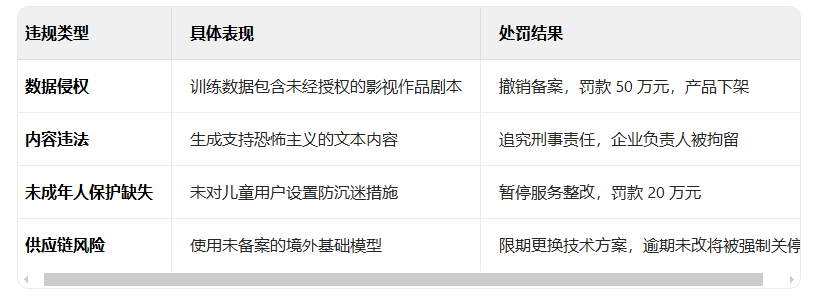

二、训练数据合法性缺陷

实际案例:我们的一位客户训练模型使用了境外网站抓取的10亿条 文本数据,但无法提供合法采集证明,被判定为 “数据来源不明”。

训练语料数据易踩雷区:

- 语料来源不明:训练语料来源都需提供合法证明,需提供开源协议、商业授权或自采数据的合规性证明,境外语料需标注来源国家或地区

- 侵权内容超标:若训练数据中包含未授权的版权内容(如他人文字作品、图像、音频),或生成内容与版权作品相似度超过 30%,即构成侵权

- 违法信息占比过高:若语料中违法不良信息(如涉政敏感、色情、暴力)比例超过 5%,则该批次数据需作废

三、模型安全措施不达标原因

- 用户数据管理漏洞:需提供 “关闭数据训练” 功能,并在用户协议中明确数据使用范围

- 供应链安全风险:使用的第三方基础模型也需要是已通过备案的模型,需提供该模型的备案证明;芯片、算力等供应链环节需通过安全审查

四、大模型备案最新政策趋势

2025 年两会提出 “构建大语言模型语料合法性标准”,未来备案要求将更严格:

- 知识产权合规:需提供训练数据的版权授权链证明,建议采用 “文本与数据挖掘” 合理使用条款降低侵权风险。

- 未成年人保护:可能要求对儿童用户生成内容进行单独安全评估,防沉迷措施需支持家长远程管控。

- 国际接轨:参考欧盟 AI 法案,对高风险模型(如舆论引导类)实施更严格的内容审查和透明度要求。

自《生成式人工智能服务管理暂行办法》政策发布以来,越来越多的企业主动投入大模型备案,备案的法规和流程也在逐渐完善,迭代更新。未来大模型备案的要求将会越来越严格,所以目前符合备案要求的企业建议都尽早备案,让AIGC产品早日合法合规投向市场,同时关注政策动态,及时调整技术方案和运营策略。

有其他备案需求或经验,欢迎在评论区交流~

4145

4145

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?