家人们谁懂啊!还在为小样本论文没创新点emo?这个王炸组合你必须知道——当贝叶斯玄学遇上小样本困境,直接开启学术开挂模式!🔥

为什么必追?

✅ 顶会狂魔:TPAMI/ICLR/NeurIPS霸榜常客,论文过稿率UP↑

✅ 过拟合终结者:5个样本也能训出超强鲁棒性(医学影像实测有效)

✅ 知识融合术:把临床经验当"外挂"加载,罕见病诊断直接拿捏

✅ 推理加速器:最新变分推断法让计算效率飙升300%

举个栗子🌰:新冠变异株检测数据不够?贝叶斯框架直接调用病毒进化树知识,3张CT图就能训出SOTA模型!(顶会审稿人看了都说绝)

💡 笔者爆肝整理8套小样本学习+贝叶斯创新方案(附源码+顶会范文),从元学习贝叶斯到神经过程网络,从医疗到遥感全覆盖,有需要的同学有需要的同学 工棕号【AI因斯坦】回复 “8小样本学习+贝叶斯” 即可领取。

Bayesian Embeddings for Few-Shot Open WorldRecognition

文章解析

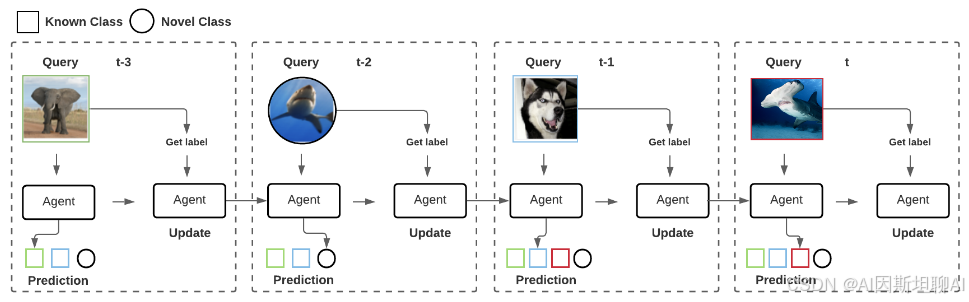

文章的核心内容是提出了一种名为FLOWR的框架,旨在将机器学习系统从封闭世界设定扩展到开放世界和少量样本的学习场景中。该框架结合了贝叶斯非参数类先验和基于嵌入的预训练方案,通过高斯嵌入和中国餐馆过程(CRP)类先验,实现了对新类别的有效检测和快速学习。

Revisiting Logistic-softmax Likelihood in Bayesian Meta-learning for Few-shot Classification

文章解析

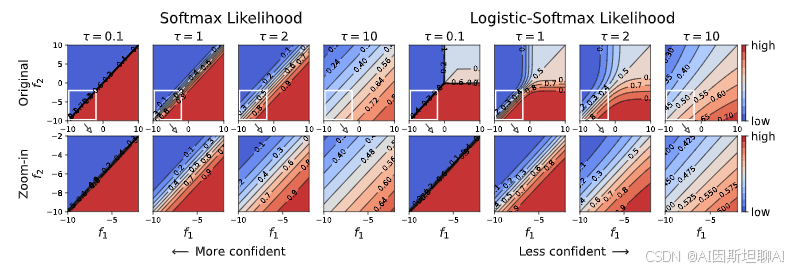

文章重新审视并重新设计了贝叶斯元学习中用于少样本分类的Logistic-softmax似然函数,通过引入温度参数来控制先验置信水平,解决了其固有的不确定性问题。研究还从理论上和实证上证明了softmax可以视为Logistic-softmax的特例,并且Logistic-softmax能够诱导出比softmax更大的数据分布族。此外,文章将改进后的Logistic-softmax似然函数应用于基于深度核的高斯过程元学习框架,并推导出针对特定任务更新的解析平均场近似。

Cross-Modal Alignment Learning for Few-Shot Out-of-Distribution Generalization

文章解析

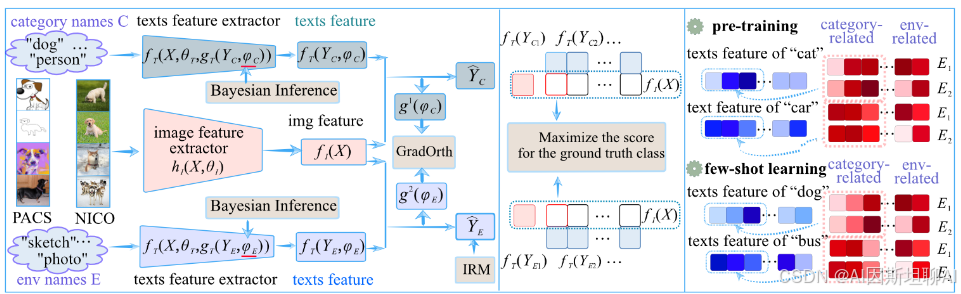

本文提出了一种新颖的贝叶斯跨模态图像-文本对齐学习方法,旨在解决少量样本学习中模型在二维分布外数据上的泛化问题。该方法仅通过贝叶斯建模方法微调文本表示,并引入梯度正交化损失和不变风险最小化(IRM)损失,以避免过拟合训练中观察到的基础类别,并改善对更广泛未见类别的泛化能力,同时通过专门的损失函数实现更好的图像-文本对齐,分离图像特征的因果和非因果部分。

Make Prompts Adaptable: Bayesian Modeling for Vision-Language Prompt Learning with Data-Dependent Prior

文章解析

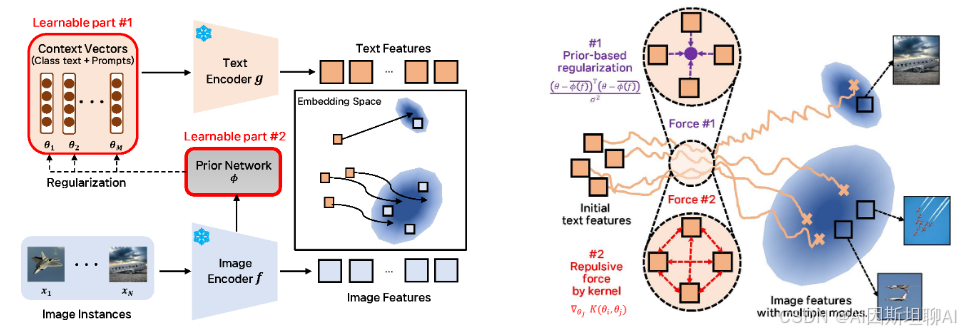

提出了一个基于贝叶斯框架的视觉-语言提示学习方法,通过建模数据依赖的先验来增强文本特征的适应性,使其能够适应已见和未见的图像特征,且不会在二者性能间产生权衡。该方法利用Wasserstein梯度流估计目标后验分布,使提示能够灵活捕捉图像特征的复杂模式,在少量样本学习场景下可缓解过拟合问题,提高提示在未观察实例上的适应性,实验表明其在多个基准数据集上相较于现有方法有显著性能提升。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?