即使设计再完善的AI伦理机制,在真实环境中也无法避免遭遇边界情境、极端突发、信息不对称等复杂因素带来的失效风险。尤其在高动态、多变量的城市低空经济环境中,AI调度系统面对不可预见事件时,往往会表现出伦理判断模糊、决策路径异常甚至安全责任模糊的现象。本章试图系统梳理AI伦理机制可能面临的五大类失效类型,结合现实案例与系统设计建议,提出“伦理回退机制”“紧急干预协议(EIP)”“伦理责任回溯链”三大工具,并构建面向未来的“伦理稳态系统”蓝图。

一、伦理失效的五类典型情境

1.1 算法偏置放大:伦理评分模型在接受长期任务训练后逐步“刻板化”,如在多次医疗任务判定中,对郊区医院路径持续赋予较低优先权,形成“系统性边缘化”。

1.2 模型空窗阶段:在任务爆发瞬间(如地震、暴雨、冲突区事件),系统伦理模型因缺乏案例参考而进入决策“空白带”,表现为任务拒绝、路径冻结、调度无响应等异常行为。

1.3 多伦理目标冲突:典型如“保护隐私”与“提升响应效率”出现矛盾时,AI系统可能因缺乏优先级设定而陷入迭代冲突,导致伦理判断模块自锁。

1.4 算法劫持与规则绕过:黑客可通过中间件注入虚假路径或修改评分接口,使高敏感任务“伪装”为低风险,绕过伦理审核机制,形成“系统被驯化”风险。

1.5 人类监管缺位:伦理干预权限未明确分配,导致一线任务人员面对伦理异常无法有效介入或申诉,系统行为缺乏社会正当性支撑。

二、伦理回退机制的设计原则

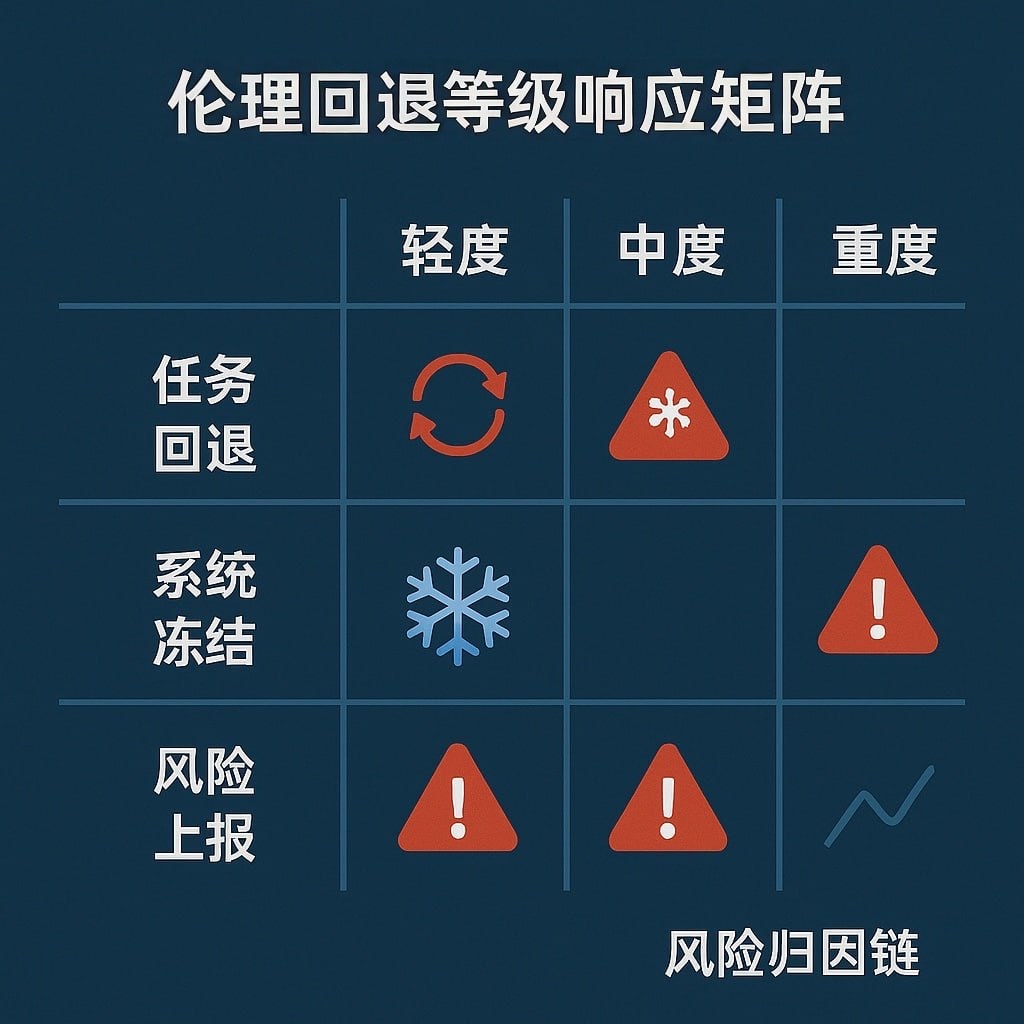

2.1 构建分级回退响应矩阵:将伦理冲突划分为三级(低风险冲突、重大权衡矛盾、极端伦理崩溃),分别对应三种系统响应:路径重新规划 → 人工审核介入 → 系统冻结与审查上报。

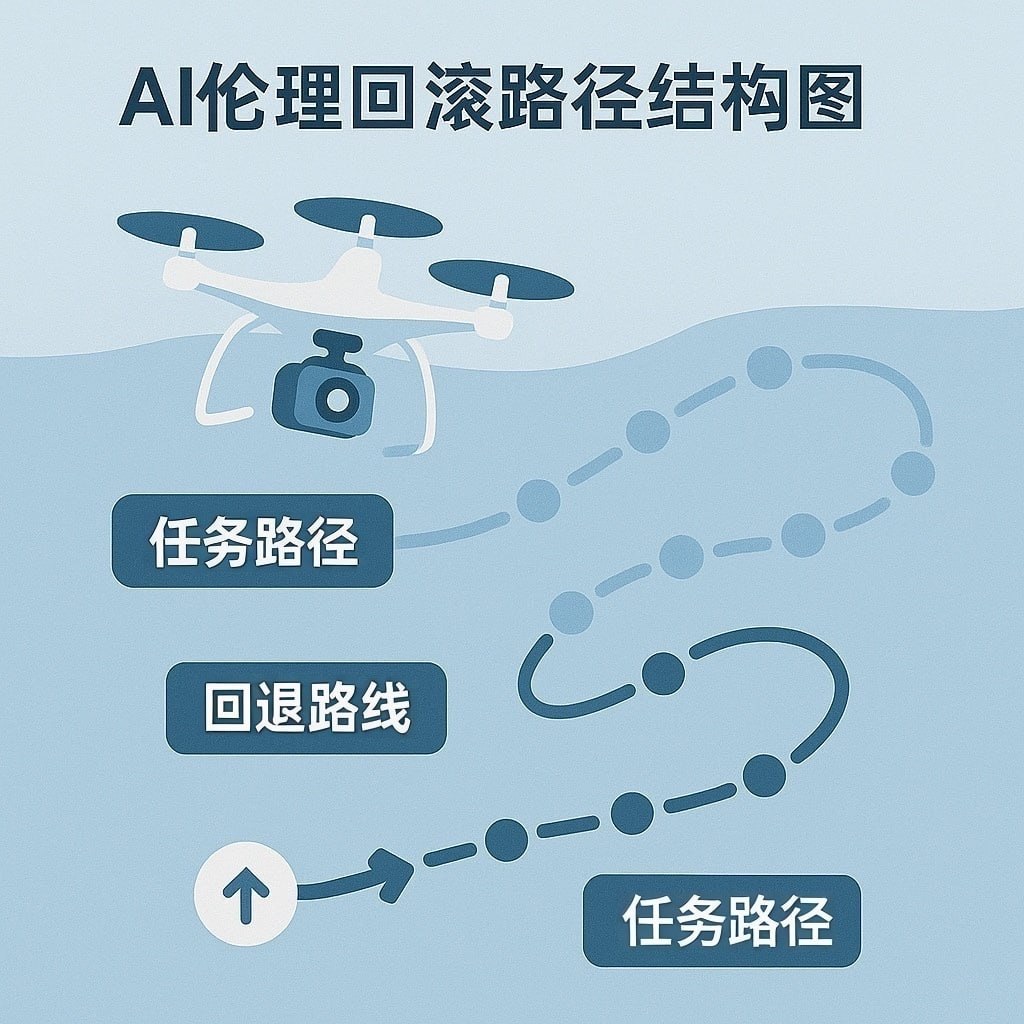

2.2 嵌入“可回滚路径”:所有任务路径在生成阶段即设计“伦理回滚路线”,确保在系统判断失效或伦理争议爆发时,AI可自动转向风险最小化路径运行或中止。

2.3 引入“伦理判定缓存机制”:对每一个高风险任务保留伦理评分缓存,一旦主评分机制出错,可从缓存中恢复最近一次安全有效判断逻辑。

三、紧急伦理干预协议(EIP)机制详解

3.1 EIP触发逻辑:当AI行为触发伦理冲突阈值(如违反最小伤害原则、接近禁区、未经授权采集敏感数据),由系统伦理感知模块或外部审计系统发出“伦理冻结信号”。

3.2 权限分级图谱:建立“伦理干预权结构图”:一级为自动终止;二级由伦理值守节点(如城管AI、空域安防系统)确认;三级由地方监管机关人工批准。

3.3 响应链路闭环:EIP启动后,系统进入“冻结-记录-回传-重评”四步处置链,并禁止调度系统自动重启,直到伦理审查机制明确解除锁定。

四、伦理责任回溯链与归因机制

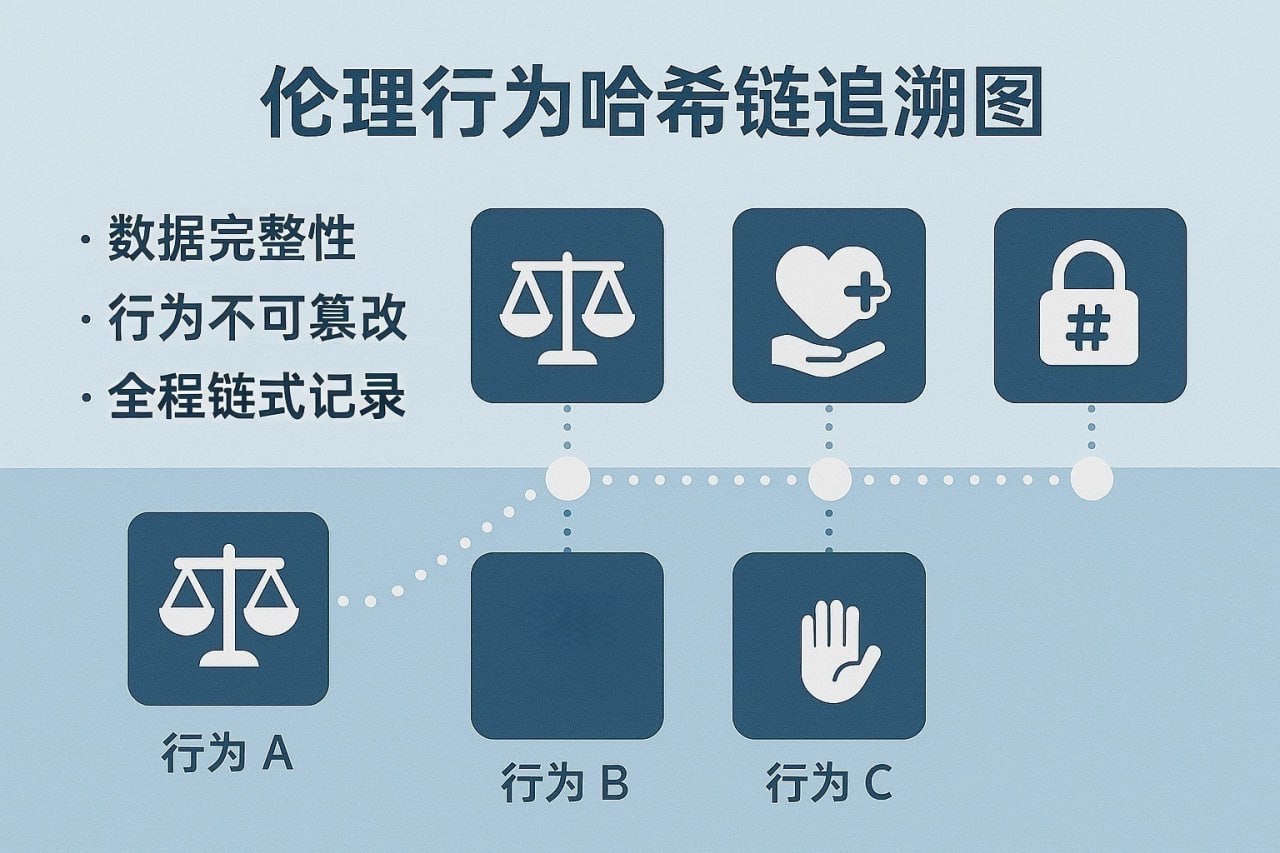

4.1 构建任务行为追溯图谱:记录AI每一个关键行为节点的“输入决策参数—伦理评分来源—模型版本—执行反馈”;如有事故发生,可据此展开多层责任归因。

4.2 引入“伦理行为哈希链”:每一次调度伦理判断生成唯一哈希编号,保证其不可篡改性与跨平台可验证性。

4.3 人机协作式归因机制:在伦理失效事件后,由AI生成行为溯源初稿,人类复核并结合社会价值观完成“最终责任图谱”。

结语

城市空域不是试验田,而是现实社会的一部分。伦理失败并不可怕,可怕的是无可追溯、无从修复的系统崩塌。睿途在构建AI调度系统时,坚持将“伦理容错性”作为技术底线,并通过制度化回退机制与开放式监督系统,不断提升平台的伦理韧性。真正可信的AI系统,不是从不出错,而是始终能正确面对错误。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?