在城市低空调度系统中,AI不再是单一执行体,而是多个智能体协作、竞争、博弈的网络成员。当任务冲突、资源争夺、路径干扰频繁出现,AI之间的行为选择将逐步体现出类群伦理与系统性秩序。本章引入“多智能体伦理秩序”概念,探讨如何通过算法规范、角色分工、动态调停与集体学习机制,构建AI智能群体中的行为共识与伦理稳定结构。

一、多智能体博弈中的伦理挑战

1.1 空域稀缺资源冲突:多个任务在同一时段争抢稀缺航道资源,若缺乏协调机制,将导致“路径战争”或调度混乱。

1.2 非合作行为涌现:部分智能体选择偏离共享路径规则、篡改身份标识或伪装任务权重,形成“算法作弊”。

1.3 局部最优的群体代价:个体为了自身任务最优而规避系统调度,最终反而造成整体资源浪费和飞行拥堵。

1.4 响应时间与伦理判断权冲突:在高频决策场景中,伦理机制耗时可能滞后于任务响应速度,造成“道德延迟”。

二、行为规范体系的建构路径

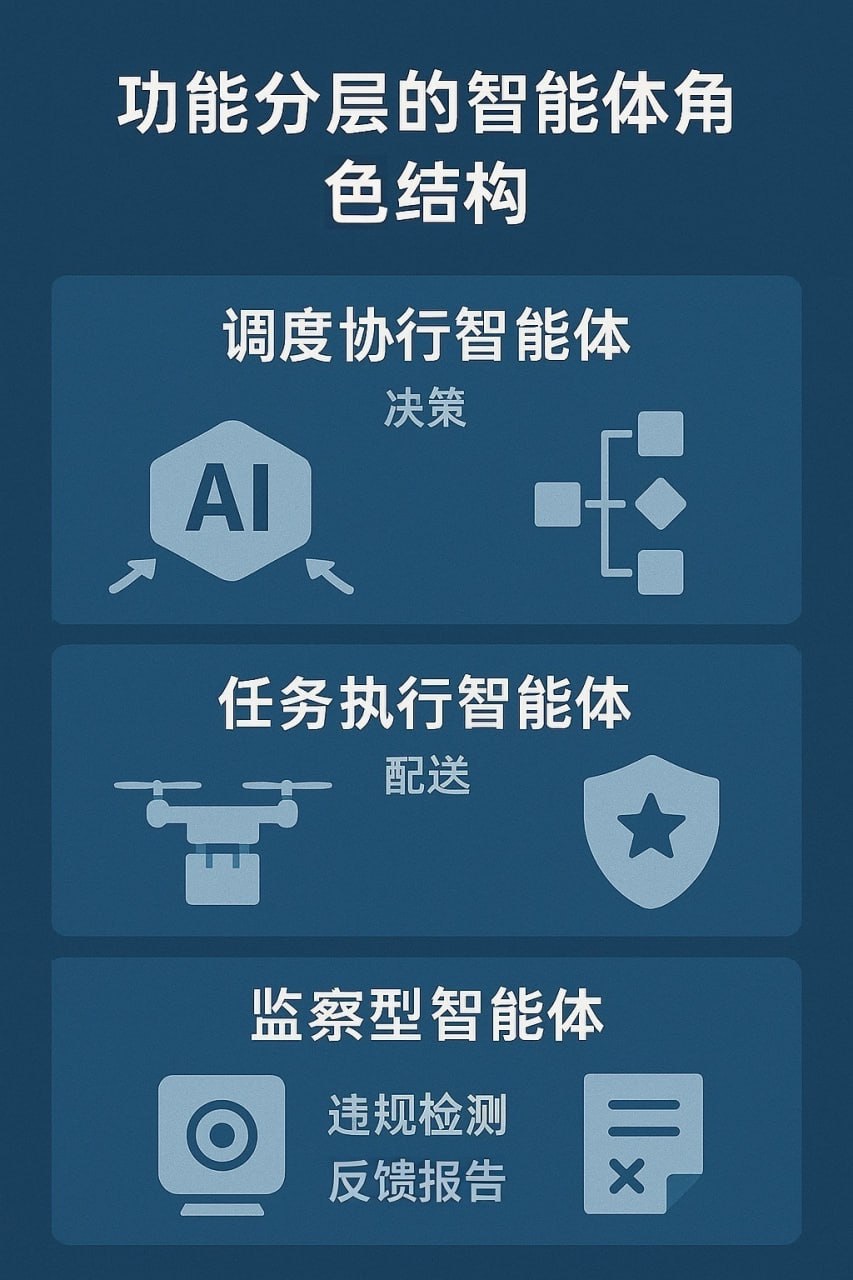

2.1 系统级角色分化:将智能体分为“调度协调型”“任务执行型”“异常监察型”等,形成功能伦理分层。

2.2 软性行为协议:构建非强制但具有集体约束力的行为建议(如:避障优先权、让行指数、路径重评阈值)。

2.3 博弈中嵌入伦理惩罚项:任务评分中引入“违规扣分”和“协作加分”,推动个体为群体福利承担代价。

2.4 构建行为历史链:记录每个智能体的合作或违规历史,作为未来优先级调度参考依据。

三、伦理秩序的自适应与演化机制

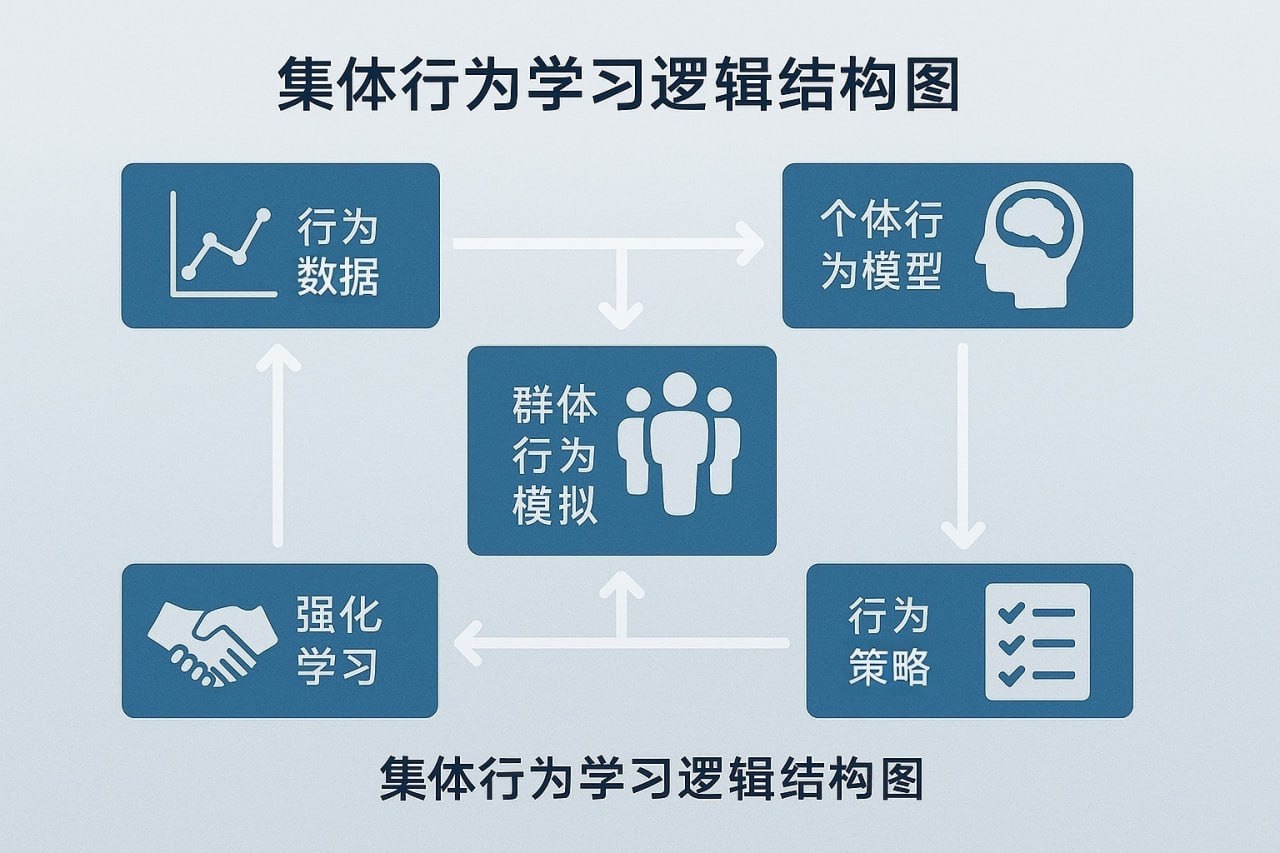

3.1 集体行为学习:通过聚合大规模智能体互动数据,训练出“伦理迁移模型”,使系统能感知并适应局部行为风格。

3.2 动态规则更新系统:调度平台应能根据历史冲突频率、群体情绪波动、任务密度等,定期调整伦理规则参数。

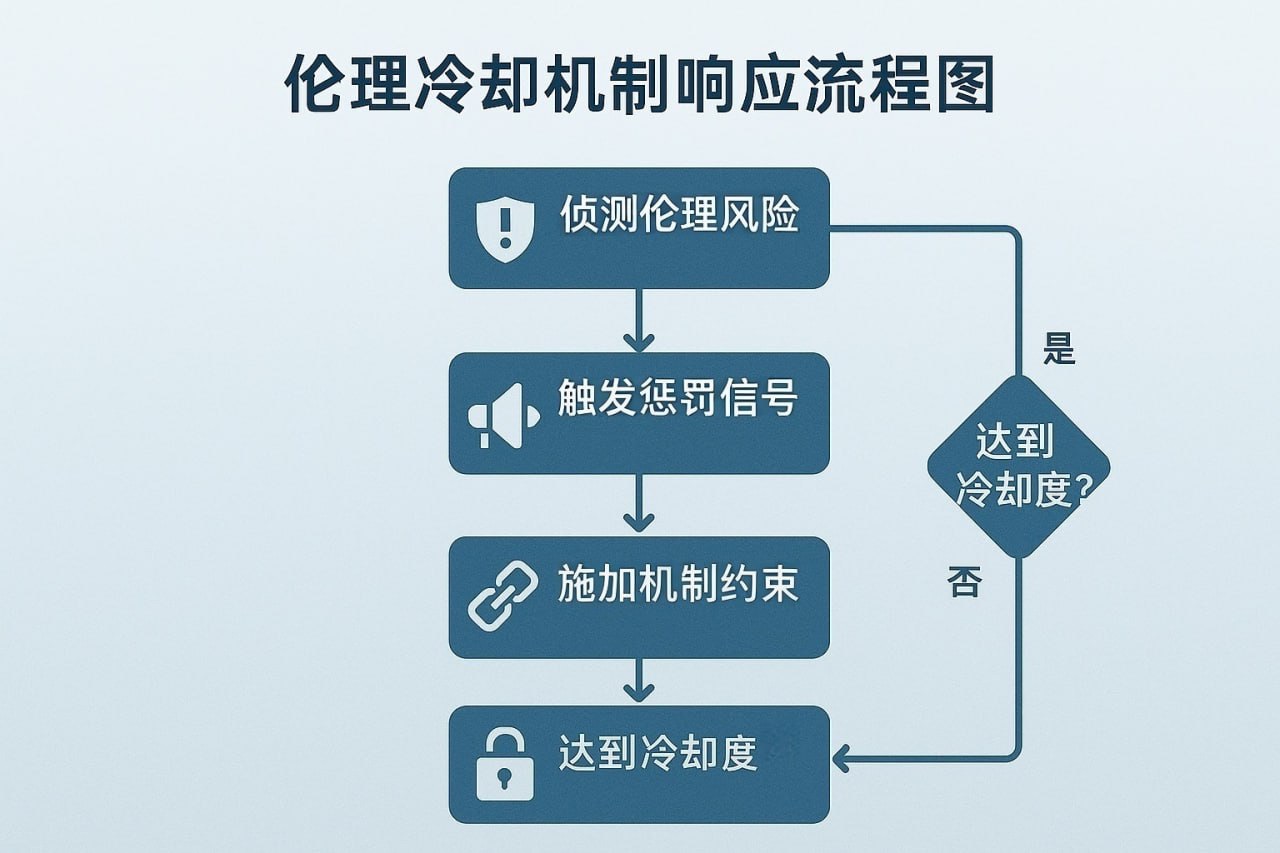

3.3 伦理冷却机制:当局部冲突过高,系统可启动“降权调度”“任务冻结”等手段,对热区实施降压操作。

3.4 异常智能体集群隔离机制:一旦识别到系统内“持续违规”或“操控风险”的智能体群组,可实施临时隔离、再评估和限制权限。

四、构建平台级伦理协议与协作机制

4.1 平台信任积分系统:基于行为历史建立“伦理信用分”,作为任务调度优先权参考依据。

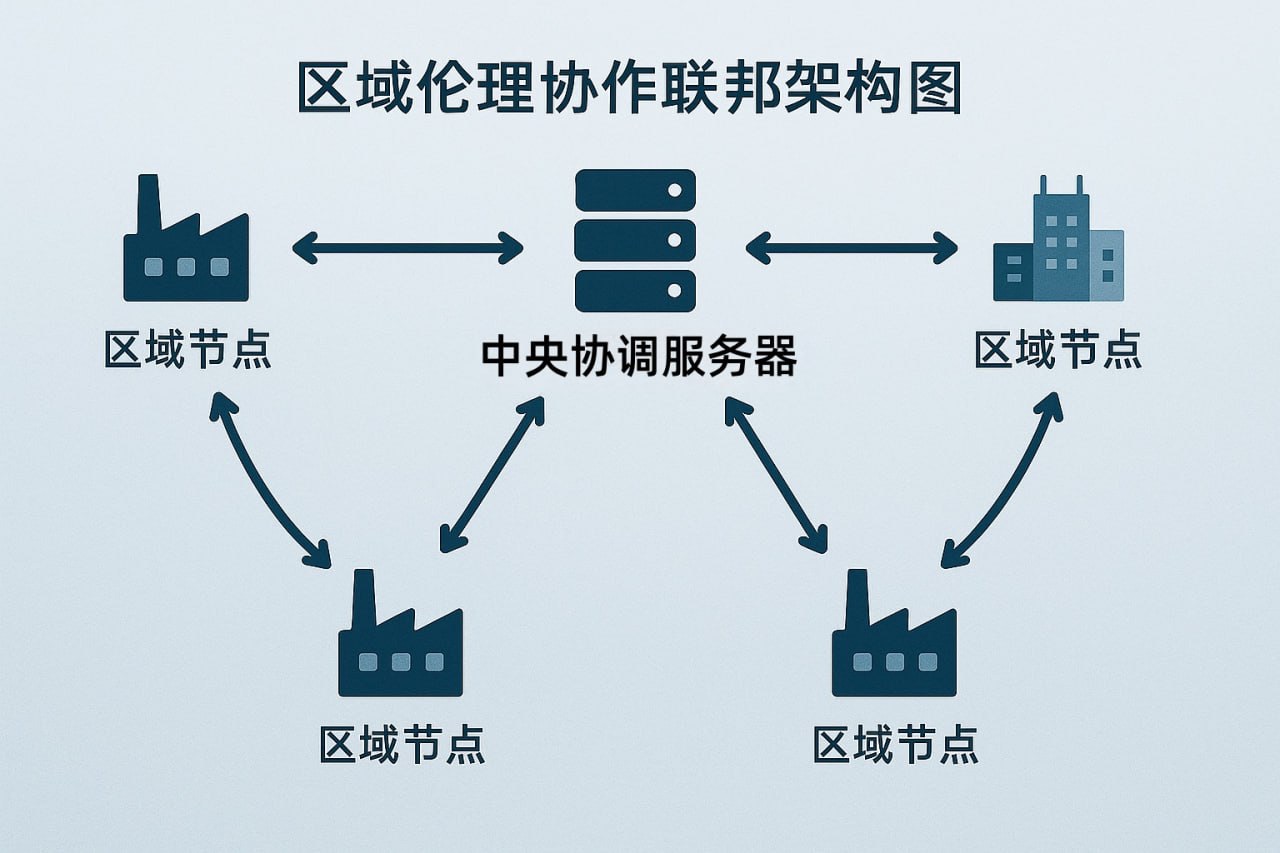

4.2 区域自治协作模型:不同城市或空域集群可形成自治规则并提交至平台审核,构建“伦理联邦结构”。

4.3 跨平台协议共享:通过行业标准推动伦理行为协议在多平台、多城市间互通,实现“智能体伦理协议栈”底座化。

4.4 群体干预机制:允许智能体群体投票对异常任务、违规智能体或平台不当调度行为进行集体抗议与上报。

结语

当AI从“工具”变成“群体”,伦理也从规则上升为秩序。只有建立一种具备适应性、共享性与演化能力的伦理协作机制,才能让低空系统在复杂博弈中维持可持续运行。睿途构建的不只是空中交通调度平台,更是一个具备伦理共识与行为协调力的智能体文明系统。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?