——构建具备长期约束力的算法治理基础法体系

摘要

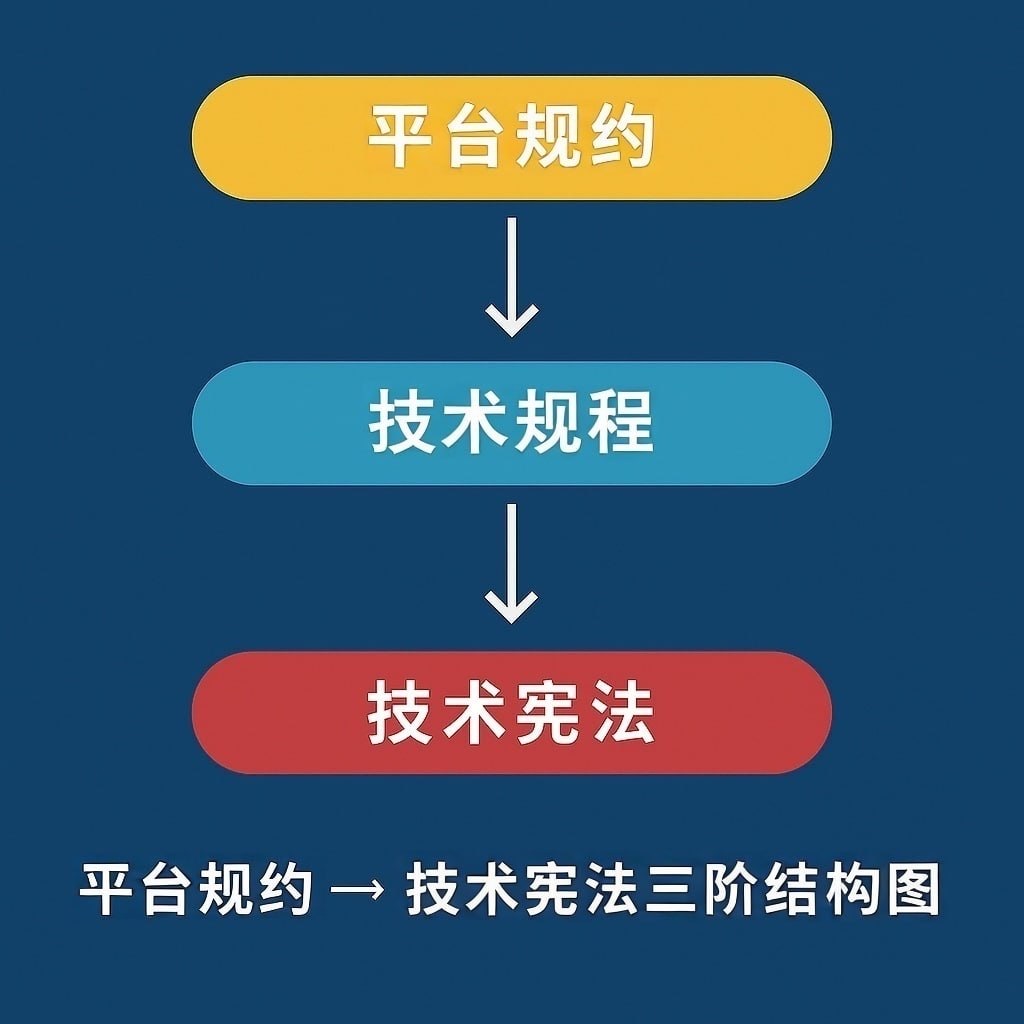

过去的AI治理主要依托“平台规约”或“行业准则”,但在技术演化速度远超制度更新的背景下,这种“柔性合规”模式已难以约束深度算法自治系统。本章提出“技术宪法”概念,主张AI系统的运行必须内嵌一套可审查、可升级、可继承的伦理制度结构。以算法约束机制、AI权力结构、协商修宪机制为核心,构建一个由“底层规则 + 协议协议 + 宪法裁定”组成的三阶治理结构,实现AI从“可控”走向“自约”。

一、平台规约的困境与限制

1.1 柔性治理机制的边界

- 平台用户协议、数据政策、行为守则普遍缺乏可执行力;

- 面对算法模型、自动决策系统,其“规约性文字”无法被程序调用与约束。

1.2 伦理原则的“挂名化”问题

- 伦理被写进PPT,但未进入算法结构;

- 决策过程缺乏“伦理约束计算模块”嵌入,实际运行中无制动机制。

二、行业级AI治理宪章的雏形

2.1 行业共识的生成与发布

- 例如:2024《AI治理深圳协同协议》《城市算法责任声明书》等;

- 多数仍为“倡议型文件”,非强制性,不具备法源地位。

2.2 行业伦理治理图谱构建

- 内容包含:数据来源合法性 → 模型可解释性 → 决策透明度 → 责任归因路径 → 用户反馈响应机制;

- 拟以“治理五权”:设模权、部署权、使用权、废止权、审查权来赋能公共参与。

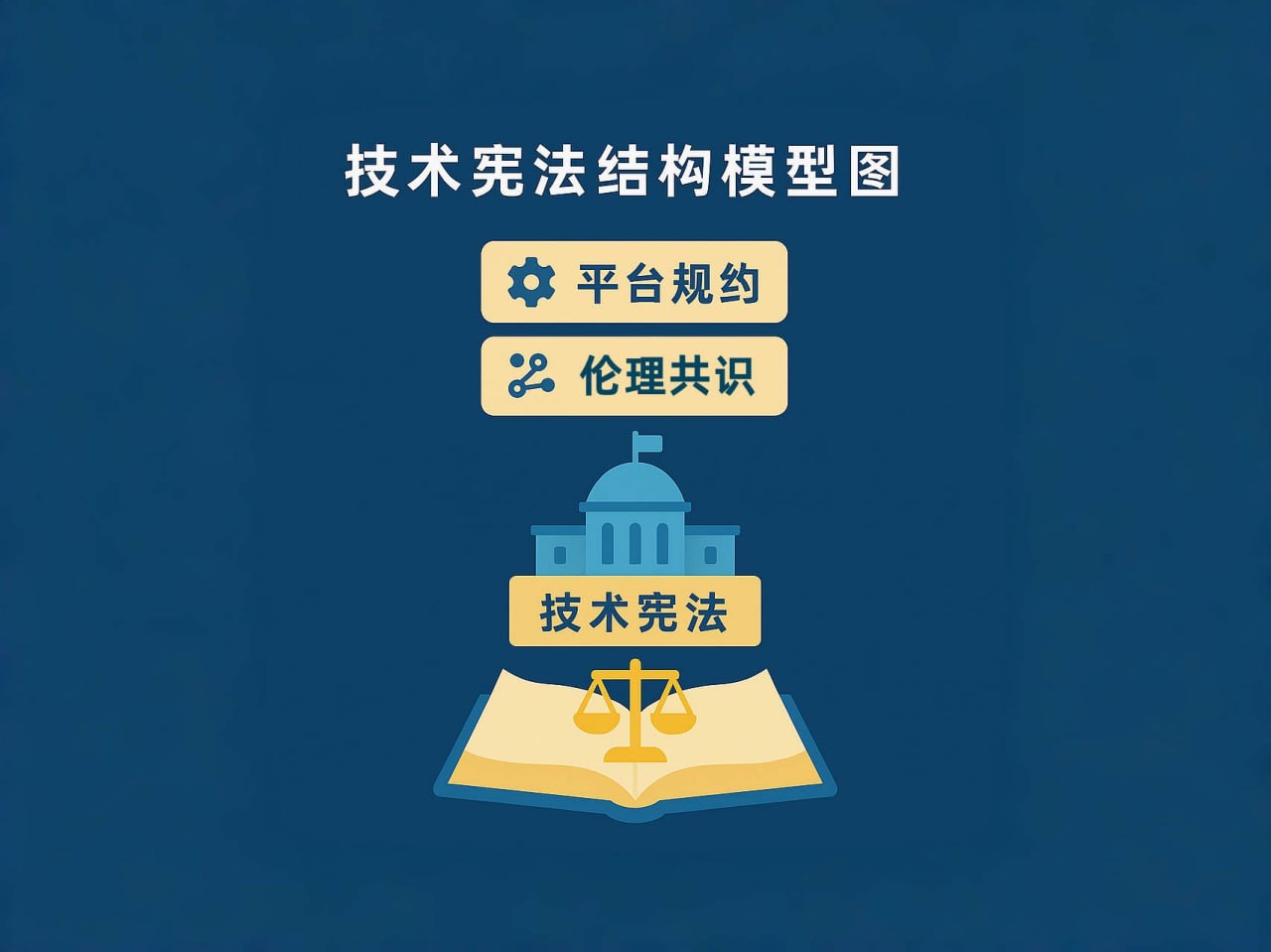

三、技术宪法的制度构想

3.1 技术宪法定义

- 技术宪法指的是:内嵌于技术系统本身、具备高级优先级与可追溯机制的伦理治理结构;

- 它不仅约束人,还约束算法行为与模型演化路径。

3.2 三阶结构模型

基础协议层:API规范、安全权限、数据处理约束,执行机制为自动校验器 / SDK内嵌合规模块

治理协定层:平台行为规范、运营逻辑、异常处置,执行机制为平台治理委员会 + 模型调度系统

技术宪法层:算法权力结构、责任签名制度、修宪机制,执行机制为嵌入式规则解析器 + 合规守门逻辑器

四、AI“权力结构”的制度再设计

4.1 算法不可滥权原则

- 明确AI模型不得越权执行“高伦理敏感度决策”(如启用紧急驱逐、触发平台级惩罚);

- 此类行为需附加“伦理二次验证”机制。

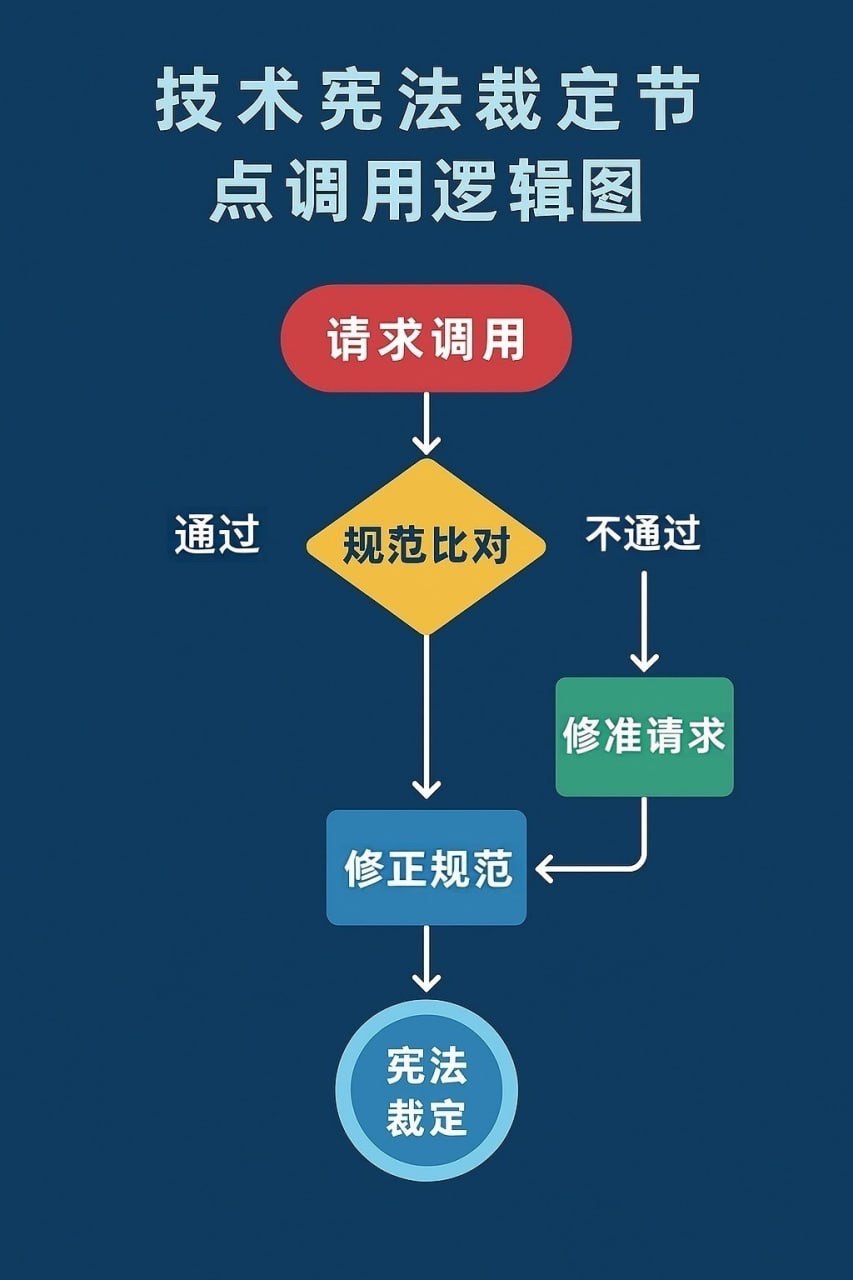

4.2 建立技术宪法裁定节点

- 所有“高等级模型行为”触发时,需由“技术宪法裁定引擎”判断其是否合规;

- 类似数字时代的“伦理法院”或“决策合法性仲裁器”。

五、结语:把规则写进代码,把伦理写成底层法

平台规约是指导,行业宪章是倡议,而技术宪法才是不依赖人治、能持续约束的算法治理根基。我们不能靠平台意志绑定AI伦理,而应靠代码层的制度嵌入,让伦理不是一种提醒,而是一种权限——能触发系统行为、阻止不当决策、形成自动问责。这,才是AI进入社会后真正需要承担的公共制度责任。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?