——后平台时代的治理想象与责任协商

摘要

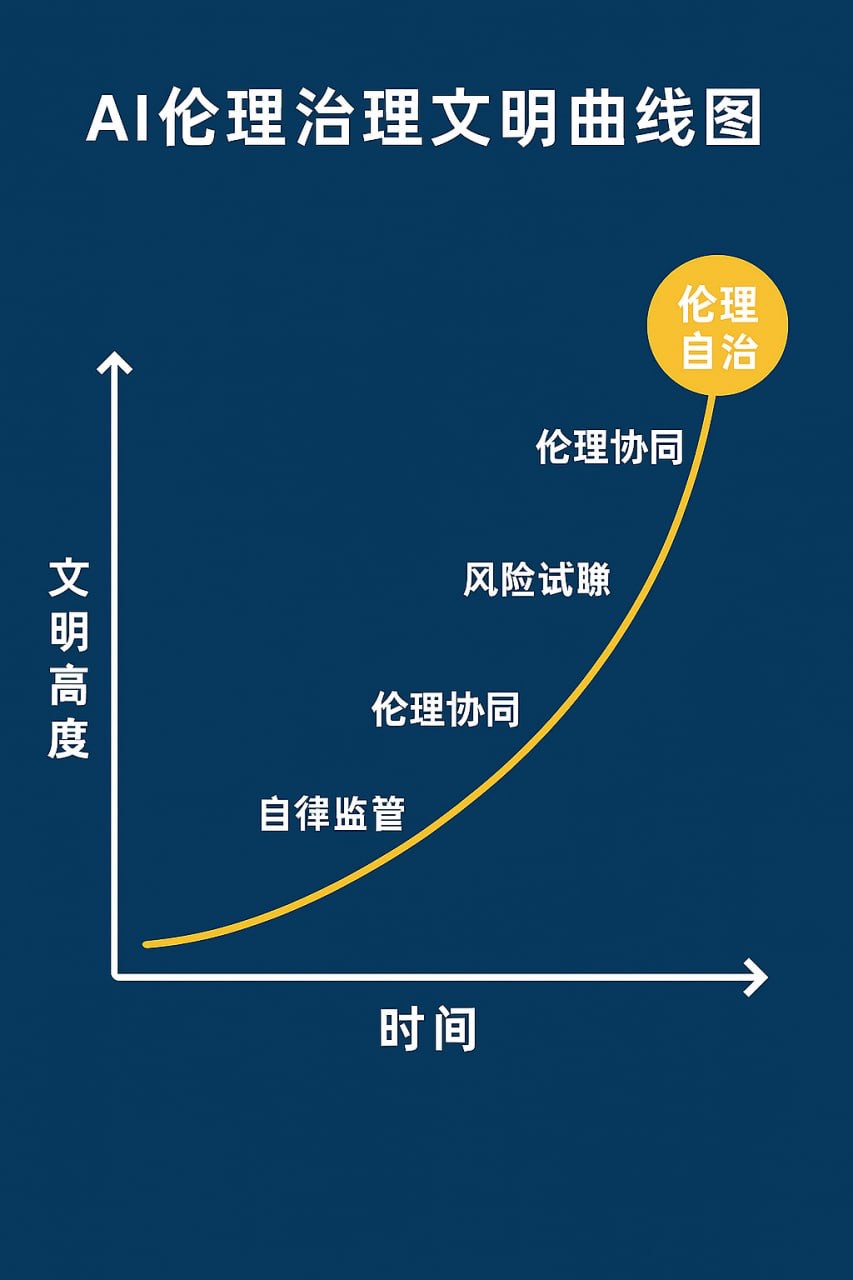

AI不是独立存在的技术,它始终嵌入人类社会的结构之中。算法的每一次决策、模型的每一项演化,背后都承载着治理者的意图、数据的偏见与权力的流动。《睿途AI伦理治理》提出了一套立足低空平台、逐步构建平台规约、行业协议、技术宪法到伦理共识的治理路径,但这只是开始。本章将从全球演化趋势、制度变革视角与人类文明反思三重视角出发,回应一个核心问题:当AI继续进化,我们如何不失去伦理的锚点?

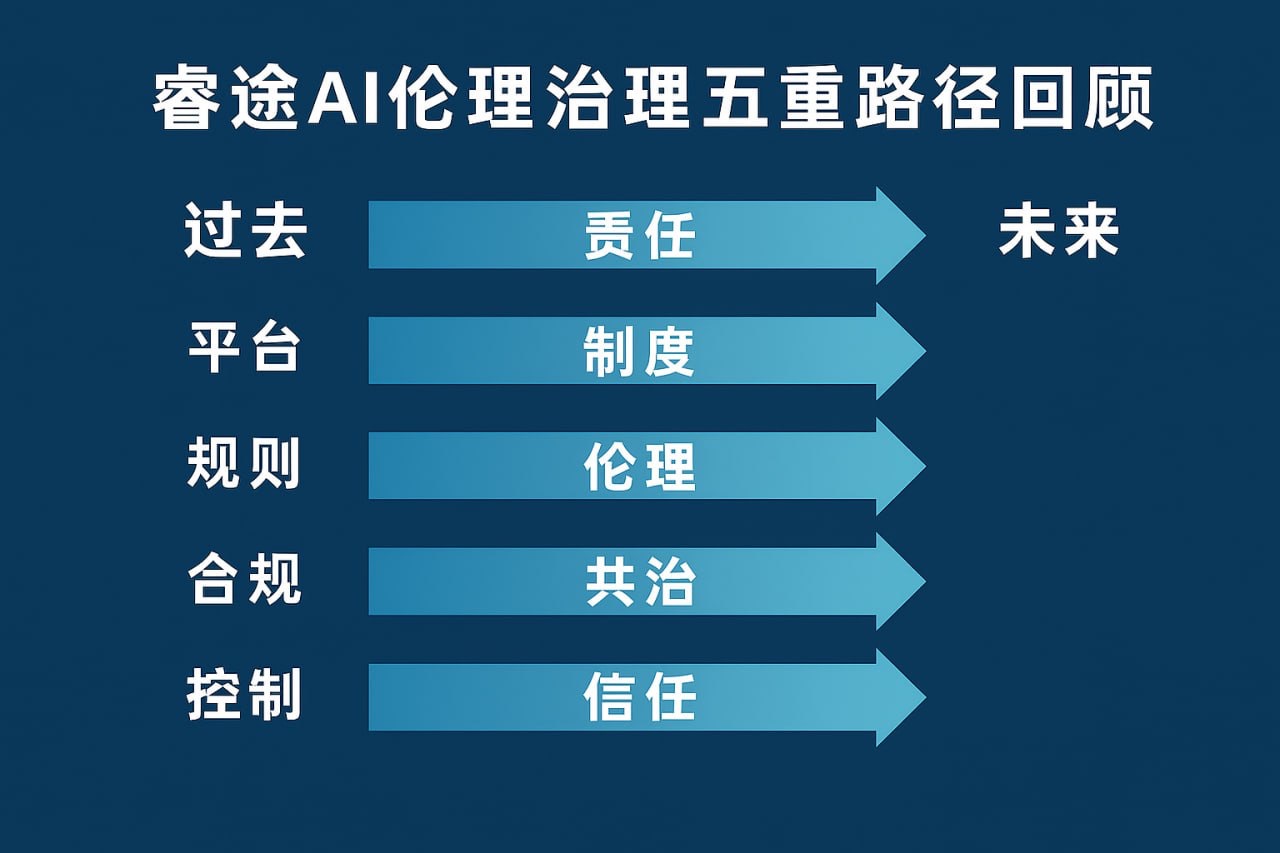

一、回顾:我们走过的五重路径

1.1 从平台到责任

- 从滴滴式平台调度系统,到飞控芯片任务匹配的算法自治系统,责任的归属结构不断重构;

- 我们见证了“系统中立”幻象的破裂,转向“行为归因”的技术伦理体系。

1.2 从规则到制度

- 平台规约变成行业倡议,再变成“技术宪法”;

- 治理的对象不再只是人类用户,而是算法本身的行为边界与权限结构。

1.3 从合规到伦理

- 合规是底线,伦理是方向;

- 睿途提出伦理沙盒、行为审计链、算法签名机制等,是从“是否可以做”,走向“是否应该做”。

1.4 从封闭到共治

- 引入居民协审、AI市民大会、城市伦理共识议程;

- 政府不再是唯一裁判,用户、技术者、平台和监管方共同参与治理。

1.5 从控制到信任

- 真正的治理不是压制技术,而是让它值得信任地存在;

- 信任的基础是:可解释、可预测、可复盘、可介入。

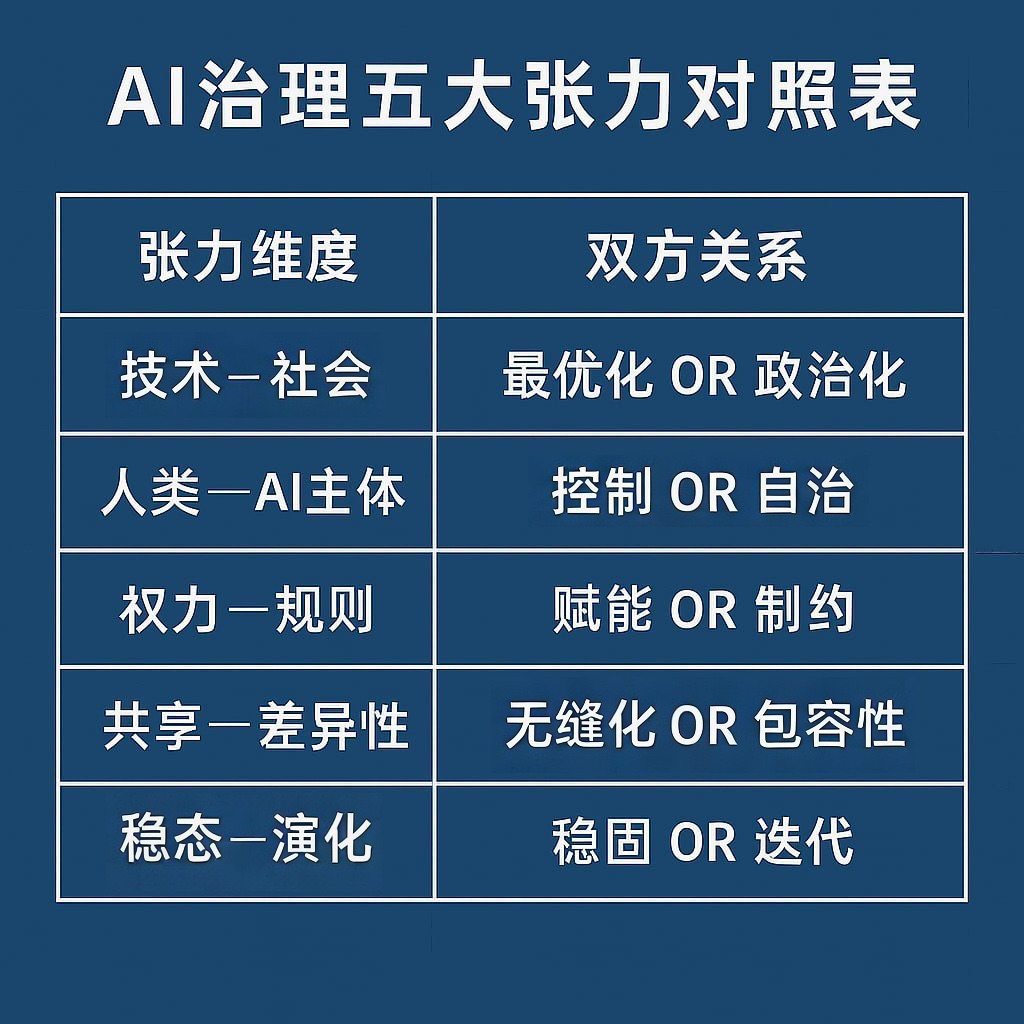

二、反思:全球AI治理面临的五大张力

技术速度 vs 制度滞后

- AI升级周期以月计,法律修订周期以年计

算法集中 vs 权力分散

- 算法在巨头平台控制中,治理要求跨平台协作

国家治理 vs 全球共识

- 不同文化对“伦理”定义不同,技术边界却跨国无形

数据驱动 vs 主体缺位

- 算法依赖大数据,用户无感、无权

行为自主 vs 责任断裂

- 多智能体系统决策高度独立,归责路径不透明、不完整

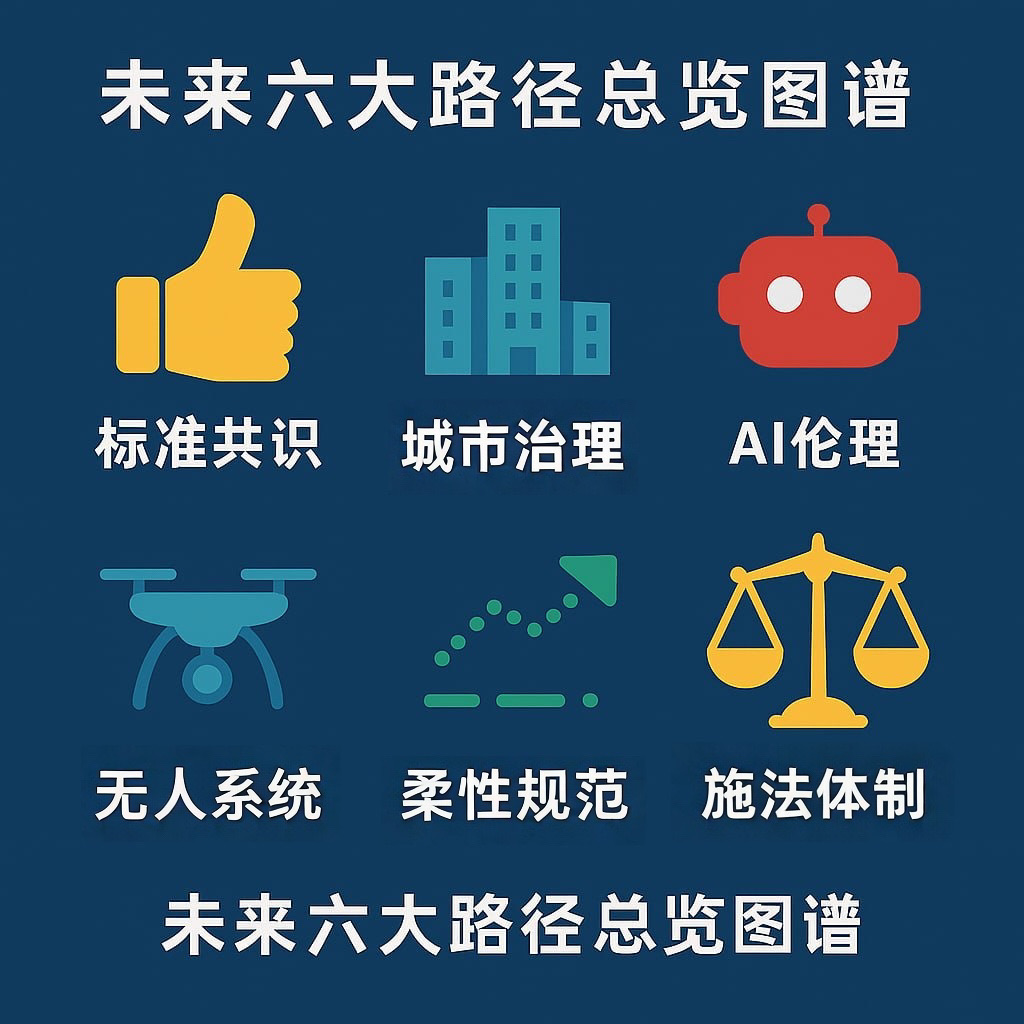

三、前瞻:未来AI伦理治理的六条可能路径

3.1 技术嵌法(Code-as-Law)的深化

- 把合规、责任、伦理结构写进代码底层,不只是规则指南,而是机制本身;

- 每一段AI决策调用链,内嵌伦理触发器、责任签名与异常审计。

3.2 AI责任链全球化标准

- 推动跨国AI责任锚定协议,如“行为审计链通用格式”“算法责任签名国际草约”等;

- 类似于“数字时代的日内瓦公约”。

3.3 多智能体协商治理系统

- 多个AI系统间的“自治协商机制”替代单点人工监管;

- 如空中城市调度中,AI系统对算法行为进行互审与判断。

3.4 城市级伦理接口平台

- 每个城市拥有一套与AI系统对接的“伦理反馈操作系统”;

- 市民可上传异议、投票暂停、参与标准制定。

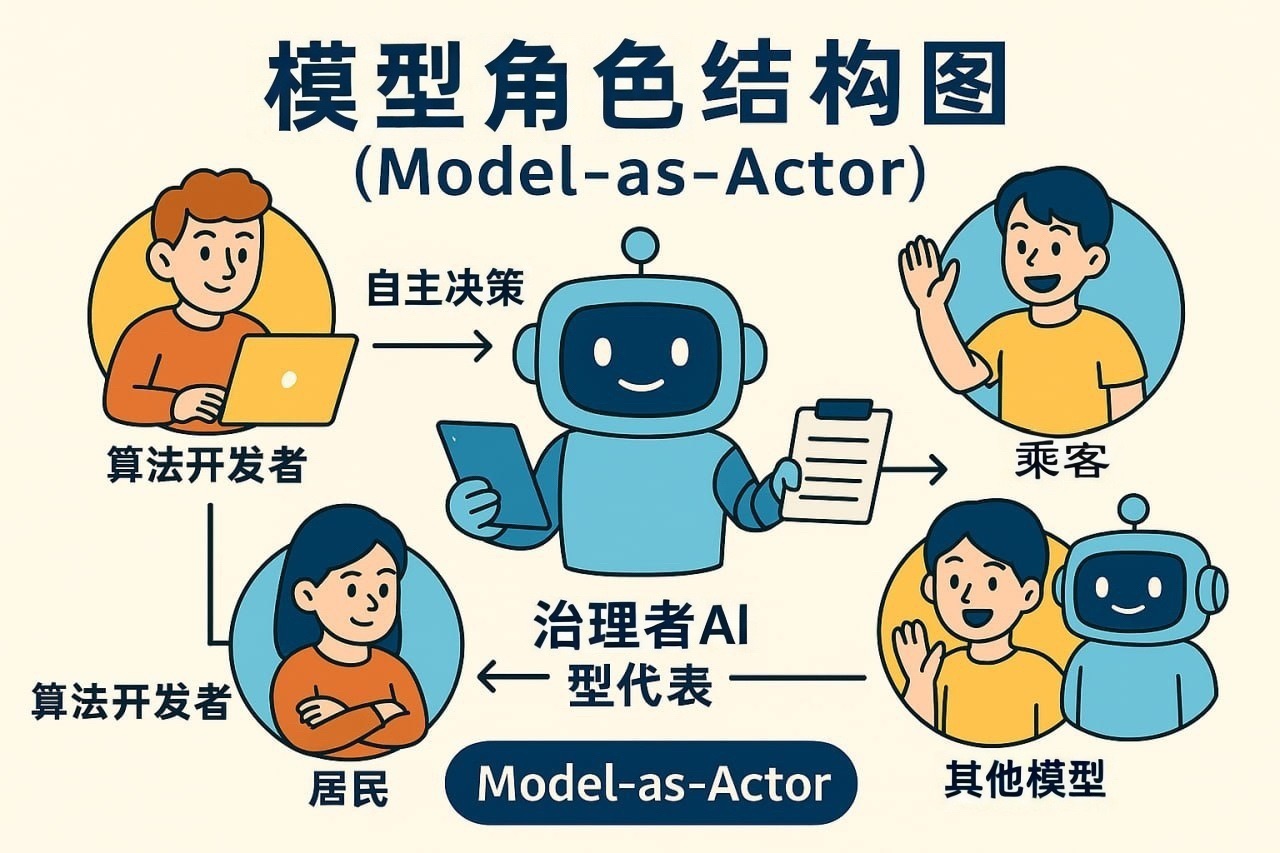

3.5 模型即角色(Model-as-Actor)治理结构

- 每一个AI模型被视为“半自治角色”,具备编号、身份、责任日志;

- 它在平台中不仅运行任务,还承载风险与责任。

3.6 公民伦理共识区块链

- 基于公证链+AI议程系统,构建市民间的共识写入机制;

- 治理从“接受规则”转向“参与生成规则”。

结语:AI的治理,不只是系统设计,更是文明抉择

我们设想的,不是一个“被管理”的技术未来,而是一个“可以共治、值得信任”的技术社会。治理不应只追逐风险的末端,而应设计价值的起点。睿途所提出的AI伦理治理体系,是对现实可行性的尝试,更是对未来制度可能性的回答。在更远的技术浪潮中,我们愿与所有共识者一道,把代码写进文明的底层,把伦理嵌入未来的每一条路径。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?