前言

机器学习(Machine Learning)作为人工智能领域的重要分支,近年来在数据分析、预测建模、自动化决策等多个领域取得了显著的成果。从简单的线性回归到复杂的深度学习模型,机器学习涵盖了广泛的技术和算法。对于初学者来说,理解机器学习的基础算法是进入这一领域的关键。本文将从最基础的线性回归开始,逐步介绍到决策树,帮助你构建坚实的机器学习知识体系。通过Python实践,你将能够快速上手并实现自己的机器学习模型。

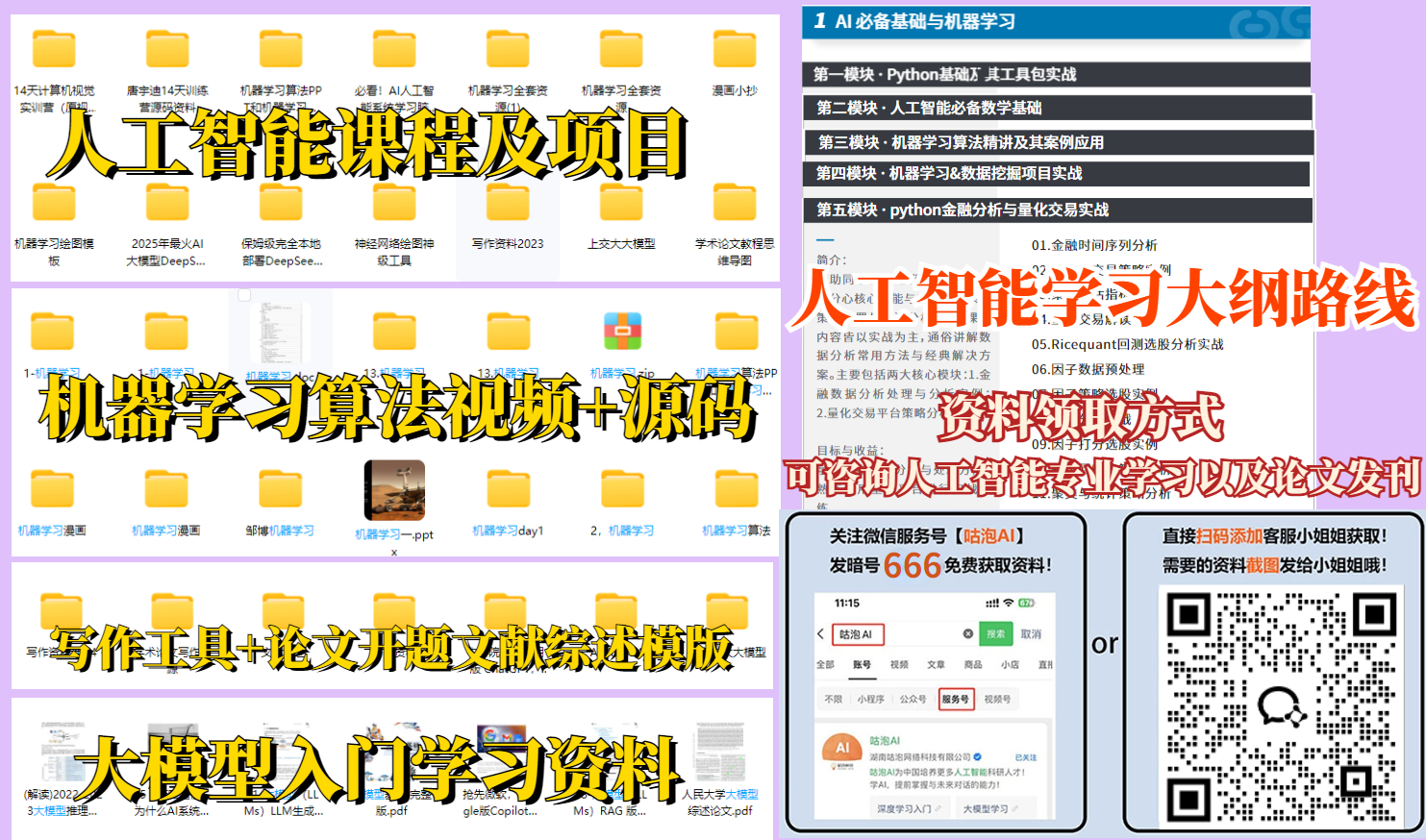

免费分享一些我整理的人工智能学习资料给大家,包括一些AI常用框架实战视频、图像识别、OpenCV、NLQ、机器学习、pytorch、计算机视觉、深度学习与神经网络等视频、课件源码、国内外知名精华资源、AI热门论文、行业报告等。

下面是部分截图,关注VX公众号【咕泡AI 】发送暗号 666 领取

一、机器学习的基本概念

机器学习是一种使计算机能够通过数据自动学习规律和模式的技术,而无需进行显式编程。根据学习方式的不同,机器学习可以分为以下几类:

-

监督学习(Supervised Learning):通过标记的数据进行学习,目标是预测新的数据点。常见的任务包括分类和回归。

-

无监督学习(Unsupervised Learning):通过未标记的数据进行学习,目标是发现数据中的结构或模式。常见的任务包括聚类和降维。

-

强化学习(Reinforcement Learning):通过与环境的交互来学习最优行为策略,目标是最大化累积奖励。

二、Python环境搭建

在开始学习机器学习之前,你需要搭建一个适合的Python开发环境。推荐使用以下工具:

-

Anaconda:一个流行的Python数据科学平台,集成了许多常用的库和工具。

-

Jupyter Notebook:一个交互式的Python环境,适合进行数据探索和模型训练。

-

PyCharm:一个功能强大的Python IDE,适合进行项目开发。

(一)安装Anaconda

-

访问 Anaconda官网 下载安装包。

-

按照安装向导完成安装。

-

启动Anaconda Navigator,创建一个新的Python环境。

(二)安装常用库

在Anaconda环境中,安装以下常用的机器学习库:

bash

复制

conda install numpy pandas matplotlib scikit-learn三、线性回归

线性回归是机器学习中最基础的算法之一,用于解决回归问题,即预测连续值输出的问题。线性回归的基本假设是输入特征和输出之间存在线性关系。

(一)线性回归的数学原理

线性回归的目标是找到一个线性函数,使得该函数能够最好地拟合训练数据。假设我们有一个数据集 (x1,y1),(x2,y2),…,(xn,yn),其中 xi 是输入特征,yi 是对应的输出值。线性回归模型可以表示为: y=θ0+θ1x1+θ2x2+…+θdxd 其中,θ0,θ1,…,θd 是模型的参数,需要通过训练数据学习得到。

(二)损失函数与优化

线性回归通常使用均方误差(Mean Squared Error, MSE)作为损失函数,定义为: MSE=n1∑i=1n(yi−y^i)2 其中,yi 是真实值,y^i 是预测值。优化的目标是最小化损失函数,通常使用梯度下降算法来更新参数。

(三)线性回归的实现

以下是一个使用Python和scikit-learn库实现线性回归的示例:

Python

复制

import numpy as np

import matplotlib.pyplot as plt

from sklearn.linear_model import LinearRegression

from sklearn.model_selection import train_test_split

from sklearn.metrics import mean_squared_error

# 生成模拟数据

np.random.seed(42)

X = 2 * np.random.rand(100, 1)

y = 4 + 3 * X + np.random.randn(100, 1)

# 划分训练集和测试集

X_train, X_test, y_train, y_test = train_test_split(X, y, test_size=0.2, random_state=42)

# 创建线性回归模型

model = LinearRegression()

model.fit(X_train, y_train)

# 预测

y_pred = model.predict(X_test)

# 评估模型

mse = mean_squared_error(y_test, y_pred)

print(f'Mean Squared Error: {mse:.2f}')

# 绘制结果

plt.scatter(X, y, color='blue', label='Data points')

plt.plot(X_test, y_pred, color='red', linewidth=2, label='Linear regression')

plt.xlabel('X')

plt.ylabel('y')

plt.legend()

plt.show()四、决策树

决策树是一种非参数监督学习算法,可以用于分类和回归任务。它通过学习一系列简单的问题来预测目标变量的值。决策树的优点是模型易于理解和解释,且不需要对数据进行归一化处理。

(一)决策树的工作原理

决策树通过递归地选择最佳特征并将其划分为子集来构建模型。每次划分的目标是最大化信息增益(Information Gain)或最小化基尼不纯度(Gini Impurity)。决策树的构建过程可以总结为以下步骤:

-

选择最佳特征进行划分。

-

递归地对每个子集重复上述过程。

-

当满足停止条件时(如达到最大深度或节点纯度足够高),停止划分。

(二)决策树的实现

以下是一个使用scikit-learn库实现决策树分类器的示例:

Python

复制

import numpy as np

import matplotlib.pyplot as plt

from sklearn.datasets import load_iris

from sklearn.tree import DecisionTreeClassifier

from sklearn.model_selection import train_test_split

from sklearn.metrics import accuracy_score

# 加载数据集

iris = load_iris()

X, y = iris.data, iris.target

# 划分训练集和测试集

X_train, X_test, y_train, y_test = train_test_split(X, y, test_size=0.2, random_state=42)

# 创建决策树分类器

model = DecisionTreeClassifier(random_state=42)

model.fit(X_train, y_train)

# 预测

y_pred = model.predict(X_test)

# 评估模型

accuracy = accuracy_score(y_test, y_pred)

print(f'Accuracy: {accuracy:.2f}')

# 可视化决策树(仅适用于二分类问题)

from sklearn.tree import plot_tree

plt.figure(figsize=(12, 8))

plot_tree(model, filled=True, feature_names=iris.feature_names, class_names=iris.target_names)

plt.show()五、项目实战:房价预测

为了更好地理解线性回归和决策树的应用,我们将通过一个房价预测项目来展示如何使用这两种算法解决实际问题。

(一)项目背景

房价预测是一个典型的回归问题,目标是根据房屋的特征(如面积、房间数量、位置等)预测其价格。我们将使用scikit-learn库中的Boston房价数据集进行实验。

(二)项目实现

1. 数据准备

Python

复制

from sklearn.datasets import load_boston

from sklearn.model_selection import train_test_split

# 加载数据集

boston = load_boston()

X, y = boston.data, boston.target

# 划分训练集和测试集

X_train, X_test, y_train, y_test = train_test_split(X, y, test_size=0.2, random_state=42)2. 使用线性回归进行预测

Python

复制

from sklearn.linear_model import LinearRegression

from sklearn.metrics import mean_squared_error

# 创建线性回归模型

linear_model = LinearRegression()

linear_model.fit(X_train, y_train)

# 预测

y_pred_linear = linear_model.predict(X_test)

# 评估模型

mse_linear = mean_squared_error(y_test, y_pred_linear)

print(f'Linear Regression MSE: {mse_linear:.2f}')3. 使用决策树进行预测

Python

复制

from sklearn.tree import DecisionTreeRegressor

# 创建决策树回归器

tree_model = DecisionTreeRegressor(random_state=42)

tree_model.fit(X_train, y_train)

# 预测

y_pred_tree = tree_model.predict(X_test)

# 评估模型

mse_tree = mean_squared_error(y_test, y_pred_tree)

print(f'Decision Tree MSE: {mse_tree:.2f}')4. 比较两种模型的性能

Python

复制

print(f'Linear Regression MSE: {mse_linear:.2f}')

print(f'Decision Tree MSE: {mse_tree:.2f}')(三)项目扩展

-

特征工程:尝试对数据进行特征工程,如添加多项式特征、交互特征等。

-

超参数优化:使用网格搜索或随机搜索优化模型的超参数。

-

模型融合:尝试将线性回归和决策树模型进行融合,提高预测性能。

六、总结

通过本文的介绍,你已经掌握了线性回归和决策树这两种基础机器学习算法的原理和实现方法。从线性回归的简单模型到决策树的非线性模型,这两种算法在许多实际问题中都有广泛的应用。希望这篇文章能够帮助你更好地理解和应用机器学习技术,开启你的机器学习之旅。如果你在实践过程中有任何问题,欢迎在评论区留言,我们一起交流和进步!

160

160

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?