前言

**[大模型]是指具有大规模参数和复杂计算结构的机器学习模型。**本文从大模型的基本概念出发,对大模型领域容易混淆的相关概念进行区分,并就大模型的发展历程、特点和分类、[泛化与]微调进行了详细解读,供大家在了解大模型基本知识的过程中起到一定参考作用。

本文目录如下:

- 大模型的定义

- 大模型相关概念区分

- 大模型的发展历程

- 大模型的特点

- 大模型的分类

- 大模型的泛化与微调

1. 大模型的定义

**大模型是指具有大规模参数和复杂计算结构的机器学习模型。**这些模型通常由[深度神经网络]构建而成,拥有数十亿甚至数千亿个参数。大模型的设计目的是为了提高模型的表达能力和预测性能,能够处理更加复杂的任务和数据。大模型在各种领域都有广泛的应用,包括[自然语言处理]、计算机视觉、语音识别和[推荐系统]等。大模型通过训练海量数据来学习复杂的模式和特征,具有更强大的[泛化能力],可以对未见过的数据做出准确的预测。

ChatGPT 对大模型的解释更为通俗易懂,也更体现出类似人类的归纳和思考能力:大模型本质上是一个使用海量数据训练而成的深度[神经网络模型],其巨大的数据和参数规模,实现了智能的涌现,展现出类似人类的智能。

那么,大模型和小模型有什么区别?

小模型通常指参数较少、层数较浅的模型,它们具有轻量级、高效率、易于部署等优点,适用于数据量较小、计算资源有限的场景,例如移动端应用、嵌入式设备、物联网等。

而当模型的训练数据和参数不断扩大,直到达到一定的临界规模后,其表现出了一些未能预测的、更复杂的能力和特性,模型能够从原始训练数据中自动学习并发现新的、更高层次的特征和模式,这种能力被称为“[涌现能力])”。而具备涌现能力的机器学习模型就被认为是独立意义上的大模型,这也是其和小模型最大意义上的区别。

相比小模型,大模型通常参数较多、层数较深,具有更强的表达能力和更高的准确度,但也需要更多的计算资源和时间来训练和推理,适用于数据量较大、计算资源充足的场景,例如云端计算、[高性能计算]、人工智能等。

如果你对AI大模型入门感兴趣,那么你需要的话可以点击这里大模型重磅福利:入门进阶全套104G学习资源包免费分享!

2. 大模型相关概念区分:

**大模型(Large Model,也称基础模型,即 Foundation Model),**是指具有大量参数和复杂结构的机器学习模型,能够处理海量数据、完成各种复杂的任务,如自然语言处理、计算机视觉、语音识别等。

**超大模型:**超大模型是大模型的一个子集,它们的参数量远超过大模型。

**[大语言模型](Large Language Model):**通常是具有大规模参数和计算能力的自然语言处理模型,例如 OpenAI 的 GPT-3 模型。这些模型可以通过大量的数据和参数进行训练,以生成人类类似的文本或回答自然语言的问题。[大型语言模型]在自然语言处理、文本生成和智能对话等领域有广泛应用。

**GPT(Generative Pre-trained Transformer):**GPT 和 ChatGPT 都是基于 Transformer 架构的语言模型,但它们在设计和应用上存在区别:GPT 模型旨在生成自然语言文本并处理各种自然语言处理任务,如文本生成、翻译、摘要等。它通常在单向生成的情况下使用,即根据给定的文本生成连贯的输出。

**ChatGPT:**ChatGPT 则专注于对话和交互式对话。它经过特定的训练,以更好地处理[多轮对话]和上下文理解。ChatGPT 设计用于提供流畅、连贯和有趣的对话体验,以响应用户的输入并生成合适的回复。

3. 大模型的发展历程

萌芽期(1950-2005):以 CNN 为代表的传统神经网络模型阶段

· 1956 年,从计算机专家约翰·麦卡锡提出“人工智能”概念开始,AI 发展由最开始基于小规模专家知识逐步发展为基于机器学习。

· 1980 年,[卷积神经网络]的雏形 CNN 诞生。

· 1998 年,现代卷积神经网络的基本结构 LeNet-5 诞生,机器学习方法由早期基于浅层机器学习的模型,变为了基于深度学习的模型,为[自然语言生成]、计算机视觉等领域的深入研究奠定了基础,对后续深度学习框架的迭代及大模型发展具有开创性的意义。

探索沉淀期(2006-2019):以 Transformer 为代表的全新神经网络模型阶段

· 2013 年,[自然语言处理模型] Word2Vec 诞生,首次提出将单词转换为向量的“词[向量模型]”,以便计算机更好地理解和处理文本数据。

· 2014 年,被誉为 21 世纪最强大算法模型之一的 GAN([对抗式生成网络])诞生,标志着深度学习进入了[生成模型]研究的新阶段。

· 2017 年,Google 颠覆性地提出了基于自[注意力机制]的神经网络结构——Transformer 架构,奠定了大模型预训练算法架构的基础。

· 2018 年,OpenAI 和 Google 分别发布了 GPT-1 与 BERT 大模型,意味着预训练大模型成为自然语言处理领域的主流。在探索期,以 Transformer 为代表的全新神经网络架构,奠定了大模型的算法架构基础,使大模型技术的性能得到了显著提升。

迅猛发展期(2020-至今):以 GPT 为代表的预训练大模型阶段

· 2020 年,OpenAI 公司推出了[GPT-3],模型参数规模达到了 1750 亿,成为当时最大的语言模型,并且在零样本学习任务上实现了巨大性能提升。随后,更多策略如基于人类反馈的强化学习(RHLF)、代码预训练、[指令微调]等开始出现, 被用于进一步提高推理能力和任务泛化。

· 2022 年 11 月,搭载了[GPT3.5]的 ChatGPT[横空出世],凭借逼真的自然语言交互与多场景内容生成能力,迅速引爆互联网。

· 2023 年 3 月,最新发布的超大规模[多模态]预训练大模型——GPT-4,具备了多模态理解与多类型内容生成能力。在迅猛发展期,大数据、大算力和大算法完美结合,大幅提升了大模型的预训练和生成能力以及多模态多场景应用能力。如 ChatGPT 的巨大成功,就是在[微软Azure]强大的算力以及 wiki 等海量数据支持下,在 Transformer 架构基础上,坚持 GPT 模型及人类反馈的强化学习(RLHF)进行精调的策略下取得的。

4. 大模型的特点

· 巨大的规模: 大模型包含数十亿个参数,模型大小可以达到数百 GB 甚至更大。巨大的模型规模使大模型具有强大的表达能力和学习能力。

**· 涌现能力:**涌现(英语:emergence)或称创发、突现、呈展、演生,是一种现象,为许多小实体相互作用后产生了大实体,而这个大实体展现了组成它的小实体所不具有的特性。引申到模型层面,涌现能力指的是当模型的训练数据突破一定规模,模型突然涌现出之前小模型所没有的、意料之外的、能够综合分析和解决更深层次问题的复杂能力和特性,展现出类似人类的思维和智能。涌现能力也是大模型最显著的特点之一。

· 更好的性能和泛化能力: 大模型通常具有更强大的学习能力和泛化能力,能够在各种任务上表现出色,包括自然语言处理、图像识别、语音识别等。

· 多任务学习: 大模型通常会一起学习多种不同的 NLP 任务,如机器翻译、文本摘要、问答系统等。这可以使模型学习到更广泛和泛化的语言理解能力。

· 大数据训练: 大模型需要海量的数据来训练,通常在 TB 以上甚至 PB 级别的数据集。只有大量的数据才能发挥大模型的参数规模优势。

· 强大的计算资源: 训练大模型通常需要数百甚至上千个 GPU,以及大量的时间,通常在几周到几个月。

· 迁移学习和预训练: 大模型可以通过在大规模数据上进行预训练,然后在特定任务上进行微调,从而提高模型在新任务上的性能。

· 自监督学习: 大模型可以通过自监督学习在大规模未标记数据上进行训练,从而减少对标记数据的依赖,提高模型的效能。

· [领域知识融合]: 大模型可以从多个领域的数据中学习知识,并在不同领域中进行应用,促进跨领域的创新。

· 自动化和效率:大模型可以自动化许多复杂的任务,提高工作效率,如自动编程、自动翻译、自动摘要等。

5. 大模型的分类

按照输入数据类型的不同,大模型主要可以分为以下三大类:

· [语言大模型]:是指在自然语言处理(Natural Language Processing,NLP)领域中的一类大模型,通常用于处理文本数据和理解自然语言。这类大模型的主要特点是它们在大规模语料库上进行了训练,以学习自然语言的各种语法、语义和语境规则。例如:GPT 系列(OpenAI)、Bard(Google)、[文心一言](百度)。

· [视觉大模型]:是指在计算机视觉(Computer Vision,CV)领域中使用的大模型,通常用于图像处理和分析。这类模型通过在大规模图像数据上进行训练,可以实现各种视觉任务,如[图像分类]、目标检测、[图像分割]、[姿态估计]、人脸识别等。例如:VIT 系列(Google)、[文心UFO]、华为盘古 CV、INTERN(商汤)。

**· 多模态大模型:**是指能够处理多种不同类型数据的大模型,例如文本、图像、音频等多模态数据。这类模型结合了 NLP 和 CV 的能力,以实现对多模态信息的综合理解和分析,从而能够更全面地理解和处理复杂的数据。例如:DingoDB 多模向量数据库(九章云极 DataCanvas)、DALL-E(OpenAI)、悟空画画(华为)、midjourney。

按照应用领域的不同,大模型主要可以分为 L0、L1、L2 三个层级:

· 通用大模型 L0:是指可以在多个领域和任务上通用的大模型。它们利用大算力、使用海量的开放数据与具有巨量参数的深度学习算法,在大规模无标注数据上进行训练,以寻找特征并发现规律,进而形成可“举一反三”的强大泛化能力,可在不进行微调或少量微调的情况下完成多场景任务,相当于 AI 完成了“通识教育”。

· 行业大模型 L1:是指那些针对特定行业或领域的大模型。它们通常使用行业相关的数据进行预训练或微调,以提高在该领域的性能和准确度,相当于 AI 成为“行业专家”。

· 垂直大模型 L2:是指那些针对特定任务或场景的大模型。它们通常使用任务相关的数据进行预训练或微调,以提高在该任务上的性能和效果。

6. 大模型的泛化与微调

**模型的泛化能力:**是指一个模型在面对新的、未见过的数据时,能够正确理解和预测这些数据的能力。在机器学习和人工智能领域,模型的泛化能力是评估模型性能的重要指标之一。

**什么是模型微调:**给定预训练模型(Pre-trained model),基于模型进行微调(Fine Tune)。相对于从头开始训练(Training a model from scatch),微调可以省去大量计算资源和计算时间,提高计算效率,甚至提高准确率。

模型微调的基本思想是使用少量带标签的数据对预训练模型进行再次训练,以适应特定任务。在这个过程中,模型的参数会根据新的数据分布进行调整。这种方法的好处在于,它利用了预训练模型的强大能力,同时还能够适应新的数据分布。因此,模型微调能够提高模型的泛化能力,减少[过拟合]现象。

常见的模型微调方法:

· Fine-tuning:这是最常用的微调方法。通过在预训练模型的最后一层添加一个新的分类层,然后根据新的数据集进行微调。

· Feature augmentation:这种方法通过向数据中添加一些人工特征来增强模型的性能。这些特征可以是手工设计的,也可以是通过自动特征生成技术生成的。

· Transfer learning:这种方法是使用在一个任务上训练过的模型作为新任务的起点,然后对模型的参数进行微调,以适应新的任务。

大模型是未来人工智能发展的重要方向和核心技术,未来,随着 AI 技术的不断进步和应用场景的不断拓展,大模型将在更多领域展现其巨大的潜力,为人类万花筒般的 AI 未来拓展无限可能性。

好啦,以上就是本期**「大模型高能玩法」的全部内容!想获取更多大模型的独家深度资料?🔥 快关注 我**,一键解锁前沿技术解析、实战案例和进阶秘籍📚!

从零入门大模型:最全学习路线、实战案例与资源汇总(2025最新版)

人工智能大模型(如ChatGPT、DeepSeek等)正驱动着技术变革,掌握相关技术已成为提升竞争力的关键。然而,大模型技术涉及领域广泛,学习曲线陡峭。为了帮助大家系统性地学习和掌握大模型技术,我们整理了一份资源包,旨在提供从理论基础到实践应用的全面支持。

这份资源包包含以下内容:

大模型学习路线与阶段规划: 提供清晰的学习路径,帮助学习者了解不同阶段的学习目标和所需技能。

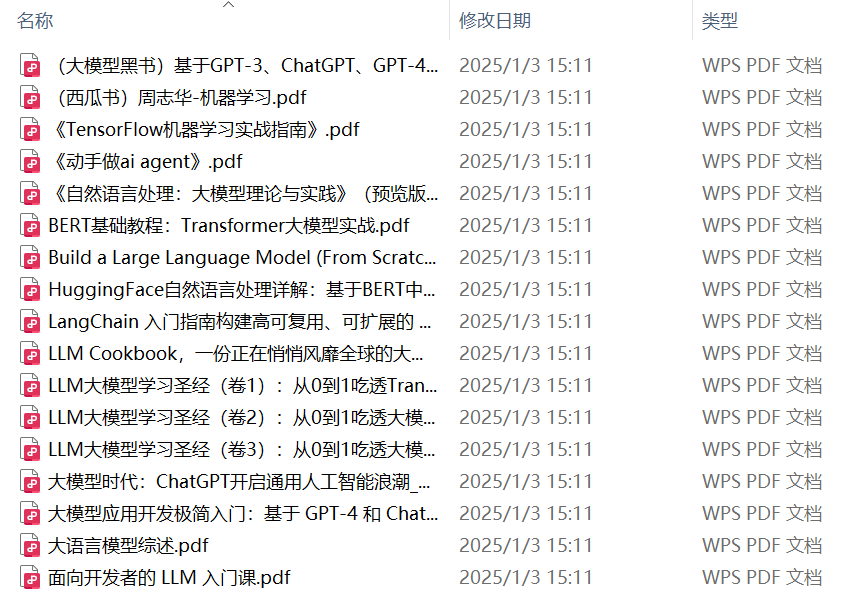

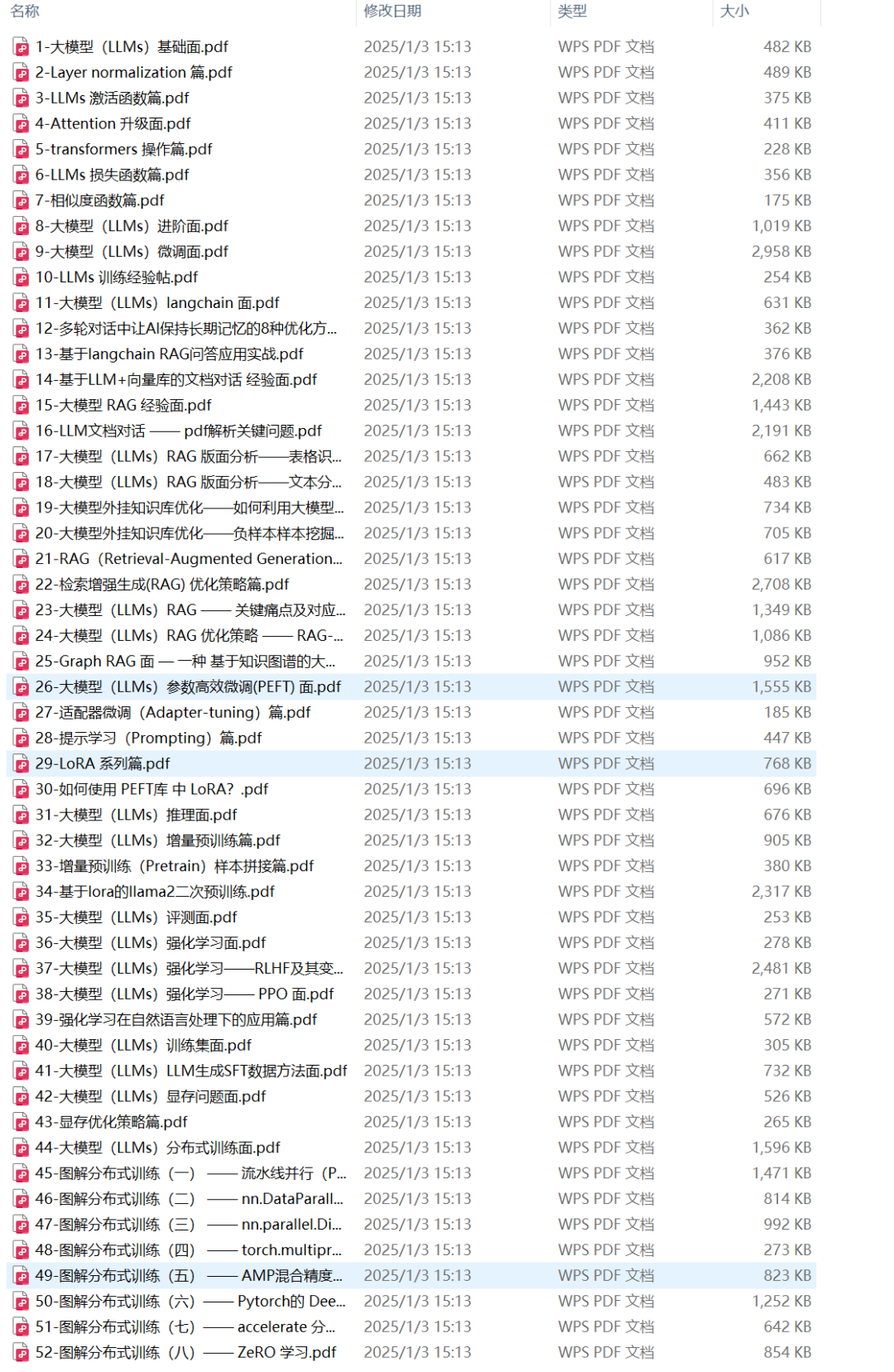

人工智能论文PDF合集: 收录了重要的大模型相关论文,涵盖Transformer架构、预训练模型、微调技术等关键领域,方便深入研究。

52个大模型落地案例合集: 汇集了不同行业的大模型应用案例,展示了如何将大模型技术应用于实际问题,并提供参考实现思路。

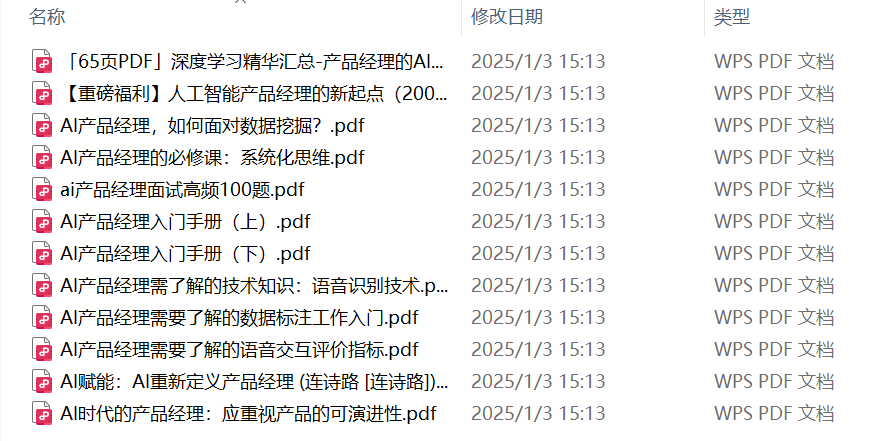

100+本数据科学必读经典书: 涵盖机器学习、深度学习、自然语言处理等领域的基础理论和算法,为理解大模型技术奠定基础。

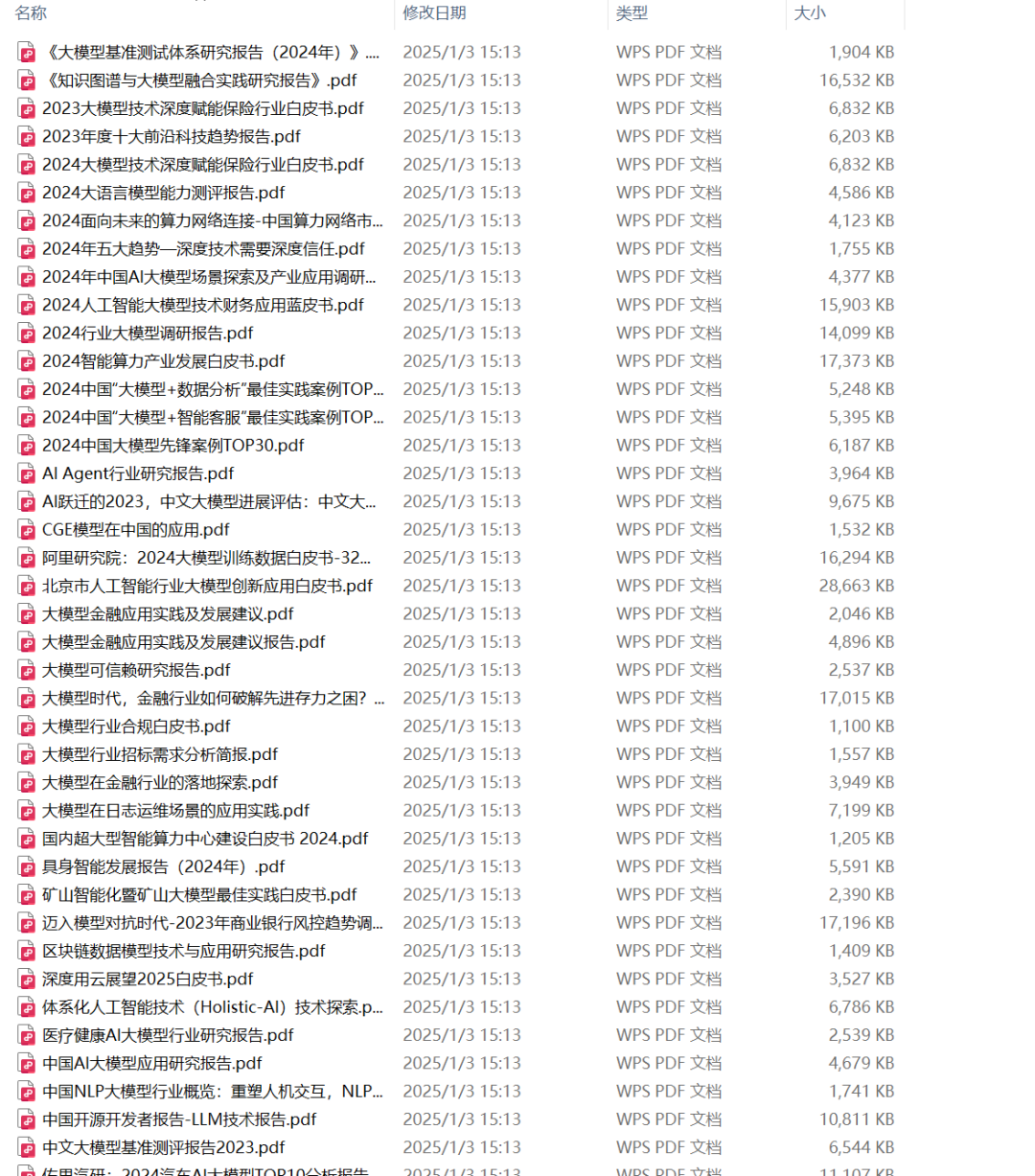

600+套大模型行业研究报告: 提供市场分析、技术趋势、竞争格局等信息,帮助了解大模型技术的行业应用和发展前景。

这份资源包对于想要系统学习大模型技术的人来说,无疑是一份极具价值的指南。首先,要充分利用其中的“大模型学习路线与阶段规划”,这相当于你的学习地图,这份指南出自于我们体系教程《NLP大模型人才培养计划》。

务必仔细研读,了解每个阶段的目标、所需技能和学习内容,并根据自身情况进行调整,制定个性化的学习计划。可以将大的学习路线分解为更小的、可实现的目标,并设定完成时间,这有助于保持学习动力和跟踪进度。

添加👇方联系方式领取【保证100%免费】

咨询大模型人才培养计划 &免费领取本文资源

大模型学习路线与阶段规划

本路线旨在帮助学员掌握大模型相关技术栈,以及大模型在行业场景中的应用,包含企业级大模型项目实战。

各阶段详细学习内容:

阶段一:自然语言处理(NLP)与AI基础

-

目标: 掌握NLP与深度学习AI的基础知识,为后续大模型学习打下坚实基础。

-

学习内容:

-

- 自注意力机制(self-attention)

- 如何让模型学习到文本中不同语段的上下文联系?

- 巧用位置编码,传递语句前后顺序关系

- 核心计算流程:编码(Encoder)和解码(Decoder)

- 实践任务一: 使用Pytorch手撸Transformer

- 实践任务二: 全能的Transformer,解决时序预测问题

-

- 循环神经网络结构拆解

- 如何解决长序列的知识遗忘问题?—长短期记忆神经网络

- 基于PyTorch实现RNN代码架构

- 如何赋予模型双向学习能力?

- 在不同任务中的RNN的用法区别:分类、序列标注等

- 实践任务: 基于RNN的分词任务实战

-

- 卷积神经网络结构拆解

- 基于PyTorch实现CNN代码架构

- 卷积网络中的经典层(Layer)及其实现方法

- 卷积网络中的经典模块(Module)及其实现方法

- 使用卷积网络建模的经典模型介绍

- 实践任务: 使用CNN搭建文本分类模型

-

- 实践任务二: 深度学习开发环境搭建

-

- 实践任务一: 从0实现逻辑回归模型

-

- 人工智能的发展路径

- 机器学习优化方法和应用

- 深度学习的发展和应用范式的演变

- 卷积神经网络(CNN)

- 循环神经网络(RNN)

- Transformer架构

阶段二:自然语言处理实战

-

目标: 结合实际场景,掌握NLP技术栈中的任务分类及相关技术。

-

学习内容:

-

- BERT的模型结构解析

- BERT预训练方法

- Mask掩码机制:让模型自己做「完形填空」

- 长段落上下文信息增强,预测下一句(NSP训练策略)

-

- 数据准备: 准备训练数据、基础文本预处理

- 最简单的编码方法:One-Hot

- 词袋表示(N-Grams词袋)

- 基于词频统计的表示方法(TF-IDF)

- 词嵌入(Word2vec、Glove、FastText)

- 可视化词向量

- 实践任务: 手写Word2vec

-

- 问题定义

- 数据获取方法

- 数据探索(EDA)&数据整理(Wrangling)&预处理(Initial Preprocessing)

- 如何将数据转化成机器可识别的语言?— 特征工程

- 算法的高级艺术:抽象方法和建模策略

- 如何衡量算法模型的好坏?—评估方法及其重要性

- 将自然语言处理算法部署成应用能力

- 实践任务: 数据分析和预处理实战

-

- 第一个自然语言处理流程

- 文本表示方法

- 预训练模型 - BERT

阶段三:多模态大模型与知识图谱自动化构建

-

目标: 掌握多模态大模型架构,以及如何利用大模型自动化构建知识图谱。

-

学习内容:

-

- 知识图谱Schema建设方案

- 基于大模型的实体识别和关系构建方法

- 基于大模型的输入存储和图谱查询方法

- 自动化迭代策略

- 实践内容:

-

- 学习如何使用大模型根据行业数据特点帮助简历并完善知识图谱schema

- 学习如何在Prompt中通过ICL增强大模型对任务的理解

- 学习如何通过微调大模型,优化实体识别和关系关系构建效果

- 学习如何让大模型理解知识图谱的总体架构,从而让大模型能够根据用户输入去自动生成数据存储和查询知识图谱的指令

- 如何驱动大模型周期性得评估知识图谱结构的优劣,自动生成优化方案

-

- 学习如何构建指令模板

- 学习如何微调训练多模态大模型

- 搭建图像要素自动识别和多模态问答demo系统

-

- 多模态大模型

- 基于大模型的知识图谱自动化构建项目实战

阶段四:企业级大模型应用落地方案 - RAG实战

-

目标: 从0-1搭建通用性RAG应用框架,并应用于多个行业场景。

-

学习内容:

-

- 企业级应用框架设计与实现

- 三个标准流程的抽象与搭建方法(RAG.Chain)

- 灵活的功能组件实现策略(RAG.Module)

- 自定义文档加载器:PDF图文信息增强识别

- 自定义开发文档分割组件:中文段落切分优化方案

- 依赖服务的接入方法:向量数据库、大模型推理服务、embedding、重排序模型

- RAG评估流程搭建

- 基于LangSmith和langfuse搭建RAG流程监控系统

- RAG场景化进阶:基于知识图谱的增强策略(接入现有图谱数据、GraphRAG)

-

- RAG任务介绍 & 技术发展历程

- RAG依赖哪些组件和能力?(向量数据库、大模型推理服务)

- 模块化RAG系统架构设计 — 从理论到实战

- 主流的(开源)RAG应用开发框架

- RAG生态工具和能力

- 实践内容:

阶段五:Agent项目实战

-

目标: 掌握Agent技术,应对系统状态变化不可控的复杂场景。

-

学习内容:

-

- 学习如何通过Prompt引导Agent进行推理

- 学习Agent推理和验证流程的实现方法

- 学习如何让Agent在合适任务上调用外部能力来增强效果

- 学习如何搭建多Agent系统

- 学习如何解决多跳问题:ReAct的实现方法

- 「人人都是AI开发专家」实践一:基于ModelScope Agent搭建一个应用开发助手

- 「人人都是AI开发专家」实践二:基于Coze搭建一个知识问答机器人

-

- Agent通用架构介绍

- Agent中的规划(Planning)和推理(Reasoning)能力

- Agent的文本输出和工具调用

- 经典AI Agent案例分析

- ModelScope-Agent项目拆解

- 实践内容:

阶段六:大模型应用算法工程师面试辅导

-

目标: 提升面试技巧,成功斩获大模型应用算法工程师职位。

-

学习内容:

-

- 在企业中的发展路径

- 职业规划:如何快速升职加薪

- 技术层面如何持续性的自我提升

-

- 优秀简历模板讲解

- 典型简历抽样点评

- 大模型面试知识点整理和分享(八股文)

- 一线互联网大厂的面试流程及侧重点

- 面试技巧分享

- 面试时的几大忌讳

-

- 面试攻略及指导

- 大模型应用算法工程师的职业规划

人工智能论文PDF合集

切忌贪多嚼不烂。建议从综述性论文入手,了解特定领域的整体情况和关键研究方向。同时,关注奠定大模型基础的经典论文,例如 Transformer 架构的论文。阅读时,精读与泛读结合,对于重要的论文仔细阅读并理解细节,对于其他论文则快速浏览以了解主要思想。务必做好笔记,记录论文的关键信息、创新点和实验结果,方便以后回顾。

52个大模型落地案例合集

52个大模型落地案例合集”是理论联系实际的绝佳素材。通过案例分析,了解大模型是如何应用于实际问题的,并思考这些案例是否可以应用于你感兴趣的领域。学习案例中的成功经验和遇到的挑战,并尝试复现一些简单的案例,加深理解。

100+本数据科学必读经典书

“100+本数据科学必读经典书”是夯实基础的基石。将书籍按照主题进行分类,例如机器学习、深度学习、自然语言处理、统计学、编程等,并根据自身背景和学习目标,选择合适的书籍。

从入门书籍开始,逐步深入。阅读时,参考其他读者的评论和推荐,选择高质量的书籍,并避免贪多嚼不烂,一次只读几本书,确保理解并掌握内容。

600+套大模型行研报告

“600+套大模型行研报告”是了解行业趋势的重要窗口。通过阅读行研报告,了解大模型技术的最新发展趋

部分资源内容展示

如果你对AI大模型入门感兴趣,那么你需要的话可以点击这里大模型重磅福利:入门进阶全套104G学习资源包免费分享!

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?