本内容重点介绍【7 UNDERSTANDING THE LOW-RANK UPDATES】的内容

该章节通过实证研究深入探讨了LoRA方法中低秩更新的性质,回答了三个关键问题,揭示了低秩适应矩阵(ΔW)的特性及其在任务适应中的作用。

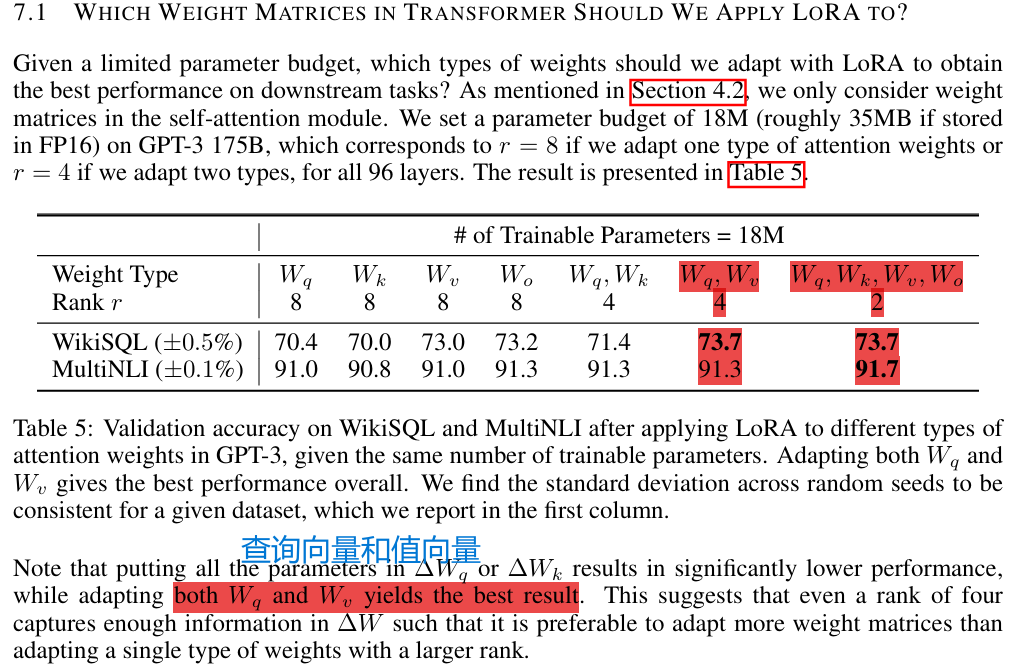

一、选择 Transformers 中哪些权重矩阵进行微调?

和

用于计算注意力分数(表示查询和键之间的相关性)。

用于表示值向量(注意力机制的输入)。

用于将多头注意力的输出转换为最终的输出。

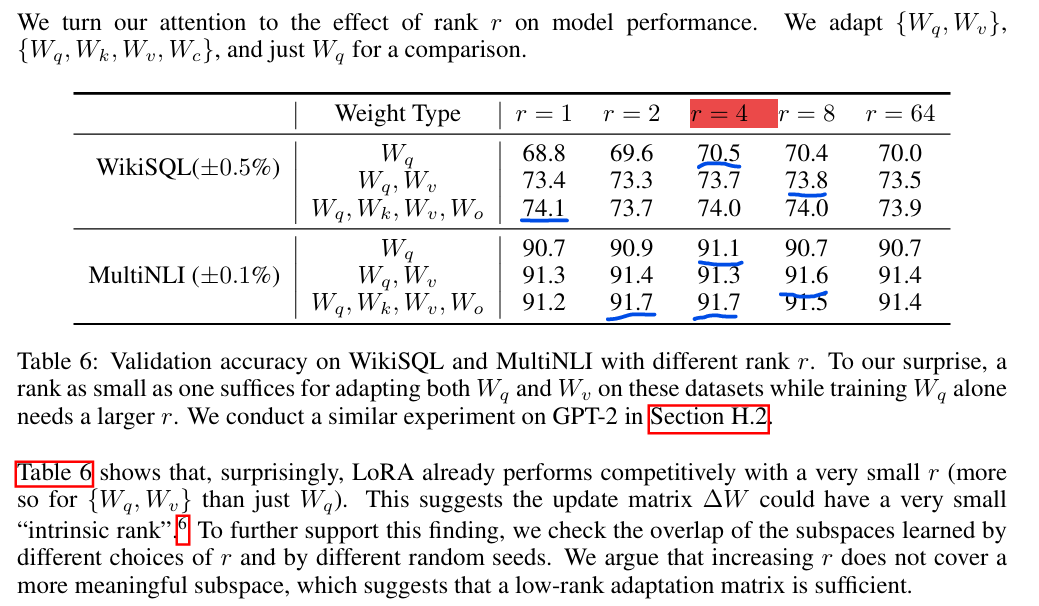

二、在 Lora 微调时最优秩该如何选择?

在LoRA方法中,低秩矩阵分解的核心是确定适应矩阵 ΔW 的秩 r。秩 r 的选择需要在参数效率与模型性能之间取得平衡:

-

过小:可能无法充分捕捉任务相关特征,导致性能下降。

-

过大:增加计算和存储成本,但性能提升可能有限。

2.1 实验一:权重对秩的影响

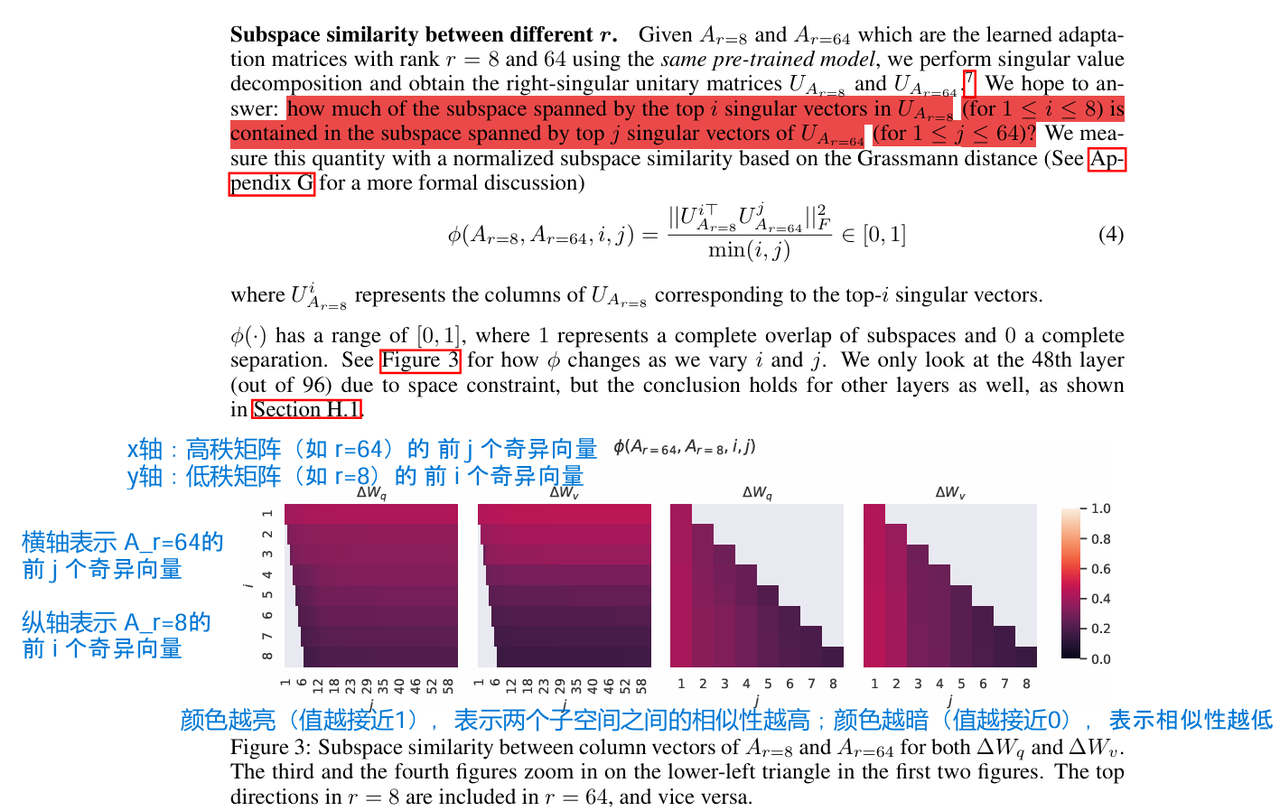

2.2 实验二:子空间相似性分析

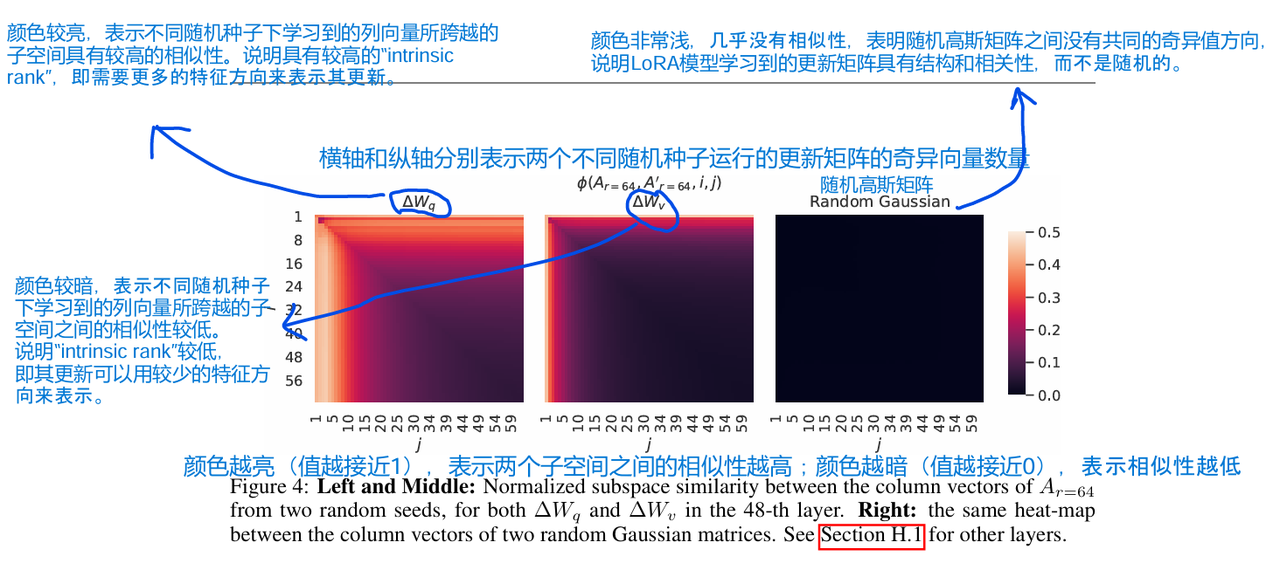

2.3 实验三:随机种子对比

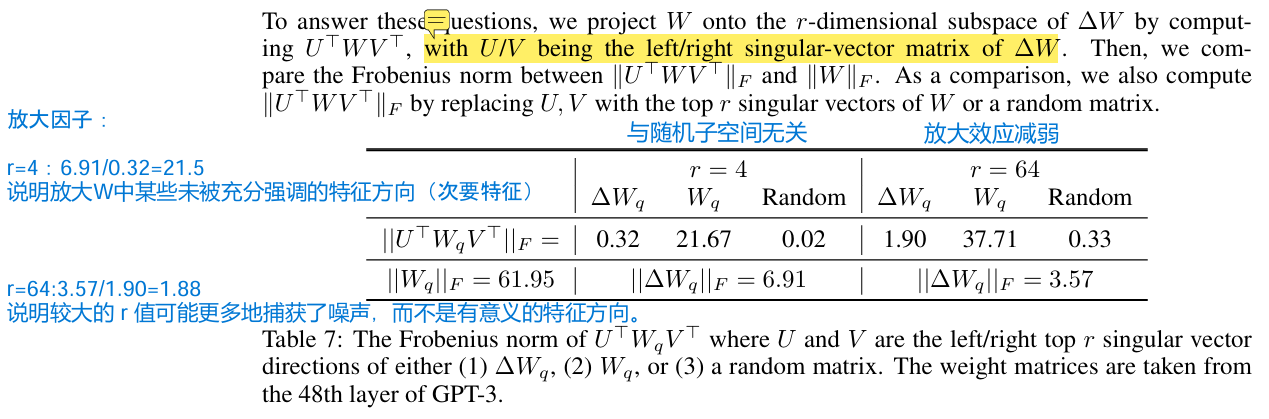

三、适应矩阵ΔW如何与预训练权重矩阵W比较?

四、参数选择总结

4.1 秩(r)的选择

-

起始值:从 r=4 或 r=8 开始调参,平衡参数效率与性能。

-

简单任务(如分类、短文本生成):尝试 r=1~4,极低秩可能已足够。

-

复杂任务(如长文本生成、跨领域适配):逐步增加至 r=8~16。

-

上限建议:通常 r ≤ 64,更高秩可能引入冗余且性价比低。

4.2 权重矩阵的选择

-

优先组合:

-

同时适应查询(

)和值(

)矩阵,性能显著优于单独适应某一矩阵。

-

次优选择:适应所有注意力权重(

、

、

、

)。

-

-

避免选项:

-

仅适应

(键矩阵) 或

(输出矩阵),实验表明效果较差。

-

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?