来源:体积比

1、Ilya 的离开

OpenAI 首席科学家 Ilya Sutskever 在 gpt-4o 发布的第二天后通过推特官宣正式离开 OpenA,打破了自逼宫 Sam Altman 事件后近半年的沉默。

2、宫斗事件前后

让我们把时间线拉回到宫斗事件前(2023 年 11 月份),沿着该事件,从 OpenAI 的公开分享+发布会、产品定义、管理层+员工的推特上找到 OpenAI 转换的蛛丝马迹,一探其中的究竟

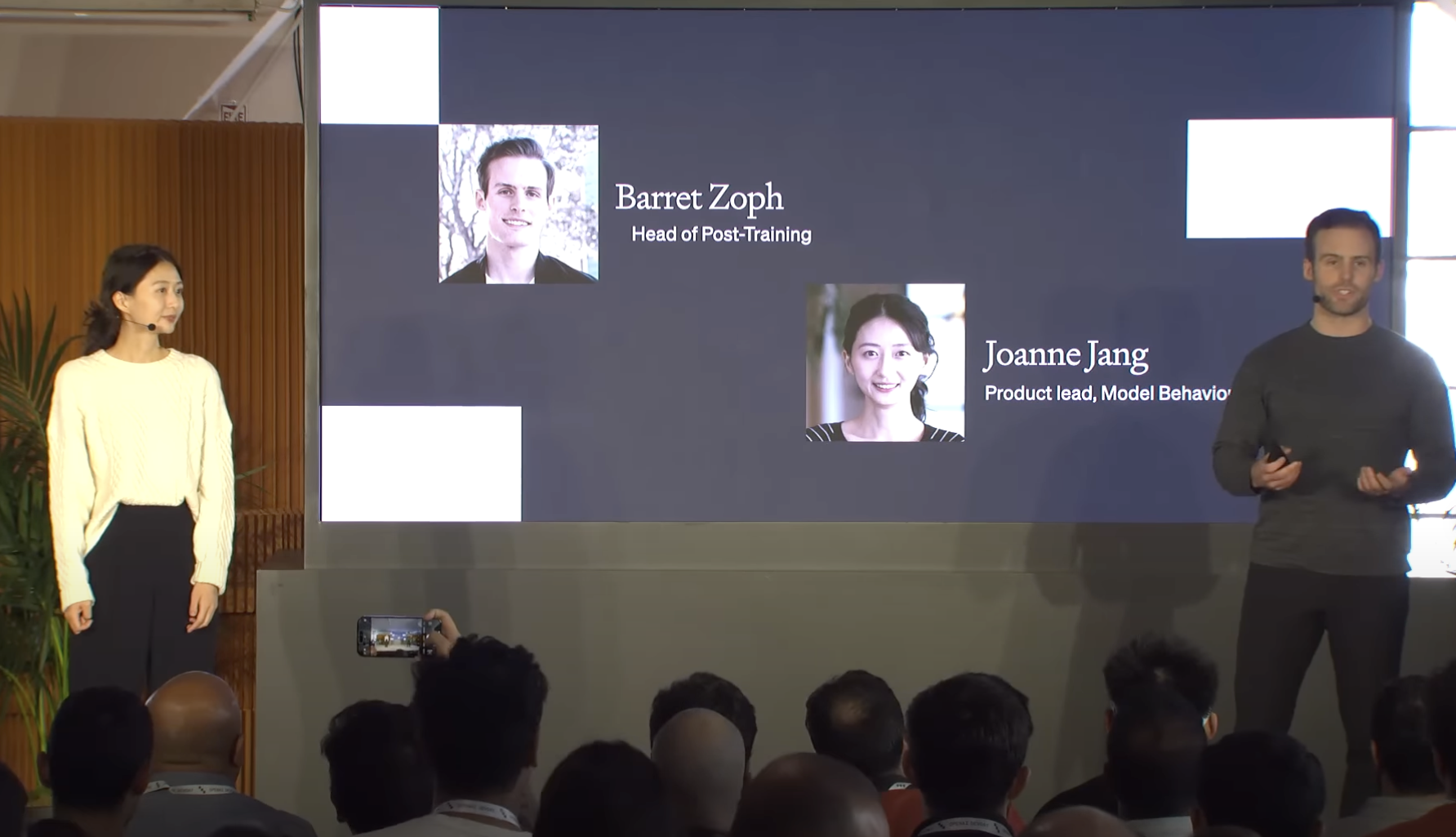

2023 年 11 月 6 日 —— OpenAI 首届开发者大会

产品团队的模型行为产品负责人 Joannan Jang和后训练团队负责人 Barret Zoph(负责将预训练模型与部署到ChatGPT、API和其他研究团队使用进行对齐)。分享了关于 OpenAI 内部产品和研发合作协同的一些思考,彼时还未上演 Ilya Sutskever 与 openai 的宫斗大戏....

核心分享提炼:

产品侧

●在Open AI,

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?