目录

前言

📅大四是整个大学期间最忙碌的时光,一边要忙着备考或实习为毕业后面临的就业升学做准备,一边要为毕业设计耗费大量精力。近几年各个学校要求的毕设项目越来越难,有不少课题是研究生级别难度的,对本科同学来说是充满挑战。为帮助大家顺利通过和节省时间与精力投入到更重要的就业和考试中去,学长分享优质的选题经验和毕设项目与技术思路。

🚀对毕设有任何疑问都可以问学长哦!

大家好,这里是海浪学长计算机毕设专题,本次分享的课题是

🎯基于人工智能的皮革瑕疵自动检测

项目背景

随着皮革制品需求的不断增长,如何提高皮革的生产质量和检测效率成为了行业关注的重点。皮革瑕疵不仅影响产品的外观和使用寿命,还可能导致重大经济损失。传统的瑕疵检测方法通常依赖人工检验,不仅效率低下,而且容易受到人为因素的影响,导致漏检或误检。。通过应用深度学习和计算机视觉技术,可以实现对皮革表面瑕疵的自动识别与分类,提升检测的准确性和效率,进而提高产品质量,降低生产成本。不仅有助于推动智能制造和工业自动化的发展,也为相关企业在竞争中提供了技术优势。

数据集

图像采集可以选择自主拍摄和互联网采集两种方式。在不同的光照条件和背景下拍摄多样化的皮革样本,以确保能够捕捉到各种瑕疵特征。通过搜索引擎和开放的图像库获取相关的皮革瑕疵图像。使用专业的标注工具(如LabelImg),对每张图像进行细致的标注,标出瑕疵的类别和具体位置。标注时需要遵循一致的标准,以确保每个标注的准确性和可重复性。

将数据集划分为训练集、验证集和测试集,以确保模型能在未见数据上进行评估。为了增强模型的鲁棒性,可以采用数据扩展技术,如图像翻转、旋转、缩放和颜色变换等,从而生成更多变体,增加样本数量。这些扩展操作有助于模型更好地适应不同的应用场景,提高其在实际应用中的表现。

设计思路

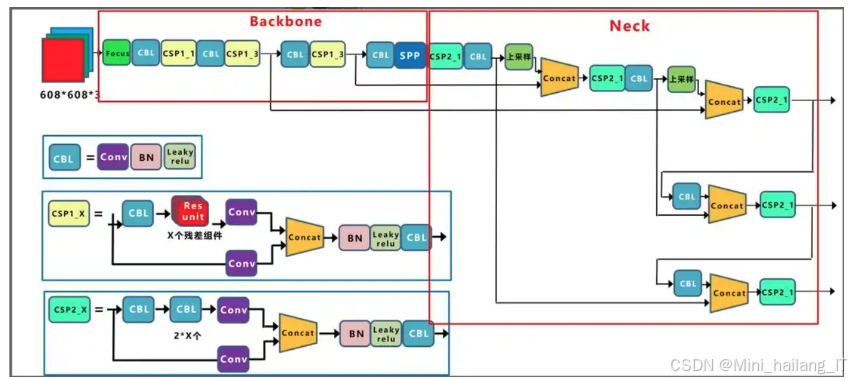

YOLOv5是一种高效的目标检测模型,其设计理念是实现快速、准确的目标检测。YOLOv5的模型结构由多个关键组件组成,主要包括主干网络(Backbone)、颈部网络(Neck)和头部网络(Head)。

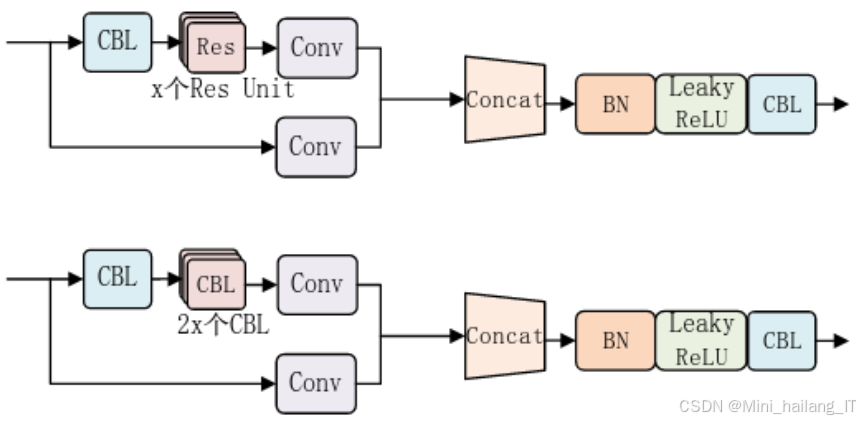

主干网络的主要任务是从输入图像中提取特征。YOLOv5使用了CSPNet作为其主干结构,旨在提高特征提取的效率和性能。CSPNet通过将特征图划分为两部分并进行交叉连接,能够有效地降低计算复杂度,同时保持较高的特征表达能力。YOLOv5还引入了多种卷积层,如卷积层、激活层、Batch Normalization等,来增强特征提取的效果。颈部网络的作用是对从主干网络提取到的特征进行融合,以便为目标检测任务提供更丰富的特征表示。YOLOv5采用了PANet作为颈部结构,通过自上而下和自下而上的路径融合不同层次的特征。这种融合方式可以有效地结合高层语义信息和低层细节信息,从而提高模型在复杂场景中的检测能力。

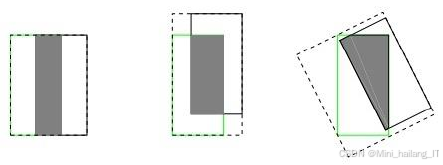

头部网络负责最终的检测任务,包括边界框回归和类别预测。YOLOv5通过多个输出层来生成不同尺度的检测结果,以适应不同大小的目标。模型在每个输出层上都会进行边界框的预测,并输出对应的类别概率。YOLOv5采用了独特的锚框机制,通过对不同尺寸的锚框进行回归,从而实现对目标的精确定位。YOLOv5使用了Leaky ReLU作为激活函数,帮助模型在训练过程中保持较好的梯度流动,避免梯度消失的问题。同时,YOLOv5采用了CIoU作为损失函数,不仅考虑了边界框的重叠区域,还考虑了边界框的中心点距离和宽高比,以提高检测精度。YOLOv5在训练过程中广泛采用数据增强技术,如随机缩放、翻转、裁剪、颜色变换等,以增强模型的鲁棒性。通过这些数据增强手段,模型能够更好地适应不同的场景和条件,从而提高检测效果。

从皮革生产线收集大量的图像数据,这些图像应包括不同类型的皮革瑕疵,如划痕、污点、色差等。确保数据集的多样性和代表性,以便模型能够学习到不同类别瑕疵的特征。对收集到的图像进行清洗和标注。清洗步骤包括去除模糊或不相关的图像。随后,使用标注工具(如LabelImg)对每张图像进行标注,标记出瑕疵的位置和类型。预处理后,图像应进行缩放、裁剪和归一化,以便输入到模型中。

def preprocess_images(image_dir, output_dir, size=(224, 224)):

if not os.path.exists(output_dir):

os.makedirs(output_dir)

for img_name in os.listdir(image_dir):

img_path = os.path.join(image_dir, img_name)

img = cv2.imread(img_path)

img_resized = cv2.resize(img, size)

cv2.imwrite(os.path.join(output_dir, img_name), img_resized)

image_dir = 'path/to/collected_images'

output_dir = 'path/to/preprocessed_images'

preprocess_images(image_dir, output_dir)选择合适的深度学习模型进行瑕疵检测。常用的模型包括YOLO、Faster R-CNN和RetinaNet等。可以选择预训练的模型进行微调,以适应皮革瑕疵检测任务。构建模型时,需要定义网络架构、损失函数和优化器。在模型训练阶段,使用准备好的训练集对模型进行训练。定义损失函数和优化器,设置训练参数(如学习率、批量大小等),并运行训练循环。可以使用早停策略监控验证集性能,以防止过拟合。

import torch

from torchvision import models

class LeatherDefectDetectionModel(torch.nn.Module):

def __init__(self, num_classes):

super(LeatherDefectDetectionModel, self).__init__()

self.base_model = models.resnet50(pretrained=True)

self.base_model.fc = torch.nn.Linear(self.base_model.fc.in_features, num_classes)

def forward(self, x):

return self.base_model(x)

model = LeatherDefectDetectionModel(num_classes=3) # 假设有三种瑕疵训练完成后,使用验证集对模型进行评估,计算准确率、召回率等指标,以了解模型的性能。根据评估结果进行超参数调优,调整学习率、批量大小等,以提升模型效果。经过充分训练和评估后,最终模型可以进行部署,以便在实际应用中进行瑕疵检测。可以将模型保存为文件格式,并在需要时加载进行推理。

from sklearn.metrics import accuracy_score

def evaluate_model(model, val_loader):

model.eval()

all_preds = []

all_labels = []

with torch.no_grad():

for inputs, labels in val_loader:

outputs = model(inputs)

_, predicted = torch.max(outputs, 1)

all_preds.extend(predicted.numpy())

all_labels.extend(labels.numpy())

accuracy = accuracy_score(all_labels, all_preds)

print(f'Validation Accuracy: {accuracy * 100:.2f}%')

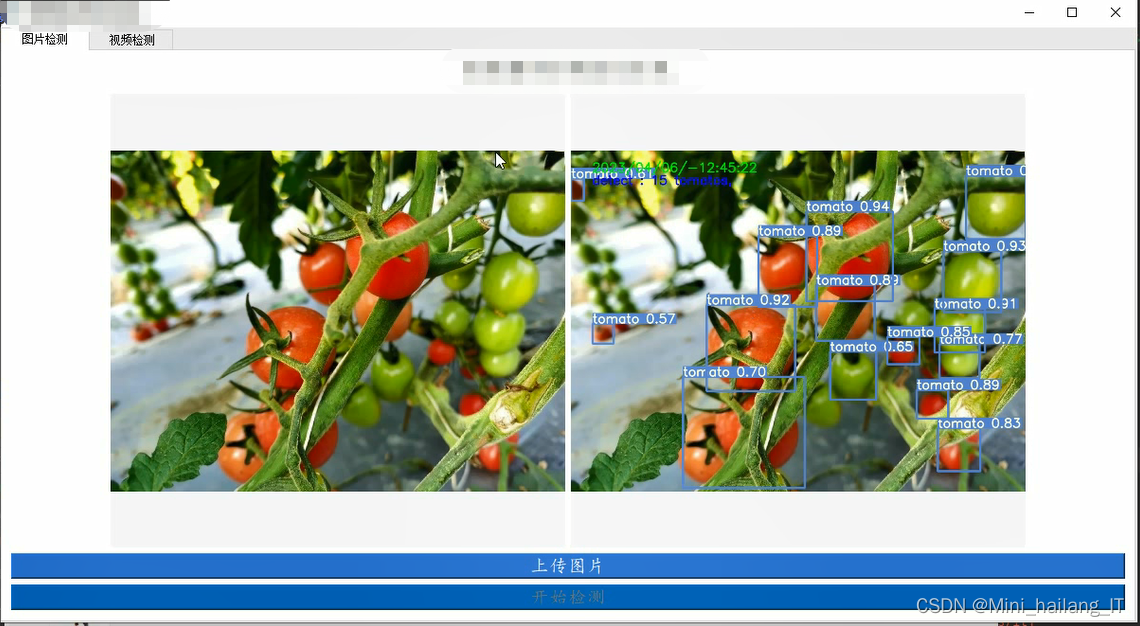

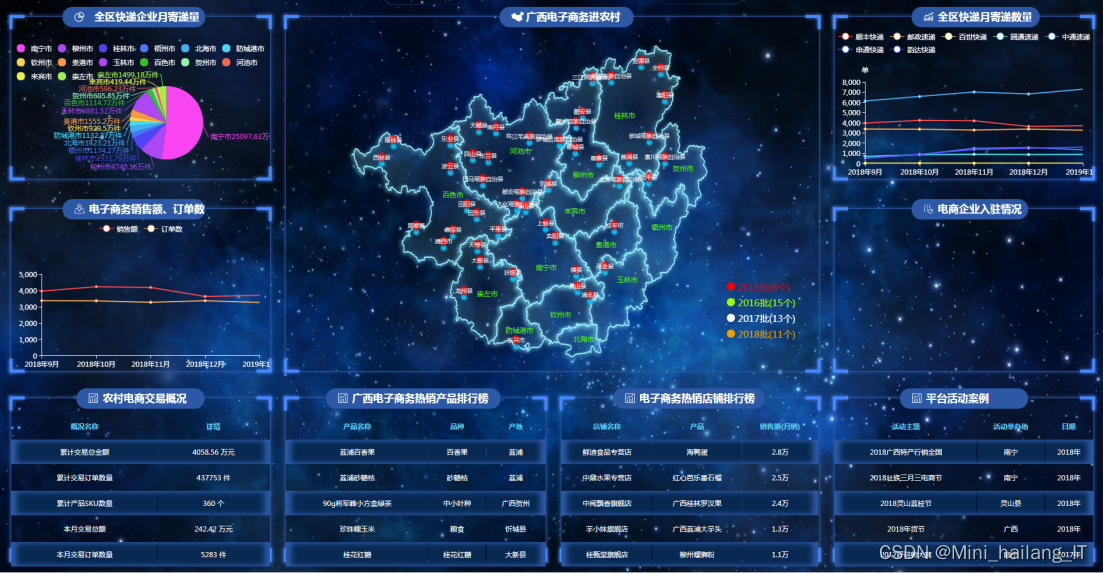

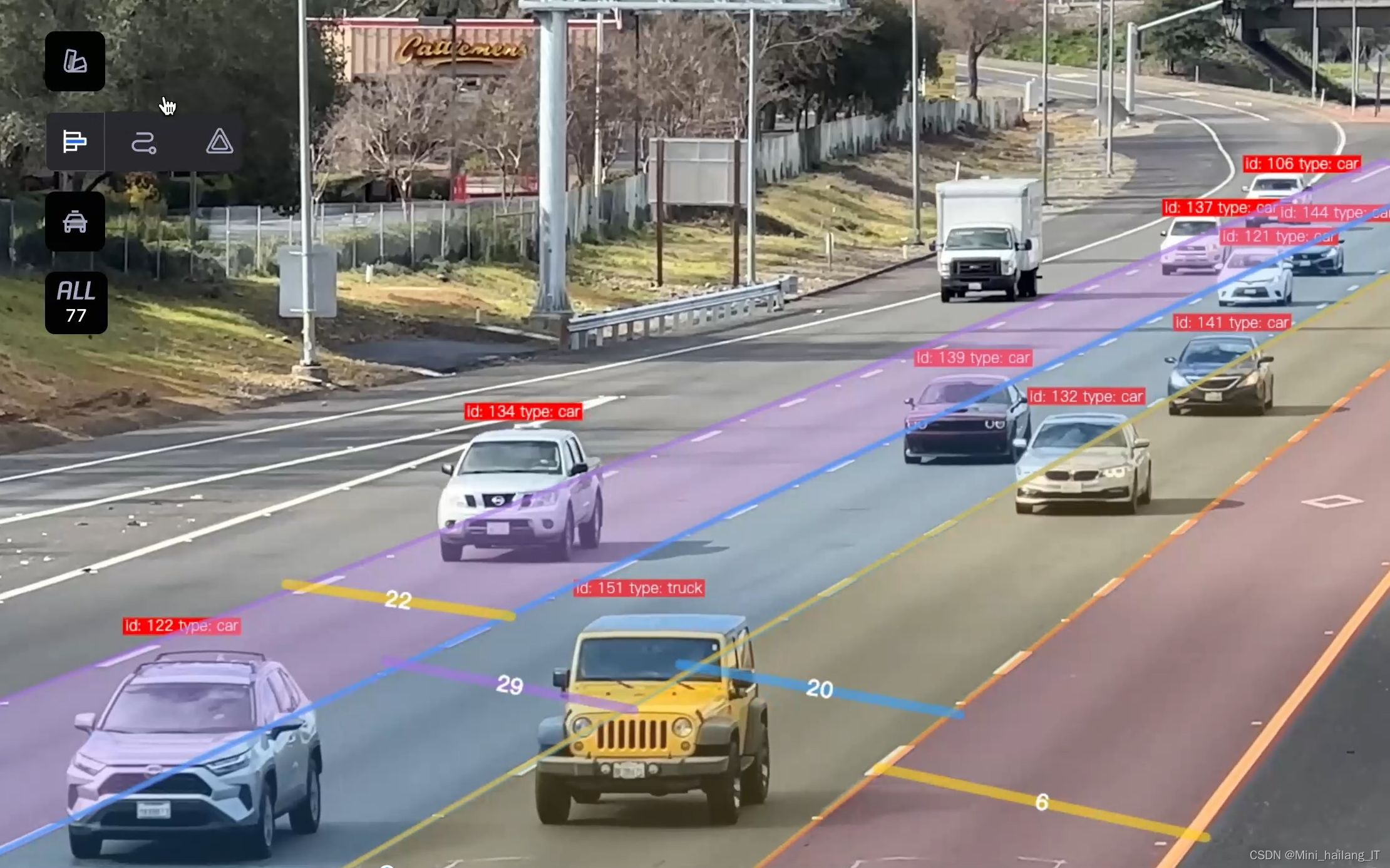

evaluate_model(model, val_loader)海浪学长项目示例:

3183

3183

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?