利用Python构建Wiki中文语料词向量模型试验

本实例主要介绍的是选取wiki中文语料,并使用python完成Word2vec模型构建的实践过程,不包含原理部分,旨在一步一步的了解自然语言处理的基本方法和步骤。文章主要包含了开发环境准备、数据的获取、数据的预处理、模型构建和模型测试四大内容,对应的是实现模型构建的五个步骤。

一、 开发环境准备

1.1 python环境

在python官网下载计算机对应的python版本。

1.2 gensim模块

(1)安装模块

下载完成后,在python安装目录下的Scripts目录中执行cmd命令进行安装。

pip install numpy

pip install scipy

pip install gensim

(2)验证模块是否安装成功

输入python命令进入python命令行,分别输入“import numpy; import scipy; import gensim; ”没有报错,即安装成功!

二、Wiki数据获取

2.1 Wiki中文数据的下载

到wiki官网下载中文语料,下载完成后会得到命名为zhwiki-latest-pages-articles.xml.bz2的文件,大小约为2.45G,里面是一个XML文件。

下载地址如下:https://dumps.wikimedia.org/zhwiki/latest/zhwiki-latest-pages-articles.xml.bz2

2.2 将XML的Wiki数据转换为text格式

(1)python实现

编写python程序将XML文件转换为text格式,使用到了gensim.corpora中的WikiCorpus函数来处理维基百科的数据,并对数据进行分词处理。python文件命名为1.py。

(2)运行程序文件

在代码文件夹下运行如下cmd命令行,即可得到转换后生成的文件zhiwiki.txt。

python 1.py

(3)得到运行结果

经过约20分钟处理,得到一个1.68G的txt文件。

三、Wiki数据预处理

3.1 中文繁体替换成简体

Wiki中文语料中包含了很多繁体字,需要转成简体字再进行处理,这里使用到了OpenCC工具进行转换。

(1)python实现

使用到了opencc来进行繁体字到简体字的转换。python文件命名为2.py。

pip install opencc

(2)运行程序文件

在代码文件夹下运行如下cmd命令行,约1小时,即可得到转换后生成的文件zhiwiki.txt。

python 2.py

(3)结果查看

生成约1.68G的txt文件wikisimple.txt,可以在浏览器中打开

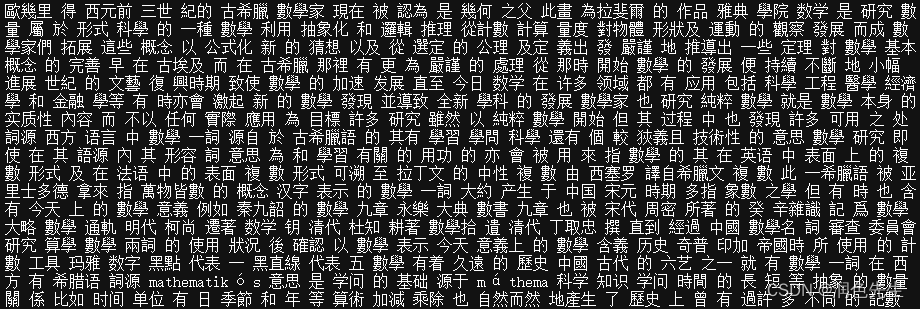

zhiwiki.txt繁体中文示例截图如下所示:

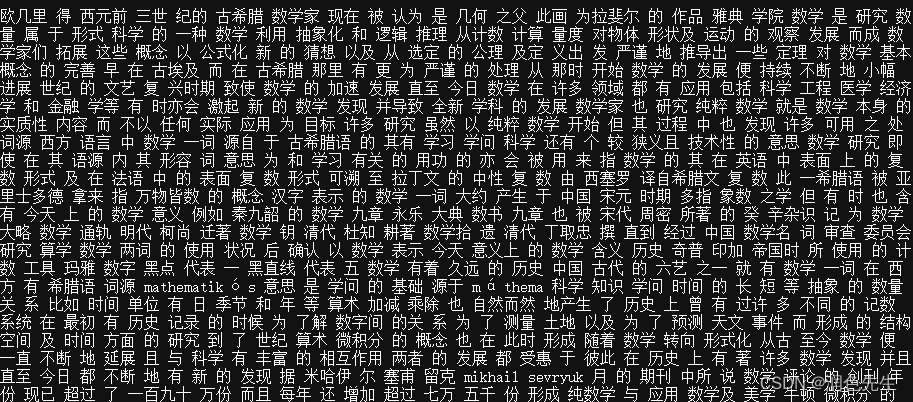

转换后的wikisimple.txt简体中文截图如下所示:

四、Word2Vec模型训练

(1)运行程序文件

在代码文件夹下运行如下cmd命令行,约30分钟,即可得到词向量模型。

python 3.py

(2)运行结果查看

2017-05-03 21:54:14,887: INFO: training on 822697865 raw words (765330910 effective words) took 1655.2s, 462390 effective words/s

2017-05-03 21:54:14,888: INFO: saving Word2Vec object under /Users/sy/Desktop/pyRoot/wiki_zh_vec/wiki.zh.text.model, separately None

2017-05-03 21:54:14,888: INFO: not storing attribute syn0norm

2017-05-03 21:54:14,889: INFO: storing np array 'syn0' to /Users/sy/Desktop/pyRoot/wiki_zh_vec/wiki.zh.text.model.wv.syn0.npy

2017-05-03 21:54:16,505: INFO: storing np array 'syn1neg' to /Users/sy/Desktop/pyRoot/wiki_zh_vec/wiki.zh.text.model.syn1neg.npy

2017-05-03 21:54:18,123: INFO: not storing attribute cum_table

2017-05-03 21:54:26,542: INFO: saved /Users/sy/Desktop/pyRoot/wiki_zh_vec/wiki.zh.text.model

2017-05-03 21:54:26,543: INFO: storing 733434x400 projection weights into /Users/sy/Desktop/pyRoot/wiki_zh_vec/wiki.zh.text.vector

摘取了最后几行代码运行信息,代码运行完成后得到如下四个文件,其中wiki.zh.text.model是建好的模型,wiki.zh.text.vector是词向量。

五、模型测试

模型训练好后,来测试模型的结果。Python代码如下,文件名为4.py。

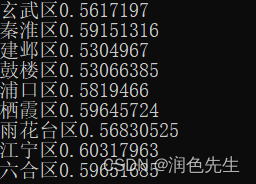

运行文件得到结果,即可查看给定词的相关性。

至此,使用python对中文wiki语料的词向量建模就全部结束了,wiki.zh.text.vector中是每个词对应的词向量,可以在此基础上作文本特征的提取以及分类。所给出代码中文件路径均需修改为当前路径。

参考资料:

https://github.com/AimeeLee77/wiki_zh_word2vec

1272

1272

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?