环境选项:

--scenario: MPE 中的环境 (默认: "simple")

--max-episode-len 环境的每个周期的长度 (默认: 25)

--num-episodes 训练周期总数 (默认: 60000)

--num-adversaries: 环境中的 adversary 数量 (默认: 0)

--good-policy: 环境中 good policy 算法 (默认: "maddpg"; 选项: {"maddpg", "ddpg"})

--adv-policy: 环境中 adversary policy 算法 (默认: "maddpg"; 选项: {"maddpg", "ddpg"})

核心训练参数:

--lr: 学习速率 (默认: 1e-2)

--gamma: 损失因子 (discount factor) (默认: 0.95)

--batch-size: Batch 大小 (默认: 1024)

--num-units: 多层神经网络层数 (默认: 64)

保存

--exp-name: 实验的名称,用以保存结果。 (默认: None)

--save-dir: 保存训练结果和模型的位置 (默认: "/tmp/policy/")

--save-rate: 模型将会以这个周期频率进行保存 (默认: 1000)

--load-dir: 载入训练结果和模型的位置 (默认: "")

评估

--restore: 恢复在load-dir的训练结果, 并且继续训练 (默认: False)

--display: 展示训练结果, 但不继续训练 (默认: False)

--benchmark: 对训练结果进行基准评估, 保存结果到 benchmark-dir 文件夹 (默认: False)

--benchmark-iters: 执行基准评估的训练周期 (默认: 100000)

--benchmark-dir: 存放基准数据的目录 (默认: "./benchmark_files/")

--plots-dir: 存放训练曲线的目录 (默认: "./learning_curves/")

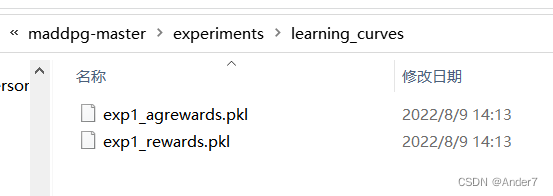

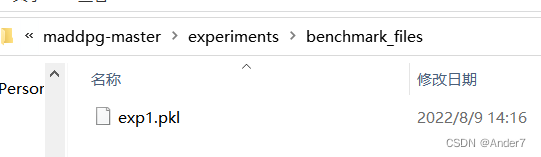

1、首先需要在experiments下自建learning_curves和benchmark_files文件夹,否则会报错或者模型数据无法保存;文件名也可以更改为exp1等

(项目目录:E:\PycharmProjects\pythonProject\maddpg-master)

(1)E:\tmp\policy :保存了训练结果和模型

(2)项目/experiments/learning_curves:保存了训练曲线

(3)项目/experiments/benchmark_files:保存了对训练结果进行评估

2、训练

python train.py --scenario simple_world_comm --num-episodes 60000 --exp-name exp1

或

在文件中直接更改参数,然后run .py(display,restore,benchmark训练时要为False,否则会读取以前的训练数据,继续训练可以用restore)

继续训练:

python train.py --scenario simple_world_comm --restore --num-episodes 60000

或

在文件中直接更改参数

3、评估

python train.py --scenario simple_world_comm --benchmark

或

在文件中直接更改参数benchmark default = True

4、可视化结果

python train.py --scenario simple_world_comm --display

或

在文件中直接更改参数display default = True

5、显示训练曲线

后续。。

本文介绍了一个基于MADDPG算法的多智能体训练框架,提供了详细的环境配置选项与核心训练参数设置说明,并指导如何进行训练、评估及结果可视化。

本文介绍了一个基于MADDPG算法的多智能体训练框架,提供了详细的环境配置选项与核心训练参数设置说明,并指导如何进行训练、评估及结果可视化。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?