根据少量演示和简单指令完成听、说、读、写、画等多模态任务是人类的基本能力。对于AI系统而言,如何利用多模态环境下的各种信息、实现少样本多模态理解与生成是有待攻克的「技术高地」。

2023年12月21日,智源研究院开源发布新一代多模态基础模型Emu2,通过大规模自回归生成式多模态预训练,显著推动多模态上下文学习能力的突破。Emu2在少样本多模态理解任务上大幅超越Flamingo-80B、IDEFICS-80B等主流多模态预训练大模型,在包括VQAv2、OKVQA、MSVD、MM-Vet、TouchStone在内的多项少样本理解、视觉问答、主体驱动图像生成等任务上取得最优性能。

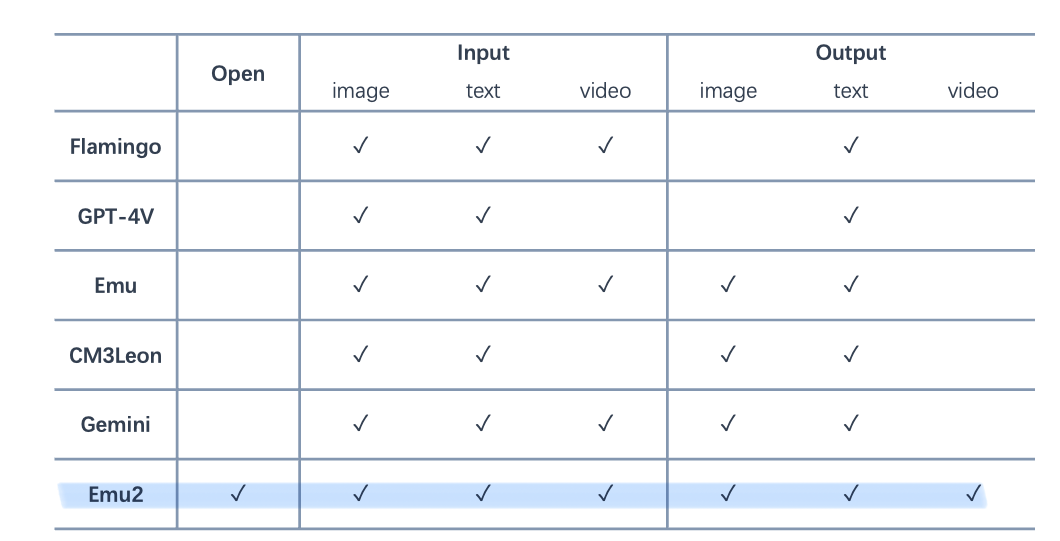

Emu2模型在各项任务上和Flamingo、GPT-4V、Gemini等模型对比情况

下周二下午2点,Emu2两位作者将进行线上直播,欢迎扫码报名

报告主题:Emu2:新一代生成式多模态模型

报告嘉宾:

BAAI-视觉模型研究中心崔玉峰,主要从事多模态预训练算法和图像生成算法研究

BAAI-视觉模型研究中心孙泉,主要从事多模态预训练算法和基础模型研究

时间: 2023年12月27日(周二) 14:00-15:00

地点: 线上直播

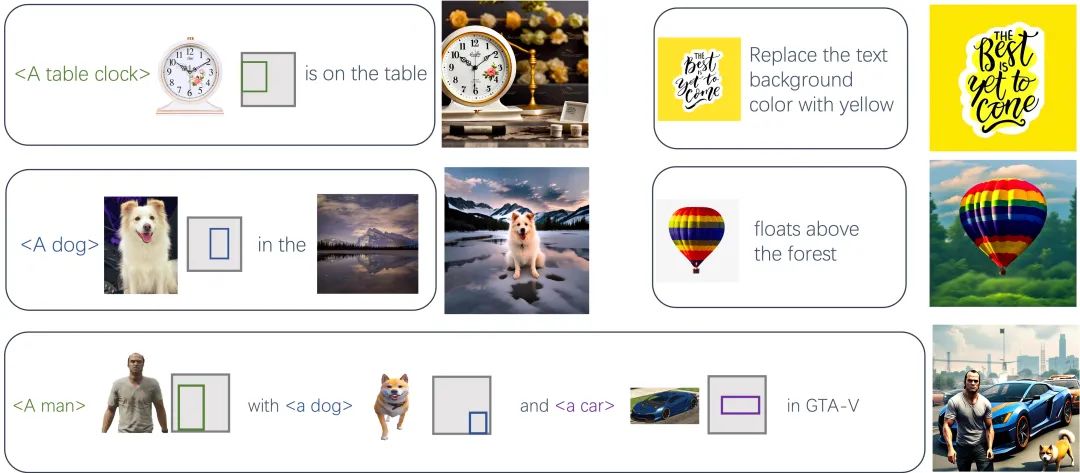

Emu2是目前最大的开源生成式多模态模型,基于Emu2微调的Emu2-Chat和Emu2-Gen模型分别是目前开源的性能最强的视觉理解模型和能力最广的视觉生成模型。Emu2-Chat可以精准理解图文指令,实现更好的信息感知、意图理解和决策规划。Emu2-Gen可接受图像、文本、位置交错的序列作为输入,实现灵活、可控、高质量的图像和视频生成。

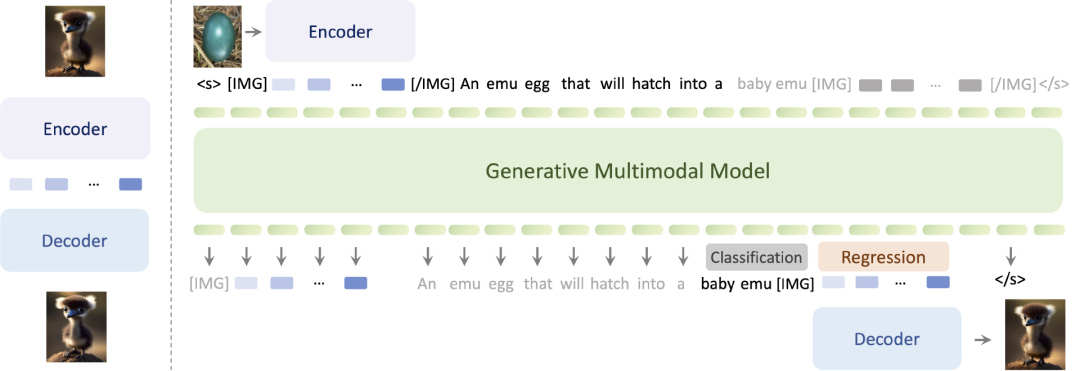

相较2023年7月发布的第一代「多模态to多模态」Emu模型,Emu2使用了更简单的建模框架,训练了从编码器语义空间重建图像的解码器、并把模型规模化到37B参数实现模型能力和通用性上的突破。此外仍延续采用大量图、文、视频的序列,建立基于统一自回归建模的多模态预训练框架,将图像、视频等模态的token序列直接和文本token序列交错在一起输入到模型中训练。

↓ Emu2的模型、代码均已开源,并提供Demo试用。了解更多技术细节,请参考Emu2论文

项目:https://baaivision.github.io/emu2/

模型:https://huggingface.co/BAAI/Emu2

代码:https://github.com/baaivision/Emu/tree/main/Emu2

Demo:https://huggingface.co/spaces/BAAI/Emu2

论文:https://arxiv.org/abs/2312.13286

SOTA理解与生成

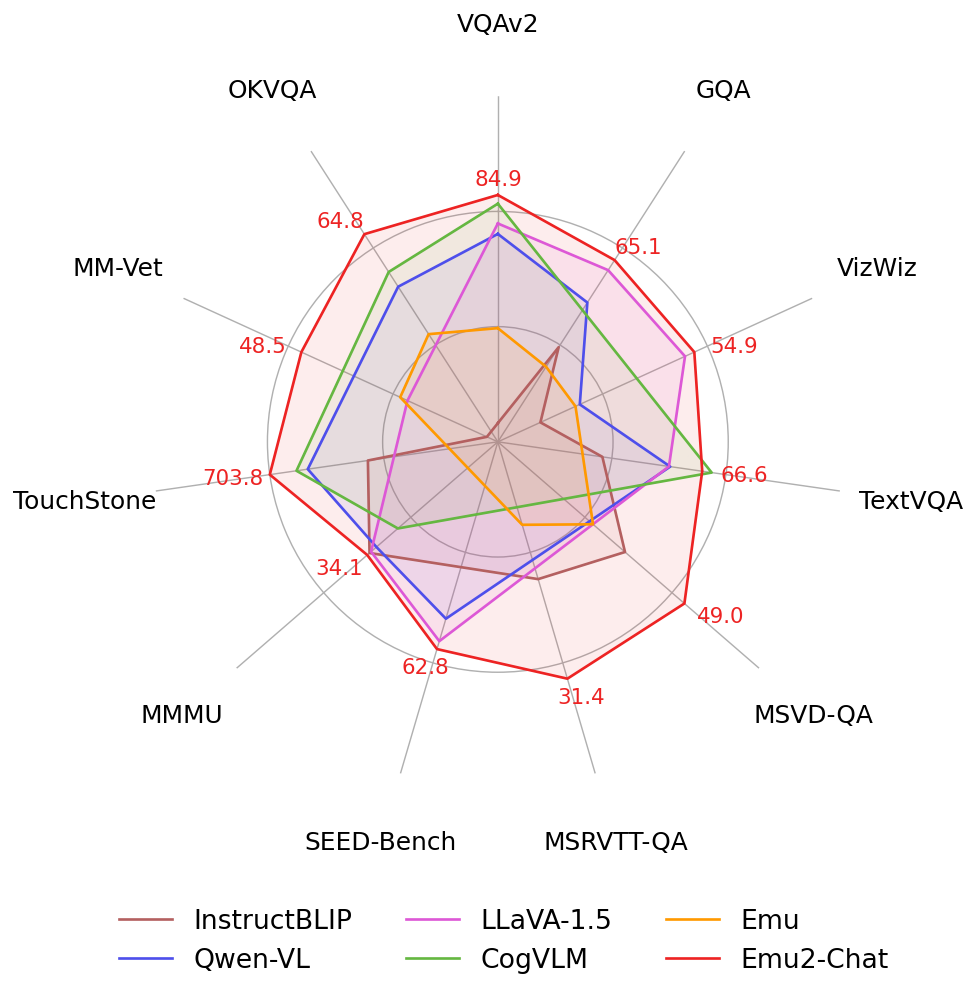

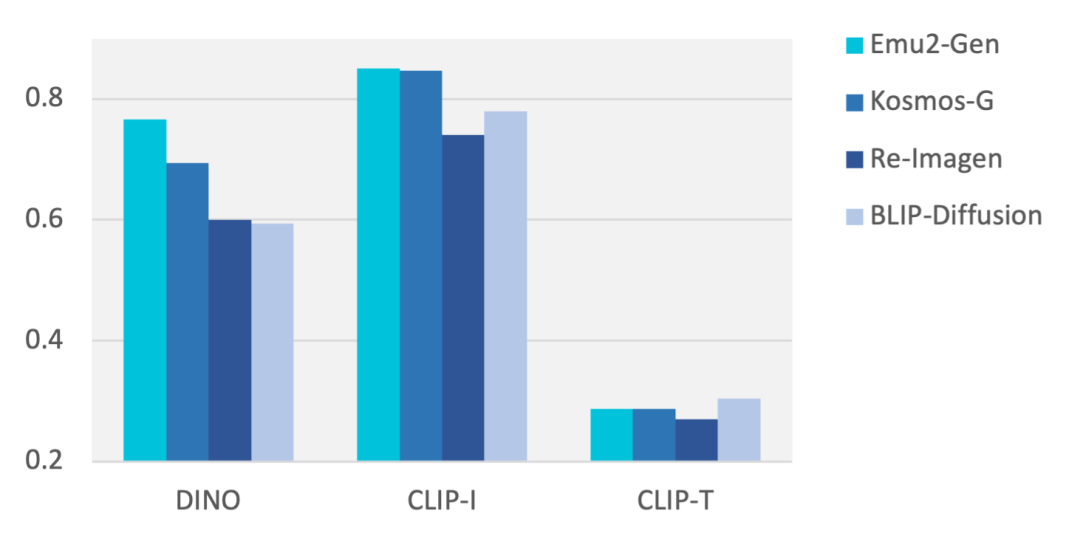

通过对多模态理解和生成能力的定量评测,Emu2在包括少样本理解、视觉问答、主体驱动图像生成在内的多个任务上取得最优性能。

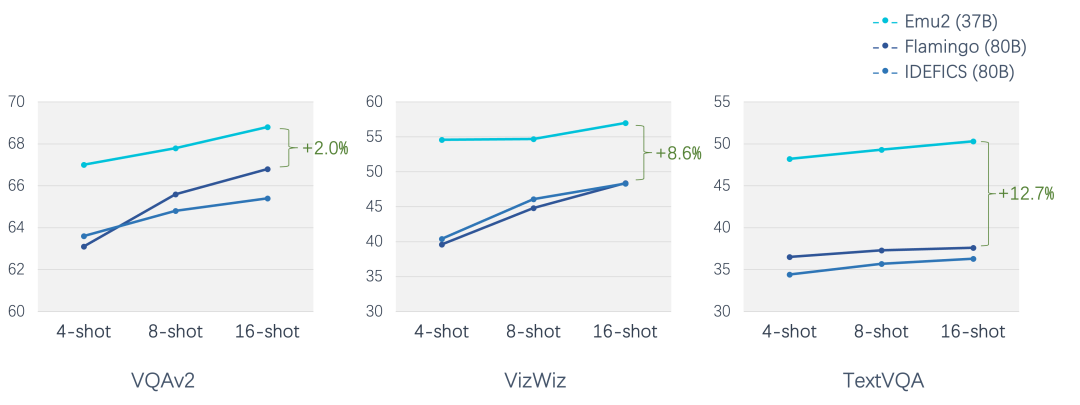

在少样本评测上,Emu2在各个场景下显著超过Flamingo-80B,例如在16-shot TextVQA上较Flamingo-80B 超过12.7个点。

经过指令微调的Emu2可以对图像和视频输入进行自由问答,以统一模型在VQAv2、OKVQA、MSVD、MM-Vet、TouchStone等十余个图像和视频问答评测集上取得最优性能。

在零样本的DreamBench主体驱动图像生成测试上,较此前方法取得显著提升,例如比Salesforce的BLIP-Diffusion的CLIP-I分数高7.1%, 比微软的Kosmos-G的DINO分数高7.2%。

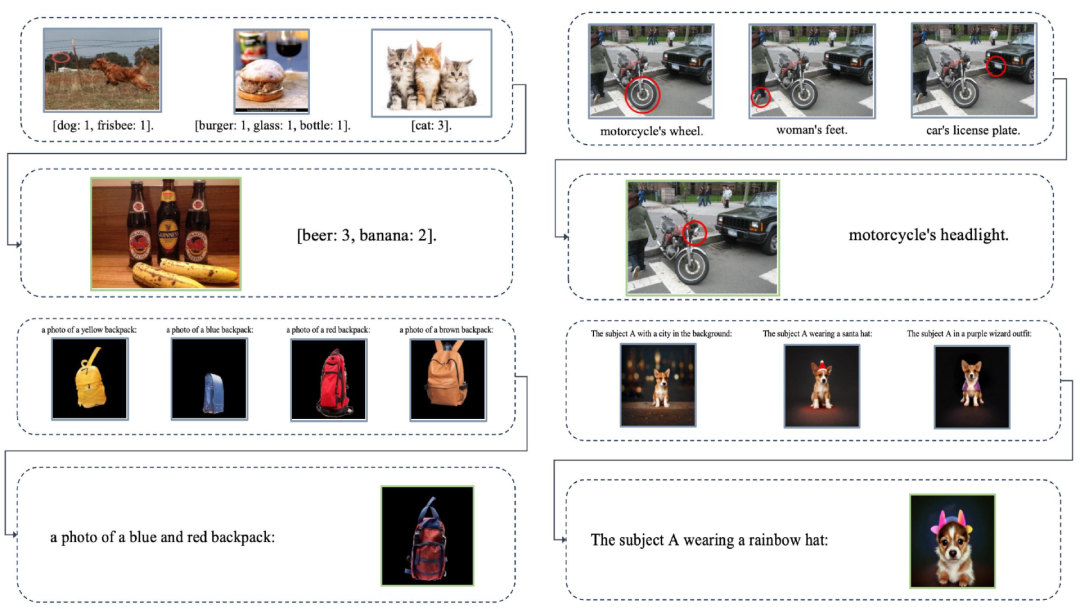

多模态上下文学习

生成式预训练完成后,Emu2 具备全面且强大的多模态上下文学习能力。基于几个例子,模型可以照猫画虎的完成对应理解和生成任务。例如在上下文中描述图像、在上下文中理解视觉提示(覆盖图像上的红圈)、在上下文中生成类似风格的图像、在上下文中生成对应主体的图像等。

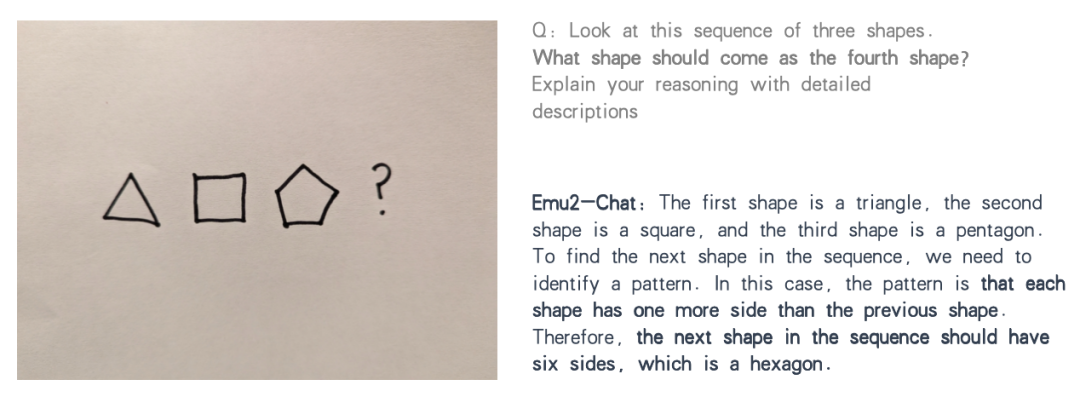

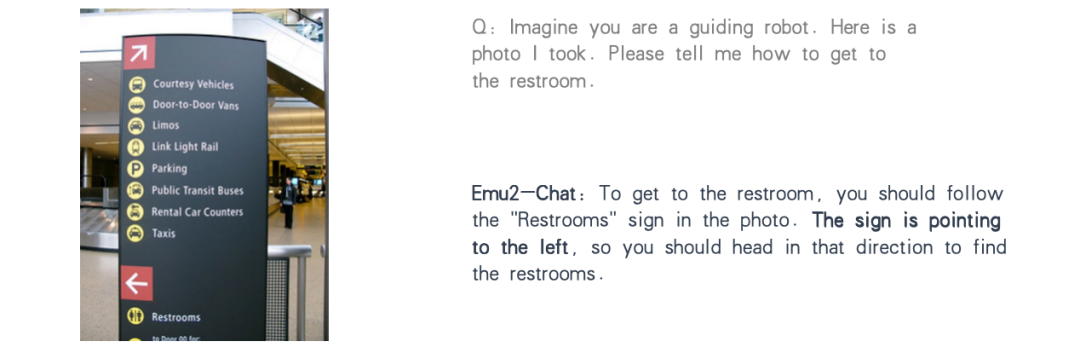

强大的多模态理解

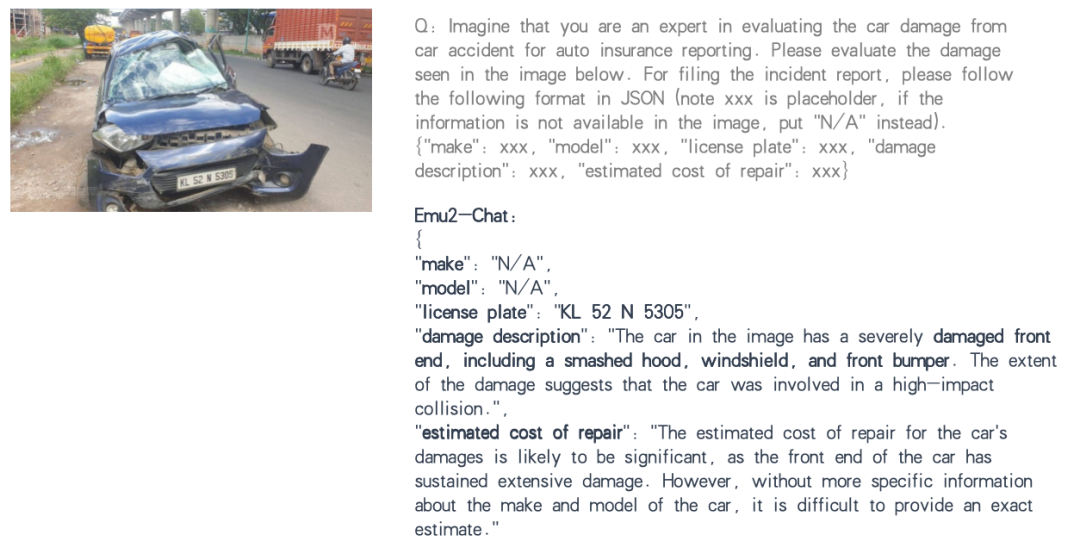

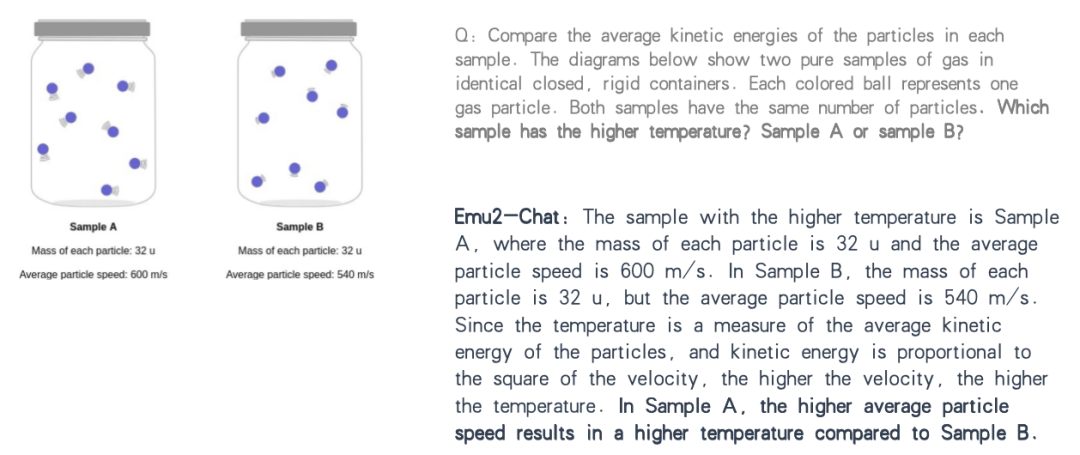

经过对话数据指令微调的Emu2-Chat,可以精准理解图文指令、更好的完成多模态理解任务。例如推理图像中的要素、读指示牌提供引导、按要求提取和估计指定属性、回答简单的专业学科问题等。

基于任意prompt序列的图像生成

经过高质量图像微调的Emu2-Gen,可以接受图像、文本、位置交错的序列作为输入,生成对应的高质量图像,这样的灵活性带来高可控性。

例如,生成指定位置、指定主体的熊和向日葵:

生成指定位置、指定主体、指定风格的宠物狗和小鸸鹋的合影图像:

更多的根据图文序列生成的例子:

基于任意prompt序列的视频生成

进一步的,Emu2支持基于任意prompt序列的视频生成。基于文本、图文交错、图文位置交错的序列,可以生成对应的高质量视频。

统一的生成式预训练

Emu2的训练方法是在多模态序列中进行生成式预训练。使用统一的自回归建模方式,根据当前已生成的 token 预测下一个视觉或文本token。相比Emu1,Emu2使用了更简单的建模框架、训练了更好的从特征重建原图的解码器、并把模型规模化到37B参数。

智源研究院开源的Emu2模型通过大规模预训练,显著提升少样本多模态理解能力,在视觉问答、图像生成等任务中表现出色。报告将详细介绍模型架构和应用成果。

智源研究院开源的Emu2模型通过大规模预训练,显著提升少样本多模态理解能力,在视觉问答、图像生成等任务中表现出色。报告将详细介绍模型架构和应用成果。

28

28

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?