误差分析

1.与学习曲线一样,误差分析也是检验学习算法。可以用交叉验证集进行手动检查,也可以通过数值估计得办法:利用对比的方法来分析。

2.偏斜类:偏斜类是说有两种样本,一种样本的数量远远高于其他样本的数量,于是我们忽略了输入X的情况,将所有的y都设置为较多的那一类样本的值。这种情况下我们使用交叉验证错误率(这是种分类错误率)的方法检验不出来错误,也无法改进。于是,引进查准率和召回率。

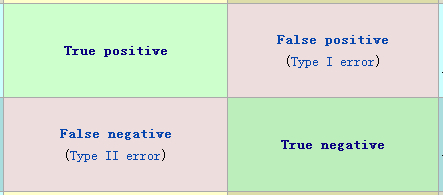

3.查准率和召回率(我们针对y=1的情况)

| 实际 positive(y=1)(相关) | 实际y=0(不相关) | |

|---|---|---|

| 预测到的 | A | B |

| 没有预测到的 | C | D |

Recall召回率=A/(A+C),Precision查准率=A/(A+B)

Precision = TP/(TP+FP); 查准率, 在所有被判断为正样本中, 真正正样本的数量.

Recall = TP/(TP+FN); 召回率, 在所有正样本中, 被识别为正样本的数量.

如果我们想要很高的准确率,那么我们可以将h>阈值中的阈值设置得小一些,这样预测结果准确一些但是对应的召回率低一些,查准率也会高一些。

如果我们不想要漏掉预测positive的情况,那么我们可以将阈值提高一些,这样预测的positive更多一些,这样的话召回率会高一些,查准率会低一些。

召回率希望结果越真实越好。查准率希望结果越相关越好。两者都是越大越好。

4.F值:

由于做P和R的平均值来进行误差分析效果并不好,所以我们采用了加权平均F值来衡量。

我们在算法选择的时候,可以试用不同的临界值,选择F较高的算法。

9088

9088

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?