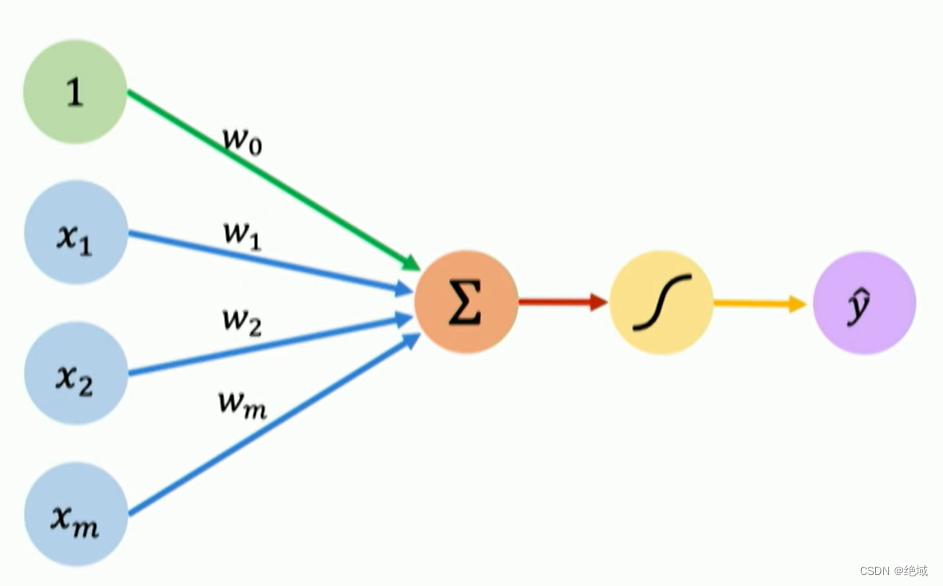

许多深度学习教程都是从这张图开始的,这是多层感知机的基础结构——一个神经元。一个神经元包含如下组成部分:输入、权重、偏置、激活函数。其中输入和权重很好理解,而偏置和损失函数需要结合数学定义来看。

神经元从数学上可以被定义为

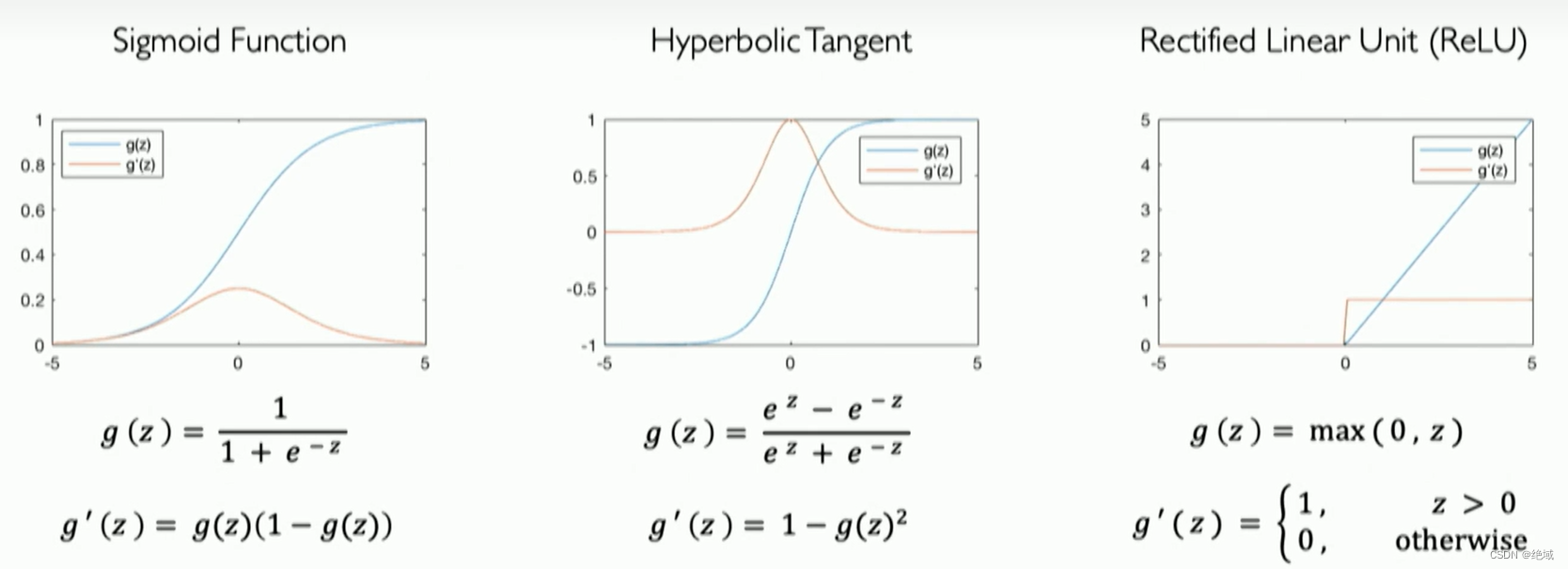

观察这个表达式可以发现,输入和权重组合是线性的,如果仅仅使用这两者进行计算,无论堆叠多少神经元,最终都只能表示输入的线性组合关系;但现实世界显然很难用变量的线性组合来描述,因而我们需要引入激活函数的概念。激活函数提供了神经网络的非线性特征,经典的激活函数有sigmoid、relu、tanh等,图像如下,

偏置这个概念与激活函数是绑定的,它提供了激活函数“激活”的条件。以relu这个激活函数为例,只有当时,该神经元的输出才不为0,即处于“激活”状态。在其余激活函数上也存在该性质——只有

超过某一阈值时,神经元才会输出一个较显著的值。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?