点击下方卡片,关注“具身智能之心”公众号

作者 | 具身智能之心 编辑 | 具身智能之心

本文只做学术分享,如有侵权,联系删文

更多干货,欢迎加入国内首个具身智能全栈学习社区:具身智能之心知识星球(戳我),这里包含所有你想要的。

在人工智能的快速演进中,具身智能逐渐成为一个重要的研究领域,展现了从单一数据源到迁移学习,再到空间智能与一脑多形的发展历程。这一转变不仅推动了机器人技术的进步,也为实现更复杂的智能系统奠定了基础。

一、单一数据源的限制

最初,机器人学习主要依赖于单一数据源进行训练。这种方法虽然在特定任务上取得了一些成功,但往往缺乏灵活性和适应性。单一数据源的模型在面对新环境或新任务时,表现出明显的局限性。例如,一款专注于执行特定操作的机器人在新的工作场景中可能会遇到困难,难以有效应对变化。

此外,研究模型的结构对成功率也起到了重要作用。以行为克隆(Behavior Cloning, BC)为例,传统的深度学习方法在模仿学习中常常依赖于直接从专家示例中学习,但这种方法在面对复杂环境时,容易受到训练数据的限制,导致模型的泛化能力不足。

随着技术的进步,新的模型结构不断涌现。近年来,随着 Transformer 在文本处理领域的成功,计算机视觉(CV)也逐渐迎来了新的发展。RT1 首次将 Transformer 应用到机器人控制中,展示了其在动态环境中的潜力。同时,扩散(Diffusion)模型在图像生成领域的火热发展为具身智能提供了新的思路。扩散模型现已以 2D 输入的方式应用于机器人控制,后续的 3D Diffusion Actor 和 3D Diffusion Policy 等新型模型结构,通过利用扩散模型的强大生成能力,使得机器人能够在更复杂的三维环境中进行有效的决策和控制。这些模型不仅提升了模仿学习的成功率,还增强了机器人在动态环境中的适应能力。

为了克服这些局限性,研究者们开始探索更为复杂的学习机制,以增强机器人的适应能力和智能水平。

二、迁移学习的崛起

迁移学习的引入为具身智能的发展注入了新的活力。引入大模型思想,或借助大模型,或借助相关数据,迁移学习使得机器人能够更快地适应新任务。这一方法的核心在于利用已有的知识库,提升学习效率和效果。

例如,RT-2 首次证明利用网络多模态数据预训练同样可以提升机器控制能力,随后 Roboflamingo 和 Obouniview 分别借助多模态大模型及自动驾驶相关技术进一步提升效果。GR-2 则通过视频生成技术实现了更高效的学习和适应。

然而,尽管迁移学习在预训练阶段表现出色,但在实际应用中,模型仍然需要在特定机器的单一数据上进行微调(fine-tuning)。这种微调过程使得模型能够更好地适应特定任务和环境,从而提高其在实际应用中的性能。

三、空间智能与一脑多形

随着技术的不断进步,具身智能逐渐向空间智能和一脑多形的方向发展。空间智能强调机器人在复杂的三维环境中进行感知和决策的能力,而一脑多形则意味着同一个智能系统能够灵活地根据不同任务的需求,自主调整其行为和策略。

在这一阶段,许多新型模型和框架应运而生,以应对多样化的应用需求。例如,RT-X、Octo、OpenVLA、CrossFormer 和 HPT 等模型通过多模态大模型的多数据微调,或通过异构设计来提升不同数据之间的兼容性。然而,这些模型仍主要局限于 2D 空间,未能有效解决不同数据和形态之间的异构性问题。具身智能要求机器人能够在复杂的三维环境中执行任务,因此,模型必须具备 3D 的感知和决策能力。同时,保持 3D 空间的一致性对于解决不同数据源和形态之间的不一致性至关重要。

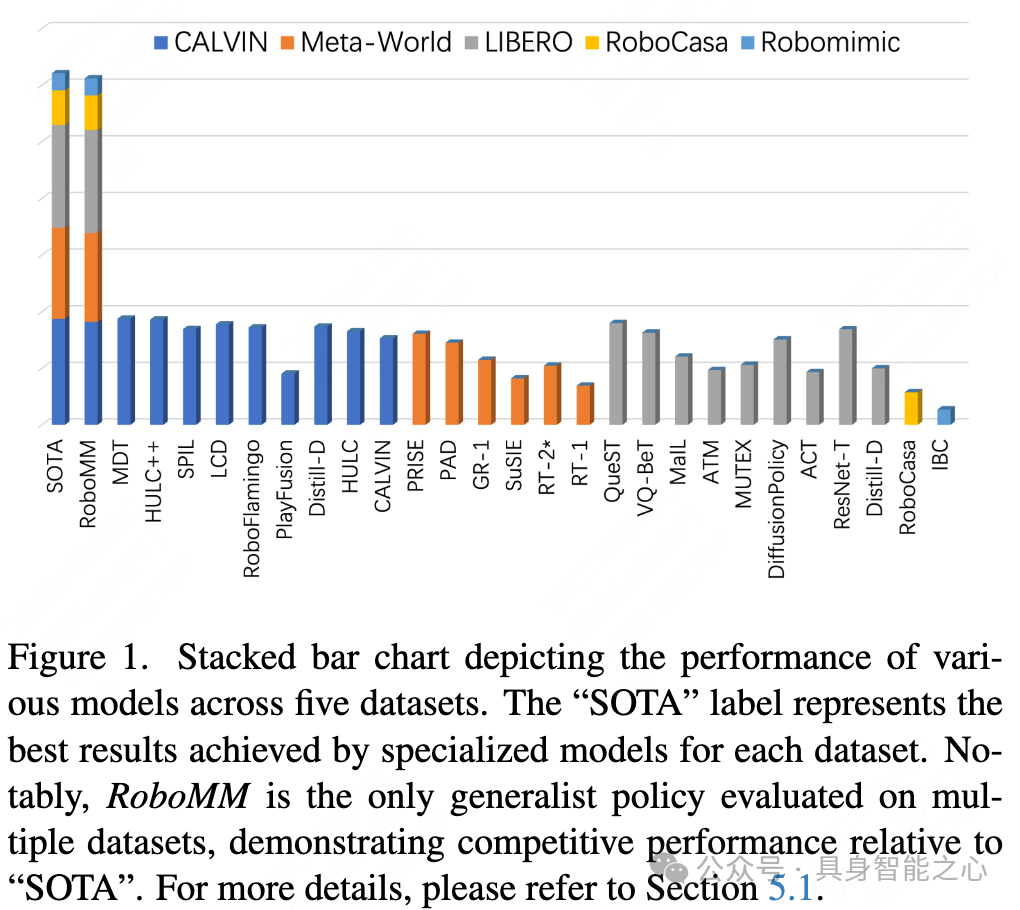

为此,RoboMM论文应运而生:RoboMM,这是一种专为机器人操作设计的多模态大模型,结合了 RoboData,一个综合性的多数据集,旨在整合多种数据源以弥补现有数据集的不足。RoboMM 通过结合相机参数和占用监督,增强了对三维环境的感知能力。此外,借助像 OpenFlamingo这样的先进语言模型,设计了高效的模态隔离掩码,灵活地引入多模态监督。这种设计不仅提高了模型的细粒度感知能力,还使其能够更有效地利用来自互联网的大量数据。

在数据方面,虽然 Open X-Embodiment整合了多个数据集,但缺乏多视角图像、相机参数和深度图等关键信息,使其更适合于 2D 多模态训练。此外,数据空间对齐的缺失导致机器人在不同数据集上的 6D 姿态不一致。而 RoboData 则通过整合多个行业知名数据集,解决了这些问题。补充了深度图和相机参数等缺失的模态。更重要的是,RoboData 通过统一物理空间,对跨机器人和平台的输入输出空间进行了对齐,确保了一致性,促进了来自多样化机器人数据集的集成学习。

RoboData 旨在为行业提供全面且公平的评估系统,而 RoboMM 则是首个能够在多个数据集上进行训练和测试的通用策略。大量实验结果表明,RoboMM 的各个组件显著提升了机器人操作任务的性能,在CALVIN基准测试中,平均序列长度从 1.7 提升至 3.3。此外,RoboMM 还确保了跨体能力,并在多个数据集上达到了最先进的结果!

四、未来展望

具身智能的发展历程表明,从单一数据到迁移学习,再到空间智能的一脑多型,技术的演变不断推动着机器人领域的创新。未来,具身智能有望在智能家居、自动驾驶、工业自动化等多个领域发挥更大的作用。

随着技术的不断进步,具身智能将能够在更复杂的环境中自主决策,真正成为人类的得力助手。通过不断学习和适应,具身智能不仅是技术的代表,更是未来智能生活的重要组成部分。

参考:

RoboMM: https://robouniview.github.io/RoboMM.github.io/

【具身智能之心】技术交流群

具身智能之心是国内首个面向具身智能领域的开发者社区,聚焦大模型、视觉语言导航、机械臂抓取、双足机器人、四足机器人、感知融合、强化学习、模仿学习、规控与端到端、机器人仿真、产品开发、自动标注等多个方向,目前近60+技术交流群,欢迎加入!扫码添加小助理微信邀请入群,备注:学校/公司+方向+昵称(快速入群方式)

【具身智能之心】知识星球

具身智能之心知识星球是国内首个具身智能开发者社区,也是最专业最大的交流平台。主要关注具身智能相关的数据集、开源项目、具身仿真平台、大模型、视觉语言模型、强化学习、具身智能感知定位、机器臂抓取、姿态估计、策略学习、轮式+机械臂、双足机器人、四足机器人、大模型部署、端到端、规划控制等方向。星球内部为大家汇总了近40+开源项目、近60+具身智能相关数据集、行业主流具身仿真平台、强化学习全栈学习路线、具身智能感知学习路线、具身智能交互学习路线、视觉语言导航学习路线、触觉感知学习路线、多模态大模型学理解学习路线、多模态大模型学生成学习路线、大模型与机器人应用、机械臂抓取位姿估计学习路线、机械臂的策略学习路线、双足与四足机器人开源方案、具身智能与大模型部署等方向,涉及当前具身所有主流方向。

扫码加入星球,享受以下专有服务:

1. 第一时间掌握具身智能相关的学术进展、工业落地应用;

2. 和行业大佬一起交流工作与求职相关的问题;

3. 优良的学习交流环境,能结识更多同行业的伙伴;

4. 具身智能相关工作岗位推荐,第一时间对接企业;

5. 行业机会挖掘,投资与项目对接;

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?