BeautifulSoup库的名字来源于路易斯.卡罗尔在《爱丽丝梦游仙境》里的同名诗歌,BeautifulSoup化平淡为神奇,它通过定位HTML标签来格式化和组织复杂的网络信息,用简单易用的Python对象为我们展现结构信息。

在我们安装完Anaconda之后就自带BS4了

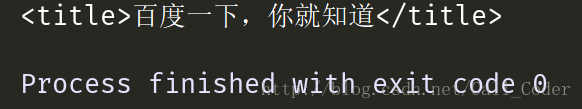

首先,我们利用BeautifulSoup来得到百度的标题:

from urllib.request import urlopen

from bs4 import BeautifulSoup

html = urlopen("http://www.baidu.com")

Bs_html = BeautifulSoup(html)

print(Bs_html.title)

输出结果为:

390

390

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?