错误:

Caused by: java.lang.ClassCastException: scala.collection.mutable.WrappedArray$ofRef cannot be cast to java.util.List

分析:

这个问题,一般是在sparksql中做row转换时候出错,最好一步步排错。

这里要说的是, row:Row是先做了一次强制类型转换(asInstanceOf),row的实际类型是Seq[T],但是不能用Array[T],否则就会出现各种scala和java的类型转换不匹配的问题. 尽量使用原生提供的对象转换的方法.

这个是我自己碰到的都一样,只不过我是在将spark的DataFrame的row对象的数据转换成Java的list时报错.

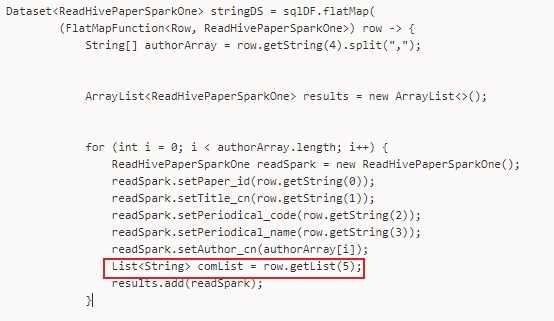

最后做了下面的修改,下面红线的是重要的,我 使用它本身提供的将row对象转化成list的api,getList(). 避免了上述错误,完成了转换。

注意:报其他数据类型的错误如Double等都可以在理解的基础上解决,本质上的原因就是spark数据类型和java数据类型的转换问题。

4105

4105

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?