千呼万唤始出来!就在昨天,WebUI的ControlNet1.1.4版本终于更新,这次的更新支持了SDXL1.0的模型。我怀着兴奋的心情,打开了网站开始下载模型。这次总共出了四种控制类型,分别是Canny、Depth、Sketch和Openpose。

来到Hugging

Face的网址:https://huggingface.co/lllyasviel/sd_control_collection/tree/main。可以看到这里有相当多的模型,当然,我们不需要全部都下载下来,因为它们之间有很多功能是重复的,是不同的作者做出来的。

但是呢,为了帮你们提前踩雷,我把他们全部都下载了,而且逐个做了测试,看到我这么辛苦的份上,你们一定会要给我一个“点赞”和“在看”的吧。

接下来,让我们来分类看一下吧。

#Canny硬边缘

首先是canny,它有几个不同的型号,体积越大,速度越慢。

我使用的是4080ti的笔记本进行的测试,12G显存。

-

模型sdxl base+refiner

-

提示词:masterpiece,best quality,1girl

-

采样方法:euler a

-

尺寸1024*1024

使用diffusers的2.5Gfull模型绘制的图片,一张图花了2分57秒,从这个效率上来看,这个大尺寸基本可以弃了。

使用diffusers的320Mb的small模型,用时34s,质量上差距不大,主要是时间优势很明显。

我们可以再看看其他作者的,这张是kohya的,用时33秒,更接近真实质感。

sai的canny分为128lora和256lora,分别用时39秒和1分08秒,这个模型比较偏绘画的感觉。

最后还有一个t2i的canny模型,用时34s,也是偏插画一点。

你们觉得哪个效果更好呢?时间上基本都在30秒以上,如果关掉refiner的话,能节省一半左右的时间,平均在17秒左右。

#Depth深度

接下来测试一些depth模型,图形尺寸664*1024。

使用diffusers的full模型,用时2分48秒,sdxl给我随机到了一个拼贴画的风格。

使用diffusers的small模型,用时23s。

使用kohya模型,用时42秒。这……好像和我的图片没什么关系。

使用sai模型,用时1分12秒,画质还可以,稍微有点慢。

Sketch草图

接下来测试一下sketch模型,画一只可爱的小猫,图形尺寸1024*624。

使用kohya模型,用时30秒,这是个啥???

使用sai模型,没找到小猫具体的位置,用时32秒,画质还可以。

使用t2i模型,用时28秒,唯一一个准的。

Openpose骨架

最后测试一下openpose模型,图形尺寸1024*624。

使用kohya模型,画很好看,但姿势不对,用时40秒。

最后

如果你是真正有耐心想花功夫学一门技术去改变现状,我可以把这套AI教程无偿分享给你,包含了AIGC资料包括AIGC入门学习思维导图、AIGC工具安装包、精品AIGC学习书籍手册、AI绘画视频教程、AIGC实战学习等。

这份完整版的AIGC资料我已经打包好,长按下方二维码,即可免费领取!

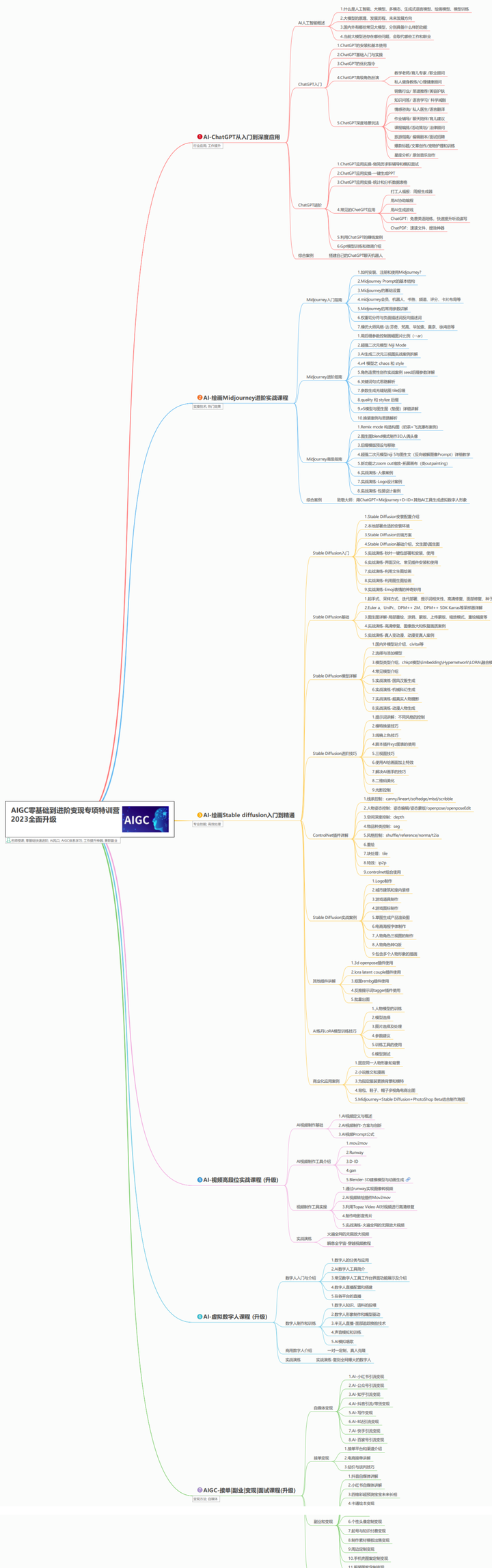

【AIGC所有方向的学习路线思维导图】

【AIGC工具库】

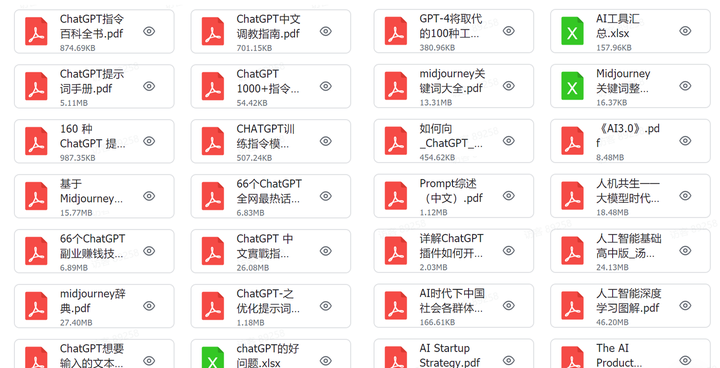

【精品AIGC学习书籍手册】

【AI绘画视频合集】

这份完整版的AIGC资料我已经打包好,长按下方二维码,即可免费领取!

812

812

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?