目录

说到性能测试的 cpu 及内存优化和异常发现,不同产品以及测试人员隶属(服务对象)不同,测试要求和测试目的是不同的,下面按个人理解分别说明下:

注:由于本身自己未从事此类工作,只是说明下如果我做会是这个思路

二、本人关于性能测试的方案设计与实践经验——测试标准和研发人员推动力非常重要

(2)细化测试用例粒度,选择重点风险用例采集数据评估具体的操作细节。

前言:

性能测试是应用程序开发过程中非常重要的一环,它可以帮助我们了解应用程序在不同负载下的表现,并发现潜在的性能瓶颈。在性能测试中,我们通常会使用用例得分评价和 CPU 内存数据监控来评估测试结果。

一、关于项目需求——按需定制测试方案

说到性能测试的 cpu 及内存优化和异常发现,不同产品以及测试人员隶属(服务对象)不同,测试要求和测试目的是不同的,下面按个人理解分别说明下:

1、测试人员的隶属(服务对象)

(1)隶属功能测试组

- 服务对象

- 服务于各部门对版本上线的评估,将版本中发现的问题提交研发人员修改。

- 特点

- 黑盒功能测试,见不到代码也不关心代码逻辑。

- ——依据测试策略所出的报告结果评估版本风险,给版本是否发布提供依据,提交的 bug 是依据现象和测试数据,优先级是对用户的影响和后果严重性。

- 功能测试组的自动化/工具组,服务于黑盒功能测试。

- ——提供解放人力的自动化脚本方案解决部分人工压力,为特定测试需求提供脚本方案/工具,产出是要交付测试流程的。

- CPU/内存测试目标

- 监控数据标准,及时提出优化改善意见并监控衰减;发现异常情况 bug:内存泄露,CPU 负载异常。

- 测试方案建议

- 监控数据采集及呈现方案附加在测试流程中,特别需求建立专项评估测试。根据版本周期长短调整测试内容,控制测试用例粒度。

注:我主要从事就是此类工作,有实践成果后文介绍。

(2)隶属于研发测试组(多见于 BSP 研发团队)

- 服务对象

- 服务于研发人员对修改引入风险的专项测试需求,研发人员在测试版本上的内部评估。

- 特点

- 自动化脚本测试,服务于开发人员的测试,根据研发对代码修改可能带来问题的猜测,组织测试方案验证,可以看到代码。

- CPU/内存测试目标

- 验证研发人员代码设计上的问题及模块改动带来的风险。

- 测试方案建议

- 根据代码逻辑及加载的资源大小加 log 获取数据,对应逻辑行为统计分析数据,需要和研发人员的沟通结论基础和代码分析基础。

注:由于本身自己未从事此类工作,只是说明下如果我做会是这个思路

二、本人关于性能测试的方案设计与实践经验——测试标准和研发人员推动力非常重要

1、测试标准

(1)性能测试标准要多部门参与制定,大多数人认可

(2)基于用户体验的标准将研发排除在外,按照:

- 其他部门设定标准

- —>通知研发

- —>研发质疑标准(如果有)

- —>竞品数据对比(说服研发或修正标准)

- —>稳定落实到测试流程长期监控。

2、测试数据评价的监控

(1)思路:

- 依据测试标准设计按 case 评价得分的打分体系,根据总分变化呈现性能监控,报告监控数据变化,依据数据分析重点衰减用例。

(2)打分原则:

- Ⅰ、用例归类,按类别分权重。(评估版本相关部门参与制定权重)

- Ⅱ、用例权重分类,按对于评估用户体验的价值分为三档。

- 基础为 1;用户频繁常用场景 +1;用户多数在使用的测试条件 +1

- 用例评分=(所属测试类权重/用例价值总计)* 此条用例的用例价值

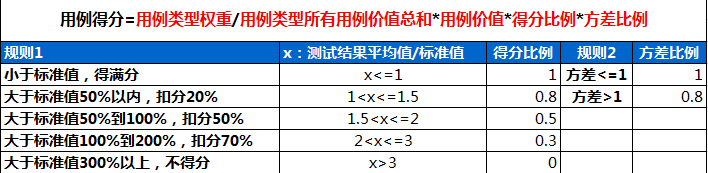

- Ⅲ、设计用例打分原则

- Ⅳ、设计数据统计展示方式:

- 我是采用的设计 excel 公式模板,每次贴数据自动计算,更新趋势图数据范围即可

3、性能测试用例设计及测试数据采集

(1)采集响应时间

- 加载时间,翻页时间,开关机等,根据项目需求设计

(2)取数据方式

- 录像数帧出数据,脚本获取时间等数据采集方式,根据数据准确性和精度要求评估

4、结果监控形式

(1)评分走势分析

- 评分降低,重点分析衰减项,超标准则提交 bug 由研发人员分析

(2)报告反馈与推进解决

- 测试结果报告发给所有评估版本质量的部门,多部门参与推动问题分析解决进度。

三、内存及 cpu 监控方案

1、测试方案选择

(1)测试流程内集成监控方案收集数据

- 数据可视化展示及分析数据&

本文探讨了性能测试中CPU和内存的优化与异常检测,根据测试人员的不同角色(功能测试组、研发测试组)提供定制化测试方案。作者强调测试标准的重要性,分享了数据评价监控、用例设计、结果监控形式以及具体的监控方案设计,包括shell脚本、Python数据转换和node-webkit的数据展示。此外,还提供了实际的监控工具供读者尝试。

本文探讨了性能测试中CPU和内存的优化与异常检测,根据测试人员的不同角色(功能测试组、研发测试组)提供定制化测试方案。作者强调测试标准的重要性,分享了数据评价监控、用例设计、结果监控形式以及具体的监控方案设计,包括shell脚本、Python数据转换和node-webkit的数据展示。此外,还提供了实际的监控工具供读者尝试。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

418

418

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?