/*问题及代码

*Copyright(c)2016,烟台大学计算机学院

*文件名称:二叉树遍历的递归算法 .cpp

*作者:郗传秀 *完成日期;2016年11月3日

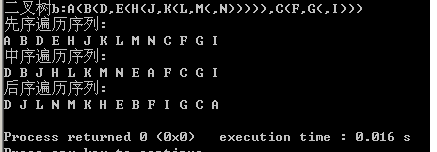

*问题描述:实现二叉树的先序、中序、后序遍历的递归算法,

并对用”A(B(D,E(H(J,K(L,M(,N))))),C(F,G(,I)))”创建的二叉树进行测试。

*输入描述:用括号的形式去输入二叉树的各个节点值

*程序输出:三种遍序的序列

*/

#include <stdio.h>

#include "btree.h"

int main()

{

BTNode *b;

CreateBTNode(b,"A(B(D,E(H(J,K(L,M(,N))))),C(F,G(,I)))");

printf("二叉树b:");

DispBTNode(b);

printf("\n");

printf("先序遍历序列:\n");

PreOrder(b);

printf("\n");

printf("中序遍历序列:\n");

InOrder(b);

printf("\n");

printf("后序遍历序列:\n");

PostOrder(b);

printf("\n");

DestroyBTNode(b);

return 0;

}

#define MaxSize 100

typedef char ElemType;

typedef struct node

{

ElemType data; //数据元素

struct node *lchild; //指向左孩子

struct node *rchild; //指向右孩子

} BTNode;

void CreateBTNode(BTNode *&b,char *str); //由str串创建二叉链

BTNode *FindNode(BTNode *b,ElemType x); //返回data域为x的节点指针

BTNode *LchildNode(BTNode *p); //返回*p节点的左孩子节点指针

BTNode *RchildNode(BTNode *p); //返回*p节点的右孩子节点指针

int BTNodeDepth(BTNode *b); //求二叉树b的深度

void DispBTNode(BTNode *b); //以括号表示法输出二叉树

void DestroyBTNode(BTNode *&b); //销毁二叉树

void PostOrder(BTNode *b); //后序遍历的递归算法

void InOrder(BTNode *b); //中序遍历的递归算法

void PreOrder(BTNode *b); //先序遍历的递归算法

#include <stdio.h>

#include <malloc.h>

#include "btree.h"

void PreOrder(BTNode *b) //先序遍历的递归算法

{

if (b!=NULL)

{

printf("%c ",b->data); //访问根节点

PreOrder(b->lchild); //递归访问左子树

PreOrder(b->rchild); //递归访问右子树

}

}

void InOrder(BTNode *b) //中序遍历的递归算法

{

if (b!=NULL)

{

InOrder(b->lchild); //递归访问左子树

printf("%c ",b->data); //访问根节点

InOrder(b->rchild); //递归访问右子树

}

}

void PostOrder(BTNode *b) //后序遍历的递归算法

{

if (b!=NULL)

{

PostOrder(b->lchild); //递归访问左子树

PostOrder(b->rchild); //递归访问右子树

printf("%c ",b->data); //访问根节点

}

}

void CreateBTNode(BTNode *&b,char *str) //由str串创建二叉链

{

BTNode *St[MaxSize],*p=NULL;

int top=-1,k,j=0;

char ch;

b=NULL; //建立的二叉树初始时为空

ch=str[j];

while (ch!='\0') //str未扫描完时循环

{

switch(ch)

{

case '(':

top++;

St[top]=p;

k=1;

break; //为左节点

case ')':

top--;

break;

case ',':

k=2;

break; //为右节点

default:

p=(BTNode *)malloc(sizeof(BTNode));

p->data=ch;

p->lchild=p->rchild=NULL;

if (b==NULL) //p指向二叉树的根节点

b=p;

else //已建立二叉树根节点

{

switch(k)

{

case 1:

St[top]->lchild=p;

break;

case 2:

St[top]->rchild=p;

break;

}

}

}

j++;

ch=str[j];

}

}

BTNode *FindNode(BTNode *b,ElemType x) //返回data域为x的节点指针

{

BTNode *p;

if (b==NULL)

return NULL;

else if (b->data==x)

return b;

else

{

p=FindNode(b->lchild,x);

if (p!=NULL)

return p;

else

return FindNode(b->rchild,x);

}

}

BTNode *LchildNode(BTNode *p) //返回*p节点的左孩子节点指针

{

return p->lchild;

}

BTNode *RchildNode(BTNode *p) //返回*p节点的右孩子节点指针

{

return p->rchild;

}

int BTNodeDepth(BTNode *b) //求二叉树b的深度

{

int lchilddep,rchilddep;

if (b==NULL)

return(0); //空树的高度为0

else

{

lchilddep=BTNodeDepth(b->lchild); //求左子树的高度为lchilddep

rchilddep=BTNodeDepth(b->rchild); //求右子树的高度为rchilddep

return (lchilddep>rchilddep)? (lchilddep+1):(rchilddep+1);

}

}

void DispBTNode(BTNode *b) //以括号表示法输出二叉树

{

if (b!=NULL)

{

printf("%c",b->data);

if (b->lchild!=NULL || b->rchild!=NULL)

{

printf("(");

DispBTNode(b->lchild);

if (b->rchild!=NULL) printf(",");

DispBTNode(b->rchild);

printf(")");

}

}

}

void DestroyBTNode(BTNode *&b) //销毁二叉树

{

if (b!=NULL)

{

DestroyBTNode(b->lchild);

DestroyBTNode(b->rchild);

free(b);

}

}

运行结果

3964

3964

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?