因为前天说了shap,这里涉及到数据形状尺寸问题,所以需要在这一节说清楚,后续的神经网络我们将要和他天天打交道。

知识点:

- numpy数组的创建:简单创建、随机创建、遍历、运算

- numpy数组的索引:一维、二维、三维

- SHAP值的深入理解

作业:今日知识点比较多,好好记忆下

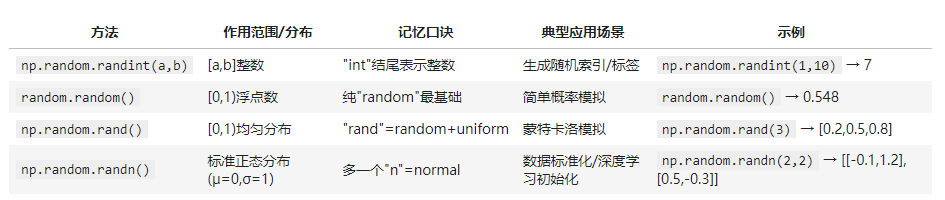

NumPy随机数生成方法对比

- 记忆技巧:

- 记忆技巧:

1. **看结尾**:

- "int" → 整数

- "n" → 正态(normal)

2. **看前缀**:

- 纯"random" → Python基础随机

- "np.random" → NumPy增强版

3. **功能差异**:

- `rand()`和`random()`都是均匀分布,但`rand()`能直接生成数组

- `randn()`生成的数据会有正有负,其他方法都是非负数

输入:

import numpy as np

a = np.array([2,4,6,8,10,12]) # 创建一个一维数组

b = np.array([[2,4,6],[8,10,12]]) # 创建一个二维数组

print(a)

print(b)

# 分清楚列表和数组的区别

print([7, 5, 3, 9]) # 输出: [7, 5, 3, 9](逗号分隔)

print(np.array([7, 5, 3, 9])) # 输出: [7 5 3 9](空格分隔)

print(a.shape) # numpy中可以用shape来查看数组的形状

zeros = np.zeros((2, 3)) # 创建一个2行3列的全零矩阵

print(zeros) # 输出: [[0. 0. 0.] [0. 0. 0.]]

ones = np.ones((3,)) # 创建一个形状为(3,)的全1数组

print(ones) # 输出: [1. 1. 1.]

arr1d = np.arange(10) # 数组: [0 1 2 3 4 5 6 7 8 9]

print(arr1d) # 输出: [0 1 2 3 4 5 6 7 8 9]

c = np.random.rand(2, 2) # 创建一个2*2的随机数组c,区间为[0,1)

print(c)

import numpy as np

np.random.seed(42) # 设置随机种子以确保结果可重复

# 生成10个语文成绩(正态分布,均值75,标准差10)

chinese_scores = np.random.normal(75, 10, 10).round(1)

# 找出最高分和最低分及其索引

max_score = np.max(chinese_scores)

max_index = np.argmax(chinese_scores)

min_score = np.min(chinese_scores)

min_index = np.argmin(chinese_scores)

print(f"所有成绩: {chinese_scores}")

print(f"最高分: {max_score} (第{max_index}个学生)")

print(f"最低分: {min_score} (第{min_index}个学生)")

sum = 0 # 初始化sum为0

for i in chinese_scores: # 遍历数组中的每个元素

sum += i

# 累加每个元素的值到sum中

print(f"所有成绩的和: {sum}") # 输出所有成绩的和

print(f"所有成绩的平均值: {sum/len(chinese_scores)}") # 输出所有成绩的平均值

#数组的运算

x = np.array([[1, 2, 3], [4, 5, 6]]) # 2D array requires double brackets

y = np.array([[7, 8, 9], [10, 11, 12]]) # Fixed array creation syntax

print(x + y) # 数组相加

print(x - y) # 数组相减

#数组的索引

arr1d = np.array([1, 2, 3, 4, 5]) # 创建一维数组

print(arr1d[0]) # 输出: 1 取出数组的第一个元素

print(arr1d[2:4]) # 输出: [3 4](切片操作),取出索引为2到3的元素(不包括索引4的元素,取左不取右)

print(arr1d[-1]) # # 取出数组的最后一个元素。-1表示倒数第一个元素。

print(arr1d[1:]) # 输出: [2 3 4 5](切片操作),取出索引为1到末尾的元素。

print(arr1d[:-1]) # 输出: [1 2 3 4](切片操作),取出索引为0到倒数第二个元素的元素。

print(arr1d[:]) # 输出: [1 2 3 4 5](切片操作),取出所有元素。

print(arr1d[::2]) # 输出: [1 3 5](切片操作),取出索引为0、2、4的元素。

# 数组:

arr2d = np.array([[1, 2, 3, 4],

[5, 6, 7, 8],

[9, 10, 11, 12],

[13, 14, 15, 16]]) # 创建二维数组

arr2d[1, :] # 输出: [5 6 7 8](切片操作),取出第二行的所有元素。

arr2d[1] # 输出: [5 6 7 8](切片操作),取出第二行的所有元素。

arr2d[:, 1] # 输出: [2 6 10 14](切片操作),取出第二列的所有元素。

arr2d[1, 2] # 输出: 7(切片操作),取出第二行第三列的元素。

arr2d[[0, 2], :] # 输出: [[1 2 3 4] [9 10 11 12]](切片操作),取出第一行和第三行的所有元素。

arr2d[:, [0, 2]] # 输出: [[1 3] [5 7] [9 11] [13 15]](切片操作),取出第一列和第三列的所有元素。

arr2d[[0, 2], [0, 2]] # 输出: [1 11](切片操作),取出第一行第一列和第三行第三列的元素。

arr2d[1, 1:3] # 输出: [6 7](切片操作),取出第二行第二列到第三列的元素。

arr2d[1:3, 1:3] # 输出: [[6 7] [10 11]](切片操作),取出第二行到第三行,第二列到第三列的元素。

print('\n')

arr3d = np.arange(3 * 4 * 5).reshape((3, 4, 5))

print(arr3d) # 创建一个3*4*5的三维数组,其中元素的值为0到11。

print(arr3d[0, 1, 2]) # 输出: 2(切片操作),取出第一层第二行第三列的元素。

print(arr3d[0, 1]) # 输出: [5 6 7 8 9](切片操作),取出第一层第二行的所有元素。

print(arr3d[0]) # 输出: [[0 1 2 3 4] [5 6 7 8 9] [10 11 12 13 14] [15 16 17 18 19]](切片操作),取出第一层的所有元素。

print(arr3d[0, 1, 2:4]) # 输出: [7 8](切片操作),取出第一层第二行第三列到第四列的元素。

# 先运行之前预处理好的代码

import pandas as pd

import pandas as pd #用于数据处理和分析,可处理表格数据。

import numpy as np #用于数值计算,提供了高效的数组操作。

import matplotlib.pyplot as plt #用于绘制各种类型的图表

import seaborn as sns #基于matplotlib的高级绘图库,能绘制更美观的统计图形。

import warnings

warnings.filterwarnings("ignore")

# 设置中文字体(解决中文显示问题)

plt.rcParams['font.sans-serif'] = ['SimHei'] # Windows系统常用黑体字体

plt.rcParams['axes.unicode_minus'] = False # 正常显示负号

data = pd.read_csv('data.csv') #读取数据

# 先筛选字符串变量

discrete_features = data.select_dtypes(include=['object']).columns.tolist()

# Home Ownership 标签编码

home_ownership_mapping = {

'Own Home': 1,

'Rent': 2,

'Have Mortgage': 3,

'Home Mortgage': 4

}

data['Home Ownership'] = data['Home Ownership'].map(home_ownership_mapping)

# Years in current job 标签编码

years_in_job_mapping = {

'< 1 year': 1,

'1 year': 2,

'2 years': 3,

'3 years': 4,

'4 years': 5,

'5 years': 6,

'6 years': 7,

'7 years': 8,

'8 years': 9,

'9 years': 10,

'10+ years': 11

}

data['Years in current job'] = data['Years in current job'].map(years_in_job_mapping)

# Purpose 独热编码,记得需要将bool类型转换为数值

data = pd.get_dummies(data, columns=['Purpose'])

data2 = pd.read_csv("data.csv") # 重新读取数据,用来做列名对比

list_final = [] # 新建一个空列表,用于存放独热编码后新增的特征名

for i in data.columns:

if i not in data2.columns:

list_final.append(i) # 这里打印出来的就是独热编码后的特征名

for i in list_final:

data[i] = data[i].astype(int) # 这里的i就是独热编码后的特征名

# Term 0 - 1 映射

term_mapping = {

'Short Term': 0,

'Long Term': 1

}

data['Term'] = data['Term'].map(term_mapping)

data.rename(columns={'Term': 'Long Term'}, inplace=True) # 重命名列

continuous_features = data.select_dtypes(include=['int64', 'float64']).columns.tolist() #把筛选出来的列名转换成列表

# 连续特征用中位数补全

for feature in continuous_features:

mode_value = data[feature].mode()[0] #获取该列的众数。

data[feature].fillna(mode_value, inplace=True) #用众数填充该列的缺失值,inplace=True表示直接在原数据上修改。

# 最开始也说了 很多调参函数自带交叉验证,甚至是必选的参数,你如果想要不交叉反而实现起来会麻烦很多

# 所以这里我们还是只划分一次数据集

from sklearn.model_selection import train_test_split

X = data.drop(['Credit Default'], axis=1) # 特征,axis=1表示按列删除

y = data['Credit Default'] # 标签

# 按照8:2划分训练集和测试集

X_train, X_test, y_train, y_test = train_test_split(X, y, test_size=0.2, random_state=42) # 80%训练集,20%测试集

from sklearn.ensemble import RandomForestClassifier #随机森林分类器

from sklearn.metrics import accuracy_score, precision_score, recall_score, f1_score # 用于评估分类器性能的指标

from sklearn.metrics import classification_report, confusion_matrix #用于生成分类报告和混淆矩阵

import warnings #用于忽略警告信息

warnings.filterwarnings("ignore") # 忽略所有警告信息

# --- 1. 默认参数的随机森林 ---

# 评估基准模型,这里确实不需要验证集

print("--- 1. 默认参数随机森林 (训练集 -> 测试集) ---")

import time # 这里介绍一个新的库,time库,主要用于时间相关的操作,因为调参需要很长时间,记录下会帮助后人知道大概的时长

start_time = time.time() # 记录开始时间

rf_model = RandomForestClassifier(random_state=42)

rf_model.fit(X_train, y_train) # 在训练集上训练

rf_pred = rf_model.predict(X_test) # 在测试集上预测

end_time = time.time() # 记录结束时间

print(f"训练与预测耗时: {end_time - start_time:.4f} 秒")

print("\n默认随机森林 在测试集上的分类报告:")

print(classification_report(y_test, rf_pred))

print("默认随机森林 在测试集上的混淆矩阵:")

print(confusion_matrix(y_test, rf_pred))

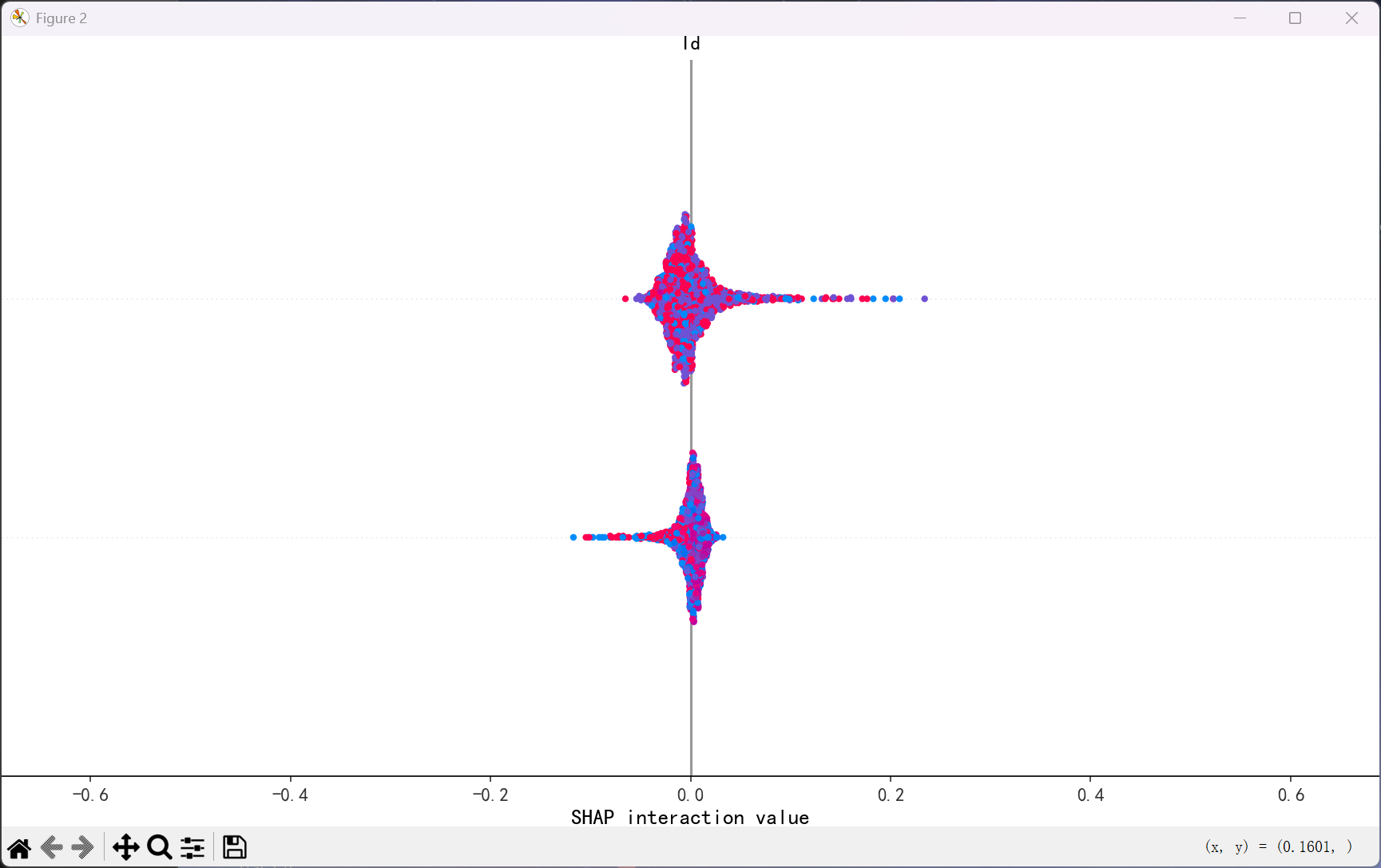

import shap

import matplotlib.pyplot as plt

explainer = shap.TreeExplainer(rf_model) # 创建SHAP解释器对象

shap_values = explainer.shap_values(X_test) # 计算SHAP值

print(shap_values) # 打印SHAP值

print('\n')

print(shap_values[0,:,:])

print('\n')

print(shap_values.shape) # 打印SHAP值的形状

print('\n')

# 比如我想取出所有样本对第二个类别的贡献值

print(shap_values[1,:,:]) # 取出所有样本对第二个类别的贡献值

print('\n')

shap.summary_plot(shap_values, X_test, plot_type="bar") # 绘制SHAP值的条形图

plt.show() # 显示图形

输出:

[ 2 4 6 8 10 12]

[[ 2 4 6]

[ 8 10 12]]

[7, 5, 3, 9]

[7 5 3 9]

(6,)

[[0. 0. 0.]

[0. 0. 0.]]

[1. 1. 1.]

[0 1 2 3 4 5 6 7 8 9]

[[0.12985547 0.05432629]

[0.9109544 0.88887468]]

所有成绩: [80. 73.6 81.5 90.2 72.7 72.7 90.8 82.7 70.3 80.4]

最高分: 90.8 (第6个学生)

最低分: 70.3 (第8个学生)

所有成绩的和: 794.9

所有成绩的平均值: 79.49

[[ 8 10 12]

[14 16 18]]

[[-6 -6 -6]

[-6 -6 -6]]

1

[3 4]

5

[2 3 4 5]

[1 2 3 4]

[1 2 3 4 5]

[1 3 5]

[[[ 0 1 2 3 4]

[ 5 6 7 8 9]

[10 11 12 13 14]

[15 16 17 18 19]]

[[20 21 22 23 24]

[25 26 27 28 29]

[30 31 32 33 34]

[35 36 37 38 39]]

[[40 41 42 43 44]

[45 46 47 48 49]

[50 51 52 53 54]

[55 56 57 58 59]]]

7

[5 6 7 8 9]

[[ 0 1 2 3 4]

[ 5 6 7 8 9]

[10 11 12 13 14]

[15 16 17 18 19]]

[7 8]

--- 1. 默认参数随机森林 (训练集 -> 测试集) ---

训练与预测耗时: 1.3899 秒

默认随机森林 在测试集上的分类报告:

precision recall f1-score support

0 0.77 0.97 0.86 1059

1 0.79 0.30 0.43 441

accuracy 0.77 1500

macro avg 0.78 0.63 0.64 1500

weighted avg 0.77 0.77 0.73 1500

默认随机森林 在测试集上的混淆矩阵:

[[1023 36]

[ 309 132]]

[[[ 9.07465700e-03 -9.07465700e-03]

[ 7.21456498e-03 -7.21456498e-03]

[ 4.55189444e-02 -4.55189444e-02]

...

[ 7.12857198e-05 -7.12857198e-05]

[ 4.67733508e-05 -4.67733508e-05]

[ 1.61298135e-04 -1.61298135e-04]]

[[-1.02606871e-02 1.02606871e-02]

[ 1.85572634e-02 -1.85572634e-02]

[-1.64992848e-02 1.64992848e-02]

...

[ 2.00070852e-04 -2.00070852e-04]

[ 5.11798841e-05 -5.11798841e-05]

[ 1.02827796e-04 -1.02827796e-04]]

[[ 3.21529115e-03 -3.21529115e-03]

[ 1.28184070e-02 -1.28184070e-02]

[ 1.02124914e-01 -1.02124914e-01]

...

[ 1.73012306e-04 -1.73012306e-04]

[ 4.74133256e-05 -4.74133256e-05]

[ 1.26753231e-04 -1.26753231e-04]]

...

[[ 1.15222741e-03 -1.15222741e-03]

[-1.71843266e-02 1.71843266e-02]

[-3.04994337e-02 3.04994337e-02]

...

[ 1.44859329e-04 -1.44859329e-04]

[ 1.80111014e-05 -1.80111014e-05]

[ 1.30107512e-04 -1.30107512e-04]]

[[ 1.29249120e-03 -1.29249120e-03]

[ 5.66948438e-03 -5.66948438e-03]

[ 2.49050264e-02 -2.49050264e-02]

...

[ 2.50590715e-06 -2.50590715e-06]

[ 4.68839113e-05 -4.68839113e-05]

[ 1.15002997e-05 -1.15002997e-05]]

[[-1.12640555e-03 1.12640555e-03]

[ 1.42648293e-02 -1.42648293e-02]

[ 4.74790019e-02 -4.74790019e-02]

...

[ 6.19451775e-05 -6.19451775e-05]

[ 3.30996384e-05 -3.30996384e-05]

[ 4.45219920e-05 -4.45219920e-05]]]

[[ 9.07465700e-03 -9.07465700e-03]

[ 7.21456498e-03 -7.21456498e-03]

[ 4.55189444e-02 -4.55189444e-02]

[ 3.47666501e-04 -3.47666501e-04]

[ 2.57821493e-04 -2.57821493e-04]

[ 2.00758099e-03 -2.00758099e-03]

[-7.54175659e-03 7.54175659e-03]

[-1.35324163e-03 1.35324163e-03]

[-7.08191659e-04 7.08191659e-04]

[-6.06829865e-03 6.06829865e-03]

[-1.90501403e-03 1.90501403e-03]

[ 1.44384291e-02 -1.44384291e-02]

[-4.91452434e-02 4.91452434e-02]

[ 6.28172371e-03 -6.28172371e-03]

[-1.64613559e-02 1.64613559e-02]

[-6.04576031e-01 6.04576031e-01]

[ 4.58074016e-04 -4.58074016e-04]

[-1.95125086e-05 1.95125086e-05]

[-1.47478232e-05 1.47478232e-05]

[ 6.27274034e-04 -6.27274034e-04]

[-1.26003035e-05 1.26003035e-05]

[-3.58303017e-04 3.58303017e-04]

[ 7.89740644e-05 -7.89740644e-05]

[ 2.08492876e-04 -2.08492876e-04]

[ 5.52330472e-06 -5.52330472e-06]

[ 4.11019037e-04 -4.11019037e-04]

[ 7.15614011e-06 -7.15614011e-06]

[ 1.07037925e-04 -1.07037925e-04]

[ 7.12857198e-05 -7.12857198e-05]

[ 4.67733508e-05 -4.67733508e-05]

[ 1.61298135e-04 -1.61298135e-04]]

(1500, 31, 2)

[[-1.02606871e-02 1.02606871e-02]

[ 1.85572634e-02 -1.85572634e-02]

[-1.64992848e-02 1.64992848e-02]

[ 5.06820187e-03 -5.06820187e-03]

[ 8.03993942e-04 -8.03993942e-04]

[ 6.23093534e-03 -6.23093534e-03]

[ 1.03509794e-02 -1.03509794e-02]

[ 3.30238833e-02 -3.30238833e-02]

[ 1.46418512e-03 -1.46418512e-03]

[ 6.79034083e-03 -6.79034083e-03]

[ 2.50718949e-03 -2.50718949e-03]

[ 3.48936324e-02 -3.48936324e-02]

[-2.37893910e-02 2.37893910e-02]

[-5.81337661e-03 5.81337661e-03]

[ 2.37683779e-02 -2.37683779e-02]

[ 3.69112306e-02 -3.69112306e-02]

[ 1.10309789e-03 -1.10309789e-03]

[ 3.26736973e-04 -3.26736973e-04]

[ 1.75816944e-04 -1.75816944e-04]

[-6.42806171e-04 6.42806171e-04]

[ 8.65196736e-07 -8.65196736e-07]

[ 5.66108030e-04 -5.66108030e-04]

[ 9.91956164e-05 -9.91956164e-05]

[ 4.18834246e-04 -4.18834246e-04]

[ 7.12584973e-05 -7.12584973e-05]

[ 2.16810255e-03 -2.16810255e-03]

[ 5.72741710e-05 -5.72741710e-05]

[ 4.53963511e-04 -4.53963511e-04]

[ 2.00070852e-04 -2.00070852e-04]

[ 5.11798841e-05 -5.11798841e-05]

[ 1.02827796e-04 -1.02827796e-04]]

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?