数据集

1. 可用数据集

Kaggle网址:https://www.kaggle.com/datasets

UCI数据集网址: http://archive.ics.uci.edu/ml/

scikit-learn网址:http://scikit-learn.org/stable/datasets/index.html#datasets

2. sklearn

-

小数据集datasets.load_*():

sklearn.datasets.load_iris() 加载并返回鸢尾花数据集 sklearn.datasets.load_boston() 加载并返回波士顿房价数据集 -

大数据集datasets.fetch_*(data_home=None):

sklearn.datasets.fetch_20newsgroups(data_home=None,subset=‘train’)

subset:‘train’或者’test’,‘all’,可选,选择要加载的数据集。

训练集的“训练”,测试集的“测试”,两者的“全部”

data_home,表示数据集下载的目录,默认是 ~/scikit_learn_data/ -

sklearn数据集的使用

sklearn数据集返回值介绍:

load和fetch返回的数据类型datasets.base.Bunch(字典格式)

- data:特征数据数组,是 [n_samples * n_features] 的二维 numpy.ndarray 数组

- target:标签数组,是 n_samples 的一维numpy.ndarray 数组

- DESCR:数据描述

- feature_names:特征名,新闻数据,手写数字、回归数据集没有

- target_names:标签名

3. 数据集的划分

机器学习一般的数据集会划分为两个部分:

- 训练数据:用于训练,构建模型

- 测试数据:在模型检验时使用,用于评估模型是否有效

划分比例:

- 训练集:70% 80% 75%

- 测试集:30% 20% 30%

数据和特征决定了机器学习的上限,而模型和算法只是逼近这个上限而已。

4. 特征工程

特征工程是使用专业背景知识和技巧处理数据,使得特征能在机器学习算法上发挥更好的作用的过程。

pandas:一个数据读取非常方便以及基本的处理格式的工具

sklearn:对于特征的处理提供了强大的接口

特征工程包含内容:

特征提取

特征预处理

特征降维

4.1 特征抽取

将任意数据(如文本或图像)转换为可用于机器学习的数字特征

字典特征提取(特征离散化)

文本特征提取

图像特征提取(深度学习将介绍)

字典特征提取

sklearn.feature_extraction.DictVectorizer(sparse=True,…)

应用场景

数据集中类别特征比较多或者本身拿到的数据就是字典类型

文本特征提取

sklearn.feature_extraction.text.CountVectorizer(stop_words=[])

应用场景

统计样本出现的个数

中文文本特征抽取

jieba.cut()

返回词语组成的生成器

Tf-idf文本特征提取

sklearn.feature_extraction.text.TfidfVectorizer(stop_words=None,....)

TF-IDF的主要思想是:如果某个词或短语在一篇文章中出现的概率高,并且在其他文章中很少出现,则认为此词或者短语具有很好的类别区分能力,适合用来分类。

词频(term frequency,tf)指的是某一个给定的词语在该文件中出现的频率

逆向文档频率(inverse document frequency,idf)是一个词语普遍重要性的度量。某一特定词语的idf,可以由总文件数目除以包含该词语之文件的数目,再将得到的商取以10为底的对数得到

注:假如一篇文件的总词语数是100个,而词语"非常"出现了5次,那么"非常"一词在该文件中的词频就是5/100=0.05。而计算文件频率(IDF)的方法是以文件集的文件总数,除以出现"非常"一词的文件数。所以,如果"非常"一词在1,000份文件出现过,而文件总数是10,000,000份的话,其逆向文件频率就是lg(10,000,000 / 1,0000)=3。最后"非常"对于这篇文档的tf-idf的分数为0.05 * 3=0.15

4.2 特征预处理

数值型数据的无量纲化:归一化、标准化

特征预处理API

sklearn.preprocessing

为什么我们要进行归一化/标准化?

特征的单位或者大小相差较大,或者某特征的方差相比其他的特征要大出几个数量级,容易影响(支配)目标结果,使得一些算法无法学习到其它的特征

无量纲化,使不同规格的数据转换到同一规格

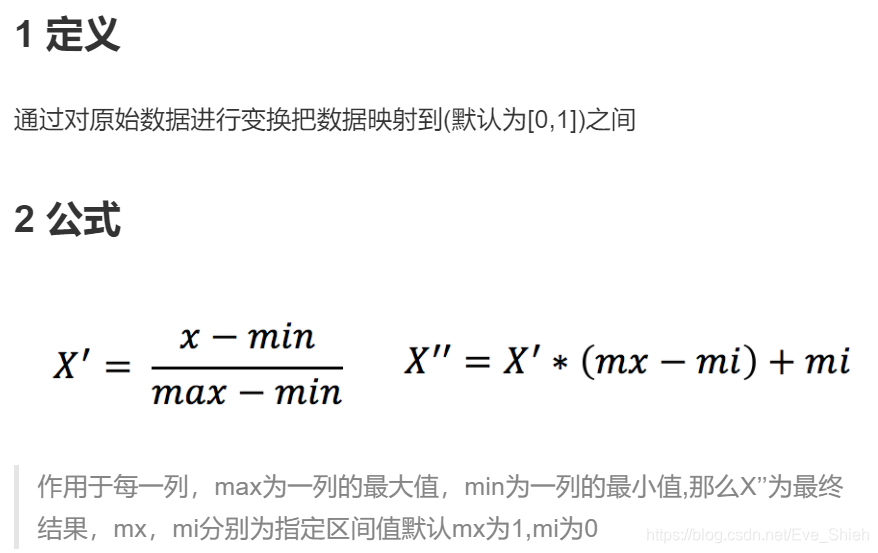

4.2.1 归一化

sklearn.preprocessing.MinMaxScaler (feature_range=(0,1)… )

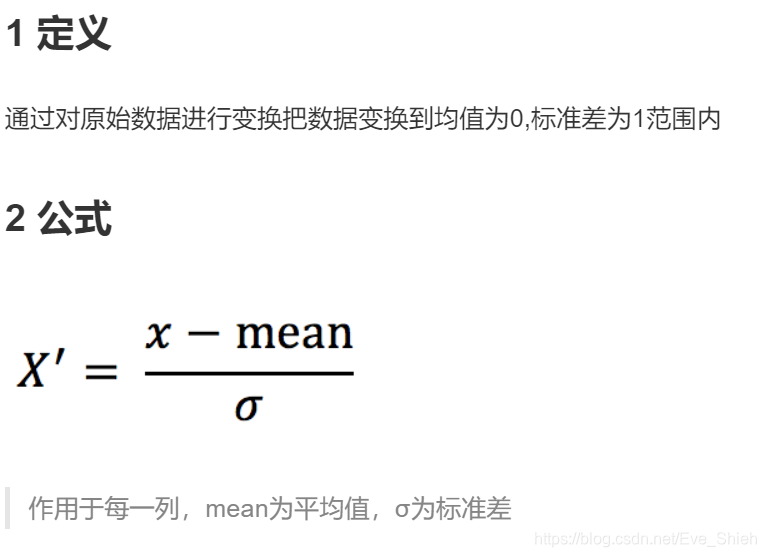

4.2.2 标准化

sklearn.preprocessing.StandardScaler( )

4.3 特征降维

降维是指在某些限定条件下,降低随机变量(特征)个数,得到一组“不相关”主变量的过程

降维的两种方式

特征选择

主成分分析(可以理解一种特征提取的方式)

4.3.1 特征选择

定义:数据中包含冗余或无关变量(或称特征、属性、指标等),旨在从原有特征中找出主要特征。

方法:

1.Filter(过滤式):主要探究特征本身特点、特征与特征和目标值之间关联

方差选择法:低方差特征过滤

相关系数----特征与特征之间的相关程度

皮尔逊相关系数

2.Embedded (嵌入式):算法自动选择特征(特征与目标值之间的关联)

决策树:信息熵、信息增益

正则化:L1、L2

深度学习:卷积等

sklearn.feature_selection

-

低方差特征过滤

删除低方差的一些特征

特征方差小:某个特征大多样本的值比较相近 特征方差大:某个特征很多样本的值都有差别 sklearn.feature_selection.VarianceThreshold(threshold = 0.0) -

皮尔逊相关系数(Pearson Correlation Coefficient)

相关系数的值介于–1与+1之间,即–1≤ r ≤+1。其性质如下: 当r>0时,表示两变量正相关,r<0时,两变量为负相关 当|r|=1时,表示两变量为完全相关,当r=0时,表示两变量间无相关关系 当0<|r|<1时,表示两变量存在一定程度的相关。且|r|越接近1,两变量间线性关系越密切;|r|越接近于0,表示两变量的线性相关越弱 一般可按三级划分:|r|<0.4为低度相关;0.4≤|r|<0.7为显著性相关;0.7≤|r|<1为高度线性相关 from scipy.stats import pearsonr 特征和特征相关性很高: 特征选择、加权求和一个新特征、主成分分析 -

主成分分析(PCA)

定义:高维数据转化为低维数据的过程,在此过程中可能会舍弃原有数据、创造新的变量

作用:是数据维数压缩,尽可能降低原数据的维数(复杂度),损失少量信息。

应用:回归分析或者聚类分析当中sklearn.decomposition.PCA(n_components=None)

1026

1026

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?