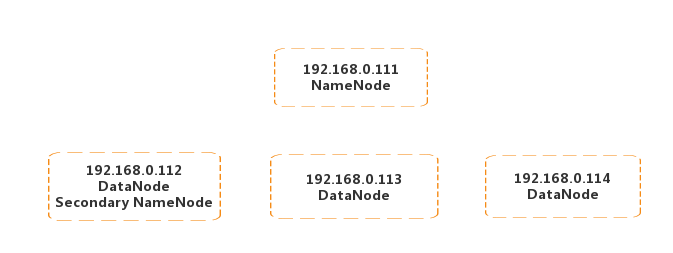

服务器规划如上图所示

搭建步骤:

1.同步时间、配置hosts、关闭防火墙

时间同步:ntpdate -u edu.ntp.org.cn

2.配置免密码登录

NameNode节点到其他节点

3.修改配置文件

修改${HADOOP_HOME}/etc/hadoop/hadoop-env.sh

# set to the root of your Java installation

export JAVA_HOME=/usr/local/software/jdk1.7.0_79core-site.xml

<?xml version="1.0" encoding="UTF-8"?>

<?xml-stylesheet type="text/xsl" href="configuration.xsl"?>

<configuration>

<property>

<name>fs.defaultFS</name>

<value>hdfs://192.168.0.111:9000</value>

</property>

<property>

<name>hadoop.tmp.dir</name>

<value>/usr/local/software/hadoop-2.7.3/data</value>

</property>

</configuration>hdfs-site.xml

<?xml version="1.0" encoding="UTF-8"?>

<?xml-stylesheet type="text/xsl" href="configuration.xsl"?>

<configuration>

<property>

<name>dfs.replication</name>

<value>3</value>

</property>

<property>

<name>dfs.namenode.secondary.http-address</name>

<value>192.168.0.112:50090</value>

</property>

</configuration>

slaves

192.168.0.112

192.168.0.113

192.168.0.114在一台机器上配置完成,使用scp命令将上述配置完成的hadoop配置同步到其他机器

4.格式化NameNode

$ bin/hdfs namenode -format5.启动hdfs

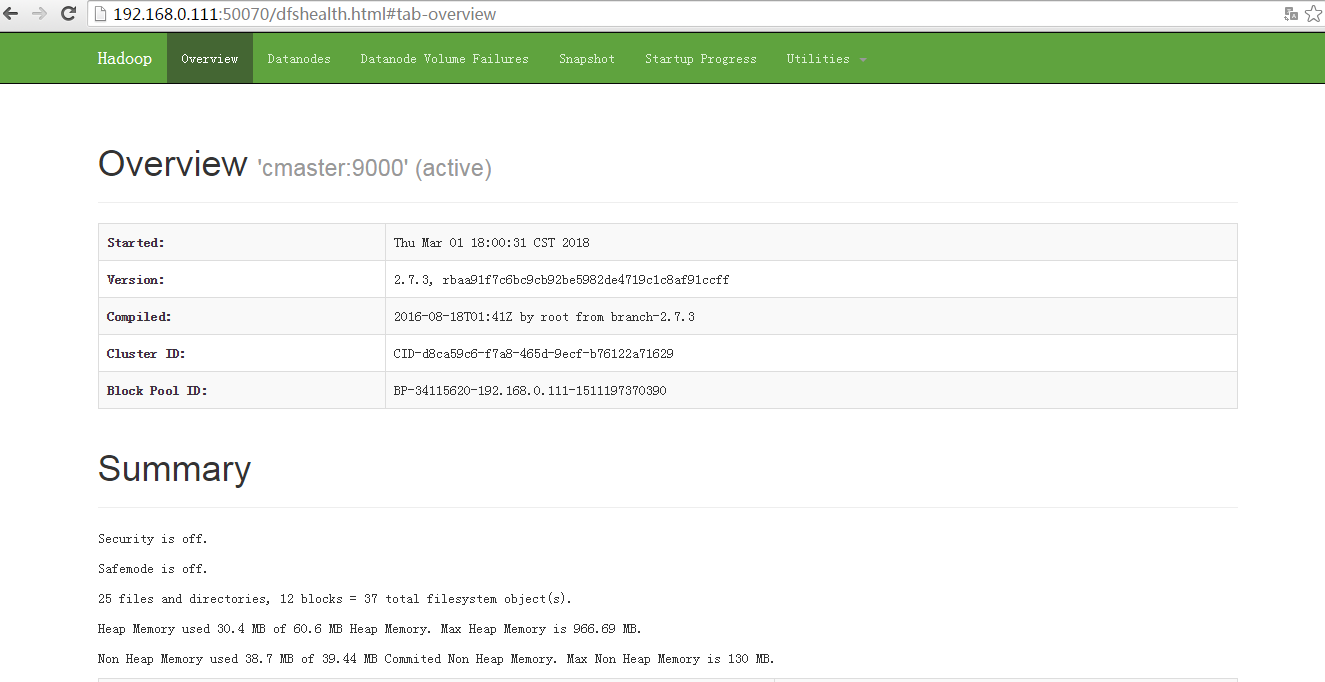

$ sbin/start-dfs.sh6.使用jps命令查看进程或访问http://192.168.0.111:50070/ 验证是否启动成功。

1194

1194

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?