SQL on Hadoop

SQL是一种传统的用来进行数据分析的标准

Hive是原始的SQL-on-Hadoop解决方案

Impala:和Hive一样,提供了一种可以针对已有Hadoop数据编写SQL查询的方法

Presto:类似于Impala,未被主要供应商支持

Shark:Spark SQL的前身,设计目标是作为Hive的一个补充

Phoenix:基于HBase的开源SQL查询引擎

Spark SQL前身

Spark的初衷:让Hive运行在Spark之上

是对Hive的改造,继承了大量Hive代码,给优化和维护带来了大量的麻烦

Spark SQL架构

Spark SQL是Spark的核心组件之一

能够直接访问现存的Hive数据

提供JDBC/ODBC接口供第三方工具借助Spark进行数据处理

提供了更高层级的接口方便的处理数据

支持多种操作方式:SQL、API编程

支持多种外部数据源:Parquet、JSON、RDBMS等

Spark SQL运行原理

Catalyst优化器是Spark SQL的核心

Catalyst Optimizer:Catalyst优化器,将逻辑计划转为物理计划

Catalyst优化器

逻辑计划:

优化:

1、在投影上面查询过滤器

2、检查过滤是否可下压

物理计划:

Spark SQL API

SparkContext

SQLContext

- Spark SQL的编程入口

HiveContext

- SQLContext的子集,包含更多功能

SparkSession(Spark 2.x推荐)

- SparkSession:合并了SQLContext与HiveContext

- 提供了与Spark功能交互单一入口点,并允许使用DataFrame和Dataset API对Spark进行编程

Dataset

特定域对象中的强类型集合

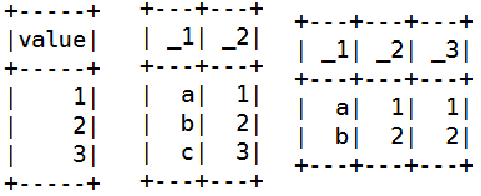

scala> spark.createDataset(1 to 3).show

scala> spark.createSataset(List(("a",1),("b",2),("c",3))).show

scala> spark.createDataset(sc.parallelize(List("a",1,1),("b",2,2))).show

1、createDataset()的参数可以是:Seq、Array、RDD

2、上面三行代码生成的Dataset分别是:Dataset[Int]、Dataset[(String,Int)]、Dataset[(String,Int,Int)]

3、Dataset = RDD + Schema,所以Dataset与RDD有大部共同的函数,如map、filter等

使用Case Class创建Dataset

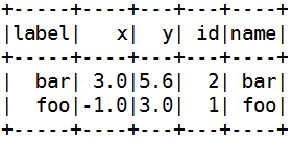

case class Point(label:String,x:Double,y:Double)

case class Category(id:Long,name:String)

val points = Seq(Point("bar",3.0,5.6),Point("foo",-1.0,3.0)).toDS

val categories = Seq(Category(1,"foo"),Category(2,"bar")).toDS

points.join(categories,points("label") === categories("name")).show

Scala中在class关键字前加上case关键字,这个类就成为了样例类,样例类和普通类区别:

(1)不需要new可以直接生成对象

(2)默认实现序列化接口

(3)默认自动覆盖toString()、equals()、hashCode()

// 典型应用场景RDD-->Dataset

case class Point(label:String,x:Double,y:Double)

case class Category(id:long,name:String)

val pointsRDD = sc.parallelize(List(("bar",3.0,5.6),("foo",-1.0,3.0)))

val categoriesRDD = sc.parallelize(List((1,"foo"),(2,"bar")))

val points = pointsRDD.map(line => Point(line._1,line._2,line._3)).toDS

val categories = categories.map(line => Category(line._1,line._2)).toDS

points.join(categories.points("label") === categories("name")).show

举例

使用Dateset完成零售商店指标统计

需求说明

完成数据装载

-

使用RDD装载零售商店业务数据

- customers.csv、orders.csv、order_items.csv、products.csv

-

定义样例类

- Customer、Order、OrderItem、Product

-

将RDD转换为Dataset

请找出:

谁的消费额最高?

哪个铲平销量最高?

import org.apache.spark.sql.SparkSession

import org.apache.spark.sql.functions._

object MythirdSpark {

case class Userinfos(userid:String,fname:String,lname:String,tel:String,tel2:String,addr:String,city:String,state:String,zip:String)

case class Orders(ordid:String,orddate:String,userid:String,ordstatu:String)

case class Products(proid:String,protype:String,title:String,price:String,img:String)

case class OrderItems(id:String,ordid:String,proid:String,buynum:String,countPrice:String,price:String)

def main(args: Array[String]): Unit = {

// 读取数据,生成对应的RDD

// val conf = new SparkConf().setMaster("local[*]").setAppName("myshops")

// val sc = new SparkContext(conf)

val spark = SparkSession.builder().master("local[*]").appName("myshops").getOrCreate()

val users = spark.sparkContext.textFile("file:///d:/data/customers.csv").cache()

val ords = spark.sparkContext.textFile("file:///d:/data/orders.csv").cache()

val pros = spark.sparkContext.textFile("file:///d:/data/products.csv").cache()

val itms = spark.sparkContext.textFile("file:///d:/data/order_items.csv").cache()

import spark.implicits._

val uss = users.map(line => {val e = line.replaceAll("\"","").split(",");

Userinfos(e(0),e(1),e(2),e(3),e(4),e(5),e(6),e(7),e(8))}).toDS()

val orders = ords.map(line => {val e = line.replaceAll("\"","").split(",");

Orders(e(0),e(1),e(2),e(3))}).toDS()

val products = pros.map(line => {val e = line.replaceAll("\"","").split(",");

Products(e(0),e(1),e(2),e(3),e(4))}).toDS()

val items = itms.map(line => {val e = line.replaceAll("\"","").split(",");

OrderItems(e(0),e(1),e(2),e(3),e(4),e(5))}).toDS()

items.groupBy("ordid").agg(round(sum("countPrice"),2).alias("cp"))

.join(orders,"ordid")

.groupBy("userid").agg(sum("cp").alias("cp"))

.orderBy(desc("cp")).limit(1)

.join(uss,"userid").show

items.groupBy("proid").agg(sum("buynum").alias("sales"))

.orderBy(desc("sales")).limit(1).join(products,"proid").show

orders.select($"ordid", dayofweek($"orddate").alias("zj"))

.groupBy("zj").agg(count("ordid")).show()

}

}

DataFrame

DataFrame = Dataset[Row]

类似传统数据的二维表格

在RDD基础上加入了Schema(数据结构信息)

DataFrame Schema支持嵌套数据类型 struct、map、array

提供更多类似SQL操作的API

DataFrame是DataSet的特例

DataFrame放Row对象

RDD与DataFrame对比

431

431

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?