你好,我是Giant。上周我在知乎刷到一个有意思的问题,实验室只有1080显卡,老师还想让发深度学习paper,也不给配置好显卡咋办?

我想起了3年前。我们实验室最开始也只有1080显卡,8个人,4张卡,日子过得紧巴巴。但前期入个门,跑跑简单的实验其实足够用了。

如果想刷比赛或发论文,硬件可能确实是道坎,下面我分享4个方法帮助你解决显卡不足的问题。

1、和老板提需求

在学校的时候,我们NLP组最初只有2张1080,做小实验还好,就是跑BERT-large模型的时候比较蛋疼,只能把 batch_size 设置成1。

后面为了做比赛和发论文,我主动向老板提出申请,希望改善配置。其实老板心里很明白“巧妇难为无米之炊”,升级了硬件,push 学生的时候更合情合理了;等这批人毕业,还能留给下一批学生继续用;甚至连实验室招生通知上都能写人手一张 xx 显卡,简直一举多得。

最终老板为我们采购了4张16G的Tesla V100,虽然花了10万,不过感觉还挺值的。

所以最简单的方法就是给老板做思想工作,帮他分析一下利弊。升级到真香的 3090,大部分老师还是愿意的。

2、白嫖GPU

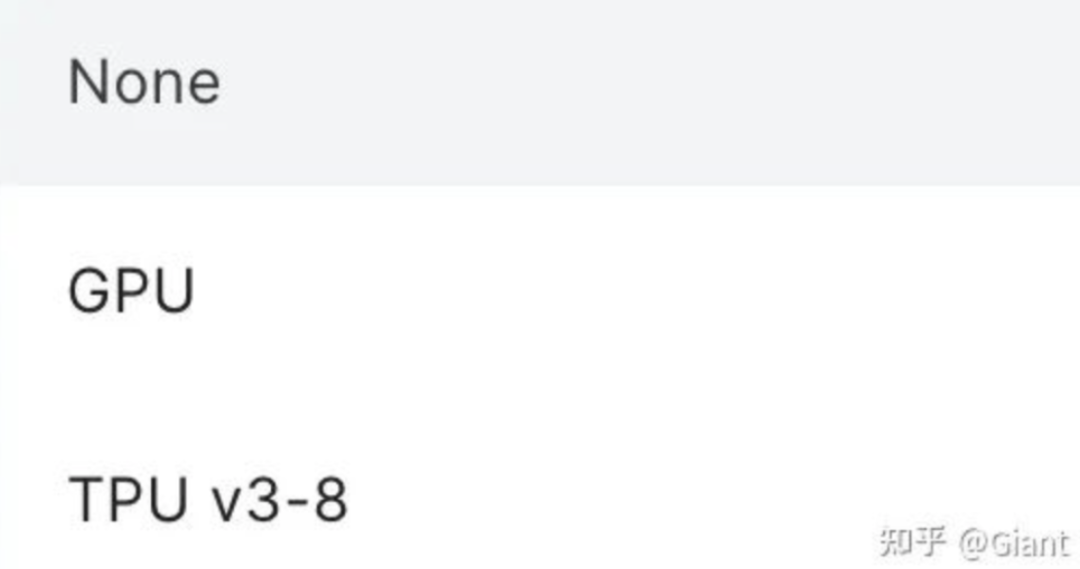

除了实验室,很多平台也提供了免费的GPU计算资源供用户使用。

例如过去两年,我在Kaggle上参加了多个算法比赛,累计使用超过500小时的GPU时长,没花1分钱。

之前我也分享过,如何通过Kaggle免费使用16G显存的Tesla V100。具体方法可以参考原文:

类似的白嫖平台还有Google的Colab,百度AI Studio等。

3、早点开始实习

早点实习既可以积累项目和实战经验,为校招进入职场做准备,又能免费利用公司的GPU,是性价比很高的选择。

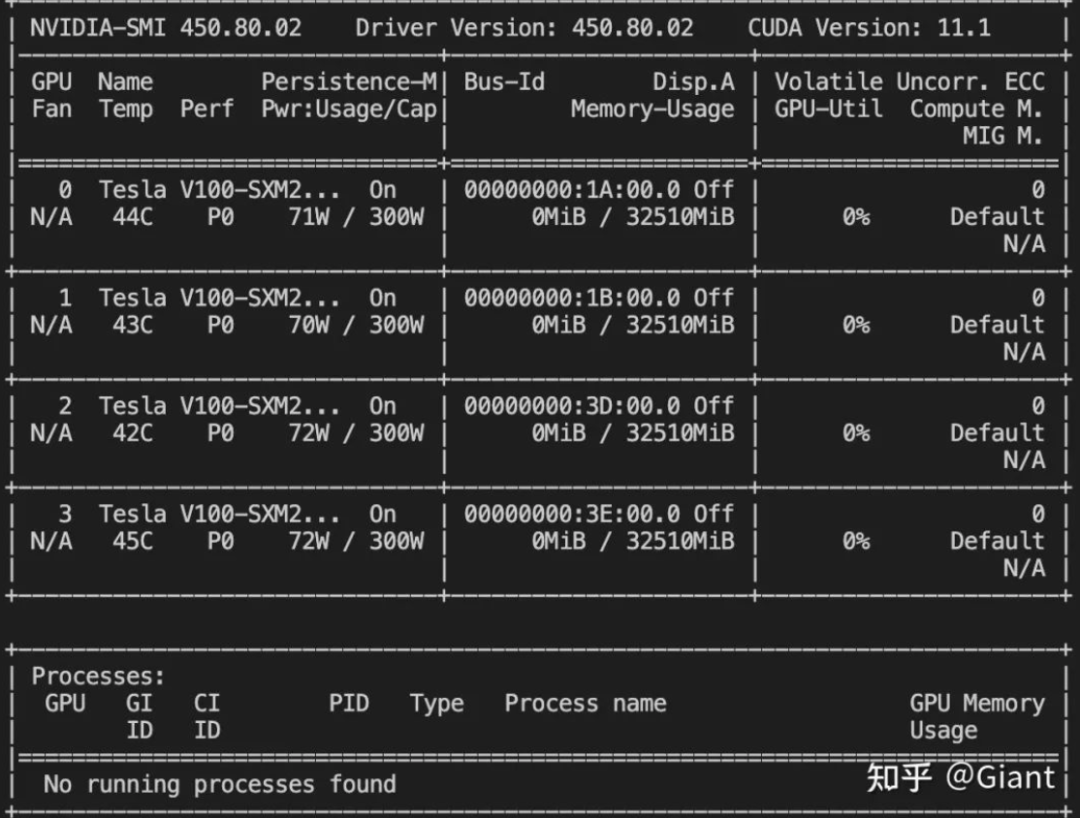

以我司字节为例,通过线上集群调用,工程师们可以同时调用多块Tesla V100-SXM2 GPU,显存32G,基本不用担心模型训练慢了。

关于如何准备深度学习相关的算法实习,我也分享过很多次,基本从理论基础、项目/比赛/paper、coding三个方面准备即可。如果还有疑问,欢迎和我交流。

分享几篇以往的文章:

4、转开发

众所周知,前端后端测试等开发岗位,对于显卡没有特别要求;而且既没有算法这么内卷,和算法的校招薪资差距也在越来越小。

当然,单纯因为显卡不足转开发可不见得是好的选择。提这一点,是希望能帮助你思考,自己喜欢的到底是什么?

是真的对深度学习算法感兴趣呢,还是看身边人都在卷AI,想上去凑个热闹?

了解自己的兴趣爱好、性格特质和优势,真的很重要。

最后,对于土豪们而言,可能直接“显卡自由”了,自己搭服务器也是不错的体验哦。

最近我们建立了深度学习/NLP交流群!想要进交流群学习和唠嗑的同学,可以直接添加微信:cs-yechen

添加时请备注:昵称+学校/公司。群里聚集了很多学术界和工业界大佬,欢迎来一起进阶,突破人生天花板~

后台回复【进群】加入算法求职交流群

后台回复【书单】获取100本AI算法好书

你好,我是Giant,硕士毕业于浙江大学。公众号「NLP情报局」专注分享算法干货和成长逆袭故事,期待你的关注鸭。

您的“点赞/在看/分享”是我坚持的最大动力!

坚持不易,卖萌打滚求鼓励 (。◕ˇ∀ˇ◕)

689

689

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?