一直以来,分析一个算法的时间复杂度对我而言都是很头疼的。直到今天又拿起数据结构,总算是弄明白了。

算法的时间复杂度就是一个算法执行次数的量级,而量级就是多项式的最高次幂。假如代码的执行次数是n(n+1)/2,那最高次幂是n^2,那么多项式的量级就是n方,代码的时间复杂度就是O(n ^2)

那么如果看算法的执行次数呢?几个题就说明白了。

代码块1:

for(int i=0;i<10;i++)

i++;

上面的代码块中,限制条件是 i<10;而 i 的初始值是0,那就执行了10次。如果将10换成n,那就是执行了n次。

代码块2:

x=1;

while(x<n/2)

x=2*x;

这道题中,x的限制条件是x<n/2。首先忽略掉 /2,因为这不影响执行的量级。执行一次,x*2,那执行三次,x=2 ^ 3。设执行次数为 t,就会有2^t<n,t=log2 N。所以时间复杂度即为O(log2 N)。

代码块3:

i=1;k=0;

while(i<n-1){

k=k+10*x;

i++;

}

限制条件是i<n-1,所以执行次数与k没有任何关系。i从0到n-1,一共执行了n-1次。那么时间复杂度就是O(N)。

代码块4:

int i=0;

while(i*i*i<=n)

i++;

执行一次,i+1。而限制条件则是i^3<=n,设执行次数为t,即t ^3<=n。得t=n开三次方

需要注意的是递归函数。比如著名的斐波那契数列的时间复杂度。

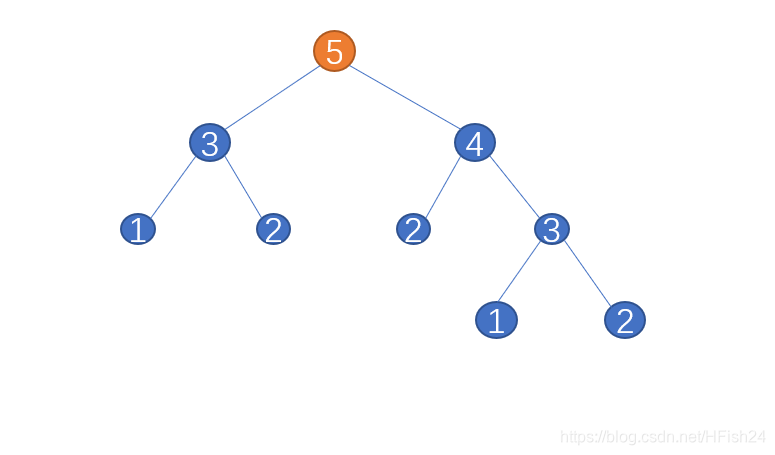

函数体为:f(n)=f(n-1)+f(n-2)

假设n=5,那么f(5)=f(4)+f(3),f(4)=f(3)+f(2),f(3)=f(2)+f(1)…

很自然的可以想到二叉树。

一个节点就是一次执行。可以看到一共执行了9次。2^(n-2)+1。所以时间复杂度为2 ^n。

6885

6885

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?