大家是否好奇过什么是ChatGPT?它是如何工作的?它有哪些强大的语言处理和生成能力?它能够回答哪些领域的问题?它如何通过人机交互来不断提高自己的能力?它的出现如何影响我们对人工智能的认知?

本期红鸟沙龙今天我们非常荣幸邀请到了熊辉教授,熊辉教授是香港科技大学(广州)协理副校长,人工智能学域主任,曾任百度研究院副院长。下面请熊辉教授为我们讲解ChatGPT惊艳:人工智能对人类未来的“危与机”。

(精彩回顾)

01

嘉宾分享

PART/1

数据驱动的人工智能发展

人类主要是由碳元素所构成的,是一种碳基生命。机器主要由硅元素所构成的,我们可以把它叫做硅基生命。

碳基生命的智能主要是分成四个境界,第一个境界就是博闻强记。机器目前已经达到了博闻强记的境界,甚至已经远超人类的博闻强记。

第二个境界是触类旁通。触类旁通建立在博闻强记的基础之上,Chat GPT是一个非常好的触类旁通的工具,拥有ChatGPT就相当于随身携带一个精通各方面知识的专家,可以极大地提高自己的工作效率,深入地了解自身掌握不足或不是自己擅长领域内的知识。

第三个境界是一叶知秋,一叶知秋是推论和预测的阶段。在这个境界中,硅基生命和碳基生命互有长短。

第四个境界是无中生有。无中生有就是所谓的完全的创新,比如爱因斯坦的相对论或者量子纠缠理论。我说的创新不是一种简单的交叉生成式创新,而是一种完全的理论和框架的创新。在这一方面,机器目前来说还是远不如人类。

从博闻强记、触类旁通、一叶知秋再到无中生有,我们可以看到机器正在快速地进步。

在可预见的将来,硅基生命的智能进步速度是飞快的,博闻强记和触类旁通之间已经远超人类,一叶知秋境界也进步飞速。

那么,我们现在所考虑的问题就是:下一个阶段,如果硅基生命能够进入到无中生有的阶段,那么,在人类的创新和整个世界的发展所面临的这种场景下,碳基生命是否已经准备好?

PART/2

ChatGPT:生成模型的本质

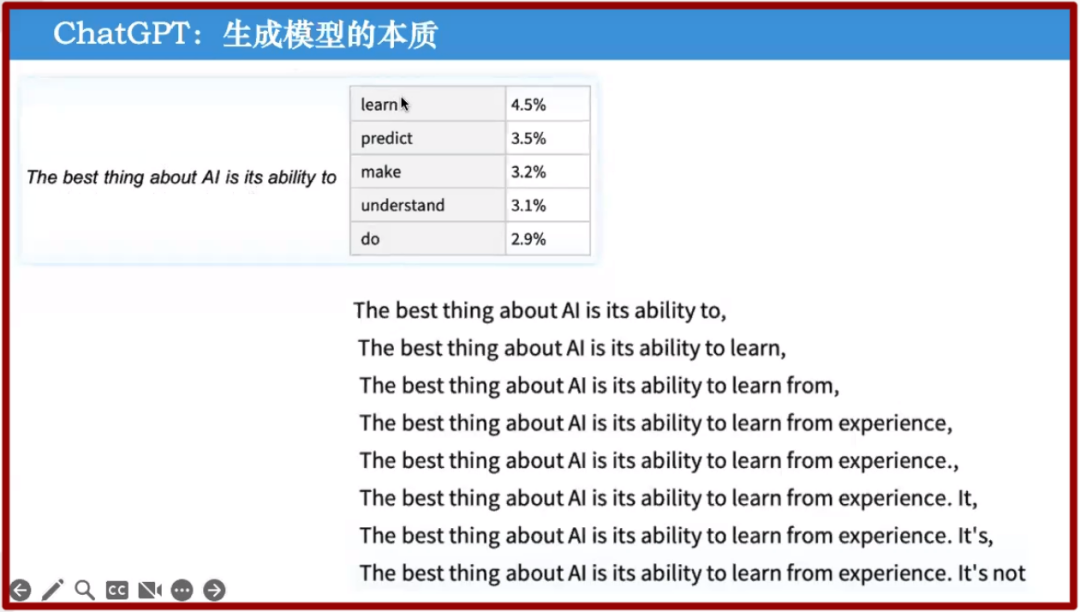

ChatGPT最本质的东西是什么?我们可以用四个字概括:概率生成。

比如,现在我们想做一个完形填空,这个句子我们已经知道前面的部分是the best thing about AI is its ability to,当我们把这个句子的前半部分放在ChatGPT里面,背后跟的就是它的概率,ChatGPT预测出是learn的概率为4.5%,predict的概率是3.5%,make的概率是3.2%,这就涉及一个概率生成的问题。

我们挑概率最大的这个——也就是learn,然后再把这个句子输到ChatGPT里面,出来的下一个单词是from,然后再下个单词就是experience,每次都是按照概率最大去走,这就是属于概率生成的模式。

ChatGPT回答一个问题或者写一篇文章跟人类是不一样的,人类往往是构思出来一整个主线再去写,主题应该怎么去设置,设置好主题以后怎么去写;而ChatGPT是根据以往所看过的文章,一个单词一个单词以大概率的形式往外蹦。

所以,ChatGPT中间使用了一个小小的一个技巧——温度参数。以往的文字生成都是允许用概率最大的那个,现在添加了一个温度参数,温度参数就是说允许用概率不是最大的那个选项去写文章,可能是概率第二大的,这样的话,同一个问题可能产生的答案会稍有不同,这与人类的思维更加相似,是一个human like。

ChatGPT 理解人类世界的阶段很有趣。

·预训练阶段:通过大量人类文本数据来学习语言结构,语法规则和通用知识。通过这种方式,GPT学会了理解语境,捕捉相关概念以及理解各种问题和答案。

·微调阶段:GPT使用具体任务的训练数据进行强化训练,这些数据可以来自特定领域,比如法律,数学,科技等。微调使GPT能适应特定任务,并提高在特定领域表现。

PART/3

ChatGPT出现在人类社会的思考

1.能力需要

ChatGPT可能会减少后代的阅读能力和写作能力。

很多小孩可能从小就开始使用ChatGPT,这会客观导致他们阅读能力和写作能力下降。

使用ChatGPT要有鉴赏能力和判断能力,才能获得你希望得到的。因为ChatGPT的核心是概率生成,它会因为概率问题生成一部分特别不靠谱的、不合逻辑的,甚至是错误的内容。那么这个时候就需要很强的鉴赏能力和判断能力,取其精华,去其糟粕。

此外,还需要强大的创新能力。

我们现在有了一个非常强大的工具,如何帮助我们去激发灵感产生更好的科研问题?是不是可以帮助我们在解决问题的过程中获得灵感?这都需要用非常创新的思维能力去使用它。

所以,我们需要不断地去培养提高我们的提问能力、鉴赏能力和创新能力。同时,我们也要有未来一代阅读能力和写作能力下降的心理准备。因为他们会越来越依赖于ChatGPT这类工具。

2.教育变革

现在,从“书本中来到书本中去”的可言传的知识价值在快速地下降。以后每个人的手机里或者电脑里都会有一个ChatGPT,书本中的知识它知道得远远超乎想象。

我们现在有很多知识只可意会,不可言传,没有办法转化成文字的东西,ChatGPT自然是很难理解,这些知识的实现只能靠体验,需要和人与自然互动才能理解。这些只可意会的知识在ChatGPT盛行时代正具有很好的价值保鲜作用。

3.碳基生命vs硅基生命的三个问题

第一个战略性的问题是碳机生命将我们所掌握的智能的四个境界——博闻强记,触类旁通,一叶知秋和无中生有不断地赋能给硅基生命。当硅基生命掌握之后,我们人类该干什么?人类生存的价值到底体现在哪里?

第二个战略性的问题:ChatGPT继续发展所面临的问题是把大量的脑力工作者(特别是文字、设计、绘画甚至是包括初级程序员)替代,很多涉及文字岗位相关的工作者会面临失业。

第三个问题是机器一旦掌握了强大的逻辑推理能力之后,硅基生命会不会在某一天意识觉醒?

PART/4

ChatGPT历程

1.横空出世

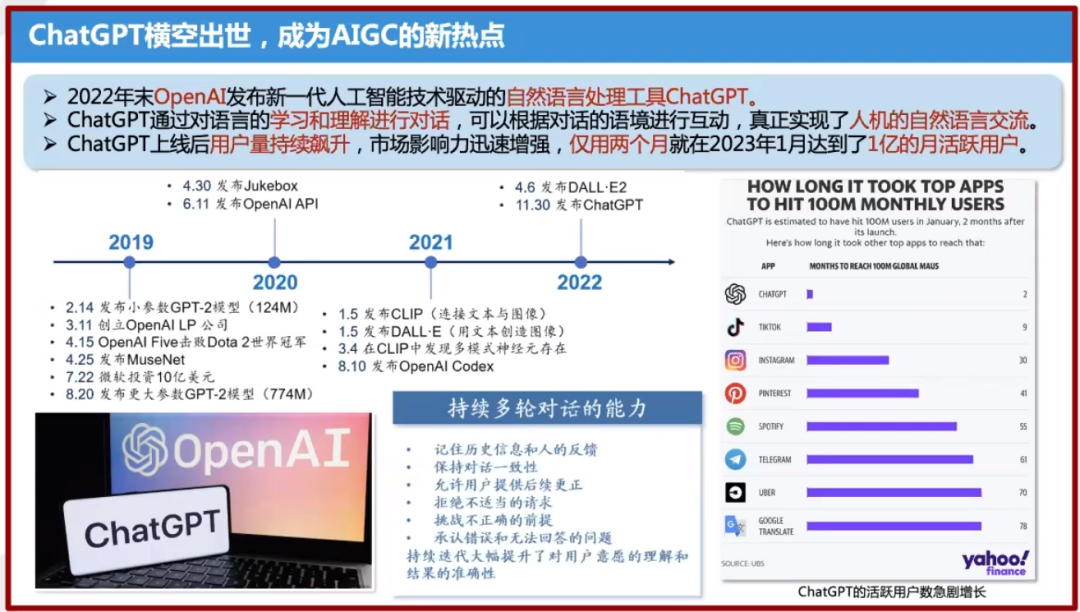

ChatGPT成长是非常快的。2019年2月14日发布小参数的GPT two的模型,然后快速地就到了2022年11月30日发布了ChatGPT。

这是人类历史上第一次,仅仅用了两个月就达到了一个亿的月活,TikTok花了9个月才达到1个亿的月活。这说明它是真正的能够带来巨大改变的工具。

2.ChatGPT 强大能力

ChatGPT有很多的能力。比如:完备的文本生成能力,可帮助新闻行业从业者撰写推文、文章续写;强大的对话能力,可帮助人类进行心理疏导、教育辅导;出色的代码能力,可帮助程序员查明BUG、生成代码。

3.ChatGPT发展

从技术发展角度来讲,这个圈的GPT的架构跟谷歌的不一样,它是完全基于注意力机制的Transformer架构奠定了GPT系列的技术基础。

从GPT-1到ChatGPT,模型规模越来越大,所使用的预训练数据量越来越多,系统越来越智能。

人类反馈强化学习(Reinforcement Learning From Human Feedback,RLHF)、代码预训练(Codex)、指示微调( Instruction Tuning)赋予了ChatGPT更强的智能。

PART/5

ChatGPT的挑战

1.伦理和安全问题

伦理问题:ChatGPT被刻意引导后可打破规则限制,作出具有仇恨言论、种族主义、性别歧视等偏见和有害的回答。

隐私问题:ChatGPT数据用途规范不明确,用户交互数据的隐私性存在很大问题。

知识产权问题:ChatGPT不具备法律人格,其生成内容的知识产权归属难以界定。知识权利人维权难度大。

2. 信息滞后,缺乏实时更新的机制

ChatGPT的认知建立在训练文本上,缺乏实时数据库或信息连接,对于超过训练数据集的问题无法回答。

由于大模型的训练技术限制,重新预训练模型需要巨大的时间和计算成本,技术上难以做到实时更新训练。

如果采用使用微调训练新知识,会导致新知识的权重过高,频繁的微调也会导致模型“遗忘”旧知识。

3. 成本高昂

需要大量算力支撑其训练,部署与应用,行业落地难,难以大范围使用。

训练成本:预训练成本高昂,所需数据量大,服务器需求高。

推理成本:ChatGPT推理一条信息的成本是目前传统搜索引擎的3到4倍,单次搜索成本过于高昂。

环境成本:ChatGPT产生很高的碳排放,对环境负荷压力大。

02

嘉宾对谈

Q

提问:概率生成式的这种AI模式离我们人类真正意义上的“理解问题”还有多远呢?

A

熊辉:其实这是一个非常具有挑战性和争议性的问题,大家的看法有很大的不一致。

我们发现这个大模型大到一定的地步之后会出现一种涌现的现象。这种涌现的现象用概率生成的方式很难去理解他,这个问题我现在无法给出一个非常具体的这种答案。因为就像我刚才所说的,我们自己都在争吵和理解。

Q

提问:想请您分析一下,人工智能目前处于什么阶段,未来什么时候能够达到最后一个阶段?达到最后一个阶段需要哪些方面的技术突破?

A

熊辉:我认为机器现在是属于一叶知秋的高级阶段。在推理和预测的很多方面已经超越人类了,但是在某些方面人类还是会领先于机器的。

就像我刚才所说的,我对于无中生有的定义相对比较狭隘,真正的无中生有属于理论体系的创新和框架的创新。

比如说像爱因斯坦的相对论或者量子纠缠理论。这种理论是非常创新性的体系。什么时候能出现?我还真不好回答。

但是我能够感觉到现在的科技属于一个井喷的状态,每天好像都会有一些新的东西诞生。所以我有预感,无中生有已经看到曙光。

Q

提问:互联网的巨头们都在考虑做自己大语言模型。这种状况会持续多久?另外您觉得今后这种状态发展的方向是一个什么样的情况?是一家独大?还是百花齐放?

A

熊辉:首先我认为做大语言模型肯定是有必要的。因为ChatGPT它本身是具有自我强化功能的。在不断的运用大模型的过程中,它可以不断地从更多人的提问中去吸取营养,不断地进步。

所以无论是站在战略层面还是经济层面,他们都有必要去做自己的大模型。

未来有可能从业态上来说更像云。从市场的切分来说,在美国有微软的云、谷歌的云,也有亚马逊的云;中国未来也是一样,有百度的GPT,也会有华为的GPT,也会有阿里的GPT,只是大家的侧重点可能会不一样。

主编 | 袁冶

责编 | 吴倩

核校 | 柳松、许珺、周姗

(红鸟沙龙由香港科技大学副教授王一老师主持,旨在建立一个各界菁英与高校师生沟通以及公众了解知识的窗口,打造一个深刻、客观、理性、知性的分享平台。)

本文探讨了ChatGPT的工作原理、强大的语言处理能力、对人类工作的影响,以及人工智能发展中面临的伦理、安全和信息滞后等问题。专家熊辉教授解析了ChatGPT在人工智能四个境界的应用和未来可能带来的变革。

本文探讨了ChatGPT的工作原理、强大的语言处理能力、对人类工作的影响,以及人工智能发展中面临的伦理、安全和信息滞后等问题。专家熊辉教授解析了ChatGPT在人工智能四个境界的应用和未来可能带来的变革。

3

3

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?