01 AI大模型这盘棋,棋手和棋子都在哪?

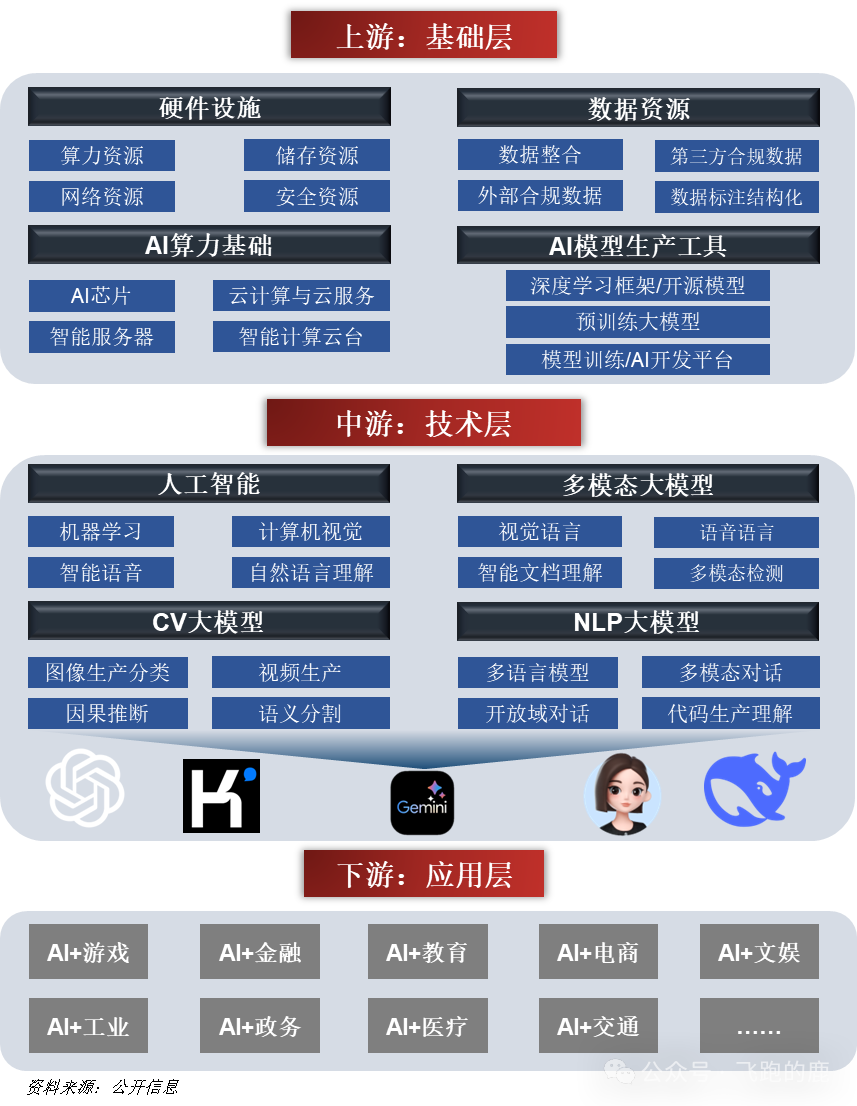

这图,乍一看挺唬人,各种箭头指来指去。说白了,就是想告诉你AI大模型这玩意儿不是凭空冒出来的,背后有一堆“供应商”在给它“输血”。从最底层的算力芯片,到中间的数据和算法,再到上层的各种应用,一层套一层。但问题是,这链条真有这么清晰?还是说,这里面水深着呢?作为网络安全从业者,我首先看到的是无数潜在的攻击点和脆弱环节。

02 AI大模型:是神话、是泡沫,还是下一代核武器?

02-1 AI大模型?不就是个参数多到爆的“大力丸”嘛!

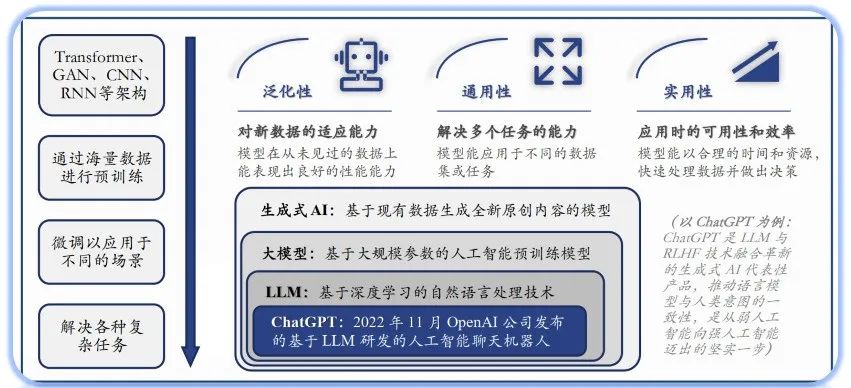

AI大模型?听着就挺唬人,对吧?说白了,这玩意儿就是个参数多到吓死人——动不动就拿“十亿”当起步价——的机器学习怪物。它不光块头大,结构也复杂得像迷宫,专门用来吞吐天文数字般的数据,然后干点儿以前机器想都不敢想的活儿,比如跟你贫嘴、给你画画,甚至帮你写代码。但别忘了,块头大不代表没弱点,参数多也可能意味着更容易被“污染”或“欺骗”。安全,安全,还是TMD安全!

02-2 三个“大”字,道尽了AI大模型的“不讲理”

“数据规模大”、“模型参数量大”、“计算复杂度高”——这不就是废话文学嘛!当然大啊,不大能叫“大”模型?关键是,这三个“大”背后,藏着多少安全隐患?数据从哪来?干净吗?有没有被投毒?参数那么大,黑箱操作,谁来审计?万一跑偏了,谁负责?计算复杂度高,意味着更容易出现意想不到的漏洞和后门。别光看光鲜的外表,想想背后的风险!

02-3 模型分类?我看是“能力圈地”运动!

什么NLP、CV、多模态……听着高大上,不就是各家厂商划地盘嘛!你搞文本的,我搞图像的,他搞音视频的。然后呢?都想搞“通吃”的多模态。这背后,是技术的自然演进,还是资本的逐利本性?我更倾向于后者。而且,不同类型的模型,安全侧重点也完全不一样。搞文本的,要防范对抗性攻击、敏感信息泄露;搞图像的,要小心深度伪造(Deepfake)被滥用。这分类图,更像是一张“风险地图索引”。

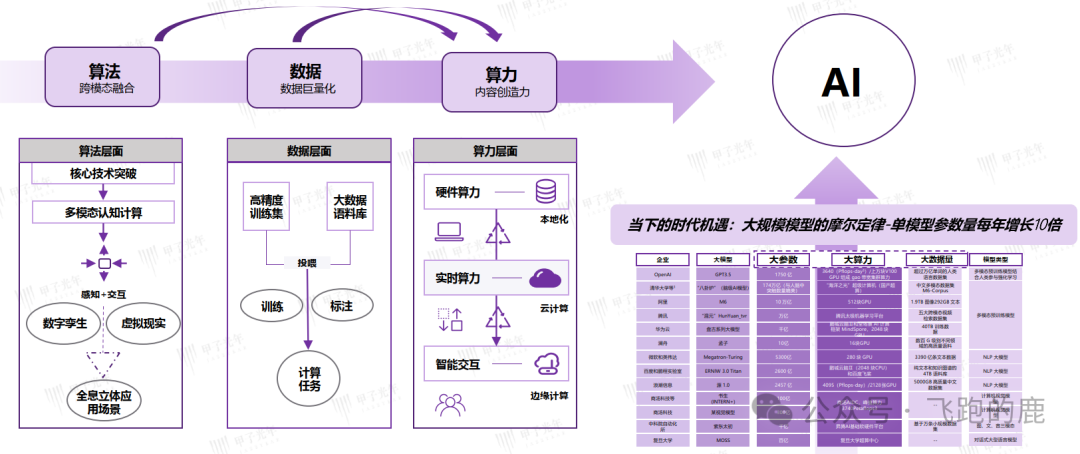

02-4 算力是爹,算法是妈,数据是奶,这话糙理不糙!

现在这人工智能圈子,算力简直就是命根子!没它,你算法再牛逼,数据再海量,也只能干瞪眼。预训练、微调、推理……哪个环节离得开算力的“暴力输出”?

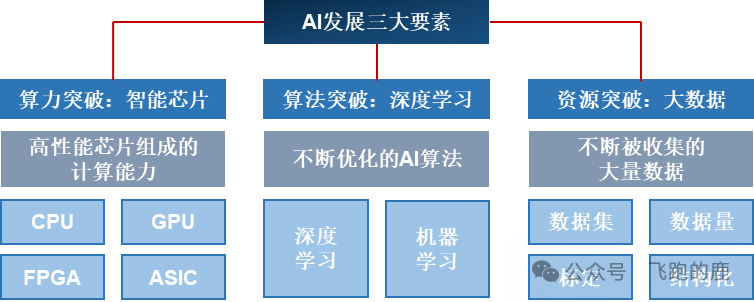

这图想说啥?不就是“算力、算法、数据”三位一体,共同托起了AI大厦嘛。但我想说的是,这三者哪个环节出了安全问题,整个大厦都可能塌方!算力被劫持挖矿?算法被植入后门?数据被污染投毒?想想都头皮发麻。所以,别光盯着技术怎么发展,更要盯着这根基牢不牢靠!

03 上游那些“军火商”:谁在给AI大模型“递刀子”?

所谓的上游,就是给AI大模型提供“弹药”的。算力、算法、数据,一个都不能少。但这些“军火商”们,真的都那么可靠吗?他们的产品和服务,会不会成为新的安全短板?值得深思。

03-1 算力:AI的“核动力”,但小心别“堆芯熔毁”!

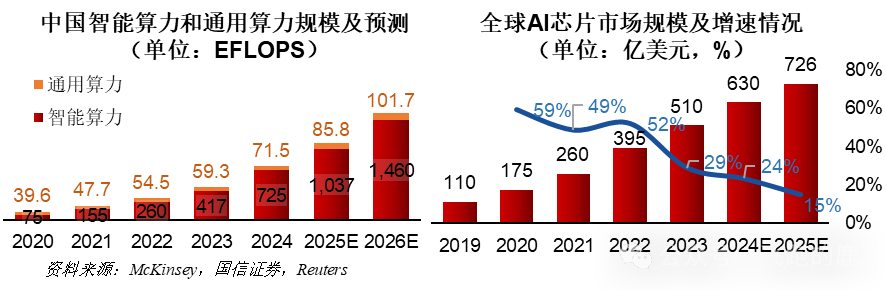

AI大模型这玩意儿,简直就是个算力吞噬兽!据说啊,到2025年,它对算力的需求能翻个十倍,其中一大半还是企业应用给“贡献”的。这数字,听着就让人血压飙升。

芯片这块儿,NVIDIA那老黄简直是躺着数钱,全球高性能AI芯片市场,他家占了八成还多!A100/H100这种尖货,根本不愁卖,价格翻着跟头往上涨,据说都涨了三倍了!简直是“一卡难求”的盛况。国内这帮兄弟们也没闲着,华为昇腾、寒武纪、壁仞科技这些,都在玩命追赶,指望着到2025年能从老黄嘴里抢下三成国内市场。有志气!但路漫漫其修远兮啊。

再看云计算那帮巨头,AWS、Azure、Google Cloud,哥仨就把全球AI云算力市场的七成给瓜分了,2023年这盘子就有640亿美刀那么大!国内的阿里云、华为云、腾讯云也不甘示弱,阿里云甚至放出话来,未来三年要砸524亿美刀扩充AI算力。这是要搞“算力军备竞赛”的节奏?

这张图,不就是想说算力需求怎么涨,谁在分蛋糕嘛。但从安全的角度看,算力高度集中在少数几家厂商手里,这本身就是个巨大的风险。一旦这些厂商的设施受到攻击,或者出现供应链安全问题,那影响面可就大了去了。而且,算力租赁模式下,数据的安全和隔离也是个大问题。你的数据在别人的服务器上跑,你真能睡得着觉?

AI算力服务商这摊子事儿,是越来越复杂了。产品和服务花样百出,市场也变得五花八门。

这张图想表达的是市场在细分,服务在深化。但我想说的是,越复杂,攻击面就越大!新的服务模式,就意味着新的安全挑战。比如,模型即服务(MaaS),听着很美,但模型的安全性、API接口的防护、用户数据的隔离,这些都是需要重点关注的。别光想着怎么卖服务,先想想怎么保证安全吧!

03-2 算法:AI的“大脑”,别让它“精神分裂”!

算法,这可是AI大模型的灵魂!什么深度学习框架啦,优化策略啦,都属于这个范畴。

说到Transformer,那可是个里程碑式的玩意儿。2017年Google那帮人搞出来的,直接掀起了AI大模型的革命,成了现在的技术底座。跟以前那些RNN比,计算效率提升了十倍不止!这简直是给AI插上了翅膀。

不过,AI训练成本也是个无底洞。GPT-4那家伙,光训练一次就可能烧掉超过1亿美刀!所以啊,什么稀疏化、蒸馏、量化这些技术就应运而生了,据说能把训练成本砍掉三到五成。省钱就是硬道理!但这些优化会不会引入新的漏洞?或者降低模型的鲁棒性?这都是需要警惕的。

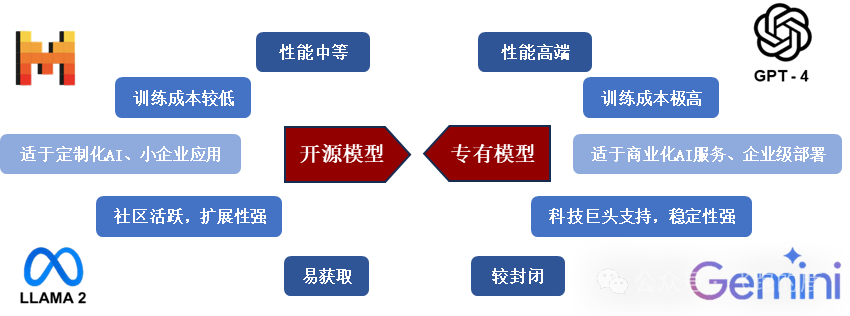

开源和专有模型之间,那也是打得不可开交。

这图列了开源和专有模型的优劣势。开源的好处是透明、灵活,大家一起添砖加瓦。但问题是,谁都能看,谁都能改,安全性怎么保证?会不会被人恶意植入后门?专有模型呢,安全性相对可控,但又容易形成技术壁垒和垄断。真是个两难的选择。在我看来,没有绝对的安全,只有持续的对抗和博弈。

最新的算法动态,那更是花样翻新。2023年,多模态大模型火了,像GPT-4V、Gemini这些,不光能处理文字,还能看图、听声、看视频,简直是“全能选手”。还有那个强化学习(RLHF),通过人类反馈来优化AI的交互能力,让AI更“懂事儿”。技术进步是好事,但能力越强,责任越大。这些新能力会不会被滥用?比如生成虚假视频、音频进行诈骗?细思极恐。

算法从“实验室”走向“应用场”,这路可不好走。

这图说的是算法怎么落地。但我想强调的是,算法的公平性、可解释性和鲁棒性,在实际应用中至关重要。如果算法存在偏见,或者决策过程完全是个黑箱,那谁敢用?尤其是在金融、医疗这些敏感领域。算法的安全性,不仅仅是技术问题,更是伦理和社会问题。

数字经济时代,数据跟石油一样宝贵,甚至更宝贵!大数据、云计算、人工智能这些新技术一顿操作猛如虎,数据的价值蹭蹭往上涨,成了推动经济发展的“新燃料”,甚至能改变全球的竞争格局。

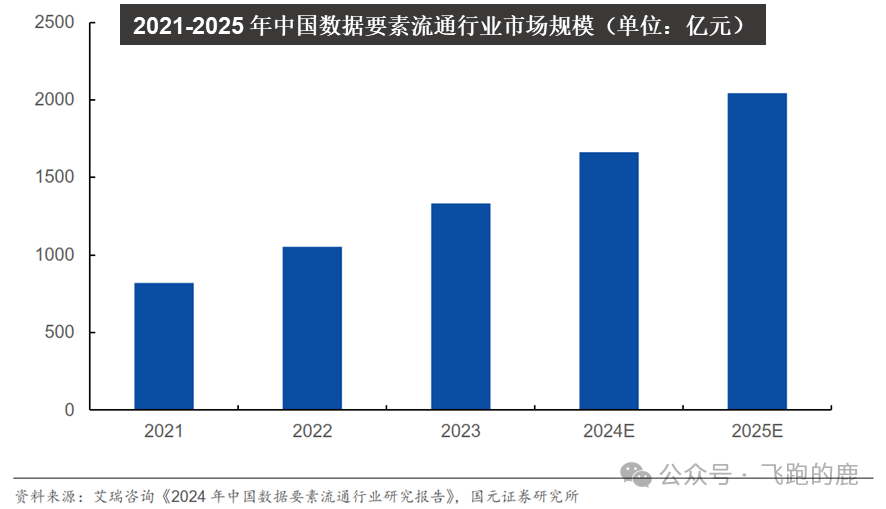

国家层面也坐不住了。2024年1月,国家数据局就搞了个《“数据要素X”三年行动计划(2024-2026 年)》。政务、金融、互联网、交通、电力这些行业都在使劲挖掘数据价值。艾瑞咨询那帮人预测,2024年这市场规模能到1662.0亿元,到2025年更是有望冲到2042.9亿元。钱景广阔啊!

这图展示了数据要素市场的蓬勃发展。但数据要素化,说白了就是把原始数据变成能交易、能产生价值的“商品”。这个过程中,数据的采集、清洗、标注、确权、定价、流通、安全保护,哪个环节都不能掉链子。尤其是数据安全和隐私保护,简直是悬在头上的达摩克利斯之剑。数据一旦泄露或被滥用,后果不堪设想。

数据要素这个产业链条,主要分三大块:数据资源要素化、市场化流通和数据要素应用。简单说,就是先把原始数据采过来、归类、加工、管理,变成“数据资产”,再进一步加工成“数据产品”。然后呢,要么挂牌上市交易,要么私下里撮合,让有需求的企业用起来。中间还有一堆第三方服务机构,搞咨询审计、评估仲裁什么的,帮着把这事儿盘活。这里面牵扯的玩家太多太杂,大家一起发财,但也得一起担风险。

这张图把数据要素的流转过程画出来了。从数据采集到最终应用,环节众多。我的职业病又犯了:这么多环节,就意味着这么多潜在的泄露点和攻击面!数据在哪个环节被篡改?在哪个环节被窃取?谁来为数据的真实性和完整性负责?这些都是需要用放大镜仔细审视的问题。

03-3 数据:AI的“饲料”,千万别喂“垃圾”!

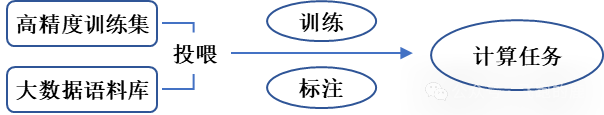

数据,这可是AI大模型的“口粮”,没它就饿死了。高质量的数据集和标注信息,那是基础中的基础。

这图展示了数据的来源和处理流程。看起来挺美好,但现实往往是骨感的。数据的来源五花八门,质量参差不齐。如何保证数据的合规性、准确性、时效性?这都是大大的问号。

“Garbage In, Garbage Out”——这句老话在AI领域简直是真理!喂进去的是垃圾,吐出来的自然也是垃圾。有研究说,AI模型表现不好,九成问题都出在数据质量上,而不是模型结构本身!可见,数据有多重要。但问题是,谁来定义什么是“高质量”数据?标准是什么?如何防止“数据投毒”这种恶意攻击?

数据的多样性也很关键,能让模型更“见多识广”,不容易“偏科”。GPT-4不就号称能处理文本和图像数据嘛。Google的PaLM2模型更是把文本、图像、音频都给整合进去了,这样在各种任务上都能露一手。听起来不错,但数据来源越多样,管理的难度和风险也越大。不同类型数据的安全要求和隐私保护策略,能一样吗?

说到前沿算法,现在AI技术本身也能反过来帮忙处理数据了。比如自监督学习、异常值检测、自动标注这些技术,都能加速数据清洗和预处理。NLP领域常用的Tokenization(分词)和Embeddings(嵌入),也是处理文本数据的重要手段。

这图讲的是AI技术如何反哺数据处理。用AI来处理数据,听起来像是个“永动机”。但问题是,如果用于数据处理的AI模型本身就有偏见或漏洞呢?那岂不是错上加错?而且,Tokenization和Embeddings这些技术,虽然能提高效率,但也可能在处理过程中丢失关键信息,或者引入新的安全风险。比如,对抗性攻击者可能会利用这些技术的特点,构造出能够欺骗模型的恶意输入。所以,技术是双刃剑,用的时候得悠着点。

04 中游这帮“炼丹师”:谁在“闭门造车”,谁在“引领潮流”?

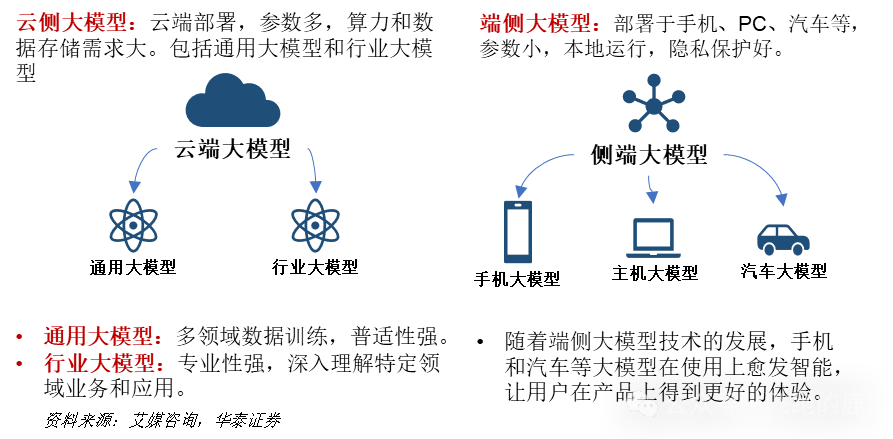

所谓的“百模大战”,听着热闹,其实就是各家AI大厂在秀肌肉,比谁的模型参数更多、能力更强、更能吹。但这里面,有多少是真材实料,有多少是资本泡沫?作为旁观者,我更关心的是,这些模型在安全性和可靠性上,能不能打?

04-1 国际赛场:巨头们的“军备竞赛”,我们只能当观众?

看看这表格,OpenAI、Google、Meta……个个都是响当当的名字。参数规模、数据量、发布时间,列得清清楚楚。但我想问的是,这些模型的训练数据都经过严格的审查了吗?有没有潜在的偏见和歧视?模型的决策过程透明吗?一旦出现问题,谁来负责?这些问题,比参数规模更值得关注。而且,这些核心技术都掌握在少数几家国外巨头手里,对我们来说,始终是个隐患。

04-2 国内战场:“诸侯割据”,谁能杀出重围,一统江湖?

再瞅瞅国内这帮“卷王”,百度文心、阿里通义、华为盘古、讯飞星火……也是打得火热。参数规模虽然还没法跟国际顶尖的比,但也在奋起直追。这股劲头是好的,但千万别光顾着堆参数、赶进度,把安全和质量给落下了。模型的鲁棒性、抗干扰能力、隐私保护能力,这些都是硬指标。别到时候模型是做出来了,结果一攻就破,或者动不动就胡说八道,那可就成了笑话了。而且,国内这些模型,有多少是真正自主可控的?有多少是在别人的地基上盖房子?这都是需要打个问号的。

05 下游应用:AI这把“万能钥匙”,能打开多少扇门,又会撬开多少“潘多拉魔盒”?

05-1 AI市场打了鸡血,下游需求嗷嗷待哺,场景多得眼花缭乱!

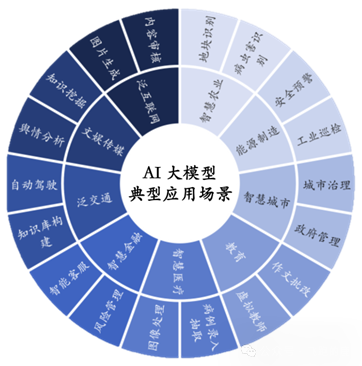

据说啊,2022年中国人工智能行业的盘子就有3716亿人民币那么大,到2027年更是要冲到15372亿!这增长速度,简直是坐上了火箭。AI这玩意儿,正憋着劲儿往制造、交通、金融、医疗这些传统行业里钻,指望着能遍地开花,大规模落地。

这图画了个大饼,展示了AI在各个行业的渗透潜力。看着是挺美好,但每个行业都有自己的特殊性和安全需求。AI在金融行业用,得考虑数据安全、交易安全、反欺诈;在医疗行业用,得考虑患者隐私、诊断准确性、医疗责任;在交通行业用,得考虑系统可靠性、人身安全。如果AI系统本身就不安全,那应用到这些关键领域,简直就是埋下了定时炸弹!

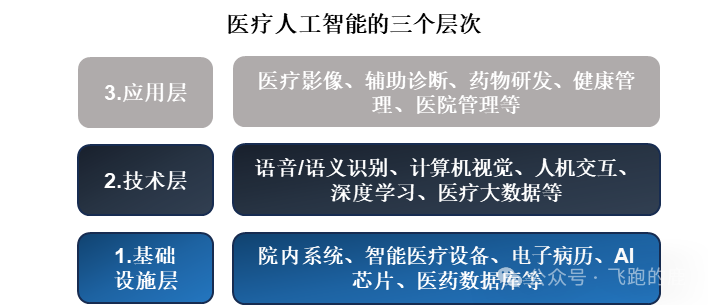

05-2 AI + 医疗:是“华佗再世”,还是“病急乱投医”?

AI在医疗行业的应用,听起来确实能解决不少痛点。什么医疗资源不够用啦,分布不均啦,人口老龄化啦,健康意识提高啦,都指望着AI来力挽狂狂澜。医疗影像、辅助诊断、新药研发、健康管理……AI好像无所不能。医疗影像算是比较成熟的了,手术机器人也挺活跃,新药研发靠AI的算力和算法优势也能提提速,健康管理更是五花八门。但问题是,医疗数据可是最敏感的隐私数据之一,一旦泄露,后果不堪设想。AI辅助诊断如果出了错,责任谁来负?新药研发如果被AI带偏了方向,浪费的可是真金白银和宝贵时间。所以,AI+医疗,前景光明,但道路曲折,安全和伦理问题必须高度重视!

05-3 AI + 金融:是“点石成金”,还是“引狼入室”?

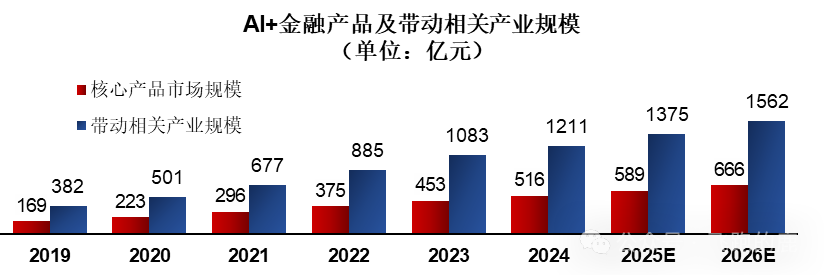

金融这行当,对信息安全的要求那是出了名的高。数据处理量大,信息基础设施也相对完善,所以AI技术早早就在营销、合规、风控这些场景里扎下了根,而且发展得还不错。

这图里列的智能客服、智能投顾、智能风控、智能营销,听着都挺智能。但金融领域的核心是什么?是信任!如果AI系统被攻击,导致客户资金损失,或者交易数据被篡改,那金融机构的信誉可就全完了。智能投顾如果给出了错误的投资建议,导致用户亏损,算谁的?智能风控如果出现了误判,把好人当坏人,或者把坏人放过,那麻烦可就大了。所以,AI在金融领域的应用,必须把安全放在第一位,任何时候都不能掉以轻心!

05-4 AI + 物流:是“降本增效”,还是“添堵添乱”?

智能仓储、智能调度、无人配送……AI在物流行业的应用,听起来能解决不少人力成本高、效率低下的问题。但这背后,同样隐藏着安全风险。智能仓储系统如果被黑客入侵,可能导致货物管理混乱甚至被盗。智能调度系统如果出现故障,可能导致大规模的物流拥堵。无人配送车辆如果被劫持或控制,后果更是不堪设想。所以,AI+物流,在追求效率的同时,也必须高度关注系统的可靠性和安全性。别到时候货没送到,反而惹出一堆麻烦。

06 未来趋势?我看是“机遇与挑战并存,馅饼与陷阱同在”!

06-1 技术深化与融合?说白了就是“能力越来越强,也越来越难管”!

什么多模态融合加速啦,强化学习与人类反馈结合啦,算法优化与效率提升啦……这些技术趋势,听着都挺牛。AI大模型以后能看、能听、能说、能思考,越来越像人,甚至在某些方面比人还强。但问题是,能力越强,就越难控制。一旦被滥用,造成的破坏也越大。算法优化是好事,但别为了追求效率,牺牲了安全性和鲁棒性。

06-2 产业生态与商业模式变革?我看是“新瓶装旧酒,换汤不换药”!

MaaS模式(模型即服务)要成为主流?说白了就是把AI大模型当成水电煤一样卖。听起来挺方便,降低了开发门槛。但模型的安全性、可靠性、合规性谁来保证?生态开放性竞争加剧?说白了就是拉帮结派,抢占地盘。行业大模型定制化?听起来是精准服务,但会不会造成新的数据孤岛和技术壁垒?这些所谓的变革,如果不能解决核心的安全和信任问题,那就只是换了个马甲而已。

06-3 政策和伦理挑战?这才是“房间里的大象”,谁都躲不过!

政策监管肯定会加强,这是板上钉钉的事。生成式AI、数据隐私、算法伦理……这些都是烫手的山芋。政府不出手管管,那还得了?伦理和可持续发展也得提上日程。AI技术不能光追求强大,还得符合人类的价值观和社会利益。数据安全和隐私保护,更是重中之重。数据是AI的命根子,如果数据不安全,那AI大厦随时都可能塌方。这些挑战,可比技术上的突破难多了!解决不好,AI大模型这股风,可能就不是什么好风了。

*************************************2025最新版CSDN大礼包:《AGI大模型学习资源包》免费分享***************************************

一、2025最新大模型学习路线

一个明确的学习路线可以帮助新人了解从哪里开始,按照什么顺序学习,以及需要掌握哪些知识点。大模型领域涉及的知识点非常广泛,没有明确的学习路线可能会导致新人感到迷茫,不知道应该专注于哪些内容。

我们把学习路线分成L1到L4四个阶段,一步步带你从入门到进阶,从理论到实战。

L1级别:AI大模型时代的华丽登场

L1阶段:我们会去了解大模型的基础知识,以及大模型在各个行业的应用和分析;学习理解大模型的核心原理,关键技术,以及大模型应用场景;通过理论原理结合多个项目实战,从提示工程基础到提示工程进阶,掌握Prompt提示工程。

L2级别:AI大模型RAG应用开发工程

L2阶段是我们的AI大模型RAG应用开发工程,我们会去学习RAG检索增强生成:包括Naive RAG、Advanced-RAG以及RAG性能评估,还有GraphRAG在内的多个RAG热门项目的分析。

L3级别:大模型Agent应用架构进阶实践

L3阶段:大模型Agent应用架构进阶实现,我们会去学习LangChain、 LIamaIndex框架,也会学习到AutoGPT、 MetaGPT等多Agent系统,打造我们自己的Agent智能体;同时还可以学习到包括Coze、Dify在内的可视化工具的使用。

L4级别:大模型微调与私有化部署

L4阶段:大模型的微调和私有化部署,我们会更加深入的探讨Transformer架构,学习大模型的微调技术,利用DeepSpeed、Lamam Factory等工具快速进行模型微调;并通过Ollama、vLLM等推理部署框架,实现模型的快速部署。

整个大模型学习路线L1主要是对大模型的理论基础、生态以及提示词他的一个学习掌握;而L3 L4更多的是通过项目实战来掌握大模型的应用开发,针对以上大模型的学习路线我们也整理了对应的学习视频教程,和配套的学习资料。

二、大模型经典PDF书籍

书籍和学习文档资料是学习大模型过程中必不可少的,我们精选了一系列深入探讨大模型技术的书籍和学习文档,它们由领域内的顶尖专家撰写,内容全面、深入、详尽,为你学习大模型提供坚实的理论基础。(书籍含电子版PDF)

三、大模型视频教程

对于很多自学或者没有基础的同学来说,书籍这些纯文字类的学习教材会觉得比较晦涩难以理解,因此,我们提供了丰富的大模型视频教程,以动态、形象的方式展示技术概念,帮助你更快、更轻松地掌握核心知识。

四、大模型项目实战

学以致用 ,当你的理论知识积累到一定程度,就需要通过项目实战,在实际操作中检验和巩固你所学到的知识,同时为你找工作和职业发展打下坚实的基础。

五、大模型面试题

面试不仅是技术的较量,更需要充分的准备。

在你已经掌握了大模型技术之后,就需要开始准备面试,我们将提供精心整理的大模型面试题库,涵盖当前面试中可能遇到的各种技术问题,让你在面试中游刃有余。

因篇幅有限,仅展示部分资料,需要点击下方链接即可前往获取

*************************************2025最新版CSDN大礼包:《AGI大模型学习资源包》免费分享*************************************

70

70

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?