阅读笔记:Exploring the Limits of Transfer Learning with a Unified Text-to-Text Transformer

Contributions

先放贡献:最近谷歌发布的T5预训练模型在Glue,SuperGlue以及Squad任务上都超越了BERT,好不风光。在小编看来,它最主要的贡献是:

- 提出一个通用框架 – T5

- 公开的C4数据集

- 各种预训练的试验,对比结果,给出推荐参数

Text-to-Text Transfer Transformer (T5)

-

它依然是基于Transformer的预训练模型

-

将主流NLP任务(MT, QA, 摘要,分类)都转换为Text-to-Text的任务

(Text-to-Text:Where the model is fed some text for contex or conditioning and is then asked to produce some output text),如下图:

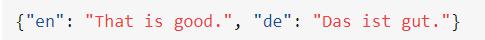

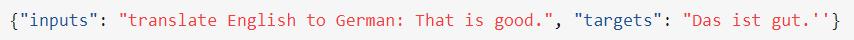

注:为了帮助区分不同任务,在数据之前加prefix,如:

变为:

分类任务则为分类的label,比如“negative”;Regression任务,拿STS-B(相似任务)来说:1-5分,每0.2分为一个度量,则输出四舍五入到最近的0.2的整数倍,如:2.57→2.60,输出为String。通过这样的方式将不同的NLP 任务都转换成统一格式,就可以用同样的模型,同样的损失函数,同样的训练过程,同样的解码过程来完成不同 NLP 任务。其实这个idea在GPT-2论文中就曾提及,在这篇论文中终于实现了。

Colossal Clean Crawled Corpus (C4)

- 源自Common Crawl (一个公开的网页存档数据集,每个月抓取约20TB 文本数据)

- 目前只有英语

- 进行清洗&#

谷歌发布的T5模型在多个NLP任务上超越BERT,其主要贡献包括提出通用框架T5,发布大规模清洗数据集C4,以及进行多样化的预训练试验。T5将各种任务转化为Text-to-Text形式,使用相同的模型结构、损失函数和训练过程,以Encoder-Decoder结构表现最佳。实验表明,Denoising objective(BERT-style)优于其他预训练目标,且模型规模和训练时间的增加能提升性能。

谷歌发布的T5模型在多个NLP任务上超越BERT,其主要贡献包括提出通用框架T5,发布大规模清洗数据集C4,以及进行多样化的预训练试验。T5将各种任务转化为Text-to-Text形式,使用相同的模型结构、损失函数和训练过程,以Encoder-Decoder结构表现最佳。实验表明,Denoising objective(BERT-style)优于其他预训练目标,且模型规模和训练时间的增加能提升性能。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

3343

3343

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?