文章目录

1. 前言

限于作者能力水平,本文可能存在谬误,因此而给读者带来的损失,作者不做任何承诺。

2. 音频编程基础

2.1 采样率

单位时间 1 秒内,采样的音频数据个数。常见的采样率有如下这些:

| 采样率 | 特点 | 应用场景 |

|---|---|---|

8 kHz | 较低的采样率,适合人类语言交流的基本频带(300 Hz 到 3.4 kHz),但不适合高质量音乐播放。 | 语音通信、电话系统。 |

11.025 kHz | 比 8 kHz 提供更好的音质,但仍主要用于语音而非音乐 | 早期的语音录音、低质量的音频文件。 |

16 kHz | 提供了较好的语音清晰度,广泛应用于现代语音处理技术中。网络电话(VoIP)、语音识别系统。 | |

22.05 kHz | 能够覆盖大部分人类听觉范围的下限,适用于一些对音质要求不是非常高的音乐播放。 | 早期 CD 音轨压缩格式(如 MP3)的较低质量版本。 |

32 kHz | 提供了一个不错的平衡点,在保持较小文件大小的同时保证了相对较高的音质。 | 数字广播(DAB)、某些流媒体服务。 |

44.1 kHz | 这是红皮书 CD 标准规定的采样率,可以覆盖几乎整个可听频率范围(20 Hz - 20 kHz),是目前最常用的高质量音频采样率之一。 | CD 音质标准、大多数消费级音频设备。 |

48 kHz | 稍高于 CD 质量,常用于需要进一步处理或混音的专业环境,确保在编辑过程中不会损失音质。 | 专业音频录制、电影音轨、视频编辑软件。 |

96 kHz | 提供了更宽广的频率响应和更高的动态范围,适合追求极致音质的发烧友。 | 高分辨率音频播放、高端音响设备。 |

192 kHz | 理论上提供了最佳的频率响应,但实际上人耳难以区分超过 96 kHz 的改进,更多是为了满足特定市场需求和技术极限探索。 | 超级高分辨率音频播放、特殊音频处理。 |

小知识:通常用 k 来指代 1000,如频率 kHz;而用 K 指代 1024,1KB。

还有一些不常见的采样率:

• 24 kHz:有时用于音频压缩或流媒体传输。

• 37.8 kHz:某些专业的音频/视频同步应用中可能会用到这个不太常见的采样率。

• 176.4 kHz:主要出现在极高端的音频市场,为那些寻求绝对最高保真度的用户服务。

• 352.8 kHz:主要出现在极高端的音频市场,为那些寻求绝对最高保真度的用户服务。

在日常编程中,采样率体现为播放和录音时设置的 rate,一般用 Fs 来标识。

2.2 采样精度

常见典型采样精度如下表:

| 采样精度 | 特点 | 应用场景 |

|---|---|---|

8-bit (8 位) | 能够表示 256 个不同的幅度级别。音质较低,动态范围有限,通常用于对音质要求不高的场合。 | 早期的游戏机、玩具、某些低质量的语音应用。 |

16-bit (16 位) | 能够表示 65,536 个不同的幅度级别。提供良好的音质和动态范围,是目前最常用的音频采样精度之一。CD 音轨的标准就是 16-bit/44.1 kHz。 | CD 音质标准、大多数消费级音频设备、广播和流媒体服务。 |

24-bit (24 位) | 能够表示 16,777,216 个不同的幅度级别。相比 16-bit,提供了更大的动态范围和更高的信噪比,适合需要高质量录音和混音的专业环境。 | 专业音频录制、后期制作、高保真音响系统、电影音效。 |

32-bit 浮点 (32-bit Floating Point) | 虽然名义上是 32-bit,但实际上使用浮点数表示法,可以在极大范围内精确地表示声音信号。主要用于音频编辑和处理过程中,以避免累积误差和失真。最终输出时通常会转换为 16-bit 或 24-bit。 | 音频处理软件、数字音频工作站 (DAW)、内部音频处理。 |

除了上述常见精度外,还有一些不太常见的采样精度,主要用于特定的应用场景或实验性技术:

• 20-bit (20 位):有时用于一些专业的音频设备中,介于 16-bit 和 24-bit 之间,提供更好的音质但占用较少存储空间。

• 24-bit/32-bit 整数:这些精度在某些高端音频设备中可见,但在实际应用中不如 32-bit 浮点普遍。

2.3 声道数

一些常见配置:

| 声道类型 | 声道数 | 特点 | 应用场景 |

|---|---|---|---|

单声道(mono) | 1 | 所有声音信息通过一个通道传递,适合不需要空间感或方向性的简单音频应用。 | 早期录音、电话通信、广播、某些类型的公共广播系统。 |

双声道(立体声) | 2(左声道 L 和右声道 R) | 提供基本的空间感,能够区分左右两侧的声音来源,广泛应用于个人娱乐和媒体内容中。 | 音乐播放、电影音轨、电视广播、大多数消费级音频设备。 |

2.1 声道 | 3(左声道 L、右声道 R 和低频效果 LFE) | 在立体声基础上增加了一个用于重低音的专用通道,增强了低频效果的表现力。 | 家庭影院入门级配置、桌面音响系统。 |

4.0/4.1 声道 | 4(前置左 L、前置右 R、后置左 SL、后置右 SR)或 5(加 LFE) | 提供了前后方位的声音定位,但没有顶部或高度信息,主要用于增强环绕感。 | 早期的家庭影院系统、游戏机音频输出。 |

5.1 声道 | 6(前置左 L、前置右 R、中置 C、后置左 SL、后置右 SR 和低频效果 LFE) | 增加了中置声道以更好地支持对话和中心声音元素,并提供完整的环绕声体验。 | 现代家庭影院标准、电影院、蓝光光盘、视频游戏。 |

6.1 声道 | 7(前置左 L、前置右 R、中置 C、后置左 SL、后置右 SR、后中置 S、LFE) | 在 5.1 的基础上添加了后中置声道,进一步增强了环绕声的真实感和平滑度。 | 高级家庭影院系统、专业音频制作。 |

7.1 声道 | 声道数:8(前置左 L、前置右 R、中置 C、侧置左 LS、侧置右 RS、后置左 RL、后置右 RR 和 LFE) | 提供了更加详细的环绕声布局,特别是侧置声道可以显著提升空间感和沉浸感。 | 高端家庭影院、沉浸式音频体验、专业音频工作室。 |

Auro-3D / Dolby Atmos / DTS:X | 可变(通常为 9.1 或更多) | 这些技术不仅扩展了水平维度上的声道数量,还引入了高度信息,使得声音可以从上方传来,创造出三维的声音环境。它们可以根据房间的具体情况灵活配置扬声器的位置。 | 最新的沉浸式音频格式,用于高端家庭影院、电影院、虚拟现实 (VR) 和一些高端游戏。 |

还有一些其他特殊声道配置除了上述常见配置外,还有一些特殊的声道设置用于特定的应用场景:

• Ambisonics:一种全向立体声格式,使用多个声道来捕捉全方位的声音信息,常用于虚拟现实和 360 度视频中。

• Binaural Audio:双耳录音技术,模拟人类耳朵听到的声音,通常通过耳机播放,提供非常逼真的听觉体验。

2.4 帧 (frame)

在音频数据里,一帧(frame) 就是指一个采样数据。一帧(frame) 数据有多大,取决于采样精度和声道数。如采样精度为 16-bit、双声道的一帧(frame)的大小为:16-bit x 2 = 32-bit = 4 bytes ;又如,采样精度为 16-bit、5.1 声道的一帧(frame)的大小为:16-bit x (5 + 1)= 96-bit = 12 bytes。

在音频编程里,不管是录音还是播放,都是以帧(frame)为单位,如双通道的情况下,只播放一个通道的数据是没有意义的。Linux 下的 alsa-lib 里将帧(frame)数目类型定义为 snd_pcm_sframes_t 或 snd_pcm_uframes_t,alsa-lib 处理音频数据也是以帧(frame)为单位。

2.5 周期大小(period_size)

一个周期(period), 是指每两次声卡硬件中断之间的传输的帧(frame)数。在音频编程里,需要设置合适的周期(period),来满足采样率的要求。举个例子,假定要播放一个 22050 kHz、2 通道、6 位精度的音频数据,要怎样设置周期(period)呢?首先,我们计算出帧(frame)大小为 (16 / 8) * 2 = 4 字节,而采样率为 22050 kHz, 即每秒 22050 帧(frame), 所以每秒播放的数据量为 22050 * 4 = 88200 字节。如果期望每 100 毫秒中断 1 次,则每个中断我们需要准备 88200 / (1000 / 100) = 8820 字节数据,由于周期(period)以帧(frame)为单位,所以周期(period)应该设置为 8820 / 4 = 2205。当然也可以直接通过公式 22050 / (1000 / 100) = 2205 来计算周期(period)大小。

2.6 缓冲大小(buffer_size)

音频编程的缓冲大小(buffer_size),也是以帧(frame)为单位,一般设置为周期大小(period_size)的两倍。缓冲大小(buffer_size)没有一个具体标准,要根据具体的应用场景来进行调整设置。

2.7 数字音频接口

数字音频接口主要完成 ADC(录音) 和 DAC(播放) 功能。

| 数字音频接口 | 特点 | 应用场景 | 优点 | 缺点 |

|---|---|---|---|---|

PCM(Pulse Code Modulation) | 类似于 I2S,有 4 根类似的信号线,但音频 PCM 接口相对于 I2S,有一些显著的不同:没有严格规定的时序和信号线配置,因此可以采用多种不同的配置;通常支持多路音频传输,可以传输多个声道的音频数据,但具体配置取决于设计;通常需要外部提供时钟信号(主时钟),以确保采样和编码的同步;接口的位宽和采样率可以根据设计进行配置,具有更大的灵活性。参考:接口:了解数字音频PCM接口吗? | 音频 PCM 接口广泛用于音频设备之间的数字音频传输,包括音频编解码器、音频处理器、数字音频接口、音频放大器等。 | 高质量音频;广泛兼容,几乎所有的音频设备和系统都支持 PCM 格式;简单处理,PCM 数据可以直接用于各种音频处理算法,无需复杂的转换或解码。 | 音频 PCM 接口有较高带宽需求,功耗相对较高,复杂布线,抗干扰能力有限。 |

PDM(Pulse Density Modulation) | 一种用于数字音频信号传输的技术,通常用于麦克风和低功耗音频设备。具有高采样率、单比特流、时钟同步、简单物理接口(只有 PDM_CLK + PDM_DATA 两根线)、内置抗混叠滤波器等特点。参考:接口:简单聊下数字音频PDM接口 | 通常用于麦克风和低功耗音频设备。 | 低功耗、简单硬件实现、高质量音频、抗噪能力强、集成度高。 | PDM 信号必须经过抽取滤波才能转换为标准 PCM(脉冲编码调制)格式,增加了软件处理负担。另外,带宽需求大、有限的动态范围、抽取滤波带来的延迟较高。 |

S/PDIF (Sony/Philips Digital Interface) | 传输立体声音频信号的接口。它可以通过同轴电缆(RCA)或光纤(TOSLINK)进行连接。参考:SPDIF接口介绍 | 家庭音响、CD/DVD 播放器、数字音频接口设备、电视和音响系统等。 | 简单易用,支持高质量的音频传输;可以传输未压缩的立体声或经过压缩的多声道音频(例如 Dolby Digital);不需要额外的电源供电。 | 只能传输立体声或少量多声道音频(最多 5.1 声道);不能支持高分辨率音频(如 24-bit/192kHz 或更高采样率音频);传输距离有限,通常不超过 10 米。 |

I2S (Inter-IC Sound) | 一种用于数字音频信号传输的接口,通常用于连接音频处理芯片、DAC(数字模拟转换器)和其他音频设备。 | 嵌入式系统、音频设备内部连接、开发板等。 | 适用于设备间的短距离连接,延迟低;支持高分辨率音频。 | 仅用于设备间的内部连接,无法进行远距离传输;硬件实现较为复杂,适合开发者和嵌入式系统。 |

SAI (Serial Audio Interface) | 一种广泛用于嵌入式系统和高性能音频处理器的接口。它用于在芯片和外部音频设备之间传输串行数字音频信号。SAI 通常支持多种音频格式,如 I2S、PCM 和 TDM(时间分复用)。 | 嵌入式音频设备、数字信号处理器(DSP)、音频解码器、声音处理模块、音响系统等。 | 高度灵活,支持多种音频协议(如 I2S、PCM、TDM),适应性强;可以用于单通道到多通道音频信号的传输,支持大范围的采样率和分辨率;适用于嵌入式系统,功耗较低,通常集成在 SOC(系统芯片)中。 | 主要用于短距离、高速数据传输,不适合远距离传输;需要专门的硬件支持,不如标准音频接口(如 USB 或 S/PDIF)普及;设计和实现较为复杂,尤其是在多通道音频应用中。 |

McASP (Multichannel Audio Serial Port) | 由德州仪器(Texas Instruments,TI)开发的一种多通道串行音频接口,用于连接 DSP 和音频处理器之间的多路音频数据流。它能提供高质量的多通道音频传输,常见于专业音频和嵌入式系统。 | 专业音频设备、嵌入式音频系统、广播设备、车载音响系统、数字音频工作站等。 | 支持多通道音频传输,通常可传输 8、16、32 通道音频信号,适合高密度音频应用;高灵活性,支持多种音频格式(如 I2S、PCM、TDM);支持高速数据传输和高采样率,适合专业音频处理;在嵌入式系统中,McASP 的接口和配置可以根据需要进行定制,适应不同的音频处理需求。 | 设计和实现复杂,特别是在多通道、同步信号传输的场景中;主要用于专业音频和嵌入式设备,设备和开发工具链要求较高;不如传统的音频接口(如 USB 和 S/PDIF)普及,硬件支持较为局限。 |

USB (Universal Serial Bus) | 一种常见的数字接口,广泛应用于各种音频设备,如 USB 声卡、音频接口、MIDI 控制器等。 | 个人电脑音频处理、外部音频设备连接、移动音频工作站等。 | 普及度极高,几乎所有的计算机和音频设备都支持 USB;即插即用,易于安装和配置;通过 USB 连接可以实现高达 24-bit/192kHz 的高质量音频传输。 | 通常有延迟问题(尤其在大负载或较低端的接口上),可能影响实时音频处理;带宽有限,过多的设备同时连接可能导致性能下降。 |

Bluetooth | 蓝牙是一种无线技术,支持在短距离内传输音频信号,常用于耳机、扬声器、智能音响等设备。 | 无线耳机、无线音响、手机与音响的连接等。 | 无线传输,便捷且无需布线;适用于日常消费类设备,普及度高。 | 音质可能受限,尤其是较低的传输标准(如 SBC 编解码器);传输距离有限,通常为 10 米以内;对于高质量音频传输(如无损音频)来说,蓝牙存在带宽限制。 |

AES/EBU (Audio Engineering Society/European Broadcasting Union) | 专业的数字音频接口,通常通过 XLR 接口进行传输。它支持平衡信号,可以传输高质量的音频信号。 | 专业音频设备,如广播设备、录音棚、现场音响系统等。 | 提供平衡信号,有助于减少噪声和干扰;支持更高质量的音频传输,可以支持多声道音频和高采样率。 | 主要用于专业领域,成本较高,设备不普及;接口和电缆较为笨重。 |

ADAT (Alesis Digital Audio Tape) | 一种多通道数字音频接口,可以通过光纤传输最多 8 个音频通道,广泛用于专业音频设备之间的多通道音频传输。 | 录音棚、音频接口、数字混音台等。 | 支持多通道音频传输,适用于需要大量音频通道的场合;光纤连接减少了电磁干扰。 | 对于更高的采样率(如 96kHz)时,通道数会减少(例如,采样率高于 48kHz 时,仅支持 4 通道传输);在长距离传输时可能会出现信号衰减。 |

FireWire (IEEE 1394) | 一种高带宽的接口,广泛用于高质量音频和视频传输,常用于音频接口和视频设备之间。 | 专业音频接口、数字录音棚、视频编辑等。 | 提供较高的带宽,适用于高质量的音频和视频传输;支持多设备串联,可以通过一个端口连接多个设备。 | FireWire 接口不如 USB 和 Thunderbolt 普及,很多现代设备不再支持;带宽虽然高,但仍受限于一定的传输速率(尤其是 400Mbps 和 800Mbps 版本)。 |

Thunderbolt | 由英特尔和苹果公司联合开发的一种高带宽接口,支持高速数据传输、视频输出和音频传输。 | 专业音频接口、视频制作、移动工作站等。 | 极高的传输速率,适合多通道音频和视频的传输;支持多种设备的链式连接。 | 成本较高,设备和接口不如 USB 普及;需要兼容的硬件和电缆。 |

MADI (Multichannel Audio Digital Interface) | 一种高性能的数字音频接口,能够传输多达 64 路音频信号(通过光纤或同轴电缆)并支持高达 96kHz 的采样率。 | 大型音响系统、广播、专业录音和后期制作等。 | 可以传输非常多的音频通道,适用于大型系统;支持长距离传输(通过光纤可达数百米)。 | 成本较高,通常用于专业应用;并非所有设备都支持 MADI,因此设备兼容性较差。 |

2.7.1 I2S

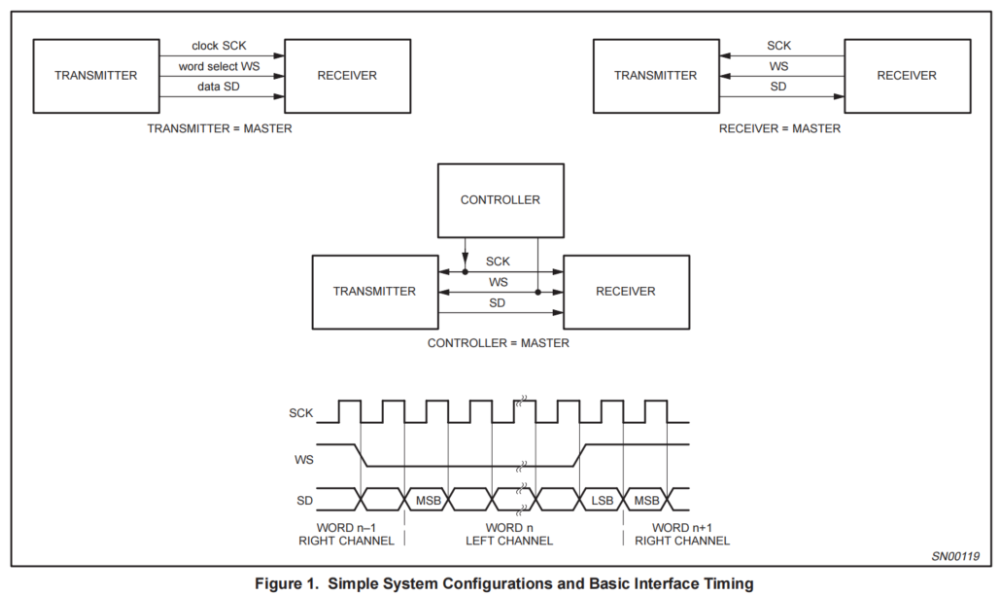

对以上这些数字音频接口,这里只挑 I2S 进行说明,对其他类型接口感兴趣的读者,可自行查阅相关资料。先来看一下 I2S 总线音频接口和其时序图:

从上图可以看到,I2S 既可以工作在主模式(master),也可以工作在从模式(slave),差别在于哪一方给数据同步时钟(Continues Serial Clock,SCK)和左右声道时钟(WS),给出时钟的一方就是 master,另一方则为 slave。I2S 有 3 根信号线:SCK,WS,SD。SCK 也称为位时钟(BCLK,Bit Clock),即每个时钟周期传输一位数据;WS 也叫 LRCK(Left-Right Clock),用来切换左右声道;SD(Serial Data)则是数据线,数据位宽可以根据具体应用而变化,数据位宽也即前面所说的采样精度。TX 方向为 Serial Data Out(SDOUT),RX 方向为 Serial Data In(SDIN)。根据通信时序的细微差异,I2S 时序可以进一步细分为 I2S Philips标准、左对齐(MSB)标准、右对齐(LSB)标准这 3 类,感兴趣的读者可查阅相关资料。

最后,再来介绍一下 I2S 时钟的计算方法。假定采样频率 Fs 为每秒 48kHz,双声道,采样精度为 32-bit,则 SCK 的计算过程如下:每秒采样的数据为 48000 * (32 / 8) * 2 = 384,000 字节,转换为采样的 bit 总数则为 192,000 * 8 = 3,072,000 bits,这也就是说,每秒要出 3,072,000 个 SCK 位时钟,也即 SCK 的频率为 3,072,000 / 1000 / 1000 = 3.072MHz。通常来讲,对于支持 I2S 接口的音频 CODEC,都会有一个 MCLK(Master Clock) 输入信号,用来产生 SCK 和 WS 时钟,MCLK 应该是 SCK 和 WS 的整数倍,方便可以通过分频产生需要的 SCK 和 WS 时钟。如对于例中需要 3.072MHz 的 SCK、48kHz 的 WS 时钟,可以给 CODEC 输入一个 12.288 MHz 的 MCLK,通过 4 分频得到 3.072MHz 的 SCK(12.288 MHz / 4 = 3.072MHz),而通过 256 分频得到 48kHz 的 WS(12.288 MHz / 256 = 48kHz),这是一个真实的使用场景。对于这些计算,我们提炼几个公式:

# 根据 采样频率、采样精度、声道数 计算需要的 SCK/BCLK 。

# 在多声道的场景下,如 TDM ,声道数可能会大于 2 ,如

# McASP 的 TDM 模式。

SCK = 采样频率 * 采样精度 * 声道数

# 通过对 MCLK 进行分频,得到要求的 SCK/BCLK、WS/LRCK 。

# MCLK 通常要求是 Fs 的整数倍,典型的如 128fs, 256fs, 512fs 。

# 假定 Fs = 48kHz,则这些典型的 MCLK 分别为:

# 128 * fs = 128 * 48kHz = 6.144 MHz

# 256 * fs = 256 * 48kHz = 12.288 MHz

# 512 * fs = 512 * 48kHz = 24.576 MHz

SCK = MCLK / N # N 为分频系数

WS = MCLK / M # M 为分频系数

上面的分频公式,是一种最简的方式(也确实存在这种真实场景),但具体要怎么设置,需要看 音频 CODEC 芯片手册时钟部分的逻辑框图以及相关寄存器。

2.8 音频工具

| 工具 | 功能特性 | 应用场景 |

|---|---|---|

Audacity | 一款开源的音频编辑和录制软件,广泛用于音频处理、剪辑、录音和分析。支持多轨音频编辑、音频效果插件和多种文件格式导入/导出。支持多轨编辑,能够对多条音频轨道进行编辑和同步处理;提供各种音频效果,如均衡器、混响、压缩等;支持 VST 插件,能够加载第三方音效处理插件;实时音频录制和波形视图分析,方便进行音频信号的观察和编辑。 | 用于音频录制、编辑和调试,尤其适合音频开发人员、音乐制作人和声音工程师。 |

JACK Audio Connection Kit (JACK) | 一个低延迟音频服务器,用于在不同的音频应用程序之间建立音频连接,主要用于 Linux 系统,但也支持 macOS 和 Windows。低延迟、高性能的音频传输;允许不同的音频应用程序和硬件之间实时连接和信号传输;强大的路由和连接功能,能够将输入输出设备、应用程序和插件灵活连接。 | 用于多应用音频系统的调试和集成,广泛用于音乐制作、实时音频处理、现场表演以及实验性音频应用。 |

Soundflower (macOS) | 一个 macOS 上的虚拟音频驱动程序,用于在应用程序之间传输音频信号。它允许用户在不需要物理音频设备的情况下进行音频的捕获和重定向。提供虚拟音频接口,将音频从一个应用程序传输到另一个应用程序;支持音频输出的捕获和流转,非常适合进行屏幕录制、直播、音频处理等任务;作为虚拟音频设备,它与 macOS 的标准音频系统无缝集成。 | 常用于录制和路由音频流,尤其是在 macOS 系统上进行音频开发和调试时。 |

Wireshark | 一种开源的网络协议分析工具,尽管它主要用于网络流量的捕获和分析,但也能够分析音频流(如 VoIP)在网络上的传输情况。强大的网络协议分析功能,能够捕获和分析各种网络协议中的音频数据包;支持实时捕获和离线分析网络音频流;提供详尽的包数据解码和时序分析,帮助开发人员诊断网络音频传输中的延迟、丢包等问题。 | 用于分析音频数据在网络中的传输,尤其适用于开发和调试基于网络的音频应用,如 VoIP、流媒体等。 |

Reaper | 一款功能强大的数字音频工作站(DAW),用于录制、编辑和混音音频。它广泛应用于音乐制作、音频开发和后期处理。强大的多轨编辑、混音和自动化功能;支持 VST 插件和其他音频插件,允许用户在工作流中集成第三方效果和处理器;内置的音频调试工具,如波形视图、频谱分析、实时信号监控等;低延迟、高性能的音频处理,适合复杂的音频工程和调试工作。 | |

FFmpeg | 一个开源的音频和视频处理工具,广泛用于音频和视频格式的转换、流媒体处理、编解码器开发等。支持各种音频格式的转换、编解码和处理,能够处理几乎所有的音频格式;提供命令行工具,适合批处理和自动化工作流;支持实时流媒体的转码和调试,适用于音频/视频同步问题的分析;提供强大的调试功能,通过日志和详细的输出帮助开发人员分析音频数据。 | 用于音频格式转换、流媒体调试、音频/视频同步分析等。 |

Pure Data (Pd) | 一款开源的视觉编程语言,专注于实时音频、视频和互动艺术的创建。它能够用于音频信号处理、音效合成和音频实验。通过图形化编程界面进行音频处理、合成和效果设计;实时音频处理和信号路由,适合音频创作和实验;支持多通道音频输入输出,适用于多音轨音频开发和调试;丰富的社区和第三方扩展,提供了大量的音频处理模块和插件。 | 用于音频信号的实时处理、效果生成和算法开发,适合创意音频开发和实验性项目。 |

Matlab / Simulink | 常用于信号处理、算法设计和系统建模的工程软件,适用于音频信号的数学建模和仿真。提供强大的数学工具箱,适用于音频信号的滤波、分析、变换等操作;支持音频算法的仿真和实时测试,能够在仿真环境中调试音频系统;支持与硬件系统的集成,适合进行音频硬件设计和验证。 | 在音频处理算法的开发和调试中广泛使用,特别是在科研和工程领域。 |

LabVIEW | 由 National Instruments 开发的图形化编程环境,广泛用于数据采集、仪器控制和信号处理。图形化编程环境,适合快速开发和原型设计;强大的数据采集和信号处理功能,支持实时音频信号的调试和优化;能够与各种硬件设备(如声卡、传感器等)进行接口,适用于音频设备的开发和测试。 | 用于音频硬件调试、实时音频信号采集和处理,尤其在实验室环境中应用广泛。 |

VST Host (例如 Savihost) | 用于加载和运行 VST 插件(虚拟效果和虚拟乐器)的软件,适用于音频开发和调试。支持加载各种 VST 插件并进行实时测试;方便调试音频效果、虚拟乐器的参数设置和响应;提供简洁的界面,适合开发者快速测试插件的功能和性能。 | 用于测试和调试 VST 插件,尤其在开发音频效果器或虚拟乐器时非常有用。 |

Cool Edit Pro | 由 Syntrillium Software 开发,后来被 Adobe 收购并改名为 Adobe Audition。它是专业音频制作、编辑和后期处理的经典工具,特别适用于音频编辑、录音、混音、音效设计等任务。尽管已经被 Audition 替代,Cool Edit Pro 在音频开发和调试历史中仍然具有重要的地位。支持音频编辑与处理(多轨编辑、非破坏性编辑、精确波形编辑、多种音频效果)、多种音频格式(如 WAV、MP3、AIFF、FLAC、OGG 等)、 高级音频处理功能(噪声消除、频谱分析、音频修复)、实时音频处理、多平台和硬件支持等。 | 音频录制与编辑、音频后期制作、音频测试与调试。 |

Adobe Audition | 作为 Cool Edit Pro 的继任者,保留了 Cool Edit Pro 的许多强大功能,同时进行了大量的增强和现代化改进。它提供了一整套用于音频创作、编辑、混音、修复和优化的工具,非常适合专业音频工程师、音乐制作人、视频编辑以及广播和电影后期制作人员使用。Audition 需要订阅费用,对于预算有限的用户可能比较昂贵。 | 音乐制作、广播和播客、视频后期制作、声音设计和电影音效、教育与训练。 |

Audio Precision | 提供了一系列精密的音频分析仪和相关工具(硬件+软件),广泛应用于消费电子、专业音响、汽车音响、半导体和其他涉及音频信号处理的行业。其产品帮助工程师和技术人员确保音频设备和系统的性能达到高标准。http://cn.ap.com/ | 消费电子:包括智能手机、平板电脑、耳机、扬声器等产品的音频质量评估。大学实验室和研究机构使用 Audio Precision 的设备来进行前沿的音频科学研究和教学演示。 |

3. 参考资料

[1] 一文搞懂I2S通信总线

[2] 【I2S】数字音频接口—I2S总线协议基本概念

[3] AP 音频测试

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?